- Vorwort

- I Installationsvorbereitung

- 1 Planung für SUSE Linux Enterprise Server

- 2 Installation auf AMD64 und Intel 64

- 3 Installation in der Arm AArch64-Architektur

- 4 Installation auf IBM POWER

- 5 Installation unter IBM Z und LinuxONE

- 6 Installation auf Virtualisierungshosts

- 7 Installation auf Hardware, die zum Zeitpunkt der Freigabe nicht unterstützt wurde

- II Installationsvorgang

- 8 Boot-Parameter

- 9 Installationsschritte

- 9.1 Übersicht

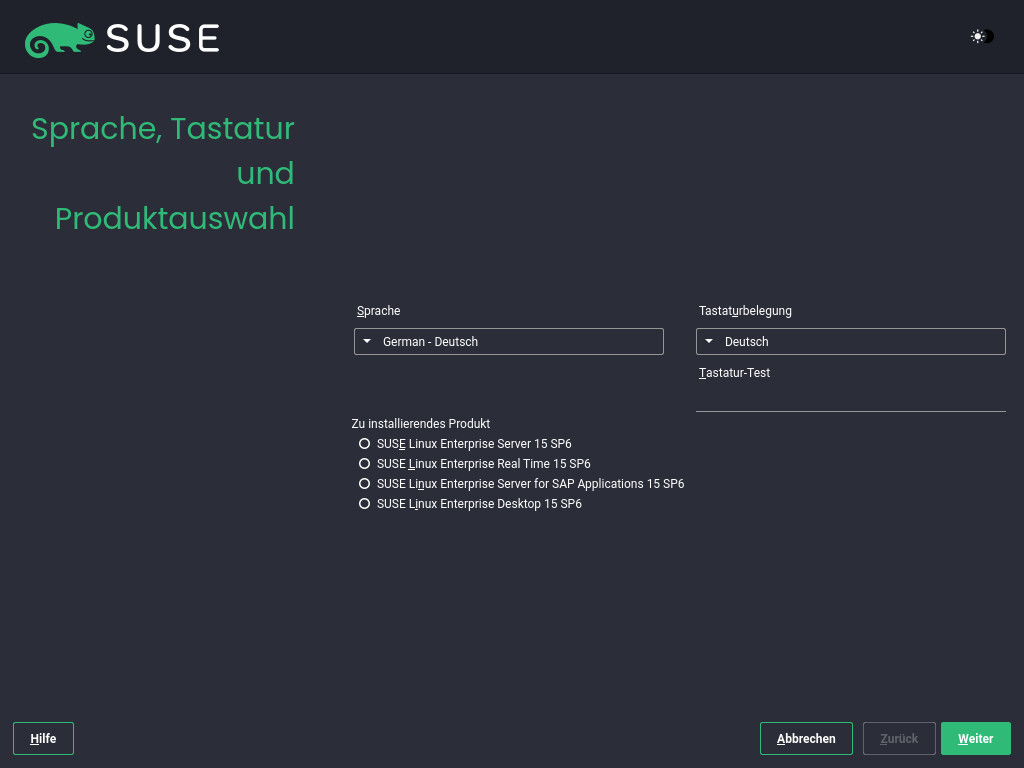

- 9.2 Selbstaktualisierung des Installationsprogramms

- 9.3 Auswahl der Sprache, der Tastatur und des Produkts

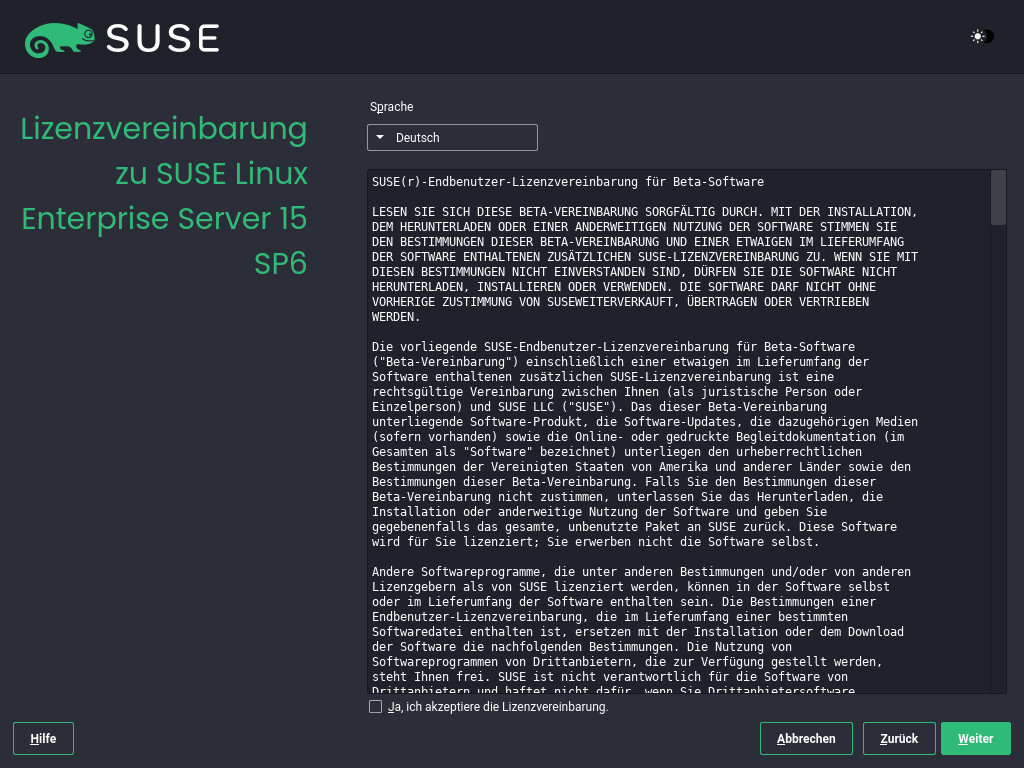

- 9.4 Lizenzvereinbarung

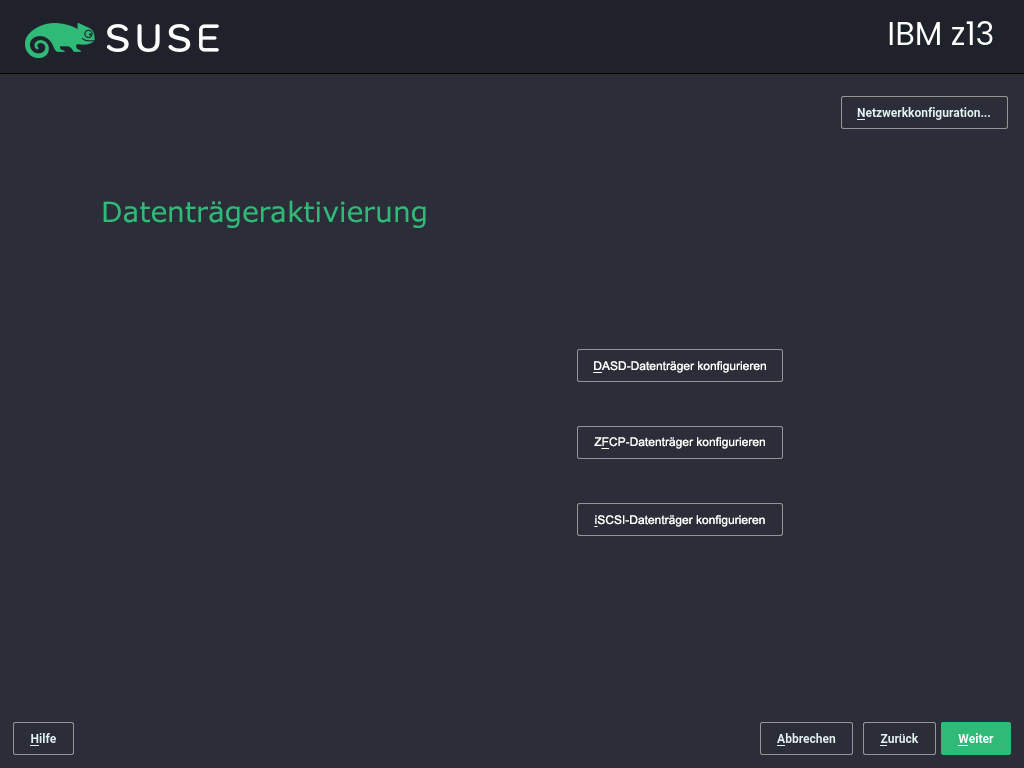

- 9.5 IBM Z: Datenträgeraktivierung

- 9.6 Netzwerkeinstellungen

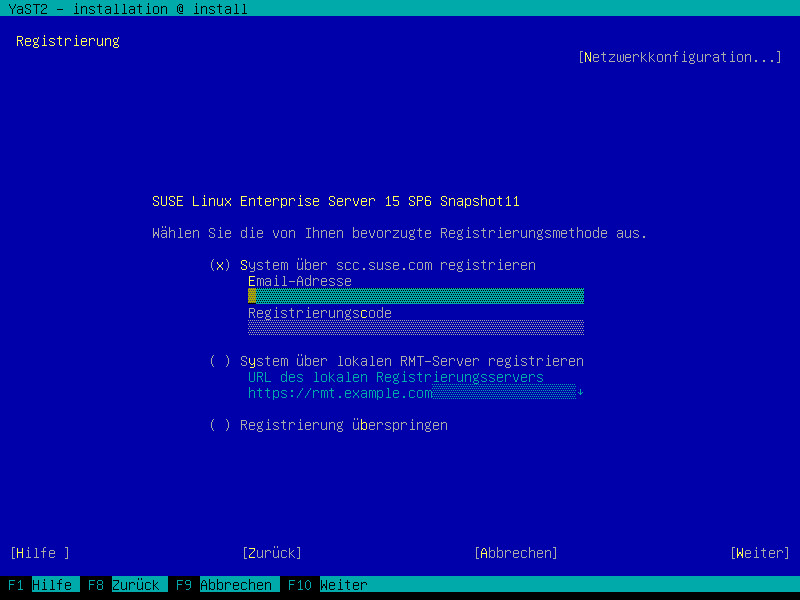

- 9.7 Registrierung

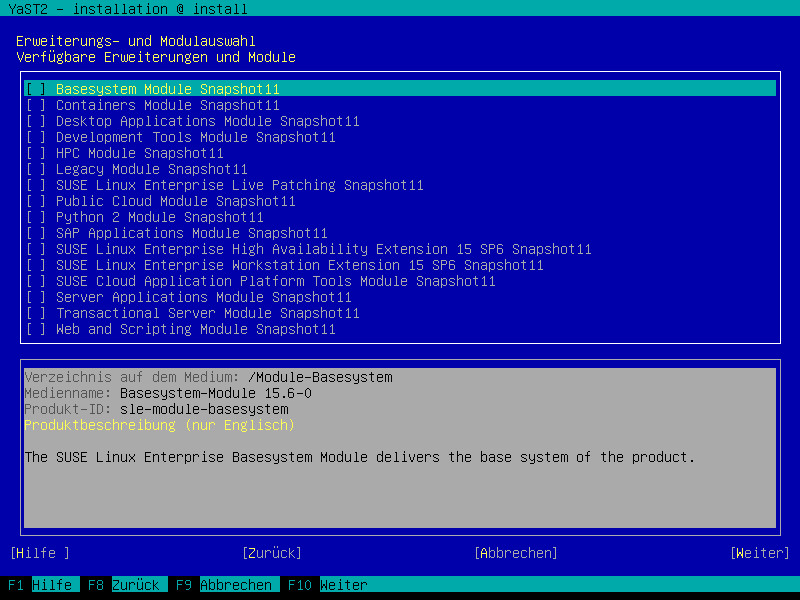

- 9.8 Auswahl der Erweiterungen und Module

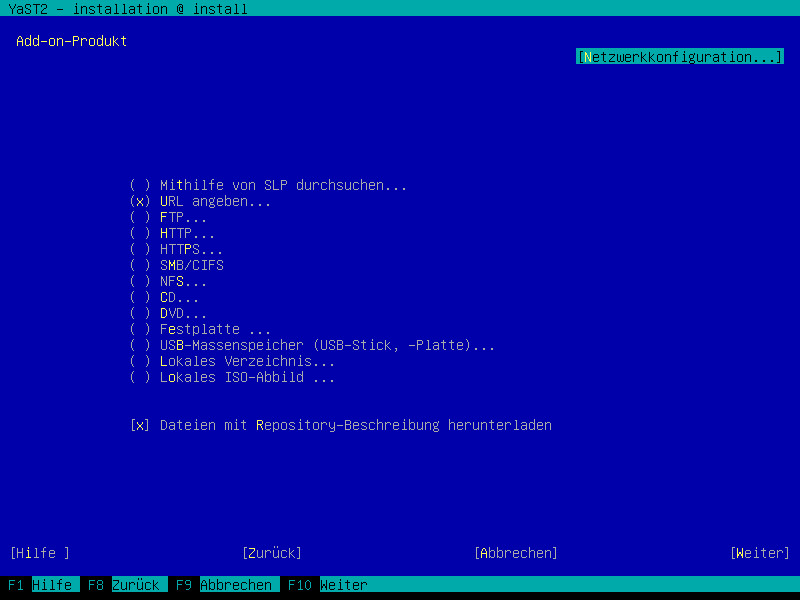

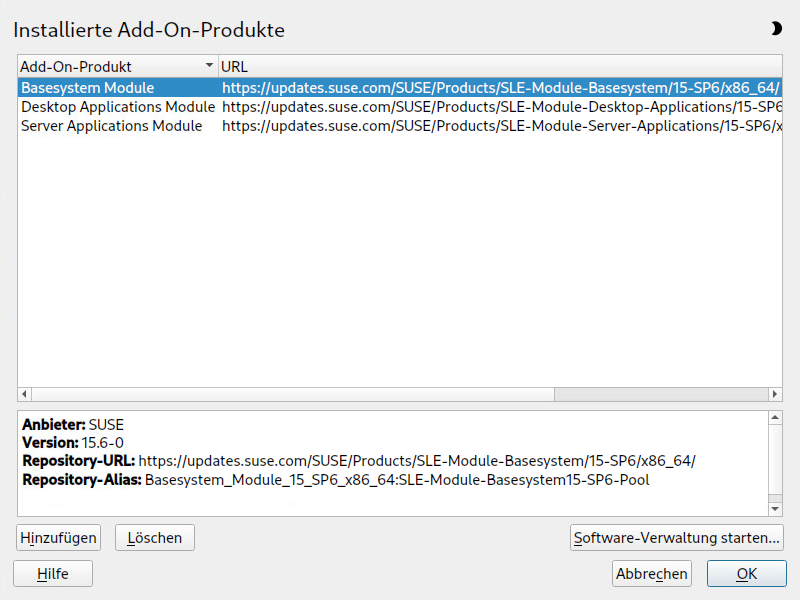

- 9.9 Add-on-Produkt

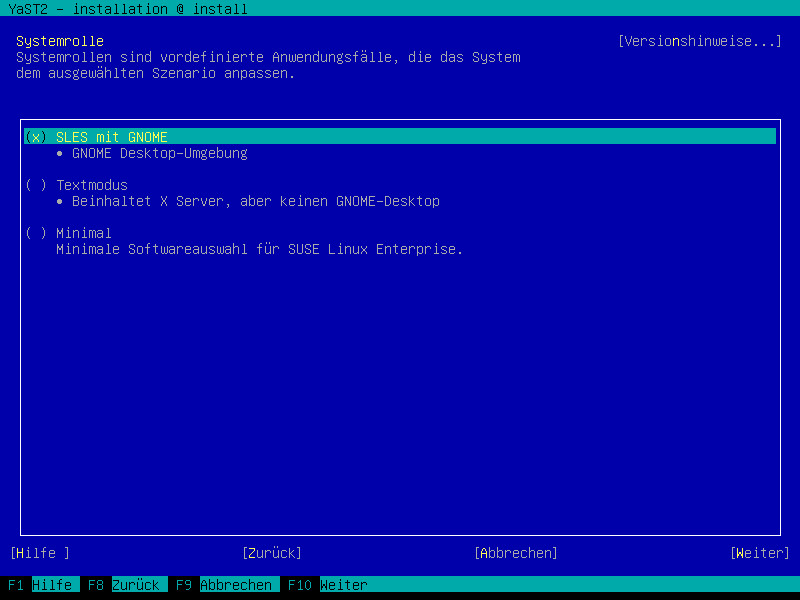

- 9.10 Systemrollen

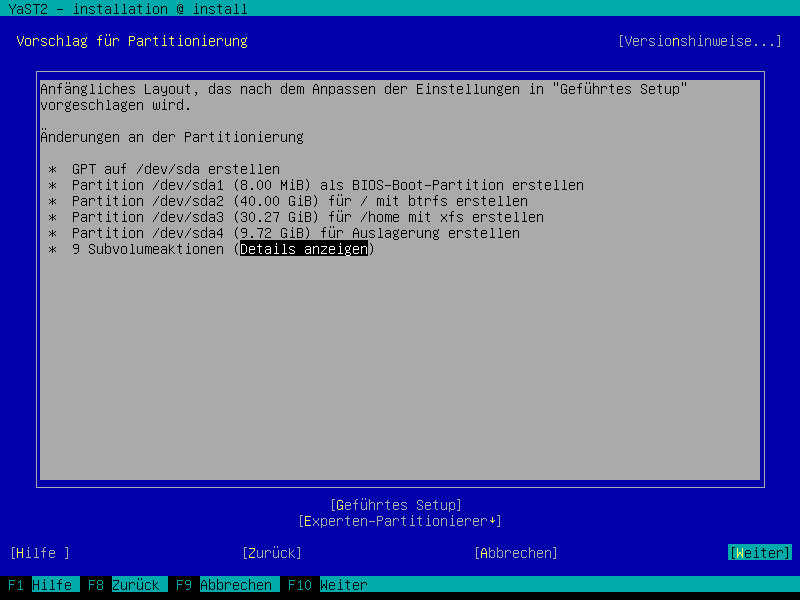

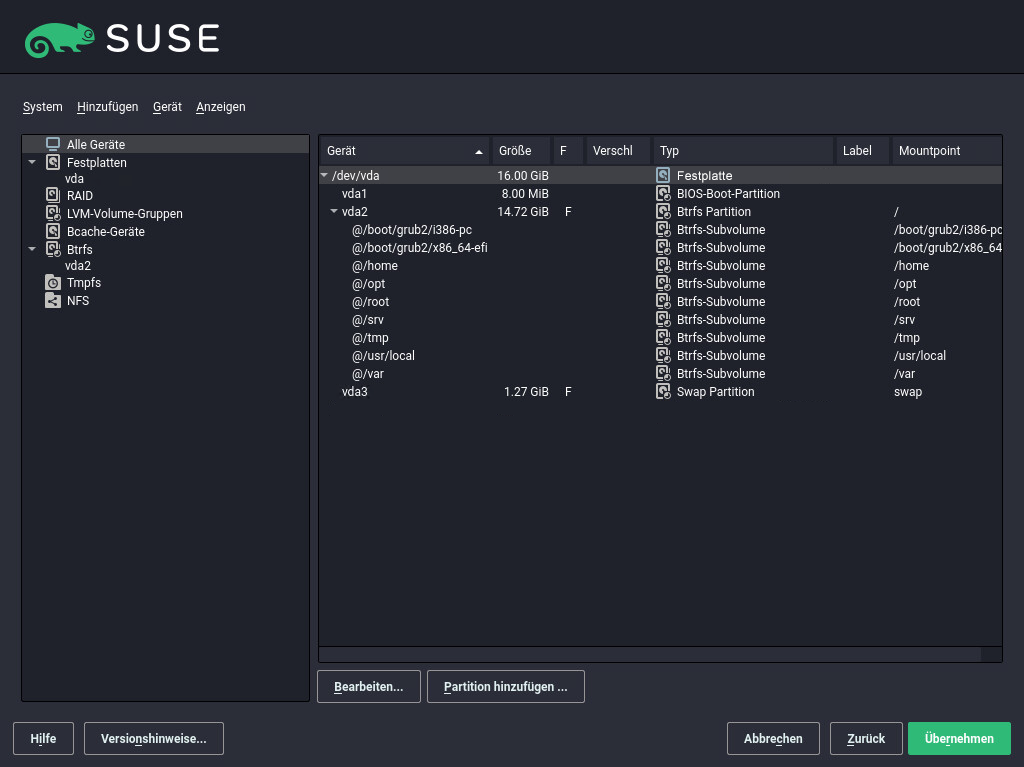

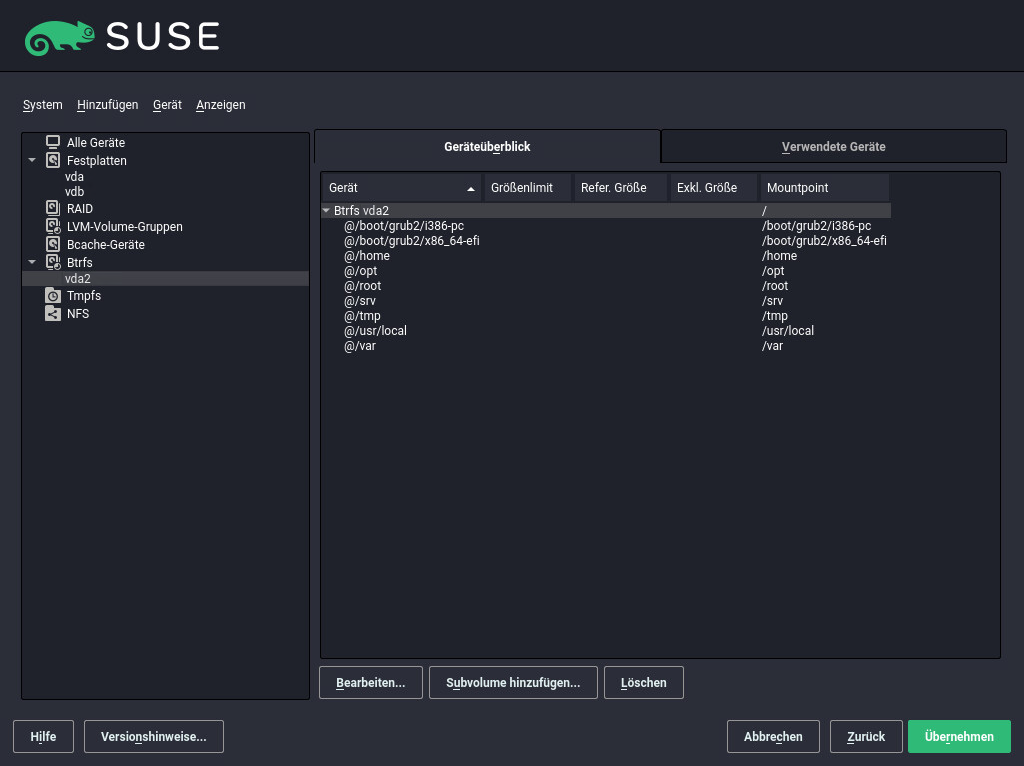

- 9.11 Partitionierung

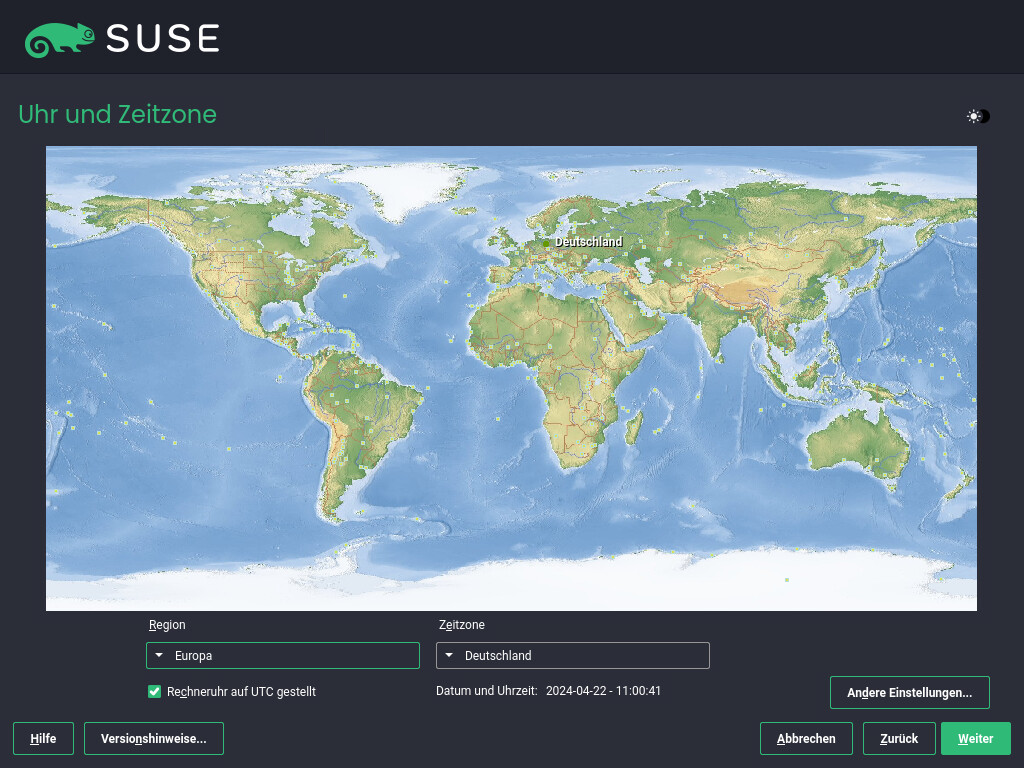

- 9.12 Uhr und Zeitzone

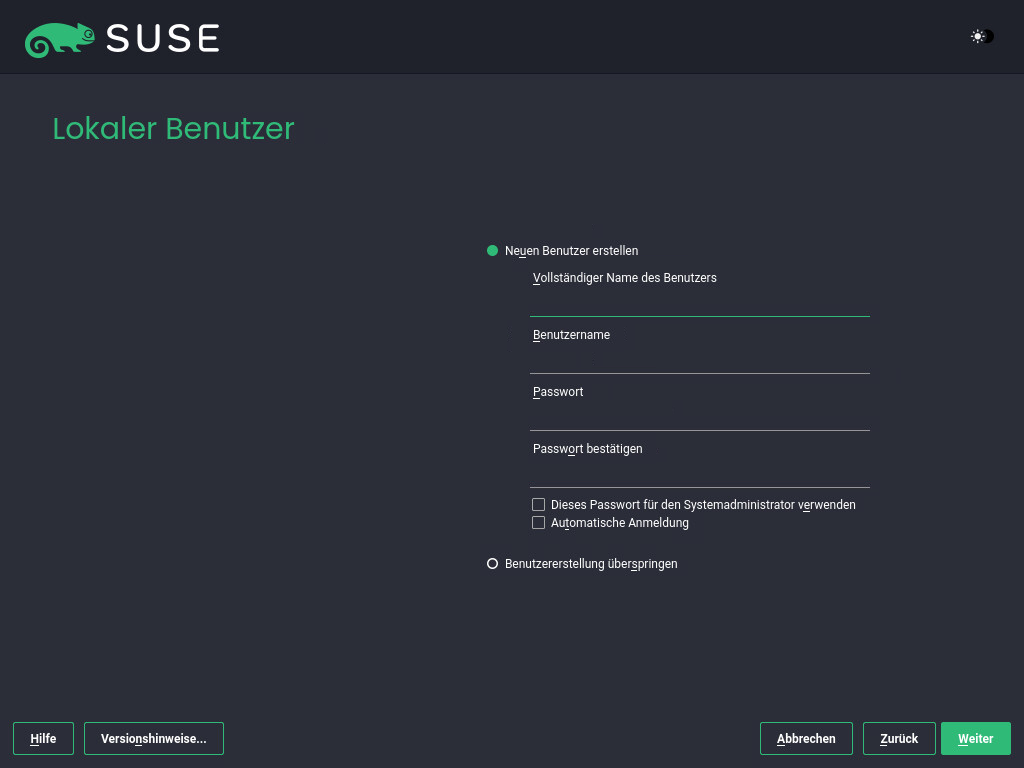

- 9.13 Erstellen von neuen Benutzern

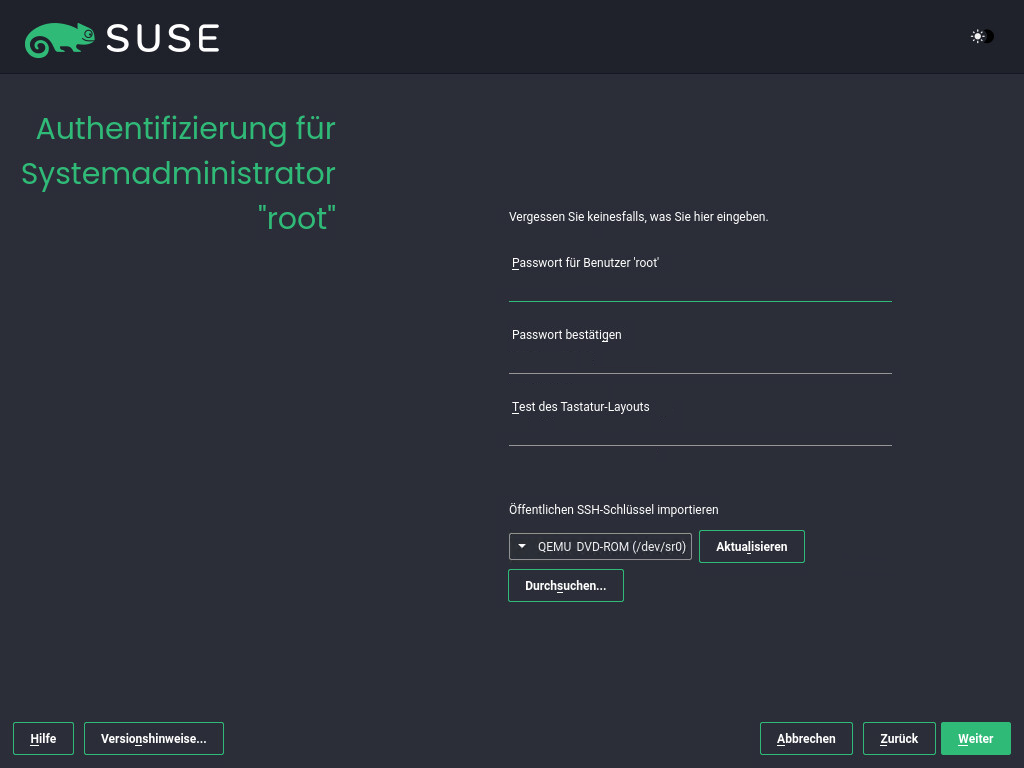

- 9.14 Authentifizierung für den Systemadministrator-

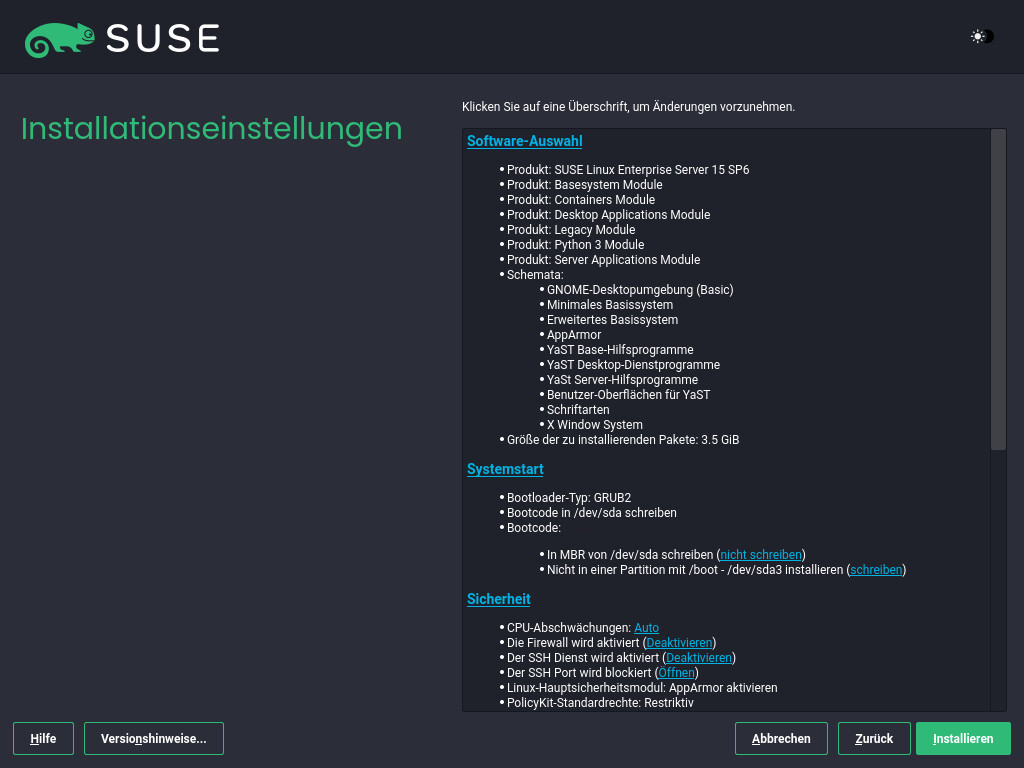

root - 9.15 Installationseinstellungen

- 9.16 Ausführen der Installation

- 10 Registrieren von SUSE Linux Enterprise und Verwalten von Modulen/Erweiterungen

- 11

- 12 Ferninstallation

- 13 Fehlersuche

- III Anpassen von Installations-Images

- IV Einrichten eines Installationsservers

- 17 Einrichten einer Netzwerkinstallationsquelle

- 17.1 Einrichten eines Installationsservers mithilfe von YaST

- 17.2 Manuelles Einrichten eines NFS-Repositorys

- 17.3 Manuelles Einrichten eines FTP-Repositorys

- 17.4 Manuelles Einrichten eines HTTP-Repositorys

- 17.5 Verwalten eines SMB-Repositorys

- 17.6 Verwenden von ISO-Images der Installationsmedien auf dem Server

- 18 Vorbereiten der Netzwerk-Boot-Umgebung

- 19 Einrichten eines UEFI HTTP-Boot-Servers

- 20 Installieren von benutzerdefinierten Vorinstallationen

- 17 Einrichten einer Netzwerkinstallationsquelle

- A Image-Erstellung und Anlegen von Produkten

- B GNU licenses

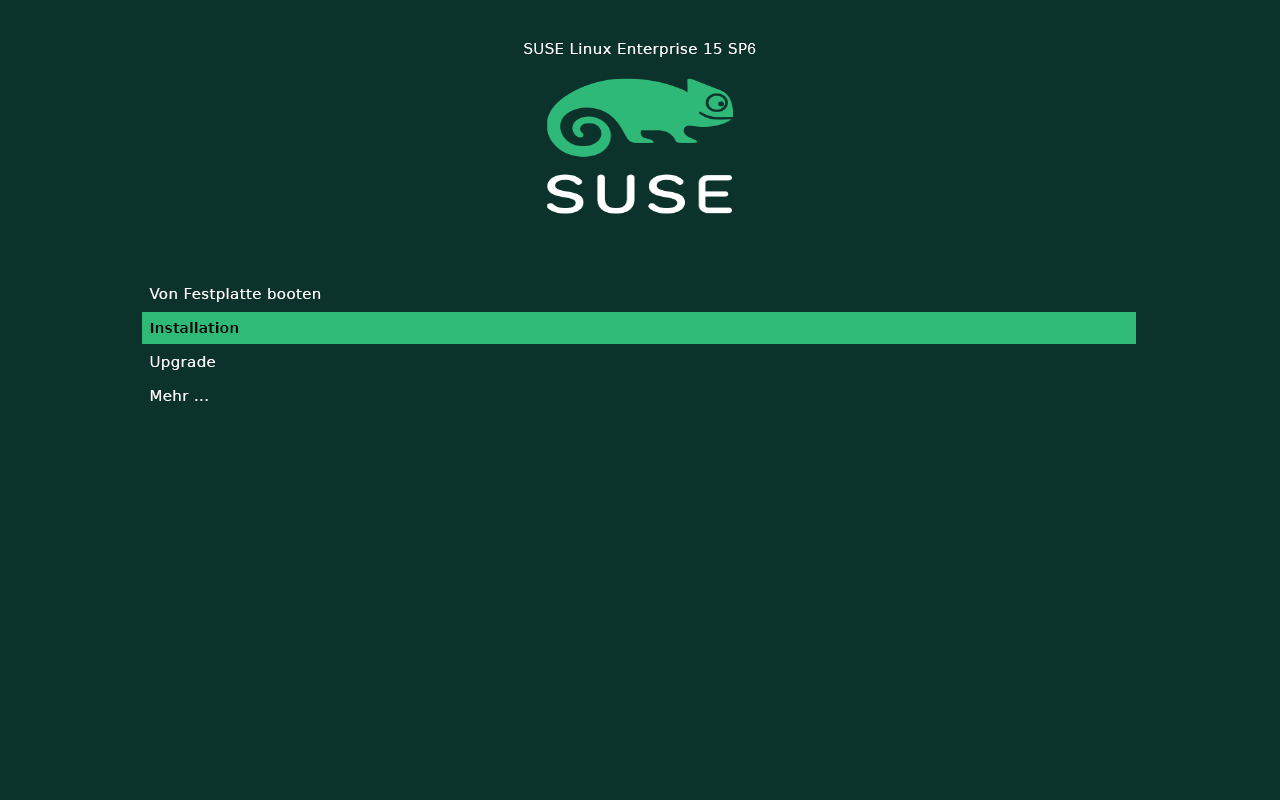

- 8.1 Der Boot-Bildschirm auf Computern mit herkömmlichem BIOS

- 8.2 Der Boot-Bildschirm auf Computern mit UEFI

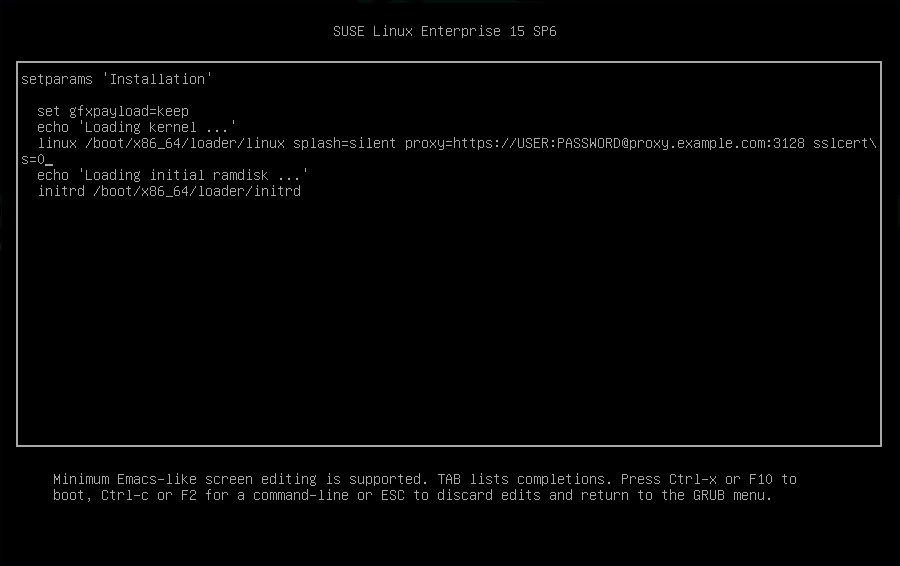

- 8.3 Editor für GRUB-Optionen

- 9.1 Auswahl der Sprache, der Tastatur und des Produkts

- 9.2 Lizenzvereinbarung

- 9.3 Datenträgeraktivierung

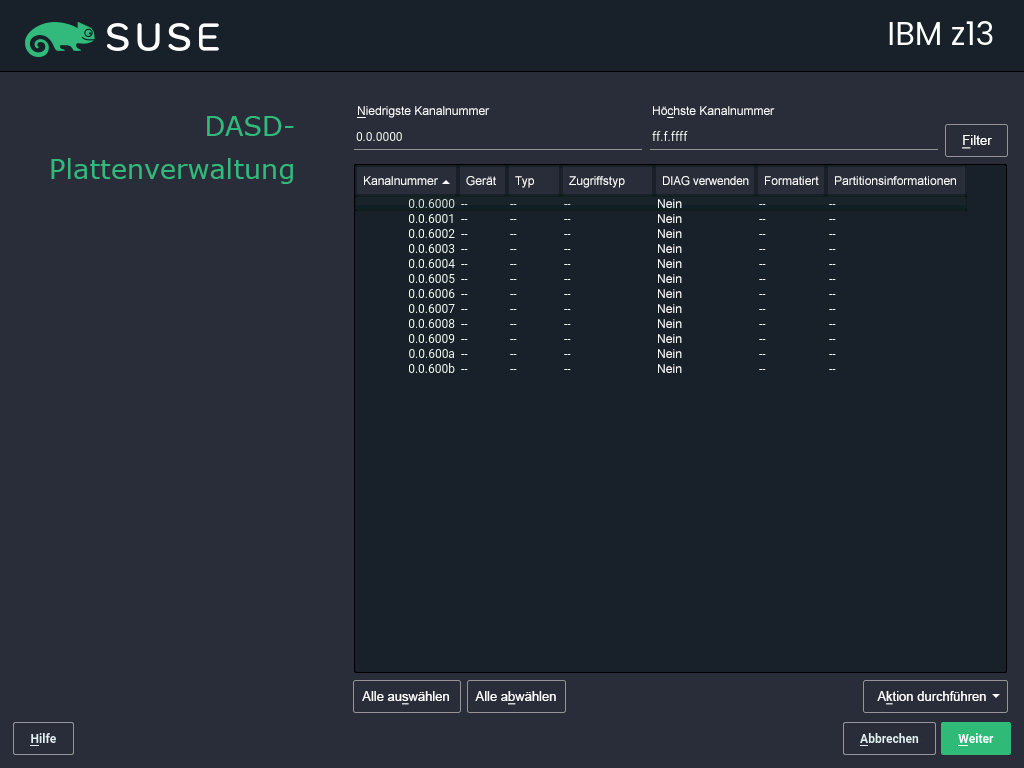

- 9.4 DASD-Datenträgerverwaltung

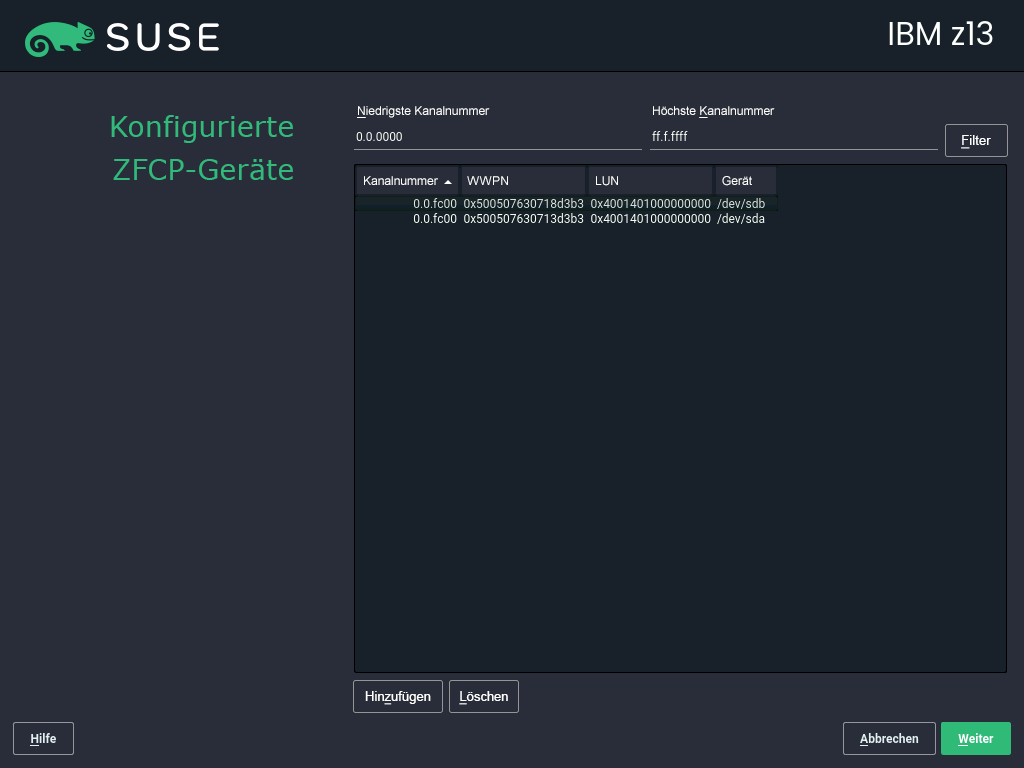

- 9.5 Konfigurierte zFCP-Geräte

- 9.6 Netzwerkeinstellungen

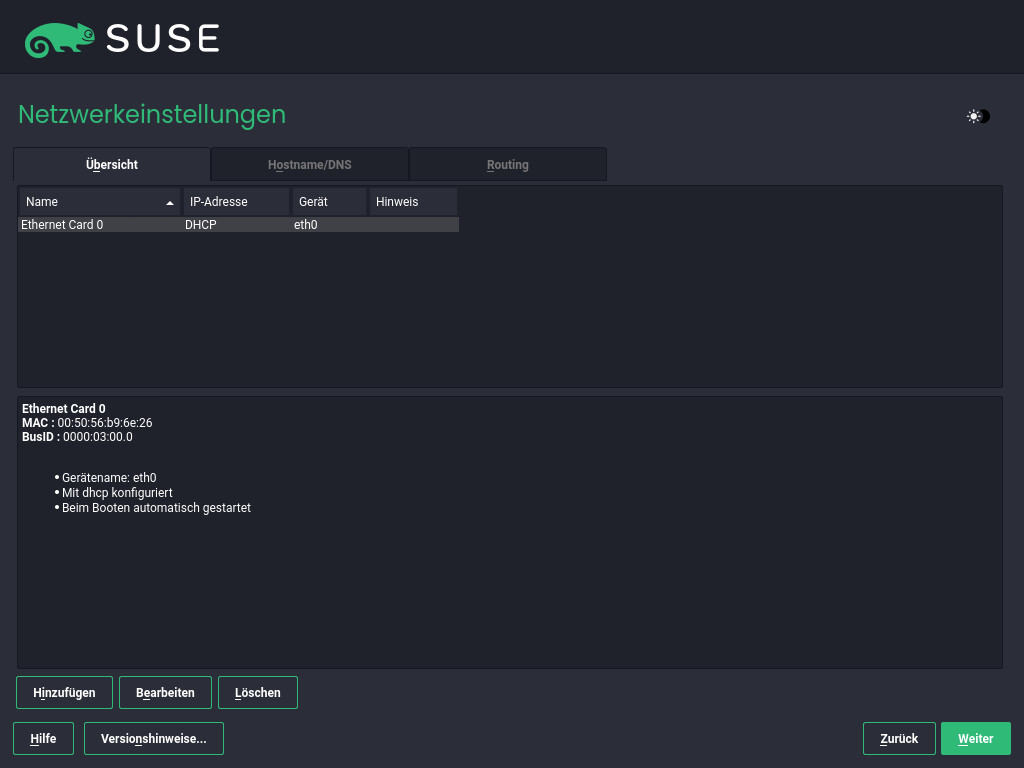

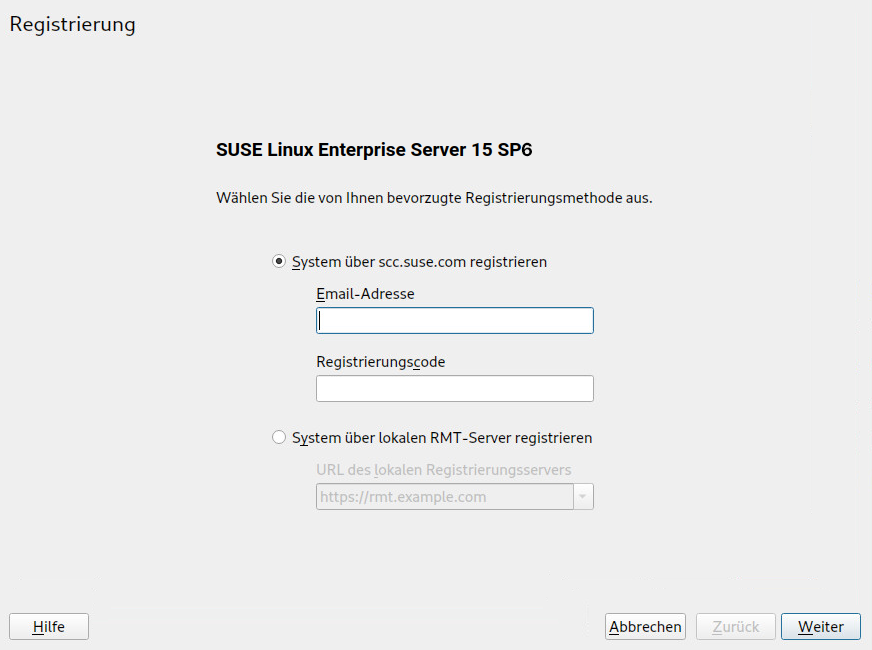

- 9.7 Registrierung beim SUSE Customer Center

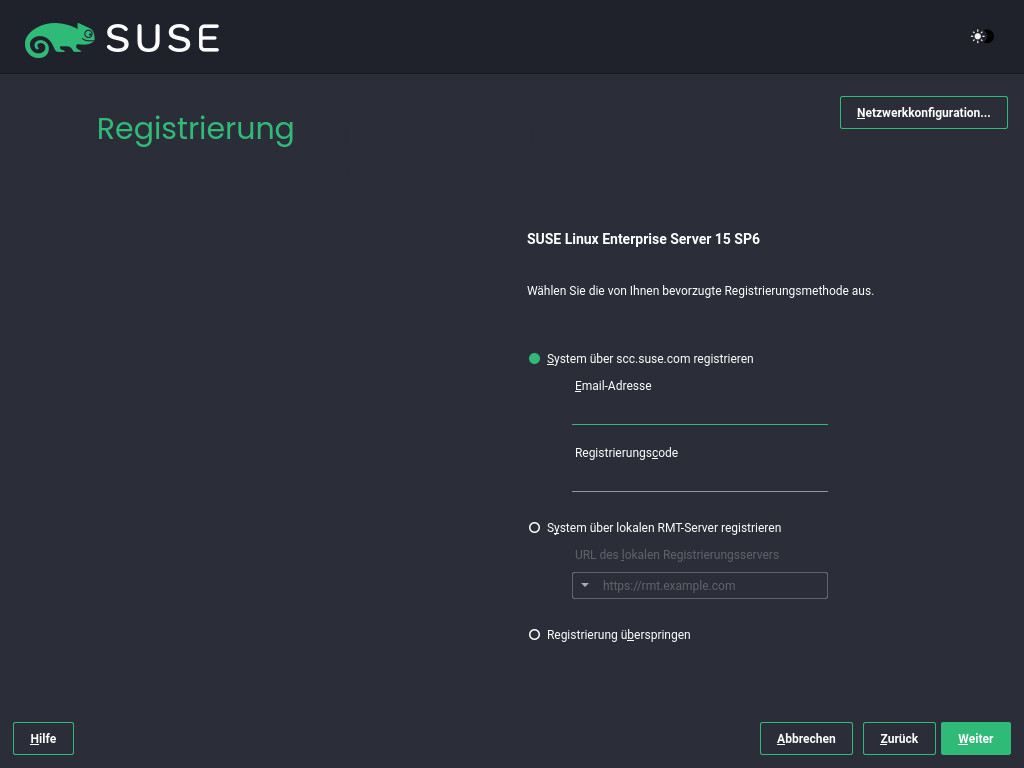

- 9.8 Installation ohne Registrierung

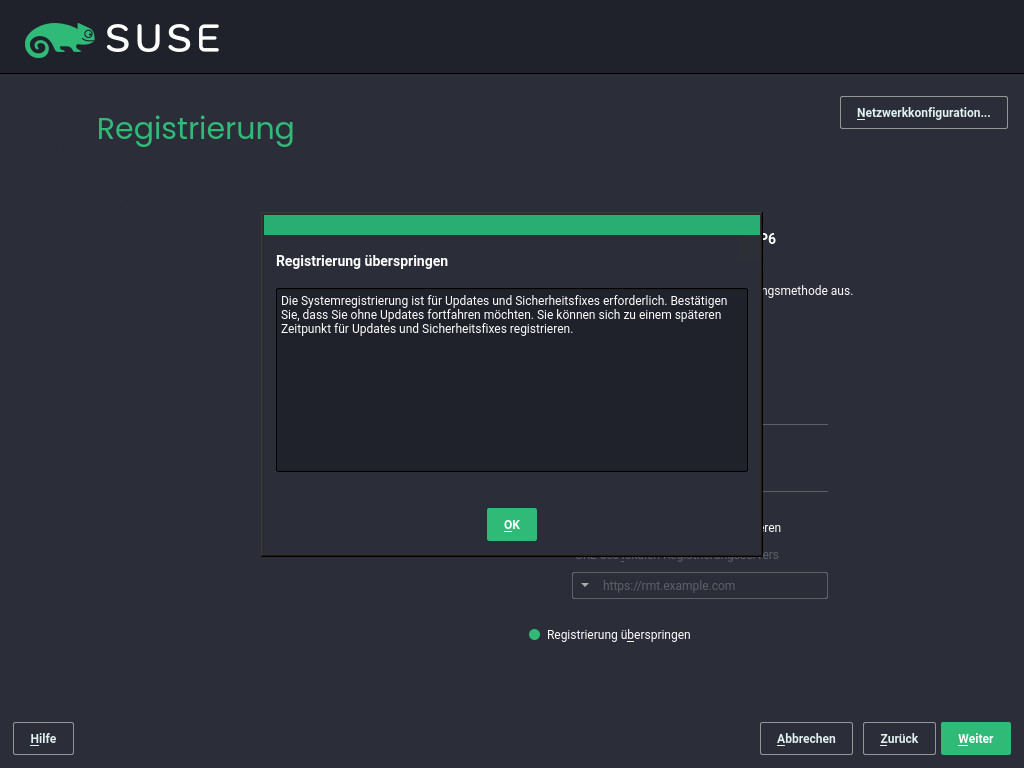

- 9.9 Auswahl der Erweiterungen und Module

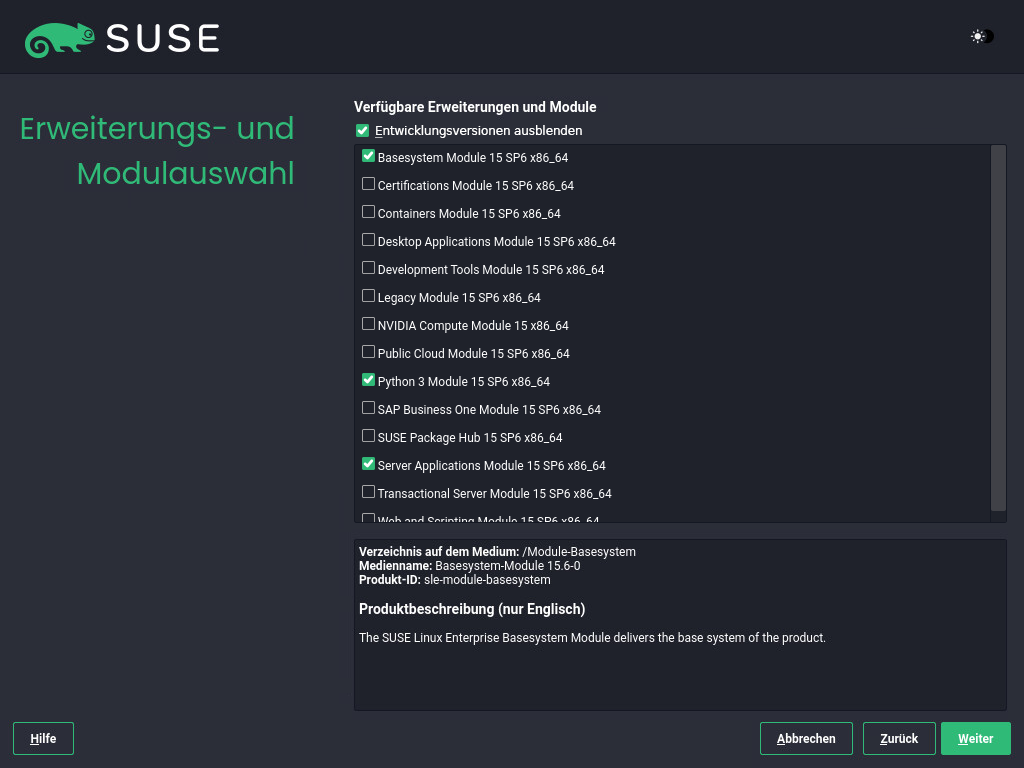

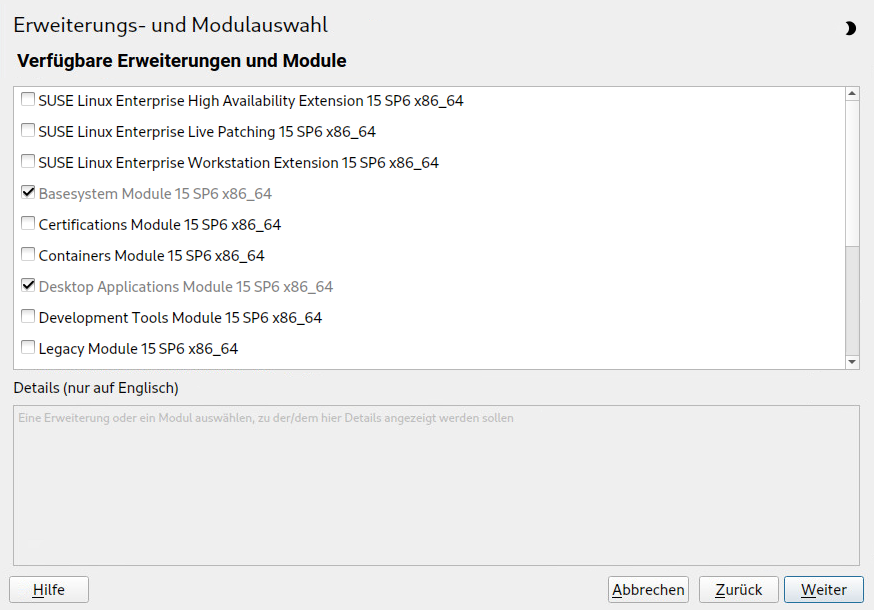

- 9.10 Add-on-Produkt

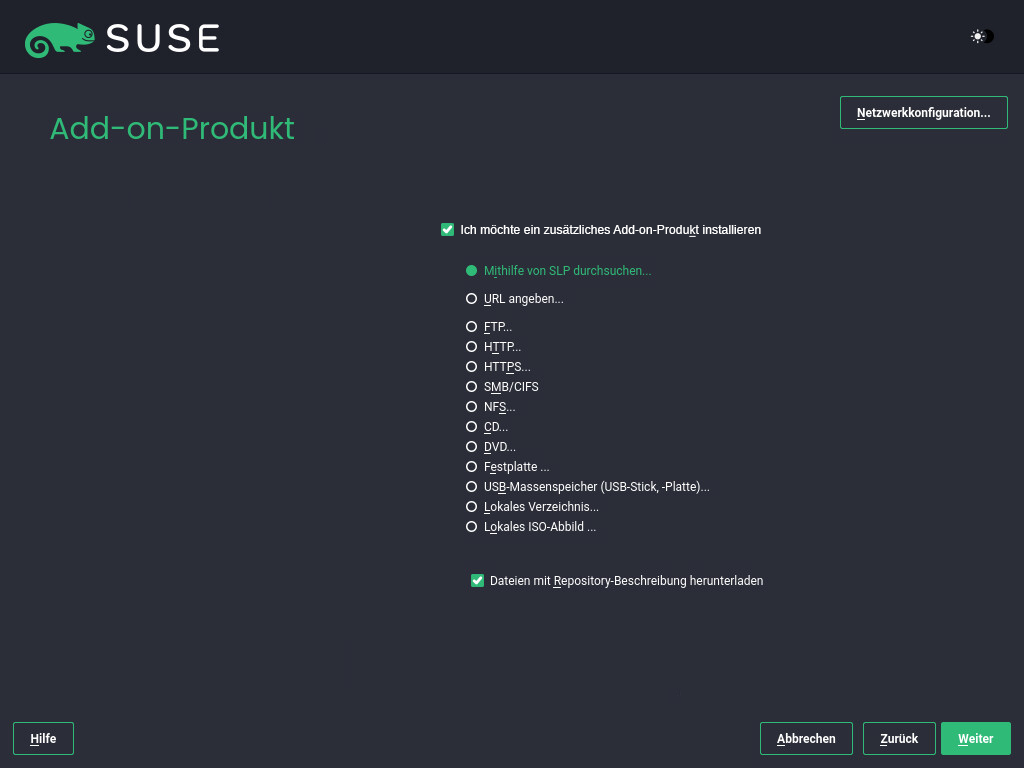

- 9.11 Systemrolle

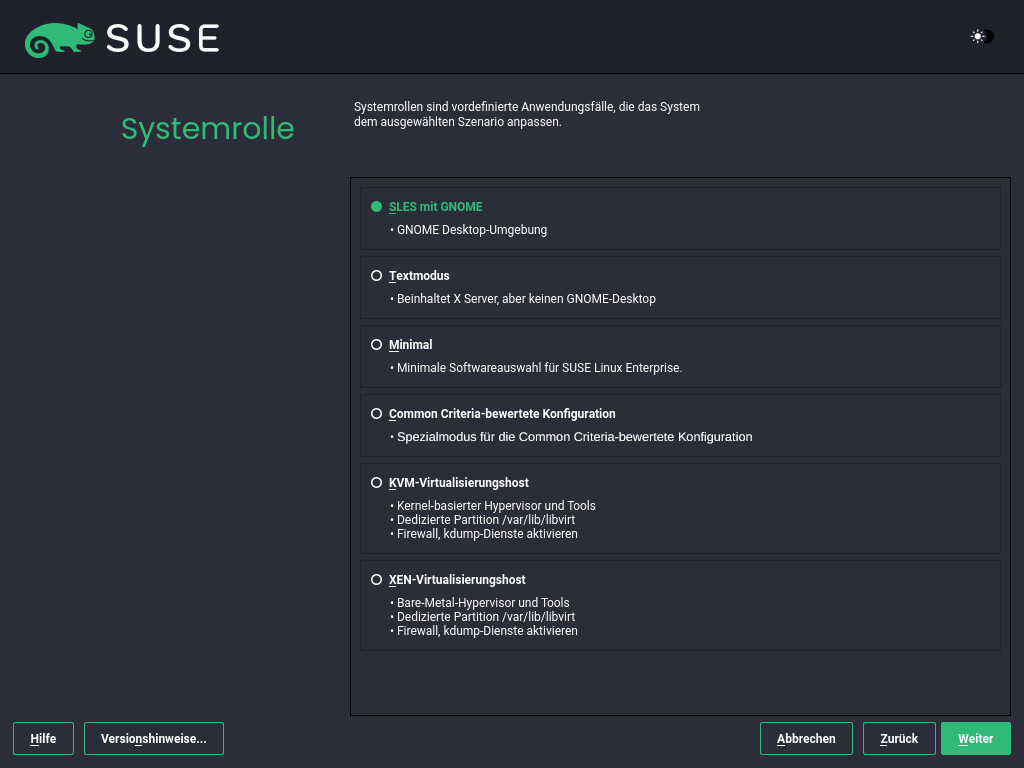

- 9.12 Vorgeschlagene Partitionierung

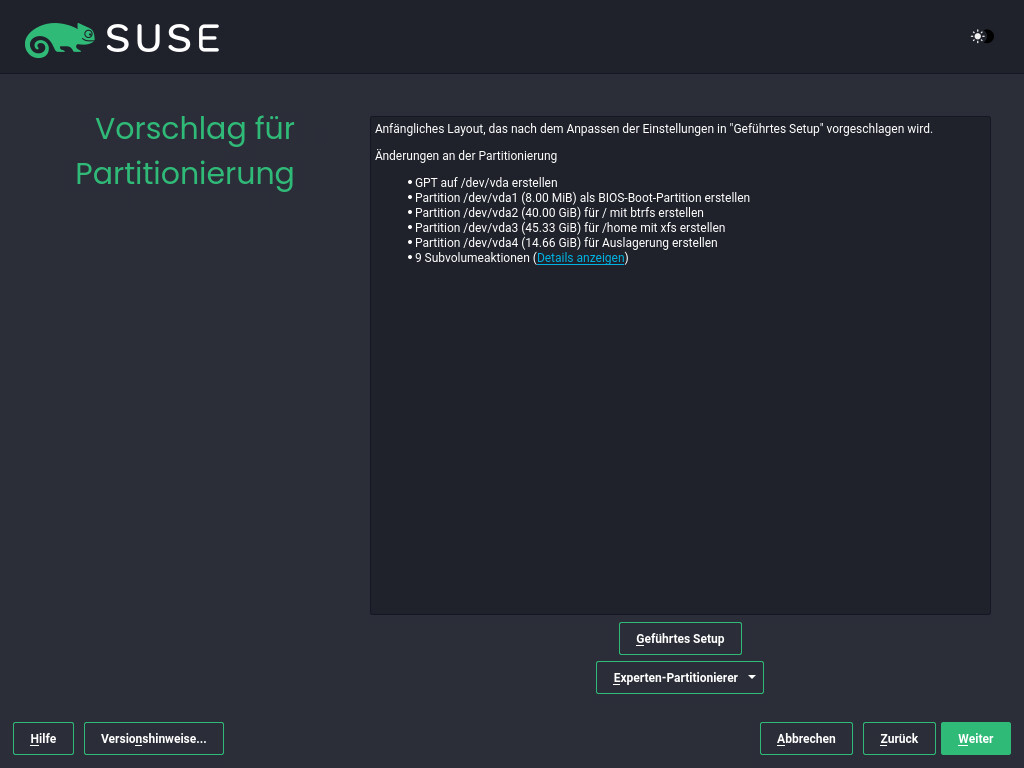

- 9.13 Uhr und Zeitzone

- 9.14 Erstellen von neuen Benutzern

- 9.15 Authentifizierung für den Systemadministrator-

root - 9.16 Installationseinstellungen

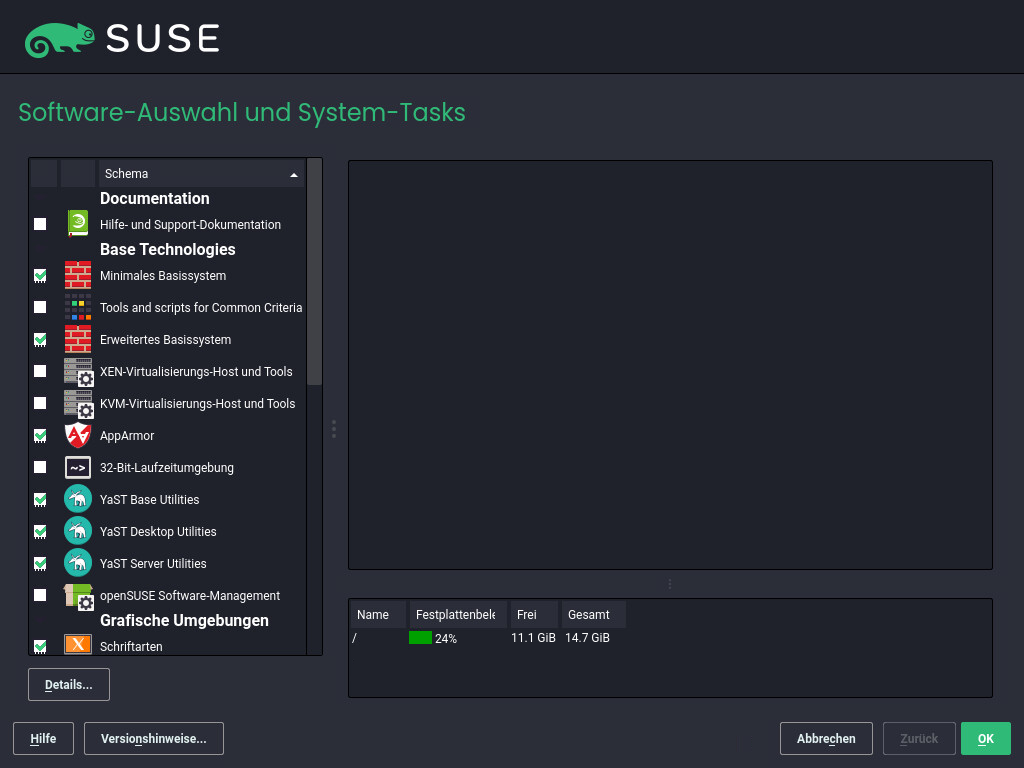

- 9.17 Software-Auswahl und System-Tasks

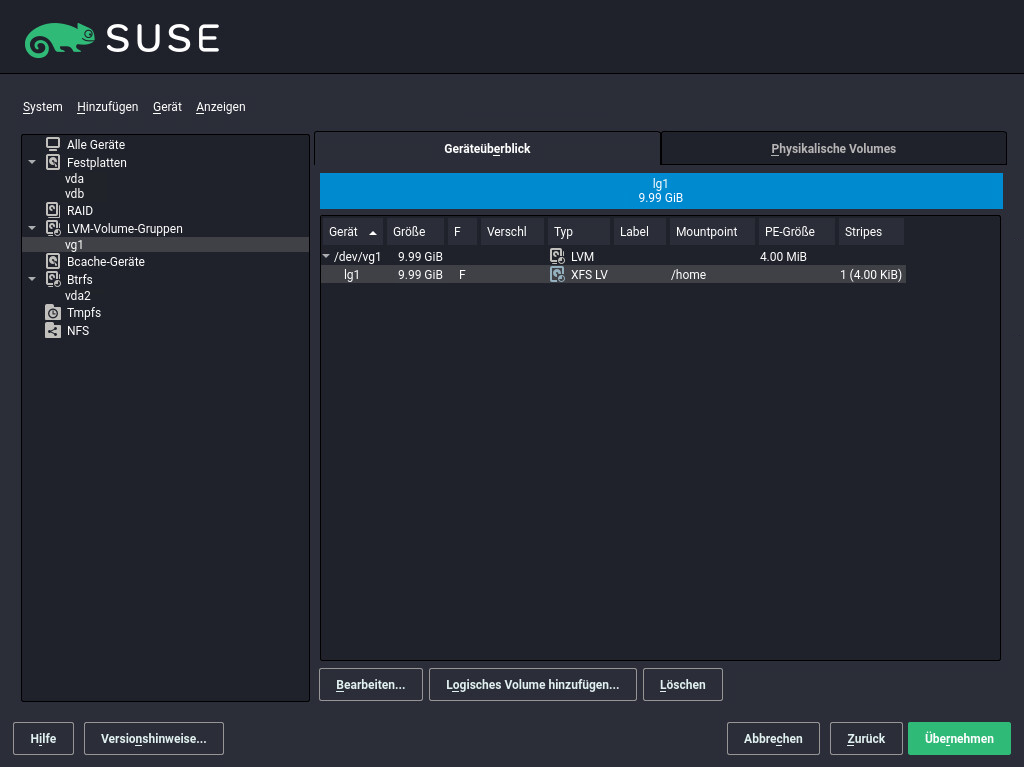

- 11.1 YaST-Partitionierung

- 11.2 Btrfs-Subvolumes im YaST-Partitionierer

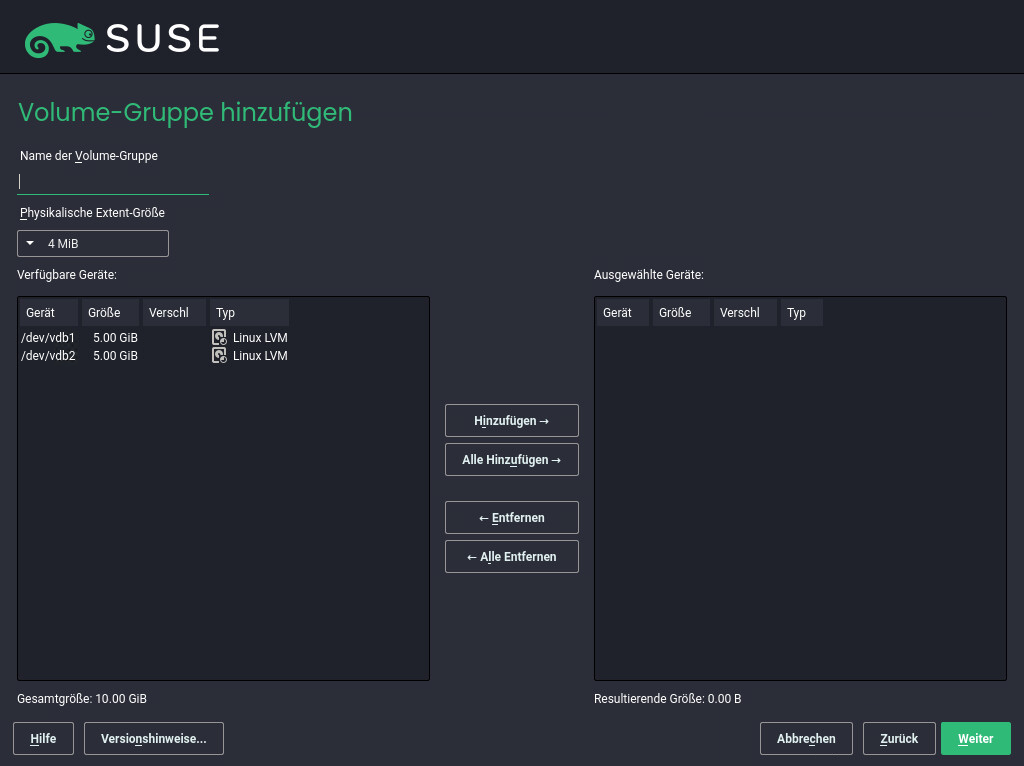

- 11.3 Anlegen einer Volume-Gruppe

- 11.4 Verwaltung von logischen Volumes

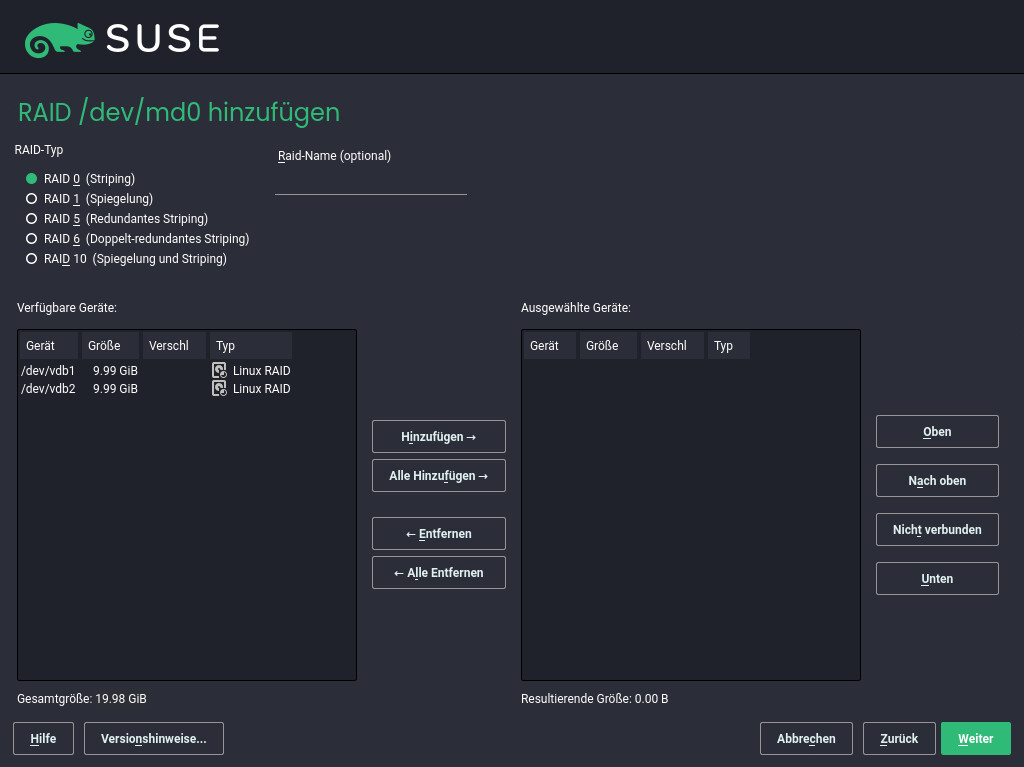

- 11.5 RAID-Partitionen

- 13.1 US-Tastaturbelegung

- 5.1 Konfiguration eines z/VM-Verzeichnisses

- 5.2 Beispiel einer XML-Domänendatei

- 5.3 Übertragen der Binärdateien über FTP

- 5.4 sles.exec

- 5.5 Unterstützte Netzwerkverbindungstypen und Treiberparameter

- 5.6 Treiberparameter für das Netzwerkgerät

- 5.7 Netzwerkparameter

- 5.8 Parmfile für eine Installation von NFS mit VNC und AutoYaST mit automatischer Konfiguration von E/A-Geräten

- 5.9 Parmfile zur Installation mit NFS, SSH und HSI sowie AutoYaST mit NFS

- 5.10 Parmfile zur Installation im VLAN

- 9.1

regcodes.txt - 9.2

regcodes.xml - 20.1 Konfigurieren von Vorschlagsbildschirmen

- 20.2 Konfigurieren des Workflow-Abschnitts

- 20.3 Konfigurieren der Liste der Workflow-Komponenten

Copyright © 2006–2026 SUSE LLC und Mitwirkende. Alle Rechte vorbehalten.

Es wird die Genehmigung erteilt, dieses Dokument unter den Bedingungen der GNU Free Documentation License, Version 1.2 oder (optional) Version 1.3 zu vervielfältigen, zu verbreiten und/oder zu verändern; die unveränderlichen Abschnitte hierbei sind der Urheberrechtshinweis und die Lizenzbedingungen. Eine Kopie dieser Lizenz (Version 1.2) finden Sie in Abschnitt „GNU Free Documentation License“.

Die SUSE Marken finden Sie im https://www.suse.com/company/legal/. Die Rechte für alle Marken von Drittanbietern liegen bei den jeweiligen Eigentümern. Markensymbole (®, ™ usw.) kennzeichnen Marken von SUSE und seinen verbundenen Unternehmen. Sternchen (*) kennzeichnen Marken von Drittanbietern.

Alle Informationen in diesem Buch wurden mit größter Sorgfalt zusammengestellt. Auch hierdurch kann jedoch keine hundertprozentige Richtigkeit gewährleistet werden. Weder SUSE LLC, ihre Tochtergesellschaften, die Autoren noch die Übersetzer können für mögliche Fehler und deren Folgen haftbar gemacht werden.

Vorwort #

1 Verfügbare Dokumentation #

- Online-Dokumentation

Unsere Dokumentation ist online verfügbar unter https://documentation.suse.com. Durchsuchen Sie die Dokumentation oder laden Sie sie in verschiedenen Formaten herunter.

Anmerkung: Neueste AktualisierungenDie neuesten Aktualisierungen sind normalerweise in der englischen Version dieser Dokumentation verfügbar.

- SUSE Knowledgebase

Wenn Sie auf ein Problem stoßen, lesen Sie die Technischen Informationsdokumente (TIDs), die online verfügbar sind unter https://www.suse.com/support/kb/. Durchsuchen Sie die SUSE Knowledgebase nach bekannten Lösungen, die sich an den Bedürfnissen der Kunden orientieren.

- Versionshinweise

Die Versionshinweise finden Sie unter https://www.suse.com/releasenotes/.

- In Ihrem System

Für die Offline-Nutzung sind die Versionshinweise auch unter

/usr/share/doc/release-notesauf Ihrem System verfügbar. Die Dokumentation zu den einzelnen Paketen finden Sie unter/usr/share/doc/packages.Viele Befehle sind auch auf den Handbuchseiten beschrieben. Führen Sie zu deren Anzeige

mangefolgt von einem bestimmten Befehlsnamen aus. Sollte derman-Befehl nicht auf Ihrem System installiert sein, müssen Sie es mitsudo zypper install maninstallieren.

2 Verbessern der Dokumentation #

Feedback und Beiträge Ihrerseits zu dieser Dokumentation sind willkommen. Für Feedback stehen die folgenden Kanäle zur Verfügung:

- Serviceanforderungen und Support

Informationen zu Diensten und Support-Optionen, die für Ihr Produkt verfügbar sind, finden Sie unter https://www.suse.com/support/.

Zum Öffnen einer Service-Anforderung benötigen Sie ein SUSE-Abonnement, das beim SUSE Customer Center registriert ist. Gehen Sie zu https://scc.suse.com/support/requests, melden Sie sich an und klicken Sie auf .

- Fehlerberichte

Melden Sie Probleme mit der Dokumentation unter https://bugzilla.suse.com/.

Klicken Sie zur Vereinfachung dieses Vorgangs neben einer Überschrift in der HTML-Version dieses Dokuments auf das Symbol (Problem melden). Dadurch wird das richtige Produkt und die Kategorie in Bugzilla vorab ausgewählt und ein Link zum aktuellen Abschnitt hinzugefügt. Sie können somit sofort mit der Eingabe Ihres Berichts beginnen.

Ein Bugzilla-Konto ist erforderlich.

- Beiträge

Wenn Sie zu dieser Dokumentation beitragen möchten, klicken Sie neben einer Überschrift in der HTML-Version dieses Dokuments auf das Symbol (Quelldokument bearbeiten). So gelangen Sie zum Quellcode auf GitHub, wo Sie eine Pull-Anforderung öffnen können.

Ein GitHub-Konto ist erforderlich.

Anmerkung: (Quelldokument bearbeiten) nur auf Englisch verfügbarDie Symbole für (Quelldokument bearbeiten) sind nur in der englischen Version jedes Dokuments verfügbar. Für alle anderen Sprachen können Sie stattdessen die Symbole (Problem melden) verwenden.

Weitere Informationen zur Dokumentationsumgebung für diese Dokumentation finden Sie in der README des Repositorys.

Sie können auch E-Mails mit Fehlerberichten und Feedback zur Dokumentation an <doc-team@suse.com> senden. Geben Sie den Titel des Dokuments, die Produktversion und das Datum der Veröffentlichung des Dokuments an. Stellen Sie außerdem die entsprechende Abschnittsnummer und den Titel bereit (oder geben Sie die URL an), und fügen Sie eine kurze Beschreibung des Problems hinzu.

3 Konventionen in der Dokumentation #

Im vorliegenden Dokument werden die folgenden Hinweise und typografischen Konventionen verwendet:

/etc/passwd: Verzeichnis- und DateinamenPLACEHOLDER: Ersetzen Sie PLACEHOLDER durch den tatsächlichen Wert.

PATH: Eine Umgebungsvariablels,--help: Befehle, Optionen und Parameteruser: Der Name eines Benutzers oder einer Gruppepackage_name: Der Name eines Softwarepakets

Alt, Alt–F1: Eine zu drückende Taste bzw. Tastenkombination. Tasten werden wie auf einer Tastatur in Großbuchstaben dargestellt.

, › : Menüelemente, Schaltflächen

AMD/Intel Dieser Absatz ist nur für die AMD64-/Intel 64-Architekturen relevant. Die Pfeile kennzeichnen den Anfang und das Ende des Textblocks.

IBM Z, POWER Dieser Absatz ist nur für die Architekturen

IBM ZundPOWERrelevant. Die Pfeile kennzeichnen den Anfang und das Ende des Textblocks.Chapter 1, „Example chapter“: Ein Querverweis auf ein anderes Kapitel in diesem Handbuch.

Befehle, die mit

root-Privilegien ausgeführt werden müssen. Sie können diesen Befehlen auch den Befehlsudovoranstellen, um sie als nicht privilegierter Benutzer auszuführen:#command>sudocommandBefehle, die von nicht privilegierten Benutzern ausgeführt werden können:

>commandBefehle können durch ein Backslash-Zeichen (

\) am Ende einer Zeile in zwei oder mehrere Zeilen aufgeteilt werden. Mit dem Backslash wird die Shell darüber informiert, dass der Befehlsaufruf nach dem Ende der Zeile fortgesetzt wird:>echoa b \ c dEin Codeblock, der sowohl den Befehl (mit vorangestellter Eingabeaufforderung) als auch die entsprechende von der Shell zurückgegebene Ausgabe anzeigt:

>commandoutputHinweise

Warnung: WarnhinweisWichtige Informationen, die Sie kennen müssen, bevor Sie fortfahren. Warnt vor Sicherheitsrisiken, potenziellen Datenverlusten, Beschädigung der Hardware oder physischen Gefahren.

Wichtig: Wichtiger HinweisWichtige Informationen, die Sie beachten sollten, bevor Sie den Vorgang fortsetzen.

Anmerkung: AnmerkungErgänzende Informationen, beispielsweise zu unterschiedlichen Softwareversionen.

Tipp: TippHilfreiche Informationen, etwa als Richtlinie oder praktische Empfehlung.

Kompaktinfos

Ergänzende Informationen, beispielsweise zu unterschiedlichen Softwareversionen.

Hilfreiche Informationen, etwa als Richtlinie oder praktische Empfehlung.

4 Support #

Nachfolgend finden Sie die Supportbestimmung für SUSE Linux Enterprise Server und allgemeine Informationen zu Technologievorschauen. Details über den Produktlebenszyklus finden Sie unter https://www.suse.com/lifecycle.

Wenn Sie Anspruch auf Support haben, finden Sie Details zum Sammeln von Informationen für ein Support-Ticket unter https://documentation.suse.com/sles-15/html/SLES-all/cha-adm-support.html.

4.1 Supportbestimmung für SUSE Linux Enterprise Server #

Sie benötigen ein entsprechendes Abonnement bei SUSE, um Support zu erhalten. Gehen Sie zur Anzeige der für Sie verfügbaren spezifischen Support-Angebote zu https://www.suse.com/support/ und wählen Sie das betreffende Produkt aus.

Die Support-Level sind folgendermaßen definiert:

- L1

Problemermittlung: Technischer Support mit Informationen zur Kompatibilität, Nutzungs-Support, kontinuierliche Wartung, Informationssammlung und einfache Problembehandlung anhand der verfügbaren Dokumentation.

- L2

Problemisolierung: Technischer Support zur Datenanalyse, Reproduktion von Kundenproblemen, Isolierung eines Problembereichs und Lösung für Probleme, die in Stufe 1 nicht gelöst wurden, sowie Vorbereitung für Stufe 3.

- L3

Problembehebung: Technischer Support zur Lösung von Problemen durch technische Maßnahmen zur Behebung von Produktfehlern, die durch den Support der Stufe 2 erkannt wurden.

Vertragskunden und Partner erhalten SUSE Linux Enterprise Server mit L3-Support für alle Pakete, ausgenommen:

Technologievorschauen.

Audio, Grafik, Schriftarten und Artwork.

Pakete, für die ein zusätzlicher Kundenvertrag erforderlich ist.

Einige Pakete, die im Lieferumfang von Modul Workstation Extension enthalten sind, erhalten nur L2-Support.

Pakete mit der Namensendung -devel (die Header-Dateien und ähnliche Entwicklerressourcen enthalten) werden nur zusammen mit den entsprechenden Hauptpaketen unterstützt.

SUSE unterstützt nur die Nutzung von Originalpaketen, Also unveränderte und nicht kompilierte Pakete.

4.2 Technologievorschauen #

Mit Technologievorschauen sind Pakete, Stacks oder Funktionen gemeint, die SUSE bereitstellt, um einen kurzen Einblick in bevorstehende Innovationen zu geben. Durch Technologievorschauen haben Sie die Möglichkeit, neue Technologien in Ihrer Umgebung zu testen. Über Ihr Feedback würden wir uns sehr freuen. Wenn Sie eine Technologievorschau testen, kontaktieren Sie bitte Ihre Ansprechpartner bei SUSE und teilen Sie ihnen Ihre Erfahrungen und Anwendungsfälle mit. Ihr Input ist für zukünftige Entwicklungen sehr hilfreich.

Technologievorschauen weisen die folgenden Einschränkungen auf:

Technologievorschauen befinden sich noch in Entwicklung. Daher sind die Funktionen möglicherweise unvollständig, instabil oder aus anderen Gründen nicht für die Produktionsnutzung geeignet.

Technologievorschauen werden nicht unterstützt.

Technologievorschauen sind möglicherweise nur für bestimmte Hardwarearchitekturen verfügbar.

Details und Funktionen von Technologievorschauen sind Änderungen unterworfen. Upgrades auf Folgeversionen sind demnach nicht möglich und erfordern eine Neuinstallation.

SUSE kann feststellen, dass eine Vorschau nicht den Kunden- oder Marktanforderungen entspricht oder nicht mit den Unternehmensstandards übereinstimmt. Technologievorschauen können jederzeit aus einem Produkt entfernt werden. SUSE ist nicht verpflichtet, eine unterstützte Version dieser Technologie in der Zukunft bereitzustellen.

Eine Übersicht der Technologievorschauen, die im Lieferumfang Ihres Produkts enthalten sind, finden Sie in den Versionshinweisen unter https://www.suse.com/releasenotes.

Teil I Installationsvorbereitung #

- 1 Planung für SUSE Linux Enterprise Server

In diesem Kapitel werden einige grundlegende Überlegungen vor der Installation von SUSE Linux Enterprise Server beschrieben.

- 2 Installation auf AMD64 und Intel 64

In diesem Kapitel werden die nötigen Schritte für die Vorbereitung der Installation von SUSE Linux Enterprise Server auf AMD64- und Intel-64-Rechnern beschrieben. Es beschreibt die für die Vorbereitung der verschiedenen Installationsmethoden erforderlichen Schritte. Die Liste der Hardware-Anforderungen bietet einen Überblick über die von SUSE Linux Enterprise Server unterstützten Systeme. Sie erhalten Informationen über verfügbare Installationsmethoden und mehrere bekannte Probleme. Sie lernen, wie Sie die Installation steuern, Installationsmedien zur Verfügung stelln und mit normalen Methoden booten können.

- 3 Installation in der Arm AArch64-Architektur

In diesem Kapitel werden die erforderlichen Schritte für die Vorbereitung der Installation von SUSE Linux Enterprise Server auf ARM AArch64-Computern beschrieben. Es beschreibt die für die Vorbereitung der verschiedenen Installationsmethoden erforderlichen Schritte. Die Liste der Hardware-Anforderungen bietet einen Überblick über die von SUSE Linux Enterprise Server unterstützten Systeme. Sie erhalten Informationen über verfügbare Installationsmethoden und mehrere bekannte Probleme. Sie lernen, wie Sie die Installation steuern, Installationsmedien zur Verfügung stelln und mit normalen Methoden booten können.

- 4 Installation auf IBM POWER

Dieses Kapitel beschreibt das Installationsverfahren für SUSE Linux Enterprise Server unter IBM POWER-Systemen.

- 5 Installation unter IBM Z und LinuxONE

In diesem Kapitel wird die Vorbereitung der Installation von SUSE® Linux Enterprise Server auf IBM Z beschrieben. Hier finden Sie alle erforderlichen Informationen, mit denen Sie die Installation auf LPAR- und z/VM-Seite vorbereiten.

- 6 Installation auf Virtualisierungshosts

In diesem Abschnitt wird der Unterstützungsstatus von SUSE Linux Enterprise Server 15 SP6 beschrieben, der als Gastbetriebssystem auf verschiedenen Virtualisierungshosts (Hypervisoren) ausgeführt wird.

- 7 Installation auf Hardware, die zum Zeitpunkt der Freigabe nicht unterstützt wurde

Bei bestimmter neuerer Hardware kann das Installationsmedium von SUSE Linux Enterprise Server nicht gebootet werden. Dies ist beispielsweise der Fall, wenn die Hardware zum Zeitpunkt der Freigabe von SUSE Linux Enterprise Server noch nicht erhältlich war. Für diese Situationen bietet SUSE verschiedene Kernel-Aktualisierungs-ISO-Images (kISO). In diesem Kapitel wird beschrieben, wie Sie SUSE Linux Enterprise Server mit der Kernel-Aktualisierung auf moderner Hardware installieren.

1 Planung für SUSE Linux Enterprise Server #

In diesem Kapitel werden einige grundlegende Überlegungen vor der Installation von SUSE Linux Enterprise Server beschrieben.

1.1 Überlegungen zur Bereitstellung von SUSE Linux Enterprise Server #

Die Bereitstellung eines Betriebssystems muss sowohl in einer bestehenden IT-Umgebung als auch in einer völlig neuen Implementierung sorgfältig vorbereitet werden. Zu Beginn Ihrer Planung sollten Sie die Projektziele und die benötigten Funktionen festlegen. Diese Überlegungen werden bei jedem Projekt anders aussehen. Immer sollten Sie sich jedoch die folgenden Fragen stellen:

Wie viele Installationen sind erforderlich? Von dieser Überlegung hängt die optimale Bereitstellungsmethode ab.

Wird das System als physischer Host oder als virtueller Computer ausgeführt?

Ist das System externen Bedrohungen wie Hackerangriffen ausgesetzt? Im Book “Security and Hardening Guide”, Chapter 1 “Security and confidentiality” finden Sie einen Überblick über die daraus folgenden Konsequenzen.

Wie erhalten Sie reguläre Updates? Alle Patches stehen registrierten Benutzern online im SUSE Customer Center zur Verfügung.

Benötigen Sie für die lokale Installation Hilfe? SUSE bietet Schulungen, Support und Beratung für alle Fragen im Zusammenhang mit SUSE Linux Enterprise Server. Weitere Informationen hierzu finden Sie unter https://www.suse.com/products/server/.

Benötigen Sie Produkte von Drittanbietern? Vergewissern Sie sich, dass das benötigte Produkt von der gewünschten Plattform unterstützt wird. Bei Bedarf bietet SUSE auch Unterstützung für Software auf anderen Plattformen an.

1.2 Bereitstellung von SUSE Linux Enterprise Server #

Um sicherzustellen, dass Ihr System fehlerlos läuft, sollten Sie nur zertifizierte Hardware verwenden. Unsere Datenbank der zertifizierten Geräte wird regelmäßig aktualisiert. Ein Suchformular für zertifizierte Hardware finden Sie unter https://www.suse.com/yessearch/Search.jsp.

Abhängig von der Anzahl der gewünschten Installationen empfehlen sich eventuell Installationsserver oder sogar völlig automatische Installationen. Wenn Sie Xen- oder KVM-Virtualisierungstechnologien verwenden möchten, empfehlen sich eventuell Netzwerk-root-Dateisysteme oder Netzwerkspeicherlösungen wie iSCSI.

SUSE Linux Enterprise Server umfasst eine Vielzahl an verschiedensten Services. Die meisten Konfigurationen lassen sich in YaST, dem Konfigurationsprogramm von SUSE, vornehmen. Darüber hinaus sind aber auch zahlreiche manuelle Konfigurationen möglich, die in den betreffenden Kapiteln beschrieben werden.

Über die Installation der Software hinaus sollten Sie in der Planung auch die Schulung der System-Endbenutzer sowie die Schulung Ihrer Helpdesk-Mitarbeiter berücksichtigen.

In den folgenden Abschnitten wird das System, auf dem Ihre neue SUSE Linux Enterprise Server-Installation ausgeführt wird, als Zielsystem oder Installationsziel bezeichnet. Der Begriff Repository (früher „Installationsquelle“ genannt) wird für alle Quellen der Installationsdaten verwendet. Dazu gehören physische Medien wie CD, DVD und USB-Flash-Laufwerk, sowie Netzwerkserver, die die Installationsdaten im Netzwerk verteilen.

1.3 Ausführen von SUSE Linux Enterprise Server #

Das Betriebssystem SUSE Linux Enterprise Server ist bewährt und stabil. Dennoch lassen sich Hardware-Ausfälle oder andere Ursachen für Ausfallzeiten und Datenverluste nicht gänzlich vermeiden. Stellen Sie sicher, dass Sie über eine Backup-Lösung für unternehmenswichtige Aufgaben verfügen.

Aus Sicherheitsgründen und zum Schutz Ihrer Daten sollten Sie alle verwendeten Systeme regelmäßig aktualisieren. Wenn es um einen unternehmenswichtigen Server geht, sollten Sie einen zweiten, identischen Computer (außerhalb der Produktionsumgebung) ausführen und alle Änderungen darauf testen. Bei Hardware-Ausfällen steht Ihnen so auch ein redundantes System zur Verfügung, zu dem Sie jederzeit wechseln können.

1.4 Registrieren von SUSE Linux Enterprise Server #

Um technischen Support und Produktaktualisierungen zu erhalten, müssen Sie Ihr SUSE-Produkt beim SUSE Customer Center registrieren und aktivieren. Es wird empfohlen, die Registrierung während der Installation vorzunehmen, da Sie so in der Lage sind, das System mit den neuesten verfügbaren Aktualisierungen und Patches zu installieren. Falls Sie gerade offline sind oder den Registrierungsschritt überspringen möchten, können Sie die Registrierung aus dem aktiven System heraus fertigstellen.

Falls Ihr Unternehmen keinen lokalen Registrierungsserver anbietet, benötigen Sie für die Registrierung von SUSE Linux Enterprise ein SUSE Customer Center-Konto. Falls Sie noch kein Konto besitzen, wechseln Sie zur SUSE Customer Center-Startseite (https://scc.suse.com/), und erstellen Sie dort ein Konto.

Bei der Installation werden Sie aufgefordert, Ihren Registrierungscode einzugeben. Weitere Informationen finden Sie im Abschnitt 9.7, „Registrierung“.

Wenn Sie die Instanzen automatisch mit AutoYaST bereitstellen, können Sie das System während der Installation registrieren. Geben Sie hierzu die entsprechenden Informationen in der AutoYaST-Steuerungsdatei an. Weitere Informationen finden Sie im Book “AutoYaST Guide”, Chapter 4 “Configuration and installation options”, Section 4.3 “System registration and extension selection”.

Weitere Informationen zum Registrieren eines bereits installierten Systems finden Sie im Book “Verwaltungshandbuch”, Chapter 8 “Installieren bzw. Entfernen von Software”, Section 8.2 “Registrieren eines installierten Systems”.

1.5 Änderungen bei der Installation von SUSE Linux Enterprise Server Version 15 #

Ab SUSE Linux Enterprise Server 15 werden alle SUSE Linux Enterprise-basierten Produkte mit einem Unified Installer von einem einzigen Satz Installationsmedien für jede unterstützte Architektur installiert.

1.5.1 Unified Installer für SUSE Linux Enterprise-basierte Produkte #

Ab SUSE Linux Enterprise Server 15 SP6 sind dies die folgenden grundlegenden Produkte:

| Produktname | Unterstützte Plattformen |

|---|---|

| SUSE Linux Enterprise Server | AMD64/Intel 64; AArch64; POWER; IBM Z |

| SUSE Linux Enterprise-Hochleistungs-Computing | AMD64/Intel 64; AArch64 |

| SUSE Linux Enterprise Real Time | AMD64/Intel 64 |

| SUSE Linux Enterprise Server für SAP-Anwendungen | AMD64/Intel 64; POWER |

| SUSE Linux Enterprise Desktop | AMD64/Intel 64 |

| SUSE-Manager-Server | AMD64/Intel 64; POWER; IBM Z |

| SUSE-Manager-Proxy | AMD64/Intel 64 |

| SUSE Manager für Retail Branch Server | AMD64/Intel 64 |

| SUSE Enterprise Storage | AMD64/Intel 64; Arm; Intel 64 |

1.5.2 Installieren mit Internetzugriff #

Wenn Sie eine Installation auf einem Rechner oder einer VM mit Internetzugriff durchführen, brauchen Sie zur Installation der oben aufgelisteten Produkte nur das Image SLE-15-SP6-Online-ARCH-GM-media1.iso für die gewünschte Architektur herunterzuladen.

Zum Installieren von SUSE Manager-Produkten muss der Zielrechner direkten Zugriff auf das SUSE Customer Center oder einen RMT-Server haben.

1.5.3 Offline-Installation #

Mit Ausnahme von SUSE Manager benötigen Sie zur Installation der anderen aufgelisteten Produkte keinen Zugriff auf das Internet, das SUSE Customer Center oder einen RMT-Server (Repository Mirroring Tool).

Laden Sie für die Offline-Installation zusätzlich das Image SLE-15-SP6-Full-ARCH-GM-media1.iso für die gewünschte Architektur herunter.

Es gibt ein zusätzliches, zweites Paket-Medium, doch es enthält nur Quellcode und wird für die Installation nicht benötigt.

Die Größe aller Installationsmedien der SLE-15-SP6-Online-ARCH-GM-media1.iso übersteigt die Kapazität einer doppelschichtigen DVD. Daher können sie nur von einem USB-Flash-Laufwerk gebootet werden.

1.5.4 Quartalsweise aktualisierte Medien #

Für die Installationsmedien und die VM-Gast-Images bietet SUSE zwei Varianten:

Die erste, die

GMim Dateinamen enthält, besteht aus dem Paketsatz, der im Lieferumfang des ersten Versands an den Kunden enthalten war.Die zweite, die durch ein

QUgefolgt von einer Zahl im Dateinamen gekennzeichnet ist, enthält denselben Paketsatz und zusätzlich alle Wartungsaktualisierungen der Pakete, die in der Zwischenzeit veröffentlicht wurden. Quartalsweise aktualisierte Medien werden alle drei Monate aktualisiert, wobei die erste Aktualisierung drei Monate nach derGM-Freigabe erfolgt.

Sie brauchen nur entweder die GM-Medien oder die QU-Medien, nicht beides. Welche Version Sie auswählen sollten, hängt von Ihren Bedürfnissen und Vorlieben ab. Wenn Ihre Hardware noch relativ neu ist, könnte die QU-Version die bessere Wahl sein. Der Installationsvorgang ist für beide Varianten identisch.

Für beide Varianten wird empfohlen, die neuesten Aktualisierungen, die nach der Erstellung der Images freigegeben wurden, während oder unmittelbar nach der Installation zu installieren.

2 Installation auf AMD64 und Intel 64 #

In diesem Kapitel werden die nötigen Schritte für die Vorbereitung der Installation von SUSE Linux Enterprise Server auf AMD64- und Intel-64-Rechnern beschrieben. Es beschreibt die für die Vorbereitung der verschiedenen Installationsmethoden erforderlichen Schritte. Die Liste der Hardware-Anforderungen bietet einen Überblick über die von SUSE Linux Enterprise Server unterstützten Systeme. Sie erhalten Informationen über verfügbare Installationsmethoden und mehrere bekannte Probleme. Sie lernen, wie Sie die Installation steuern, Installationsmedien zur Verfügung stelln und mit normalen Methoden booten können.

2.1 Hardware #

Das Betriebssystem SUSE® Linux Enterprise Server eignet sich für die verschiedensten Hardware-Geräte. Es ist unmöglich, alle denkbaren Hardware-Kombinationen aufzuführen, die von SUSE Linux Enterprise Server unterstützt werden. Um Ihnen für die Planungsphase eine Richtlinie zur Verfügung zu stellen, werden hier die Mindestanforderungen dargestellt.

Wenn Sie ganz sichergehen möchten, dass eine bestimmte Computerkonfiguration funktioniert, erkundigen Sie sich, welche Plattformen von SUSE zertifiziert wurden. Eine Liste finden Sie unter https://www.suse.com/yessearch/.

- Prozessor

Die meisten zum Zeitpunkt der Veröffentlichung verfügbaren CPUs werden unterstützt.

- Maximale Anzahl von CPUs

Gemäß dem Software-Design unterstützen Intel 64 und AMD64 maximal 8192 CPUs. Wenn Sie ein so großes System nutzen möchten, informieren Sie sich auf unserer Webseite zur Hardware-Systemzertifizierung über die unterstützten Geräte (siehe https://www.suse.com/yessearch/).

- Speicheranforderungen

Für eine Minimalinstallation sind mindestens 1024 MB Arbeitsspeicher erforderlich. Fügen Sie auf Rechnern mit mehr als zwei Prozessoren 512 MB pro CPU hinzu. Fügen Sie bei Installationen auf Remote-Systemen über HTTP oder FTP weitere 150 MB hinzu. Diese Werte gelten ausschließlich für die Installation des Betriebssystems. Der tatsächliche Arbeitsspeicherbedarf in der Produktion ist abhängig von der Auslastung des Systems. Für Systeme, auf denen die GNOME-Desktop-Umgebung ausgeführt wird, sind mindestens 2048 MB Arbeitsspeicher erforderlich und 4096 MB werden empfohlen.

- Anforderungen an die Festplatte

Die Anforderungen an die Festplatte sind im Wesentlichen abhängig von der ausgewählten Installation und von der geplanten Nutzung des Computers. Gewöhnlich benötigen Sie mehr Speicherplatz als die Installationssoftware alleine, damit ein System ordnungsgemäß arbeitet. Mindestanforderungen für verschiedene Optionen:

Installationsumfang

Mindestanforderungen an die Festplatte

Expertenmodus

1,5 GB

Minimalinstallation

2,5 GB

GNOME-Desktop

3 GB

Alle Schemata

4 GB

Empfohlener Mindestwert (keine Btrfs-Snapshots): 10 GB

Erforderlicher Mindestwert (mit Btrfs-Snapshots): 16 GB

Empfohlener Mindestwert (mit Btrfs-Snapshots): 32 GB

Bei einer root-Partition kleiner als 10 GB macht das Installationsprogramm keinen Vorschlag für eine automatische Partitionierung und Partitionen müssen manuell erstellt werden. Daher werden als Mindestgröße für die root-Partition 10 GB empfohlen. Die root-Partition muss mindestens 16 GB groß sein, wenn Sie Btrfs-Snapshots auf dem root-Volume für System-Rollbacks (siehe Book “Verwaltungshandbuch”, Chapter 10 “Systemwiederherstellung und Snapshot-Verwaltung mit Snapper”) ermöglichen möchten.

- Boot-Methoden

Der Computer kann von einer CD oder über das Netzwerk gestartet werden. Zum Starten über das Netzwerk ist ein spezieller Boot-Server erforderlich. Die Einrichtung kann mit SUSE Linux Enterprise Server erfolgen.

2.2 Überlegungen zur Installation #

Dieser Abschnitt umfasst zahlreiche Faktoren, die vor der Installation von SUSE Linux Enterprise Server auf AMD64- und Intel-64-Hardware zu berücksichtigen sind.

2.2.1 Installation auf Hardware oder auf einem virtuellen Computer #

SUSE Linux Enterprise Server wird in der Regel als unabhängiges Betriebssystem installiert. Dank der Virtualisierung ist es auch möglich, mehrere Instanzen von SUSE Linux Enterprise Server auf derselben Hardware auszuführen. Die Installation des VM-Host-Servers erfolgt jedoch wie eine typische Installation mit einigen zusätzlichen Paketen. Ein Beschreibung der Installation von virtuellen Gästen finden Sie im Book “Virtualization Guide”, Chapter 10 “Guest installation”.

2.2.2 Installationsziel #

Die meisten Installationen erfolgen auf der lokalen Festplatte. Daher müssen die Festplatten-Controller für das Installationssystem nicht zur Verfügung stehen. Wenn ein bestimmter Controller (z. B. ein RAID-Controller) ein zusätzliches Kernel-Modul benötigt, stellen Sie für das Installationssystem eine Aktualisierungsdiskette für das Kernel-Modul bereit.

Sonstige Installationsziele können verschiedene Arten von Block-Geräten sein, die ausreichenden Speicherplatz und eine entsprechende Geschwindigkeit zum Ausführen eines Betriebssystems bieten. Dies beinhaltet auch Netzwerk-Block-Geräte, wie iSCSI oder SAN. Die Installation kann auch auf Netzwerk-Dateisystemen mit den standardmäßigen Unix-Berechtigungen ausgeführt werden. Beim Starten dieser Systeme können jedoch Probleme auftreten, da sie von initramfs unterstützt werden müssen, damit das eigentliche System gestartet werden kann. Diese Installationen sind insbesondere dann von Nutzen, wenn Sie dasselbe System an verschiedenen Standorten starten müssen oder den Einsatz von Virtualisierungsfunktionen planen (z. B. Domänenmigration).

2.3 Installationsmethoden #

Sie können die gewünschte Installationsmethode auswählen, indem Sie die Einrichtung mit einer der in Abschnitt 2.4, „Booten des Systems“ aufgeführten Optionen starten. Informationen zum Aktivieren der verschiedenen Installationsmethoden finden Sie im Abschnitt 8.3.4, „Festlegen des Fernzugriffs“. Informationen zur Verwendung der Ferninstallationsmethoden finden Sie in Kapitel 12, Ferninstallation.

Ein kurzer Überblick über die verschiedenen Methoden:

- Lokal mit Monitor und Tastatur

Mit dieser Methode wird SUSE Linux Enterprise Server am häufigsten installiert. Sie erfordert sehr wenig Vorbereitung, jedoch viel direkte Interaktion.

- Im Fernverfahren über SSH

Sie können die Installation über SSH entweder im Textmodus vornehmen oder die grafische Installation per X-Forwarding ausführen. Detaillierte Informationen finden Sie im Abschnitt 12.4, „Überwachen der Installation über SSH“.

- Im Fernverfahren über serielle Konsole

Für diese Installationsmethode benötigen Sie einen zweiten Computer, der über ein Nullmodem-Kabel mit dem Zielcomputer verbunden ist. Die Installation erfolgt im Textmodus. Detaillierte Informationen finden Sie im Abschnitt 12.5, „Installation über die serielle Konsole“.

- Im Fernverfahren über VNC

Verwenden Sie diese Methode, um die Installation über eine grafische Oberfläche ohne direkten Zugriff auf den Zielcomputer auszuführen. Detaillierte Informationen finden Sie im Abschnitt 12.3, „Überwachen der Installation über VNC“.

- Automatisch über AutoYaST

Zur Installation SUSE Linux Enterprise Server auf mehreren Computern mit ähnlicher Hardware empfiehlt es sich, die Installationen mit AutoYaST durchzuführen. Installieren Sie in diesem Fall zuerst eine Instanz von SUSE Linux Enterprise Server und erstellen Sie hierüber die erforderlichen AutoYaST-Konfigurationsdateien. Detaillierte Informationen finden Sie im Book “AutoYaST Guide”.

2.4 Booten des Systems #

In diesem Abschnitt erhalten Sie einen Überblick über die Schritte zur vollständigen Installation von SUSE Linux Enterprise Server.

Anders als bei früheren SLE-Produkten lässt sich die gesamte SLE 15 SP6-Produktlinie mit dem Unified Installer installieren. Detaillierte Informationen zu den Änderungen seit SUSE Linux Enterprise 15 und dazu, welche Medien für die Installation heruntergeladen werden sollen, finden Sie in Abschnitt 1.5, „Änderungen bei der Installation von SUSE Linux Enterprise Server Version 15“..

Eine vollständige Beschreibung der Installation und Konfiguration des Systems mit YaST finden Sie in Teil II, „Installationsvorgang“.

Wenn Sie eine neue Hardware verwenden, kann es erforderlich sein, die Installation mit einem neueren Kernel von einem Kernel Update ISO-Image zu booten. Detaillierte Informationen finden Sie im Kapitel 7, Installation auf Hardware, die zum Zeitpunkt der Freigabe nicht unterstützt wurde.

Bereiten Sie die Installationsmedien vor.

- USB-Flash-Laufwerk

Das ist die einfachste Methode zum Starten der Installation. Zum Erstellen eines bootfähigen Flash-Laufwerks müssen Sie ein DVD-Image mit dem Befehl

ddauf das Gerät kopieren. Der Flash-Datenträger darf nicht eingehängt sein, und alle Daten auf dem Gerät werden gelöscht.#ddif=PATH_TO_ISO_IMAGE of=USB_STORAGE_DEVICE bs=4M- Booten vom Netzwerk

Falls von der Firmware des Zielrechners unterstützt, können Sie den Computer vom Netzwerk aus booten und von einem Server aus installieren. Diese Bootmethode erfordert einen Boot-Server, der die erforderlichen Boot-Images über das Netzwerk bereitstellt. Das exakte Protokoll hängt von Ihrer Hardware ab. In der Regel benötigen Sie mehrere Dienste, wie TFTP und DHCP oder PXE-Boot. Detaillierte Informationen finden Sie im Kapitel 18, Vorbereiten der Netzwerk-Boot-Umgebung.

Die Installation ist von vielen gängigen Netzwerkprotokollen wie NFS, HTTP, FTP oder SMB möglich. Weitere Informationen zur Durchführung einer solchen Installation finden Sie in Kapitel 12, Ferninstallation.

Konfigurieren Sie die Firmware des Zielsystems für das Booten des ausgewählten Mediums. Beachten Sie bei der Konfiguration der richtigen Boot-Reihenfolge die Dokumentation des Hardware-Herstellers.

Legen Sie die erforderlichen Boot-Parameter für Ihre Installationssteuerungsmethode fest. In Abschnitt 2.3, „Installationsmethoden“ finden Sie einen Überblick über die verschiedenen Methoden. In Kapitel 8, Boot-Parameter finden Sie eine Liste der Boot-Parameter.

Führen Sie die Installation wie in Kapitel 9, Installationsschritte beschrieben aus. Das System muss nach Abschluss der Installation neu gestartet werden.

Optional: Ändern Sie die Boot-Reihenfolge des Systems, sodass der Bootvorgang direkt von dem Medium aus gestartet wird, auf dem SUSE Linux Enterprise Server installiert wurde. Wenn das System vom Installationsmedium bootet, legt der erste Boot-Parameter fest, dass das installierte System gebootet werden soll.

2.5 Behandlung von Start- und Installationsproblemen #

Vor der Bereitstellung wird SUSE® Linux Enterprise Server umfangreichen Tests unterzogen. Dennoch treten gelegentlich Probleme beim Start oder bei der Installation auf.

2.5.1 Probleme beim Booten #

Startprobleme können das YaST-Installationsprogramm daran hindern, Ihr System zu starten. Ein weiteres Symptom ist, dass Ihr System nicht startet, nachdem die Installation abgeschlossen wurde.

- Das System bootet nicht vom Installationsmedium

Ändern Sie die Firmware oder das BIOS Ihres Computers, sodass die richtige Startsequenz eingestellt ist. Ziehen Sie hierzu die Dokumentation zu Ihrer Hardware zurate.

- Der Computer stürzt ab

Ändern Sie die Konsole auf Ihrem Computer, sodass die Kernel-Ausgabe sichtbar wird. Überprüfen Sie die letzten Ausgaben. In der Regel erfolgt dies durch Drücken der Tasten Strg–Alt–F10. Falls Sie das Problem nicht beheben können, wenden Sie sich an die SUSE Linux Enterprise Server-Supportmitarbeiter. Um alle Systemmeldungen zum Startzeitpunkt zu protokollieren, verwenden Sie eine serielle Verbindung, wie im Abschnitt 2.3, „Installationsmethoden“ beschrieben.

- Boot-Diskette

Die Boot-Disk ist eine nützliche Übergangslösung, falls Probleme bei der Festlegung der anderen Konfigurationen auftreten oder Sie die Entscheidung bezüglich des endgültigen Startmechanismus noch aufschieben möchten. Weitere Details über das Erstellen von Boot-Disks finden Sie im Book “Verwaltungshandbuch”, Chapter 18 “Der Bootloader GRUB 2” grub2-mkrescue.

- Viruswarnung nach der Installation

In einigen BIOS-Varianten wird die Struktur des Bootsektors (MBR) überprüft und nach der Installation von GRUB 2 wird fälschlicherweise eine Virenwarnung angezeigt. Dieses Problem lässt sich lösen, indem Sie das BIOS aufrufen, nach den entsprechenden Einstellungen suchen und diese bearbeiten. Deaktivieren Sie beispielsweise . Sie können diese Option später wieder aktivieren. Wenn als einziges Betriebssystem Linux verwendet wird, ist dies jedoch nicht erforderlich.

2.5.2 Probleme bei der Installation #

Wenn während der Installation ein unerwartetes Problem auftritt, sind Informationen zum Ermitteln der Ursache erforderlich. Die folgenden Anweisungen helfen Ihnen bei der Fehlersuche:

Überprüfen Sie die Ausgaben der verschiedenen Konsolen. Sie können die Konsole mit der Tastenkombination Strg–Alt– Fn wechseln. Rufen Sie beispielsweise eine Shell zum Ausführen verschiedener Befehle auf, indem Sie Strg–Alt– F2 drücken.

Versuchen Sie, die Installation mit „sicheren Einstellungen“ zu starten. (Drücken Sie im Installationsbildschirm die Taste F5 und wählen Sie .) Wenn die Installation in diesem Fall problemlos funktioniert, besteht eine Inkompatibilität, die zu einem Fehler in

ACPIoderAPICführt. In einigen Fällen kann eine BIOS- oder Firmware-Aktualisierung dieses Problem beheben.Überprüfen Sie die Systemmeldungen in der Konsole des Installationssystems durch Eingabe des Befehls

dmesg -T.

2.5.3 Initiieren der Installation statt Booten #

Die Standardoption im Startmenü der Installationsquelle für SUSE Linux Enterprise Server bootet den Rechner in das bereits installierte System. Um dies zu vermeiden und stattdessen den Installationsprozess zu starten, wählen Sie eine der verfügbaren Installationsoptionen im Startmenü.

3 Installation in der Arm AArch64-Architektur #

In diesem Kapitel werden die erforderlichen Schritte für die Vorbereitung der Installation von SUSE Linux Enterprise Server auf ARM AArch64-Computern beschrieben. Es beschreibt die für die Vorbereitung der verschiedenen Installationsmethoden erforderlichen Schritte. Die Liste der Hardware-Anforderungen bietet einen Überblick über die von SUSE Linux Enterprise Server unterstützten Systeme. Sie erhalten Informationen über verfügbare Installationsmethoden und mehrere bekannte Probleme. Sie lernen, wie Sie die Installation steuern, Installationsmedien zur Verfügung stelln und mit normalen Methoden booten können.

3.1 Hardware #

Das Betriebssystem SUSE® Linux Enterprise Server eignet sich für die verschiedensten Hardware-Geräte. Es ist unmöglich, alle denkbaren Hardware-Kombinationen aufzuführen, die von SUSE Linux Enterprise Server unterstützt werden. Um Ihnen für die Planungsphase eine Richtlinie zur Verfügung zu stellen, werden hier die Mindestanforderungen dargestellt.

Wenn Sie ganz sichergehen möchten, dass eine bestimmte Computerkonfiguration funktioniert, erkundigen Sie sich, welche Plattformen von SUSE zertifiziert wurden. Eine Liste finden Sie unter https://www.suse.com/yessearch/.

- Prozessor

Als Mindestanforderung ist eine CPU erforderlich, die die Armv8-A-Befehlssatzinfrastruktur (Instruction Set Architecture, ISA) unterstützt, z. B. Arm Cortex-A53 oder Cortex-A57. Eine Liste der verfügbaren Armv8-A-Prozessoren finden Sie unter https://www.arm.com/products/processors/cortex-a/.

CPUs mit der Armv8-R- (Echtzeit) und Armv8-M-ISA (Mikrokontroller) werden derzeit nicht unterstützt.

- Maximale Anzahl von CPUs

Die maximale Anzahl der unterstützten CPUs beträgt 256. Wenn Sie ein so großes System nutzen möchten, informieren Sie sich auf unserer Webseite zur Hardware-Systemzertifizierung über die unterstützten Geräte (siehe https://www.suse.com/yessearch/).

- Speicheranforderungen

Für eine Minimalinstallation sind mindestens 1024 MB Arbeitsspeicher erforderlich. Fügen Sie auf Rechnern mit mehr als zwei Prozessoren 512 MB pro CPU hinzu. Fügen Sie bei Installationen auf Remote-Systemen über HTTP oder FTP weitere 150 MB hinzu. Diese Werte gelten ausschließlich für die Installation des Betriebssystems. Der tatsächliche Arbeitsspeicherbedarf in der Produktion ist abhängig von der Auslastung des Systems. Für Systeme, auf denen die GNOME-Desktop-Umgebung ausgeführt wird, sind mindestens 2048 MB Arbeitsspeicher erforderlich und 4096 MB werden empfohlen.

- Anforderungen an die Festplatte

Die Anforderungen an die Festplatte sind im Wesentlichen abhängig von der ausgewählten Installation und von der geplanten Nutzung des Computers. Gewöhnlich benötigen Sie mehr Speicherplatz als die Installationssoftware alleine, damit ein System ordnungsgemäß arbeitet. Mindestanforderungen für verschiedene Optionen:

Installationsumfang

Mindestanforderungen an die Festplatte

Expertenmodus

1,5 GB

Minimalinstallation

2,5 GB

GNOME-Desktop

3 GB

Alle Schemata

4 GB

Empfohlener Mindestwert (keine Btrfs-Snapshots): 10 GB

Erforderlicher Mindestwert (mit Btrfs-Snapshots): 16 GB

Empfohlener Mindestwert (mit Btrfs-Snapshots): 32 GB

Bei einer root-Partition kleiner als 10 GB macht das Installationsprogramm keinen Vorschlag für eine automatische Partitionierung und Partitionen müssen manuell erstellt werden. Daher werden als Mindestgröße für die root-Partition 10 GB empfohlen. Die root-Partition muss mindestens 16 GB groß sein, wenn Sie Btrfs-Snapshots auf dem root-Volume für System-Rollbacks (siehe Book “Verwaltungshandbuch”, Chapter 10 “Systemwiederherstellung und Snapshot-Verwaltung mit Snapper”) ermöglichen möchten.

- Boot-Methoden

Der Computer kann von einem USB-Datenträger oder über das Netzwerk gestartet werden. Zum Starten über das Netzwerk ist ein spezieller Boot-Server erforderlich. Die Einrichtung kann mit SUSE Linux Enterprise Server erfolgen.

3.2 Überlegungen zur Installation #

Dieser Abschnitt umfasst zahlreiche Faktoren, die vor der Installation von SUSE Linux Enterprise Server auf ARM AArch64-Hardware zu berücksichtigen sind.

3.2.1 Installation auf Hardware oder auf einem virtuellen Computer #

SUSE Linux Enterprise Server wird in der Regel als unabhängiges Betriebssystem installiert. Dank der Virtualisierung ist es auch möglich, mehrere Instanzen von SUSE Linux Enterprise Server auf derselben Hardware auszuführen. Die Installation des VM-Host-Servers erfolgt wie eine typische Installation mit einigen zusätzlichen Paketen. Ein Beschreibung der Installation von virtuellen Gästen finden Sie im Book “Virtualization Guide”, Chapter 10 “Guest installation”.

3.2.2 Installationsziel #

Die meisten Installationen erfolgen auf der lokalen Festplatte. Daher müssen die Festplatten-Controller für das Installationssystem nicht zur Verfügung stehen. Wenn ein bestimmter Controller (z. B. ein RAID-Controller) ein zusätzliches Kernel-Modul benötigt, stellen Sie für das Installationssystem eine Aktualisierungsdiskette für das Kernel-Modul bereit.

Sonstige Installationsziele können verschiedene Arten von Block-Geräten sein, die ausreichenden Speicherplatz und eine entsprechende Geschwindigkeit zum Ausführen eines Betriebssystems bieten. Dies beinhaltet auch Netzwerk-Block-Geräte, wie iSCSI oder SAN. Die Installation kann auch auf Netzwerk-Dateisystemen mit den standardmäßigen Unix-Berechtigungen ausgeführt werden. Beim Starten dieser Systeme können jedoch Probleme auftreten, da sie von initramfs unterstützt werden müssen, damit das eigentliche System gestartet werden kann. Diese Installationen sind insbesondere dann von Nutzen, wenn Sie dasselbe System an verschiedenen Standorten starten müssen oder den Einsatz von Virtualisierungsfunktionen planen (z. B. Domänenmigration).

3.3 Steuern des Installationsprozesses #

Sie können die gewünschte Installationsmethode auswählen, indem Sie die Einrichtung mit einer der im Abschnitt 2.4, „Booten des Systems“ aufgeführten Optionen starten. Informationen zum Aktivieren der verschiedenen Installationsmethoden finden Sie im Abschnitt 8.3.4, „Festlegen des Fernzugriffs“. Informationen zur Verwendung der Ferninstallationsmethoden finden Sie in Kapitel 12, Ferninstallation.

Ein kurzer Überblick über die verschiedenen Methoden:

- Lokal mit Monitor und Tastatur

Mit dieser Methode wird SUSE Linux Enterprise Server am häufigsten installiert. Sie erfordert wenig Vorbereitung, jedoch viel direkte Interaktion.

- Im Fernverfahren über SSH

Sie können die Installation über SSH entweder im Textmodus vornehmen oder die grafische Installation per X-Forwarding ausführen. Detaillierte Informationen finden Sie im Abschnitt 12.4, „Überwachen der Installation über SSH“.

- Im Fernverfahren über serielle Konsole

Für diese Installationsmethode benötigen Sie einen zweiten Computer, der über ein Nullmodem-Kabel mit dem Zielcomputer verbunden ist. Die Installation erfolgt im Textmodus. Detaillierte Informationen finden Sie im Abschnitt 12.5, „Installation über die serielle Konsole“.

- Im Fernverfahren über VNC

Verwenden Sie diese Methode, um die Installation über eine grafische Oberfläche ohne direkten Zugriff auf den Zielcomputer auszuführen. Detaillierte Informationen finden Sie im Abschnitt 12.3, „Überwachen der Installation über VNC“.

- Automatisch über AutoYaST

Zur Installation SUSE Linux Enterprise Server auf mehreren Computern mit ähnlicher Hardware empfiehlt es sich, die Installationen mit AutoYaST durchzuführen. Installieren Sie in diesem Fall zuerst eine Instanz von SUSE Linux Enterprise Server und erstellen Sie hierüber die erforderlichen AutoYaST-Konfigurationsdateien. Detaillierte Informationen finden Sie im Book “AutoYaST Guide”.

3.4 Booten des Systems #

In diesem Abschnitt erhalten Sie einen Überblick über die Schritte zur vollständigen Installation von SUSE Linux Enterprise Server.

Anders als bei früheren SLE-Produkten lässt sich die gesamte SLE 15 SP6-Produktlinie mit dem Unified Installer installieren. Detaillierte Informationen zu den Änderungen seit SUSE Linux Enterprise 15 und dazu, welche Medien für die Installation heruntergeladen werden sollen, finden Sie in Abschnitt 1.5, „Änderungen bei der Installation von SUSE Linux Enterprise Server Version 15“..

Eine vollständige Beschreibung der Installation und Konfiguration des Systems mit YaST finden Sie in Teil II, „Installationsvorgang“.

Wenn Sie eine neue Hardware verwenden, kann es erforderlich sein, die System mit einem neueren Kernel von einem Kernel Update ISO-Image zu booten. Detaillierte Informationen finden Sie im Kapitel 7, Installation auf Hardware, die zum Zeitpunkt der Freigabe nicht unterstützt wurde.

Bereiten Sie die Installationsmedien vor.

- USB-Flash-Laufwerk

Das ist die einfachste Methode zum Starten der Installation. Zum Erstellen eines bootfähigen Flash-Laufwerks müssen Sie ein DVD-Image mit dem Befehl

ddauf das Gerät kopieren. Der Flash-Datenträger darf nicht eingehängt sein, und alle Daten auf dem Gerät werden gelöscht.#ddif=PATH_TO_ISO_IMAGE of=USB_STORAGE_DEVICE bs=4M- Booten vom Netzwerk

Falls von der Firmware des Zielrechners unterstützt, können Sie den Computer vom Netzwerk aus booten und von einem Server aus installieren. Diese Bootmethode erfordert einen Boot-Server, der die erforderlichen Boot-Images über das Netzwerk bereitstellt. Das exakte Protokoll hängt von Ihrer Hardware ab. In der Regel benötigen Sie mehrere Dienste, wie TFTP und DHCP oder PXE-Boot. Detaillierte Informationen finden Sie im Kapitel 18, Vorbereiten der Netzwerk-Boot-Umgebung.

Die Installation ist von vielen gängigen Netzwerkprotokollen wie NFS, HTTP, FTP oder SMB möglich. Weitere Informationen zur Durchführung einer solchen Installation finden Sie in Kapitel 12, Ferninstallation.

Konfigurieren Sie die Firmware des Zielsystems für das Booten des ausgewählten Mediums. Beachten Sie bei der Konfiguration der richtigen Boot-Reihenfolge die Dokumentation des Hardware-Herstellers.

Legen Sie die erforderlichen Boot-Parameter für Ihre Installationssteuerungsmethode fest. In Abschnitt 3.3, „Steuern des Installationsprozesses“ finden Sie einen Überblick über die verschiedenen Methoden. In Kapitel 8, Boot-Parameter finden Sie eine Liste der Boot-Parameter.

Führen Sie die Installation wie in Kapitel 9, Installationsschritte beschrieben aus. Das System muss nach Abschluss der Installation neu gestartet werden.

Optional: Ändern Sie die Boot-Reihenfolge des Systems, sodass der Bootvorgang direkt von dem Medium aus gestartet wird, auf dem SUSE Linux Enterprise Server installiert wurde. Wenn das System vom Installationsmedium bootet, legt der erste Boot-Parameter fest, dass das installierte System gebootet werden soll.

3.5 Behandlung von Start- und Installationsproblemen #

Obwohl SUSE® Linux Enterprise Server einem umfangreichen Testprogramm unterzogen wird, treten möglicherweise gelegentlich Probleme beim Starten oder bei der Installation auf.

3.5.1 Probleme beim Booten #

Startprobleme können das YaST-Installationsprogramm daran hindern, Ihr System zu starten. Ein weiteres Symptom ist, dass Ihr System nicht startet, nachdem die Installation abgeschlossen wurde.

- Rechner bootet das installierte System anstelle des Installationsmediums

Ändern Sie die Bootsequenz im BIOS des Rechners. Weitere Informationen finden Sie in der mit der Hardware bereitgestellten Dokumentation.

- Das System stürzt ab

Ändern Sie die Konsole auf Ihrem System, sodass die Kernel-Ausgabe sichtbar wird. Überprüfen Sie die letzten Zeilen der Ausgabe. In der Regel erfolgt dies durch Drücken der Tasten Strg–Alt–F10. Falls Sie das Problem nicht beheben können, wenden Sie sich an die SUSE Linux Enterprise Server-Supportmitarbeiter. Um alle Systemmeldungen zum Startzeitpunkt zu protokollieren, verwenden Sie eine serielle Verbindung, wie im Abschnitt 2.3, „Installationsmethoden“ beschrieben.

- Boot-Diskette

Die Boot-Disk ist eine nützliche Übergangslösung. Verwenden Sie eine Boot-Disk, falls Probleme bei der Festlegung der anderen Konfigurationen auftreten oder Sie die Entscheidung bezüglich des endgültigen Startmechanismus noch aufschieben möchten. Weitere Informationen über das Erstellen von Boot-Disks finden Sie unter Book “Verwaltungshandbuch”, Chapter 18 “Der Bootloader GRUB 2” grub2-mkrescue.

3.5.2 Probleme bei der Installation #

Wenn während der Installation ein unerwartetes Problem auftritt, sind Informationen zum Ermitteln der Ursache erforderlich. Die folgenden Anweisungen helfen Ihnen bei der Fehlersuche:

Überprüfen Sie die Ausgaben der verschiedenen Konsolen. Sie können die Konsole mit der Tastenkombination Strg–Alt– Fn wechseln. Rufen Sie beispielsweise eine Shell zum Ausführen verschiedener Befehle auf, indem Sie Strg–Alt– F2 drücken.

Versuchen Sie, die Installation mit „sicheren Einstellungen“ zu starten. (Drücken Sie im Installationsbildschirm die Taste F5 und wählen Sie .) Wenn die Installation in diesem Fall problemlos funktioniert, besteht eine Inkompatibilität, die zu einem Fehler in

ACPIoderAPICführt. In einigen Fällen kann dieses Problem durch eine Firmware-Aktualisierung behoben werden.Überprüfen Sie die Systemmeldungen in der Konsole des Installationssystems durch Eingabe des Befehls

dmesg -T.

3.5.3 Initiieren der Installation statt Booten #

Die Standardoption im Startmenü des Installationsmediums für SUSE Linux Enterprise Server bootet den Rechner in das bereits installierte System. Um stattdessen den Installationsprozess zu starten, wählen Sie eine der verfügbaren Installationsoptionen im Startmenü.

3.6 Raspberry Pi #

SUSE Linux Enterprise Server ist die erste Linux-Distribution für Unternehmen, die den kostengünstigen Einplatinenrechner Raspberry Pi* unterstützt. SUSE Linux Enterprise Server 15 SP6 unterstützt folgende Modelle:

Raspberry Pi 3 Model A+

Raspberry Pi 3 Model B

Raspberry Pi 3 Model B+

Raspberry Pi 4 Model B

Raspberry Pi Compute Module 3

Raspberry Pi Compute Module 3+

Der Raspberry Pi unterscheidet sich in mehreren Aspekten von herkömmlichen Serverrechnern. Vor allem ist er nicht mit einem Bootloader zum Laden von Betriebssystemen ausgestattet. Im Lieferumfang von SUSE Linux Enterprise Server ist daher zusätzlich eine Bootloader-Software enthalten, die diese Lücke schließt.

3.6.1 Bootvorgang #

Der primäre Prozessor des System-on-Chip (SoC) des Raspberry Pi ist die Broadcom VideoCore Graphics Processing Unit (GPU), nicht die Arm Central Processing Unit (CPU). Die GPU startet die Initialisierung der Hardware von einem Bootloader der ersten Stufe im On-Chip Boot-ROM. Nur wenige Konfigurationsoptionen haben Einfluss auf den Boot-ROM. Weitere Informationen hierzu finden Sie in Abschnitt 3.6.1.2, „OTP-Speicher“.

Die Hardware des Raspberry Pi 3 enthält keine integrierte Firmware. Stattdessen wird die Bootloader-Firmware der zweiten Stufe, bootcode.bin, bei jedem Rechnerstart vom Bootmedium geladen. Diese wiederum lädt den Bootloader der dritten Stufe, start.elf.

Die Hardware des Raspberry Pi 4 ist mit einem kleinen EEPROM (Electrically Erasable Programmable Read-Only Memory) für den Bootloader der zweiten Stufe ausgestattet. Ansonsten ist die Bootsequenz ähnlich wie beim Raspberry Pi 3, wobei der Bootloader der dritten Stufe, start4.elf, vom Bootmedium geladen wird.

Ein Update des Bootloaders der zweiten Stufe kann durch Booten von einer speziell dafür vorbereiteten microSD-Karte erfolgen.

Legen Sie dazu einfach ein Bootmedium Ihres Vertrauens ein, und vergewissern Sie sich, dass nicht unabsichtlich eine Datei mit dem Namen recovery.bin vorhanden ist.

Wenn eine Datei armstub8.bin vorhanden ist, wird sie als Bootloader der vierten Stufe in AArch64 Exception Level 3 (EL3) geladen. Andernfalls wird ein minimal integrierter Stub verwendet.

Ein für EL3 geladener Code (oft BL31 genannt) ist im Arbeitsspeicher vorhanden und Linux versucht möglicherweise Hypercalls in EL3 während der gesamten Laufzeit.

Vergewissern Sie sich, dass Ihre Bootmedien nicht unabsichtlich eine Datei armstub8.bin enthalten. SUSE Linux Enterprise Server 15 SP6 enthält sie nicht.

Beachten Sie, dass das SoC des Raspberry Pi keinen TrustZone-Sicherheitsspeicher bereitstellt. Sowohl das Betriebssystem auf der CPU als auch Software auf der GPU hat Zugriff auf seinen RAM. Er ist daher nicht für kryptografische EL0-s-Anwendungen geeignet. SUSE Linux Enterprise Server stellt aus diesem Grund kein EL1-s-TEE (Trusted Execution Environment) zur Verfügung.

SUSE Linux Enterprise Server für den Raspberry Pi ist zum Laden eines Bootloaders der fünften Stufe namens Das U-Boot konfiguriert.

3.6.1.1 Config.txt #

Es gibt keinen nichtflüchtigen Speicher für Konfigurationsinformationen. Das bedeutet, dass es keine herkömmlichen Einstellungen zur Anpassung der Bootgerätereihenfolge, des Datums und der Uhrzeit usw. gibt.

Stattdessen liest der Bootloader eine Konfigurationsdatei config.txt vom Bootmedium. Die von SUSE bereitgestellte config.txt sollte nicht bearbeitet werden. Der Benutzer kann jedoch optional eine Datei extraconfig.txt bereitstellen, die gegebenenfalls die Einstellungen von config.txt überschreibt. Damit kann SUSE Linux Enterprise Server die Datei config.txt gegebenenfalls aktualisieren, ohne Benutzereinstellungen zu überschreiben.

3.6.1.2 OTP-Speicher #

Das SoC umfasst außerdem einen kleinen einmal programmierbaren Speicher (OTP, One-Time Programmable Memory). Dieser kann zum Konfigurieren einiger Einstellungen verwendet werden, wie zum Beispiel ob der Boot-ROM versuchen sollte, von USB-Geräten oder über Ethernet zu booten.

Dieser OTP-Speicher ist auf der Raspberry Pi Foundation-Website beschrieben: https://www.raspberrypi.org/documentation/hardware/raspberrypi/otpbits.md

Die in den OTP-Speicher geschriebenen Konfigurationseinstellungen lassen sich nicht rückgängig machen.

Am häufigsten wird der OTP-Speicher zur Aktivierung des USB-Boots auf dem Raspberry Pi 3 Model B oder Compute Module 3 genutzt.

3.6.1.3 Aktivieren des USB-Bootmodus für Raspberry Pi 3 Model B #

Bereiten Sie eine microSD-Karte vor wie in Abschnitt 3.6.3, „Bereitstellen eines Appliance-Image“ beschrieben, um dauerhaft das Booten von angeschlossenen USB-Massenspeichergeräten auf dem Raspberry Pi 3 Model B und von dessen integriertem USB-Ethernet zuzulassen. Fügen Sie vor dem Aushängen und Auswerfen der Karte und dem Booten von der Karte ihrer FAT-Partition eine Textdatei extraconfig.txt (Abschnitt 3.6.1.1, „Config.txt“) mit folgenden Einstellungen hinzu:

program_usb_boot_mode=1

Booten Sie dann von der bearbeiteten microSD-Karte wie üblich. Sobald Sie eine Ausgabe vom U-Boot- oder GRUB-Bootloader oder dem Linux-Kernel sehen, können Sie die Stromzufuhr trennen und dann die microSD-Karte entnehmen. Ihr Gerät sollte nun von USB booten können (Abschnitt 3.6.4, „Installation von USB-Medien“).

Beachten Sie, dass der für den Raspberry Pi 3 Model B aktivierte USB-Bootmodus nicht mehr deaktiviert werden kann (Abschnitt 3.6.1.2, „OTP-Speicher“).

Weitere Details finden Sie auf der Raspberry Pi Foundation-Website: https://www.raspberrypi.org/documentation/hardware/raspberrypi/bootmodes/msd.md

Für den Raspberry Pi Compute Module 3 sind dieselben Einstellungen erforderlich, doch die Bereitstellung des bearbeiteten Image ist etwas komplizierter.

3.6.2 Fehlen einer Echtzeituhr #

Am Raspberry Pi ist keine batteriegestützte Echtzeituhr (Real-Time Clock, RTC) vorhanden.

Da keine Echtzeituhr vorhanden ist, müssen Raspberry Pi-Geräte so konfiguriert werden, dass sie über NTP (Network Time Protocol) die Uhrzeit von einem Netzwerkserver abrufen.

Die Hauptplatinen in Raspberry Pi Compute Modules weisen jedoch möglicherweise eine RTC auf.

Es ist auch möglich, eine RTC über den GPIO-Anschluss mittels HATs (Hardware Attached on Top) oder anderen Erweiterungsplatinen anzuschließen.

Prüfen Sie jedoch in jedem Fall, ob der entsprechende RTC-Chipsatz von SUSE Linux Enterprise Server unterstützt wird. Die angeschlossene RTC muss dem Betriebssystem über ein Gerätebaum-Overlay beschrieben werden (Abschnitt 3.6.1.1, „Config.txt“).

- E/A-Karte des Compute Module 4

dtparam=i2c_vc=on dtoverlay=i2c-rtc,pcf85063a,i2c_csi_dsi

- MyPi-Basiskarte

dtparam=i2c1=on dtoverlay=i2c-rtc,ds1307

Informationen zu anderen Karten und HATs finden Sie in der jeweils mitgelieferten Dokumentation.

3.6.3 Bereitstellen eines Appliance-Image #

Zur Bereitstellung eines Betriebssystems auf Raspberry Pi-Hardware wird am häufigsten ein vorinstalliertes System-Image auf einem Bootmedium, normalerweise einer microSD-Karte, kopiert. Dies ist die schnellste und einfachste Methode.

SUSE stellt ein vorkonfiguriertes bootfähiges Image von SUSE Linux Enterprise Server für Raspberry Pi-Hardware bereit. Es ist im Btrfs-Dateisystem enthalten und die Komprimierung ist aktiviert, um die Leistung zu verbessern und den Verschleiß auf microSD-Medien zu reduzieren.

Es wird eine microSD-Karte mit einer Mindestgröße von 8 GB empfohlen. Schnellere Karten erhöhen die Systemleistung. Beim ersten Bootvorgang erweitert das Betriebssystem das Dateisystem automatisch, um die Karte auszufüllen. Dies bedeutet, dass der erste Bootvorgang wesentlich länger dauert als folgende Bootvorgänge.

In Raspberry Pi Quick Start wird erläutert, wie das Karten-Image auf microSD-Medien geschrieben wird.

3.6.4 Installation von USB-Medien #

Einige Modelle des Raspberry Pi lassen das Booten von USB-Massenspeichergeräten zu. Daraufhin ist die Bereitstellung von SUSE Linux Enterprise Server auf Raspberry Pi ähnlich wie bei Serverplattformen möglich.

Die Installation kann von einem USB-Wechselmedium wie einem Speicherstick auf eine microSD-Karte im internen Steckplatz des Rechners erfolgen. Alternativ kann die Installation von einem USB-Medium auf ein anderes USB-Medium wie eine über USB angeschlossene Festplatte durchgeführt werden.

Beachten Sie, dass der Ethernet-Controller auf dem Raspberry Pi 3 am integrierten USB-2.0-Bus des Geräts angeschlossen ist.

Daher muss ein Betriebssystem, das von einem über USB angeschlossenen Wechseldatenträger aus ausgeführt wird, die gesamte Bandbreite von 480 MBit/s des USB 2.0-Controllers freigeben. Dies schränkt die Leistung ein und könnte erhebliche Beeinträchtigungen der Netzwerkleistung nach sich ziehen.

Diese Beschränkung gilt nicht für den Raspberry Pi 4.

Neuere Modelle des Raspberry Pi 3 mit BCM2837 B0-Silizium (silberne statt schwarzer Chips), einschließlich Raspberry Pi 3 Model B+ und Compute Module 3+, ermöglichen standardmäßig das Booten von USB-Speichergeräten.

Bei älteren Modellen wie dem Raspberry Pi 3 Model B oder Compute Module 3, kann einmalig ein USB-Boot durch Booten von einer speziell dafür vorbereiteten microSD-Karte aktiviert werden. Eine Anleitung dazu finden Sie im Abschnitt 3.6.1.2, „OTP-Speicher“.

3.6.5 Installation vom Netzwerk #

Da in der Hardware keine Firmware integriert ist (Abschnitt 3.6.1, „Bootvorgang“), ist das Netzwerk-Booten des Raspberry Pi über PXE komplexer als bei den meisten herkömmlichen Computern.

Der Prozess zum Einrichten eines PXE-Boot-Servers für x86 und Arm wird im Dokument SUSE Best Practices How to Set Up a Multi-PXE Installation Server beschrieben.

Die Raspberry Pi Foundation veröffentlicht Informationen über das Booten eines Raspberry Pi von einem anderen Raspberry Pi über PXE: https://www.raspberrypi.org/documentation/hardware/raspberrypi/bootmodes/net_tutorial.md

3.6.6 Zusätzliche Informationsquellen #

Weitere Informationen finden Sie in den folgenden Ressourcen:

- SUSE Linux Enterprise Server 15 SP4-Versionshinweise

Weitere Informationen zur Hardwarekompatibilität, den unterstützten Optionen und Funktionen bei der Ausführung auf Raspberry Pi finden Sie in den SUSE Linux Enterprise Server-Versionshinweisen in Abschnitt Boot and Driver Enablement for Raspberry Pi:

https://www.suse.com/releasenotes/aarch64/SUSE-SLES/15-SP4/#aarch64-rpi

- Raspberry Pi Quick Start

https://documentation.suse.com/sles/15-SP4/html/SLES-raspberry-pi/article-raspberry-pi.html

- Liste der openSUSE-Hardwarekompatibilität: Raspberry Pi 3

Das openSUSE-Projekt umfasst auch Informationen zu Installation und Konfiguration der Raspberry Pi-Hardware. Vieles davon gilt auch für SUSE Linux Enterprise.

Weitere Informationen hierzu finden Sie unter https://en.opensuse.org/HCL:Raspberry_Pi3.

- Das U-Boot

Weitere Informationen über den Bootloader

Das U-Bootfinden Sie auf der GitHub-Seite des Projekts unter https://github.com/u-boot/u-boot.

4 Installation auf IBM POWER #

Dieses Kapitel beschreibt das Installationsverfahren für SUSE Linux Enterprise Server unter IBM POWER-Systemen.

4.1 Hardware #

Zur Ausführung von SUSE Linux Enterprise Server unter POWER muss Ihre Hardware die unten aufgeführten Mindestanforderungen erfüllen.

- Unterstützte Server

Schlagen Sie in der Datenbank der SUSE-zertifizierten Hardware nach, um sicherzustellen, dass Ihre spezielle Hardwarekonfiguration unterstützt wird. Die Datenbank ist verfügbar unter https://www.suse.com/yessearch/Search.jsp. SUSE Linux Enterprise Server unterstützt möglicherweise weitere IBM POWER-Systeme, die nicht aufgeführt sind. Aktuelle Informationen finden Sie im IBM Information Center für Linux unter https://www.ibm.com/support/knowledgecenter/linuxonibm/liaam/liaamdistros.htm.

- Speicheranforderungen

Für eine Minimalinstallation sind mindestens 1024 MB Arbeitsspeicher erforderlich. Fügen Sie auf Rechnern mit mehr als zwei Prozessoren 512 MB pro CPU hinzu. Fügen Sie bei Installationen auf Remote-Systemen über HTTP oder FTP weitere 150 MB hinzu. Diese Werte gelten ausschließlich für die Installation des Betriebssystems. Der tatsächliche Arbeitsspeicherbedarf in der Produktion ist abhängig von der Auslastung des Systems. Für Systeme, auf denen die GNOME-Desktop-Umgebung ausgeführt wird, sind mindestens 2048 MB Arbeitsspeicher erforderlich, und 4096 MB werden empfohlen.

- Anforderungen an die Festplatte

Die Festplattenanforderungen hängen vom Typ der Installation und dem Benutzerszenario ab. Normalerweise benötigt ein ordnungsgemäß funktionierendes System mehr Speicherplatz als die Installation selbst. Die Mindestanforderungen sind wie folgt:

Installationsumfang

Mindestanforderungen an die Festplatte

Expertenmodus

1,5 GB

Minimalinstallation

2,5 GB

GNOME-Desktop

3 GB

Alle Schemata

4 GB

Empfohlener Mindestwert (keine Btrfs-Snapshots): 10 GB

Erforderlicher Mindestwert (mit Btrfs-Snapshots): 16 GB

Empfohlener Mindestwert (mit Btrfs-Snapshots): 32 GB

Wenn die Stammpartition kleiner als 10 GB ist, schlägt das Installationsprogramm keine Partitionierung vor. In diesem Fall müssen Sie Partitionen manuell erstellen. Wir empfehlen Ihnen, 10 GB für die Stammpartition zu reservieren, um dies zu vermeiden. Erhöhen Sie die Mindestgröße auf 16 GB, wenn Sie planen, Btrfs-Snapshots im root-Volume zu aktivieren (weitere Informationen finden Sie im Book “Verwaltungshandbuch”, Chapter 10 “Systemwiederherstellung und Snapshot-Verwaltung mit Snapper”).

Vergewissern Sie sich vor der Installation von SUSE Linux Enterprise Server, dass am Server die neueste Firmware installiert ist. Die neueste Firmware finden Sie im IBM FixCentral: https://www.ibm.com/support/fixcentral/. Wählen Sie das System in der Liste der Produktgruppen aus. Im IBM PowerLinux Tools Repository steht weitere Software zur Verfügung. Unter https://www.ibm.com/docs/en/linux-on-systems?topic=servers-linux-power-tools-repository finden Sie weitere Informationen zur Verwendung des IBM PowerLinux Tools Repository.

4.2 Installieren von SUSE Linux Enterprise Server für POWER #

Das folgende Verfahren beschreibt die Einrichtung einer Installationsumgebung. Überspringen Sie es, falls Sie bereits eine Installationsumgebung eingerichtet haben.

Starten Sie eine SSH-Sitzungen an Ihrer HMC, und führen Sie das Kommando

vtmenuaus.Wählen Sie den gewünschten POWER-Server und die LPAR aus. Wenn für die gewählte LPAR bereits eine Sitzung an der seriellen Konsole besteht, müssen Sie diese zunächst mit folgendem Kommando schließen:

rmvterm -m SERVER -p LPAR

Booten Sie die LPAR neu, indem Sie eine neue SSH-Sitzung an der HMC erstellen und folgendes Kommando ausführen:

chsysstate -r lpar -m SERVER -o shutdown -n LPAR --immed --restart

Beachten Sie, dass dieses Kommando einen Hard-Reboot der LPAR verursacht. Entfernen Sie die Flagge

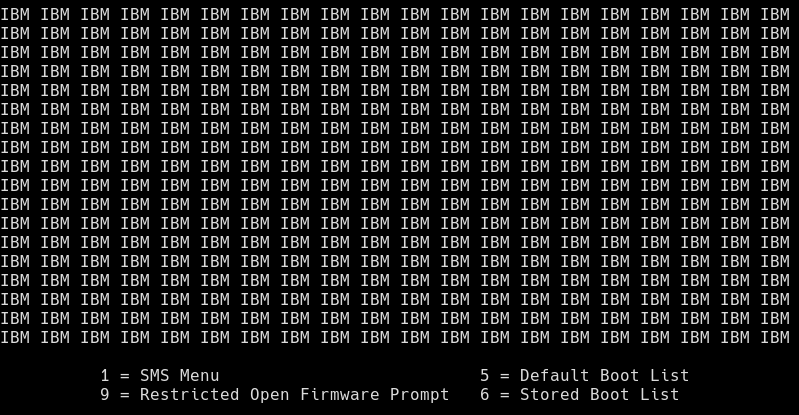

--immedaus dem oben genannten Kommando, um einen Soft-Reboot durchzuführen und ein ordnungsgemäßes Herunterfahren der aktiven Aufgaben zu ermöglichen.Drücken Sie nach Eingabeaufforderung an der seriellen Konsole die

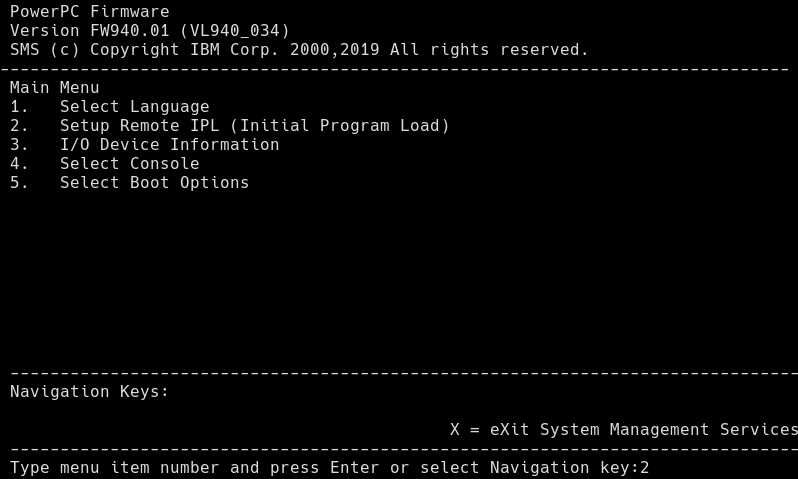

1, um das SMS-Menü zu öffnen.Wählen Sie

Setup Remote IPL (Initial Program Load), indem Sie2und Eingabetaste drücken.Wählen Sie den NIC-Adapter für den Zugriff auf den TFTP-Server aus.

Wählen Sie die zu verwendende IP-Version (zum Beispiel IPv4) aus.

Wählen Sie das Protokoll für den Zugriff auf den TFTP-Server aus (zum Beispiel

1für BOOTP).Wählen Sie

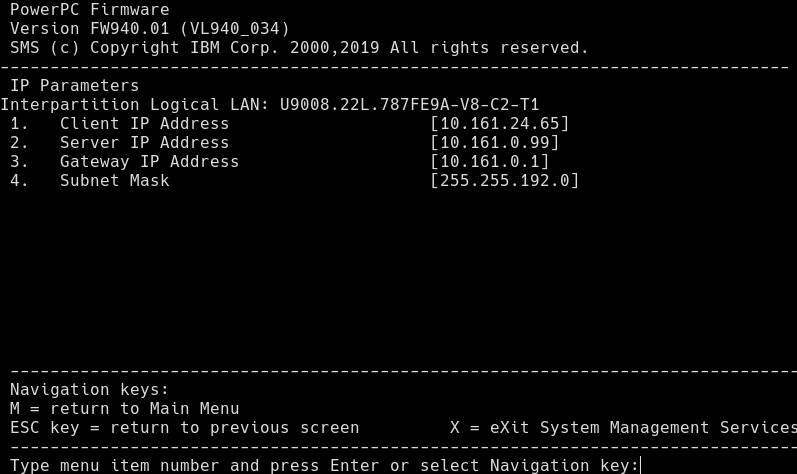

IP Parameters, indem Sie1und Eingabetaste drücken.Konfigurieren Sie die erforderlichen Netzwerkparameter der LPAR, einschließlich IP-Adresse, Netzwerk-Gateway und Netzwerkmaske. Geben Sie in der

Server IP Addressdie IP-Adresse des TFTP-Servers an.Kehren Sie durch Drücken der Esc-Taste zum ersten Bildschirm zurück. Wählen Sie folgende Einträge in der angegebenen Reihenfolge aus:

Select Boot OptionsSelect Install/Boot DeviceNetworkBOOTP

Wählen Sie den vorher angegebenen NIC-Adapter aus und wählen Sie dann:

Normal Mode BootYes

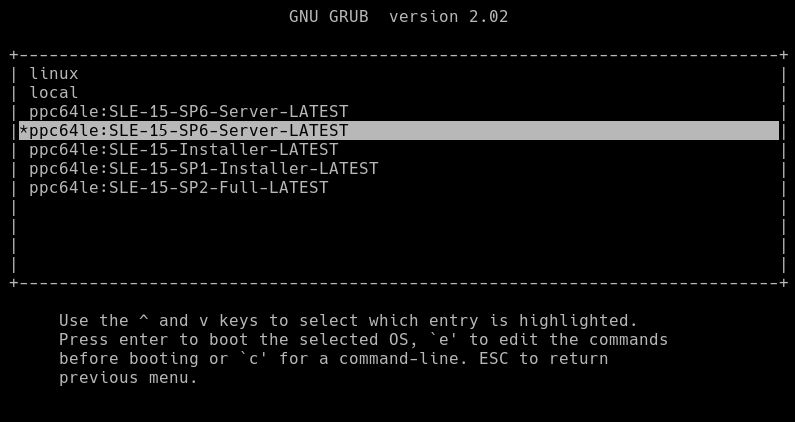

Zu Beginn des Vorgangs sollten Sie ein GRUB-Menü mit einer Liste der am TFTP-Server verfügbaren Images sehen.

4.3 Installieren von SUSE Linux Enterprise Server #

Im Allgemeinen verläuft die Installation von SUSE Linux Enterprise Server unter POWER ähnlich wie eine normale Installation.

In den ersten beiden Schritten werden Sie aufgefordert, die gewünschte Sprache und Tastatur zu wählen und die Lizenzvereinbarung des Produkts zu lesen und ihr zuzustimmen.

Wählen Sie als Nächstes die gewünschte Methode zur Produktregistrierung, und schließen Sie die Registrierung ab. Wenn Sie das System über das SUSE Customer Center registrieren, werden Sie aufgefordert, die Update-Repositorys zu aktivieren. Drücken Sie die Taste

Yes.Um Module oder Erweiterungen zu installieren, wählen Sie diese mit den Pfeiltasten aus, und drücken Sie Leertaste. Abhängig davon, welche Erweiterungen und Module Sie auswählen, werden Sie aufgefordert, GnuPG-Schlüssel für die verknüpften Repositorys zu importieren.

Installieren Sie die gewünschten Add-on-Produkte. Falls Sie ein Add-on installieren möchten, müssen Sie die Installationsquelle dafür angeben.

Geben Sie ein Partitionsschema für die Installation an. Drücken Sie

Nextoder Alt–N, um den Standardvorschlag zu akzeptieren.Wählen Sie die für Ihr spezielles Szenario geeignete Systemrolle.

Auf den nächsten Bildschirmen können Sie die entsprechende Zeitzone angeben und einen Benutzer erstellen. Falls Sie keinen Benutzer erstellen möchten, werden Sie aufgefordert, ein root-Passwort anzugeben.

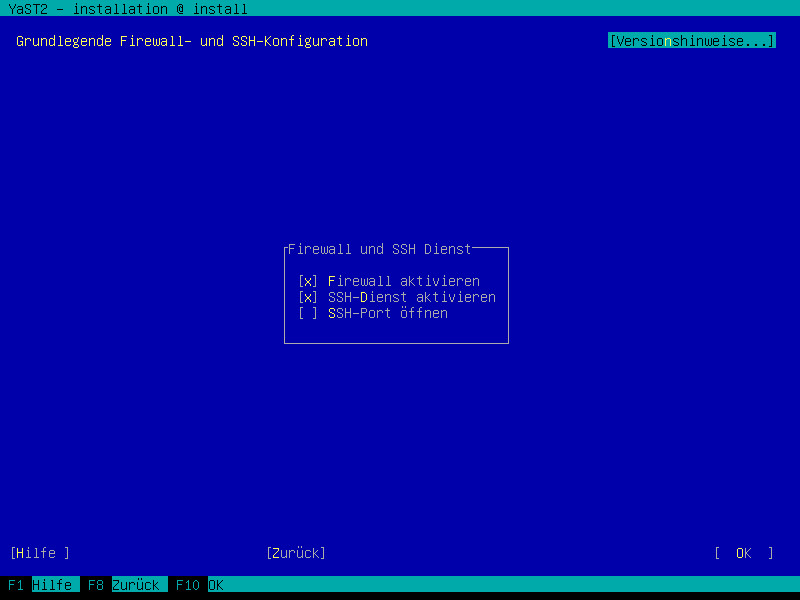

Vergewissern Sie sich am Bildschirm mit der Installationszusammenfassung, dass der SSH-Dienst aktiviert und ein SSH-Port geöffnet ist. Drücken Sie dazu

Change, gehen Sie zum BildschirmBasic Firewall and SSH Configuration, und aktivieren Sie die entsprechenden Optionen. Drücken Sie die TasteOK.Bestätigen Sie die Installationskonfiguration, und drücken Sie zum Starten des Installationsvorgangs auf

Install.

4.4 Zusätzliche Informationsquellen #

Sie erhalten weitere Informationen zu IBM PowerLinux von SUSE und IBM:

Die SUSE Support Knowledge Base unter https://www.suse.com/support/kb/ stellt eine Informationsquelle dar, die Kunden bei der Lösung von Problemen unterstützt. Durchsuchen Sie die Knowledge Base zu SUSE Linux Enterprise Server mithilfe von relevanten Suchbegriffen.

Sicherheitswarnungen finden Sie im https://www.suse.com/support/security/. SUSE pflegt auch zwei Mailinglisten zum Thema Sicherheit:

suse-security:·Allgemeine Diskussion von Sicherheitsthemen zu Linux und SUSE. Alle Sicherheitswarnungen für SUSE Linux Enterprise Server werden an diese Liste gesendet.suse-security-announce: Eine SUSE-Mailingliste speziell für Sicherheitswarnungen.

Um sich in die linuxppc-dev-Mailingliste einzutragen, melden Sie sich über die Formulare unter https://lists.ozlabs.org/listinfo/linuxppc-dev/ an.

5 Installation unter IBM Z und LinuxONE #

In diesem Kapitel wird die Vorbereitung der Installation von SUSE® Linux Enterprise Server auf IBM Z beschrieben. Hier finden Sie alle erforderlichen Informationen, mit denen Sie die Installation auf LPAR- und z/VM-Seite vorbereiten.

5.1 Systemanforderungen #

Dieser Abschnitt enthält grundlegende Informationen zu den Systemanforderungen, der MicroCode-Ebene und der Software für IBM Z.

5.1.1 Hardware #

SUSE Linux Enterprise Server wird auf folgenden Plattformen ausgeführt:

IBM zEnterprise EC12 (zEC12) (2827)

IBM zEnterprise BC12 (zBC12) (2828)

IBM z Systems z13 (2964)

IBM z Systems z13s (2965)

IBM z Systems z14 (3906)

IBM z Systems z14 ZR1 (3907)

IBM z Systems z15 T01 (8561)

IBM z Systems z15 T02 (8562)

IBM z Systems z16 A01 (3931)

IBM LinuxONE Emperor (2964)

IBM LinuxONE Rockhopper (2965)

IBM LinuxONE Emperor II (3906)

IBM LinuxONE Rockhopper II (3907)

IBM LinuxONE III LT1 (8561)

IBM LinuxONE III LT2 (8562)

IBM LinuxONE Emperor 4 (3931)

5.1.1.1 Speicheranforderungen #

Für verschiedene Installationsmethoden gelten bei der Installation unterschiedliche Speicheranforderungen. Für die Textmodus-Installation unter z/VM, LPAR und KVM wird ein Arbeitsspeicher mit mindestens 1 GB empfohlen. Für die Installation im Grafikmodus ist ein Arbeitsspeicher mit mindestens 1,5 GB erforderlich.

Ein Arbeitsspeicher mit mindestens 512 MB ist für die Installation von NFS-, FTP- und SMB-Installationsquellen erforderlich oder wenn VNC verwendet wird. Denken Sie daran, dass Arbeitsspeicheranforderungen auch von der Anzahl der Geräte abhängig ist, die für den z/VM-Gast oder das LPAR-Image sichtbar sind. Die Installation mit vielen zugänglichen Geräten (selbst wenn sie für die Installation nicht verwendet werden) kann mehr Speicher erfordern.

5.1.1.2 Festplattenspeicher, Anforderungen #

Die Anforderungen an die Festplatte hängen im Wesentlichen von der Installation ab. Für ein ordnungsgemäß funktionierendes System benötigen Sie normalerweise mehr Speicherplatz als für die Installationssoftware erforderlich. Die Mindestanforderungen für die verfügbaren Installationstypen sind wie folgt:

|

Installationstyp |

Mindestanforderungen an die Festplatte |

|---|---|

|

Expertenmodus |

1,5 GB |

|

Minimalinstallation |

2,5 GB |

|

GNOME-Desktop |

3 GB |

|

Alle Schemata |

4 GB |

|

Empfohlener Mindestwert (keine Btrfs-Snapshots): 10 GB | |

|

Erforderlicher Mindestwert (mit Btrfs-Snapshots): 16 GB | |

|

Empfohlener Mindestwert (mit Btrfs-Snapshots): 32 GB | |

5.1.1.3 Netzwerkverbindung #

Für die Kommunikation mit dem SUSE Linux Enterprise Server-System wird eine Netzwerkverbindung benötigt. Dabei kann es sich um eine oder mehrere der folgenden Verbindungen oder Netzwerkkarten handeln:

OSA Express Ethernet (einschließlich Fast und Gigabit Ethernet)

HiperSockets oder Gast-LAN

10 GBE, VSWITCH

RoCE (RDMA over Converged Ethernet)

Folgende Schnittstellen sind noch enthalten, werden aber nicht mehr unterstützt:

CTC (oder virtuelles CTC)

ESCON

IP-Netzwerkschnittstelle für IUCV

Für Installationen unter KVM müssen die folgenden Anforderungen erfüllt sein, damit dem VM-Gast ein transparenter Zugang zum Netzwerk ermöglicht wird:

Die virtuelle Netzwerkschnittstelle muss mit einer Host-Netzwerkschnittstelle verbunden sein.

Die Host-Netzwerkschnittstelle muss mit einem Netzwerk verbunden sein, dem der virtuelle Server beitritt.

Wenn der Host mit einer redundanten Netzwerkverbindung konfiguriert ist, bei der zwei unabhängige OSA-Netzwerk-Ports zu einer Bonding-Netzwerkschnittstelle gruppiert sind, gilt für die Bonding-Netzwerkschnittstelle die Kennung

bond0. Falls mehr als eine Bonding-Schnittstelle vorhanden ist, lautet siebond1,bond2usw.Für die Einrichtung einer nicht redundanten Netzwerkverbindung ist die Kennung der einzelnen Netzwerkschnittstelle erforderlich. Die Kennung hat das Format enccw0.0.NNNN, wobei NNNN für die Gerätenummer der gewünschten Netzwerkschnittstelle steht.

5.1.2 MicroCode-Ebene, APARs und Korrekturen #

Eine Dokumentation zu den Einschränkungen und Anforderungen für diese Version von SUSE Linux Enterprise Server finden Sie bei IBM developerWorks unter https://developer.ibm.com/technologies/linux/. Wir empfehlen die Verwendung des höchsten verfügbaren Servicelevels. Erfragen Sie die Mindestanforderungen beim IBM-Support.

Für z/VM werden die folgenden Versionen unterstützt:

z/VM 6.4

z/VM 7.1

z/VM 7.2

z/VM 7.3

Klären Sie die Reihenfolge der Installation mit dem IBM-Support, da es erforderlich sein kann, die VM APARs vor der Installation der neuen MicroCode-Ebenen zu aktivieren.

5.1.3 Software #

Beim Installieren von SUSE Linux Enterprise Server über nicht-Linux-gestütztes NFS oder FTP können Probleme mit der NFS- oder FTP-Serversoftware auftreten. Der standardmäßige FTP-Server unter Windows* kann Fehler verursachen. Daher empfehlen wir, die Installation auf diesen Rechnern über SMB durchzuführen.

Zum Herstellen einer Verbindung mit dem SUSE Linux Enterprise Server-Installationssystem ist eine der folgenden Methoden erforderlich (SSH oder VNC wird empfohlen):

- SSH mit Terminalemulation (xterm-kompatibel)

SSH ist ein Unix-Standardwerkzeug, das auf den meisten Unix- oder Linux-Systemen vorhanden ist. Für Windows können Sie den Putty SSH-Client verwenden.

- VNC-Client