このガイドは、SUSE® Linux Enterprise High Availability Extensionを使用してクラスタを設定、構成、および管理する必要がある管理者を対象にしています。構成と管理をすばやく効率的に行うため、この製品にはグラフィカルユーザインタフェースとコマンドラインインタフェース(CLI)の両方が備わっています。重要なタスクを実行するために、このガイドには両方のアプローチが説明されています。これにより、ニーズを満たす適切なツールを選択できるようになります。

- 序文

- I インストール、セットアップ、およびアップグレード

- II 設定および管理

- III ストレージとデータレプリケーション

- IV 付録

- 用語集

- E GNU licenses

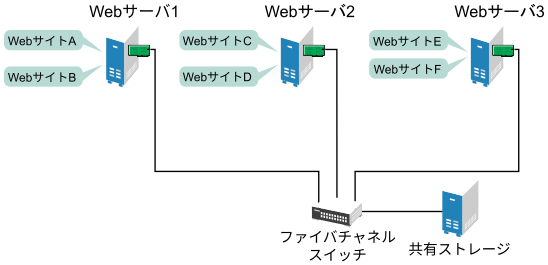

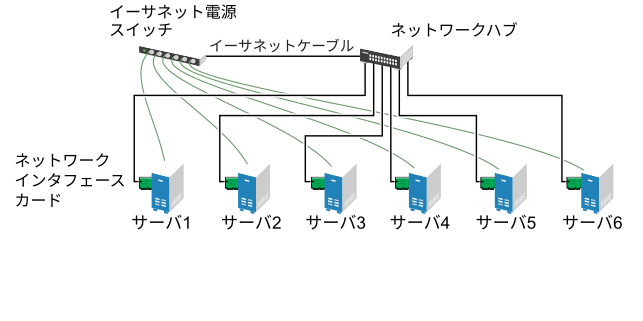

- 1.1 3サーバクラスタ

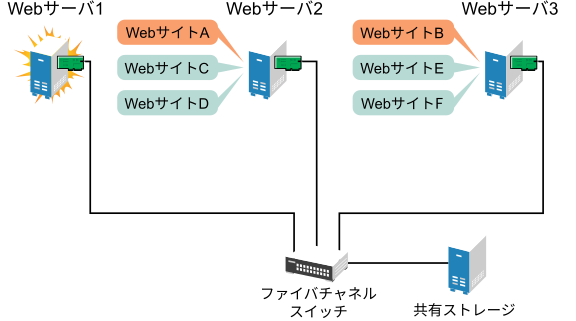

- 1.2 1台のサーバに障害が発生した後の3サーバクラスタ

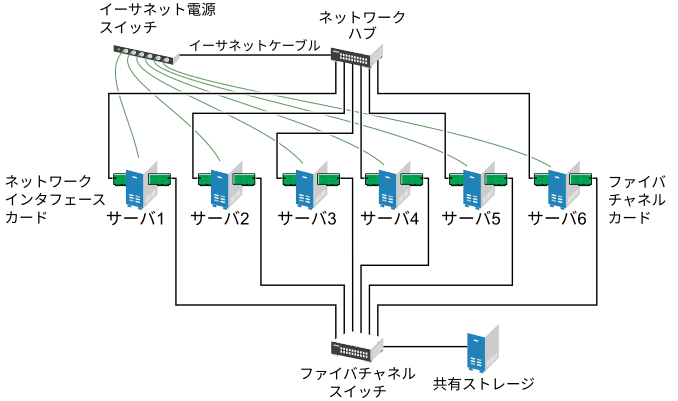

- 1.3 一般的なファイバチャネルクラスタの設定

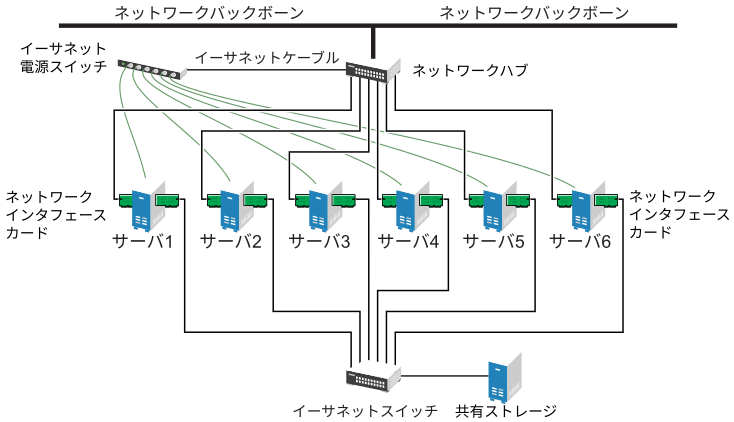

- 1.4 一般的なiSCSIクラスタの設定

- 1.5 共有ストレージなしの一般的なクラスタ設定

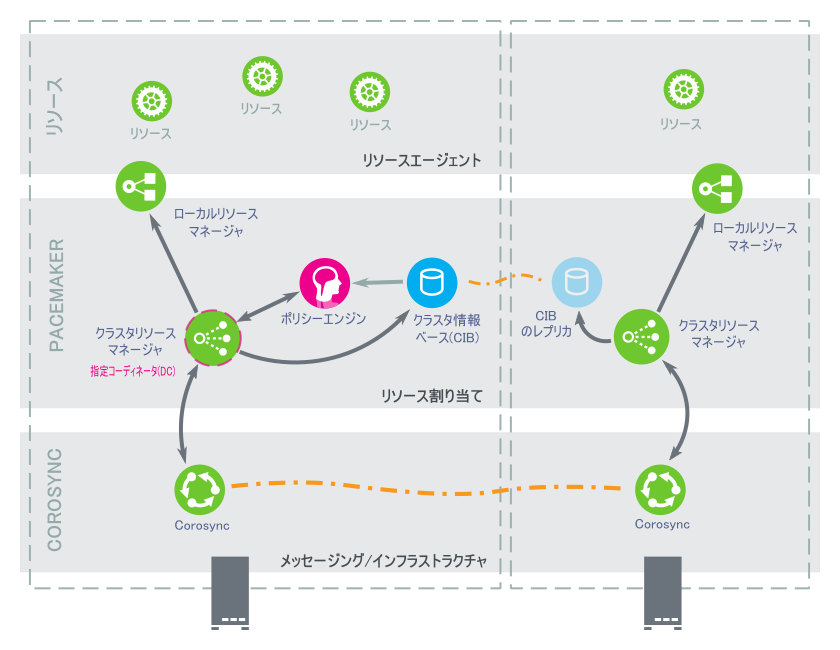

- 1.6 アーキテクチャ

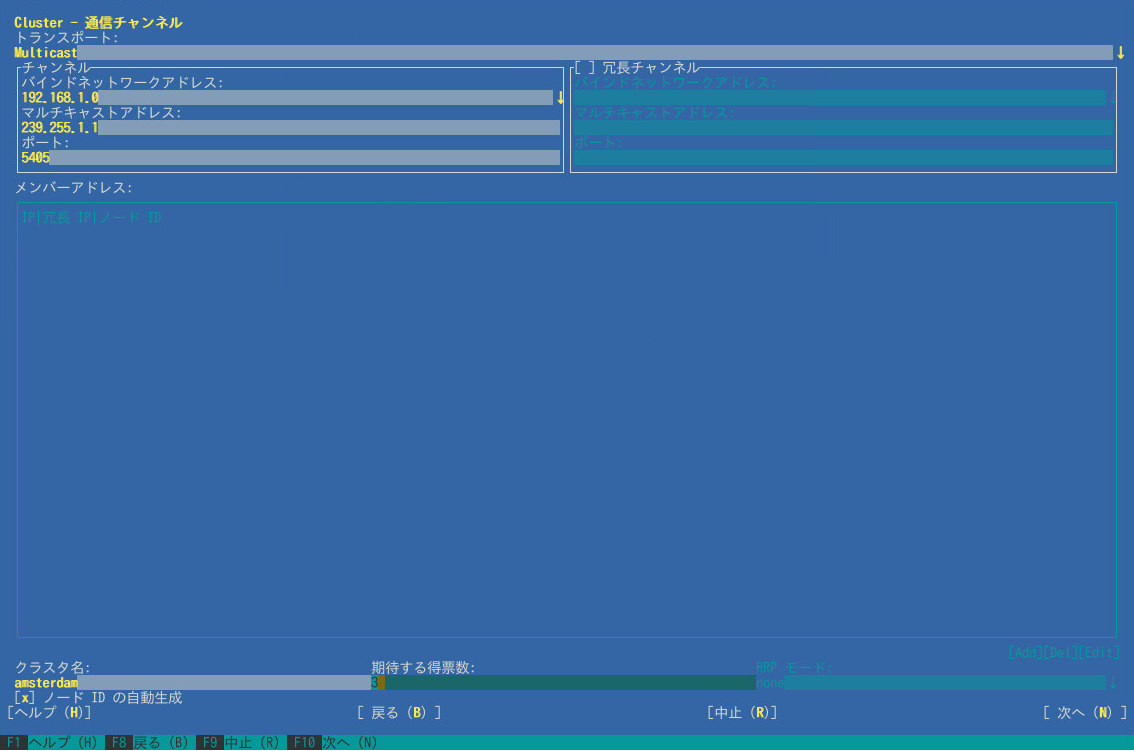

- 4.1 YaST - マルチキャスト設定

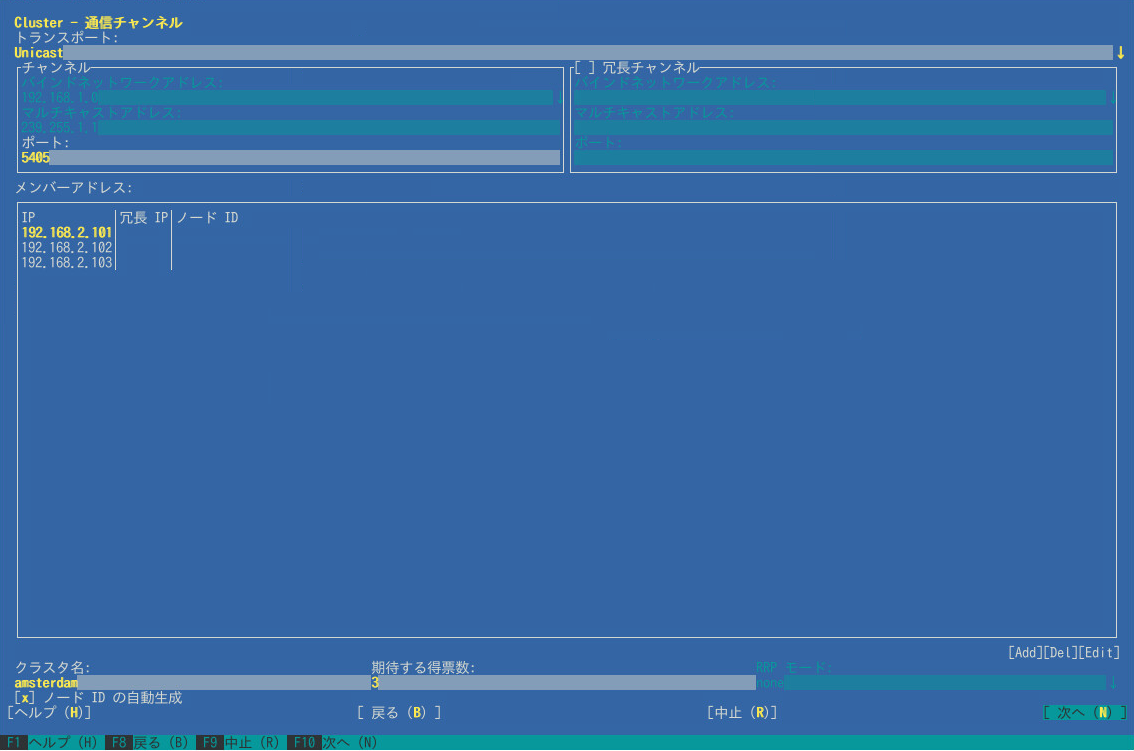

- 4.2 YaST - ユニキャスト設定

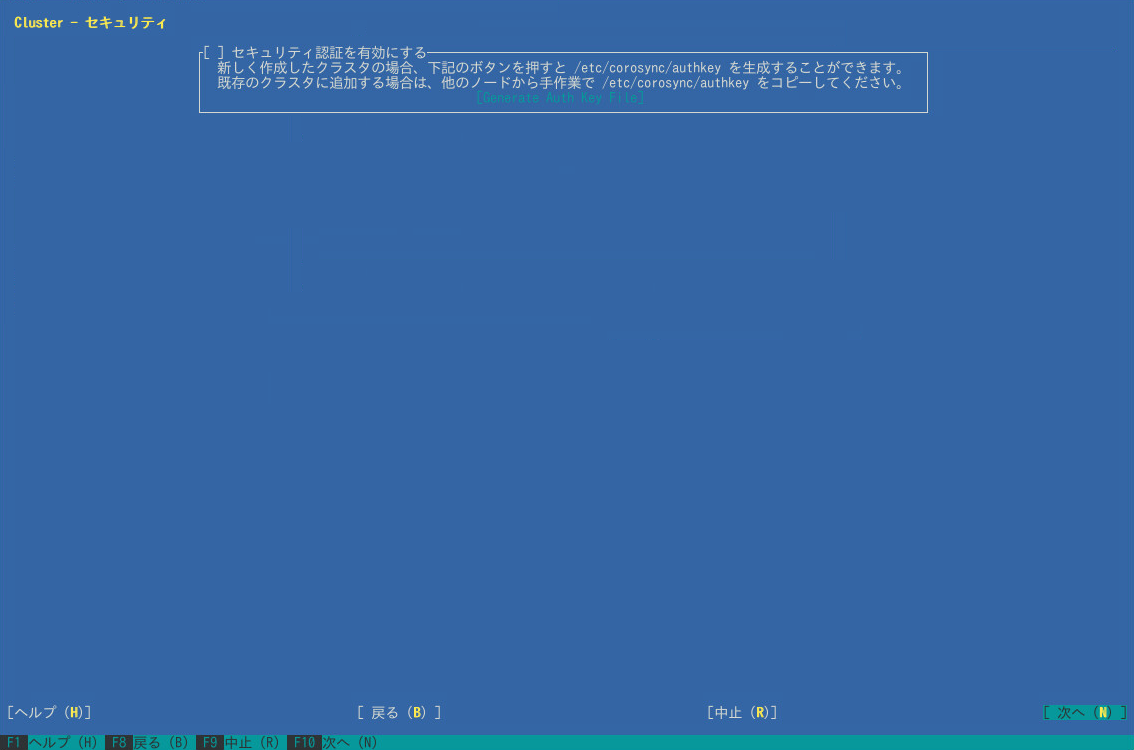

- 4.3 YaST - セキュリティ

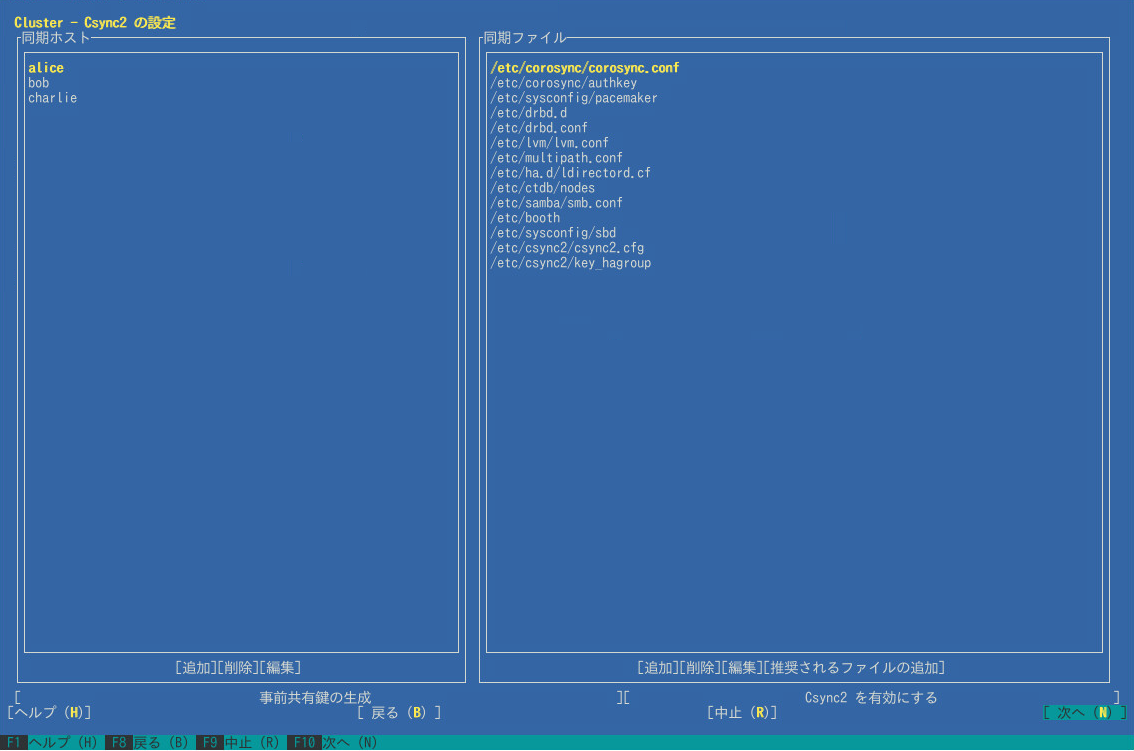

- 4.4 YaST - Csync2

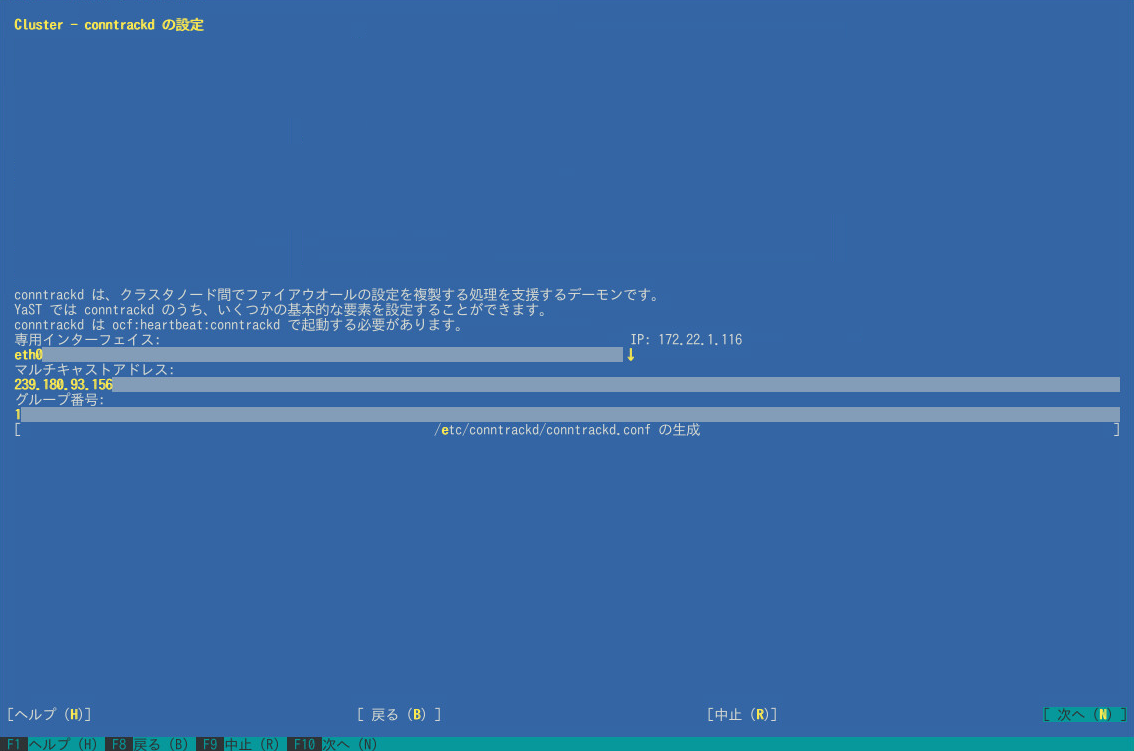

- 4.5 YaST -

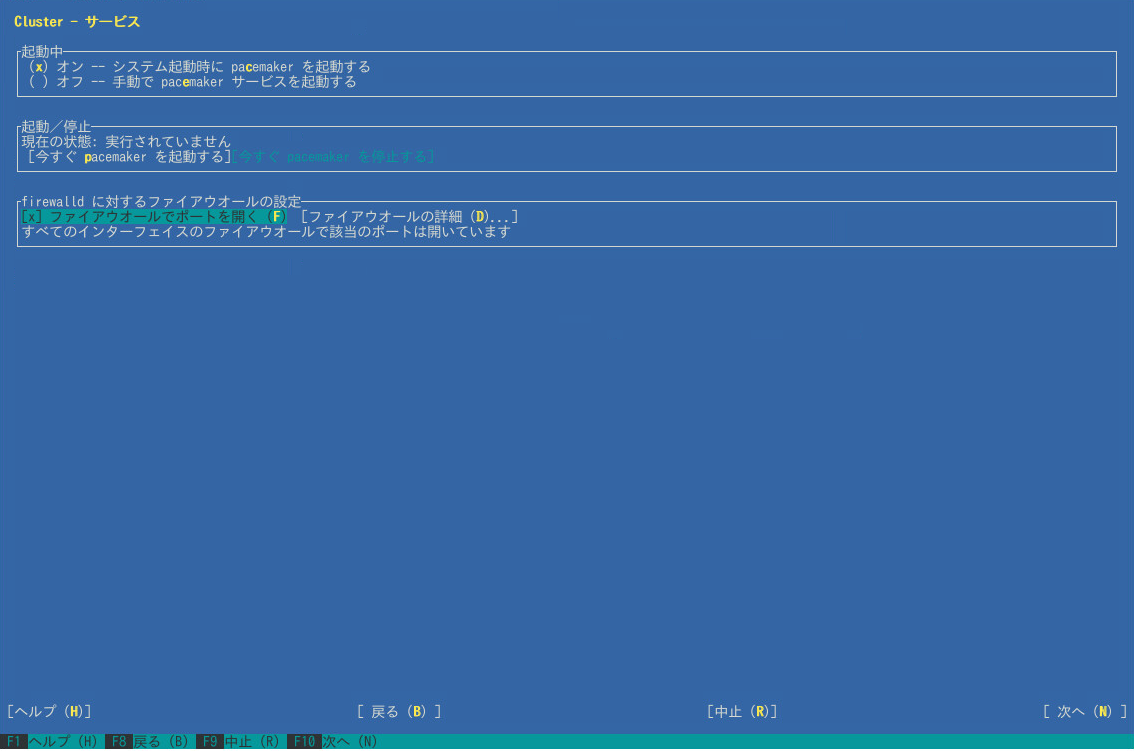

conntrackd - 4.6 YaST - サービス

- 6.1 グループリソース

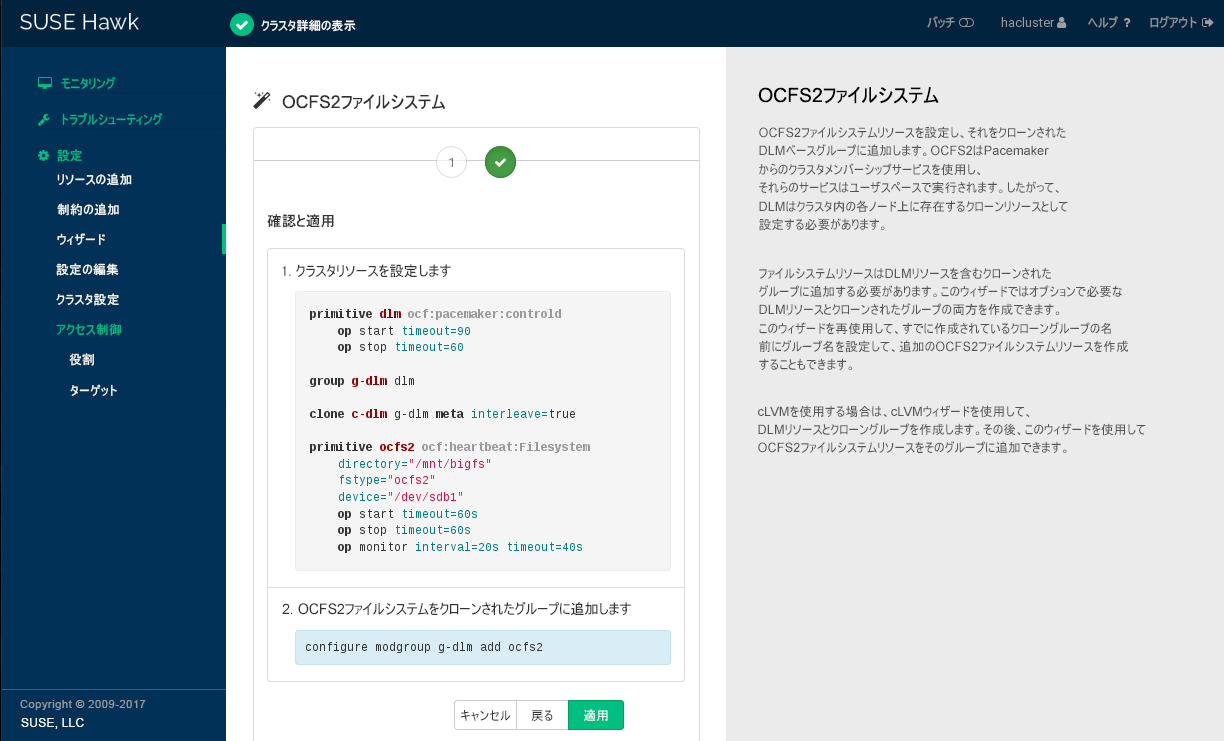

- 7.1 Hawk2 - クラスタの設定

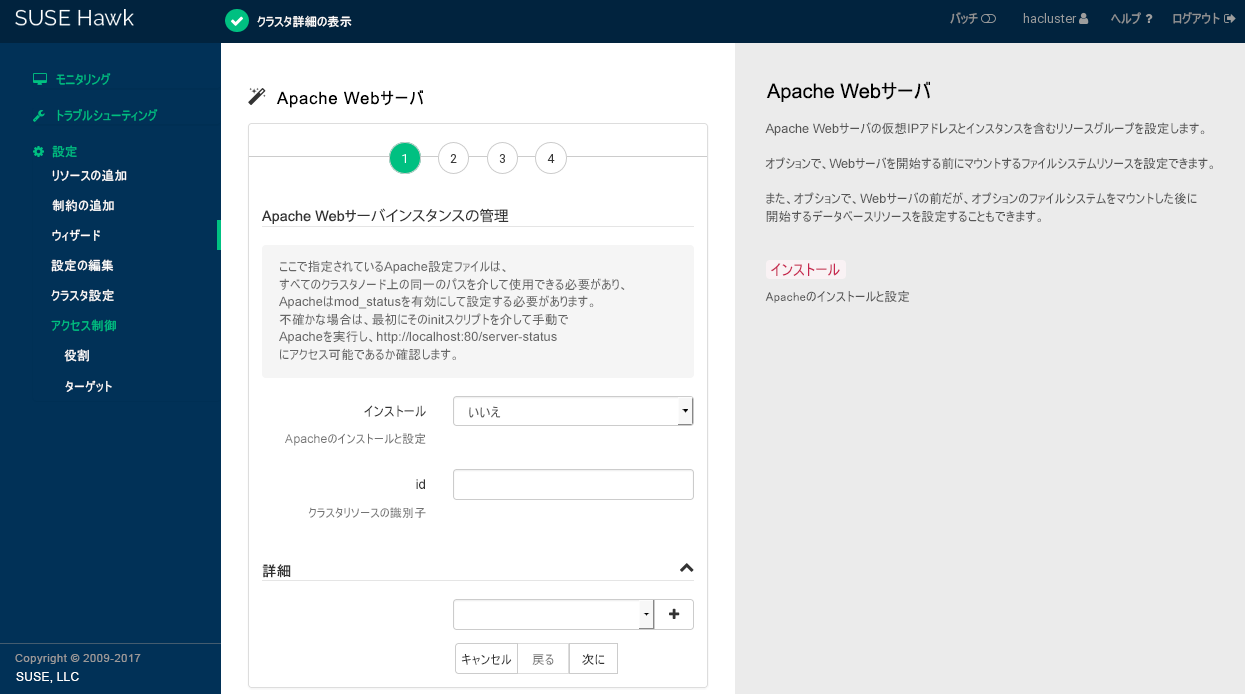

- 7.2 Hawk2 - Apache Webサーバ用のウィザード

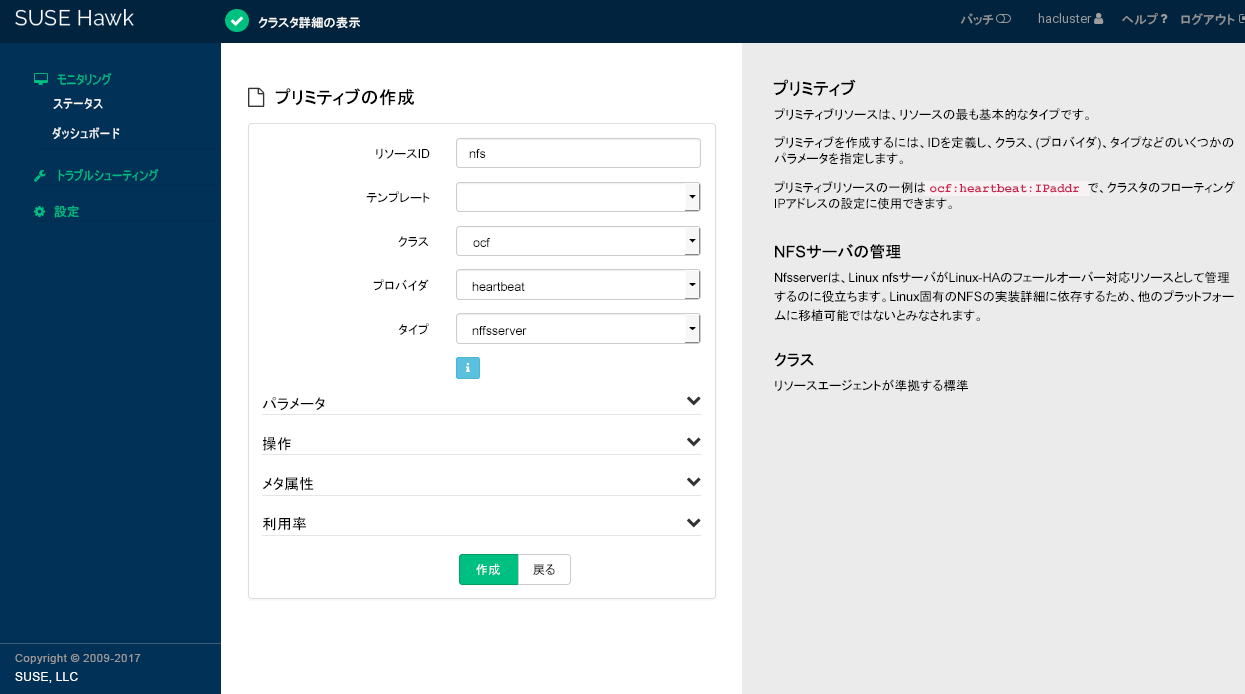

- 7.3 Hawk2 - プリミティブリソース

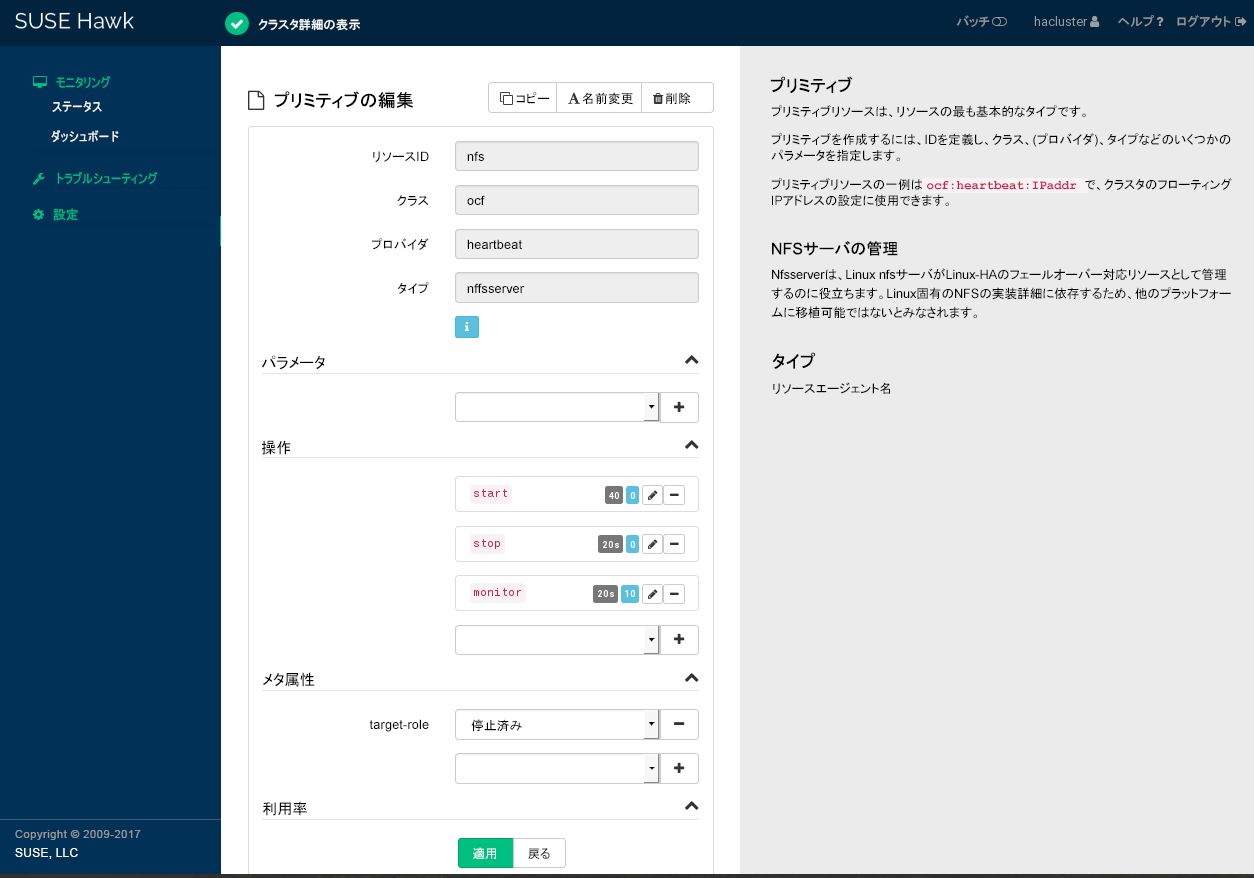

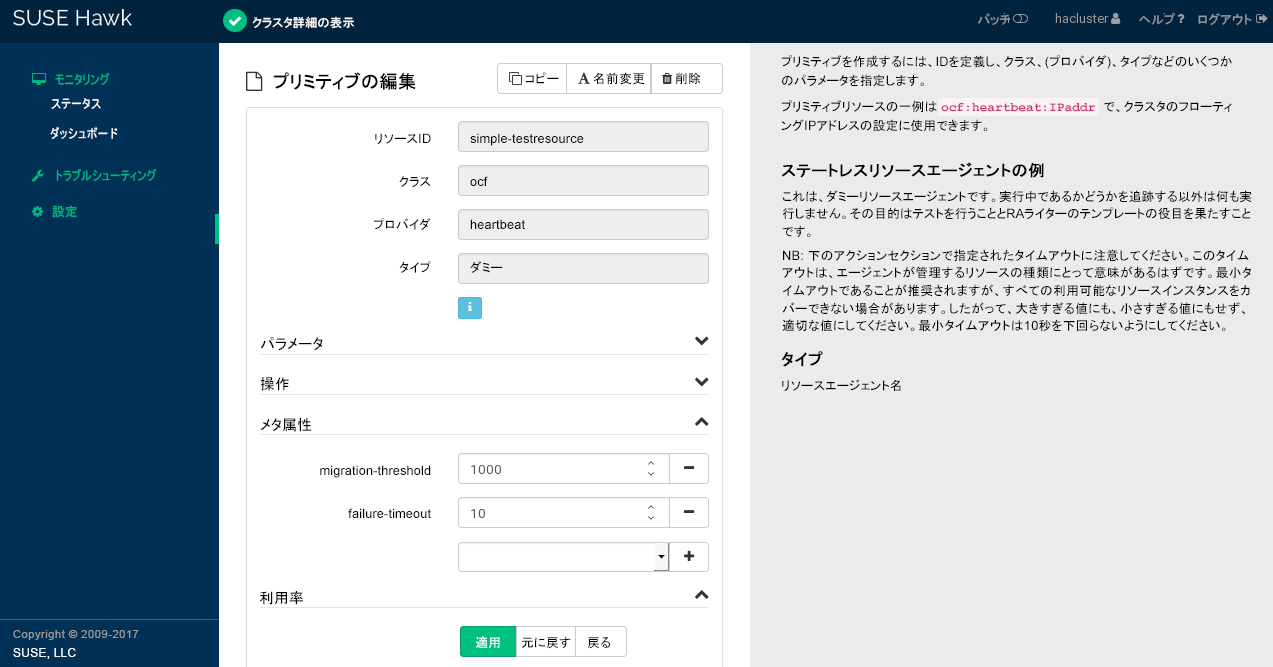

- 7.4 Hawk2 - プリミティブリソースの編集

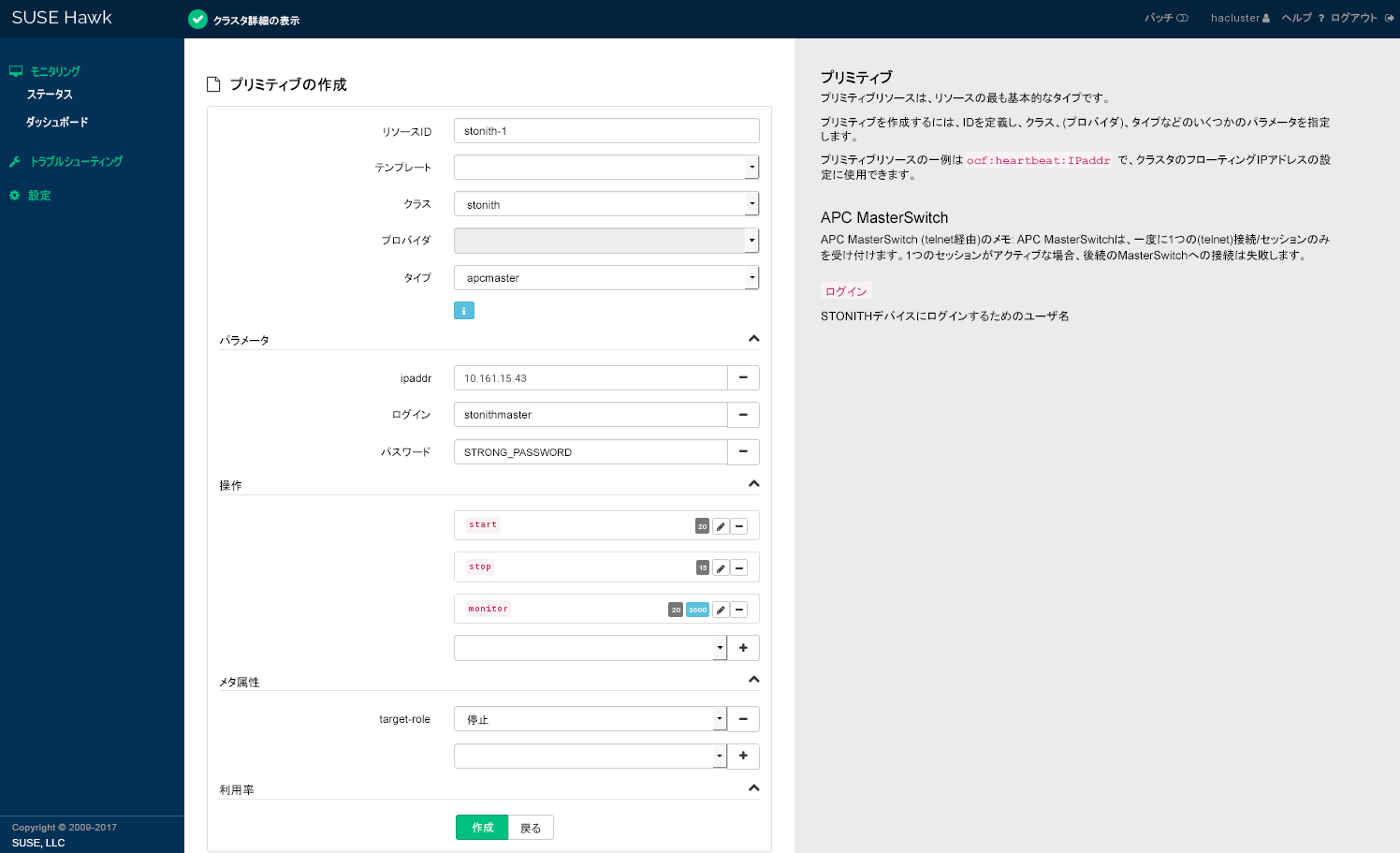

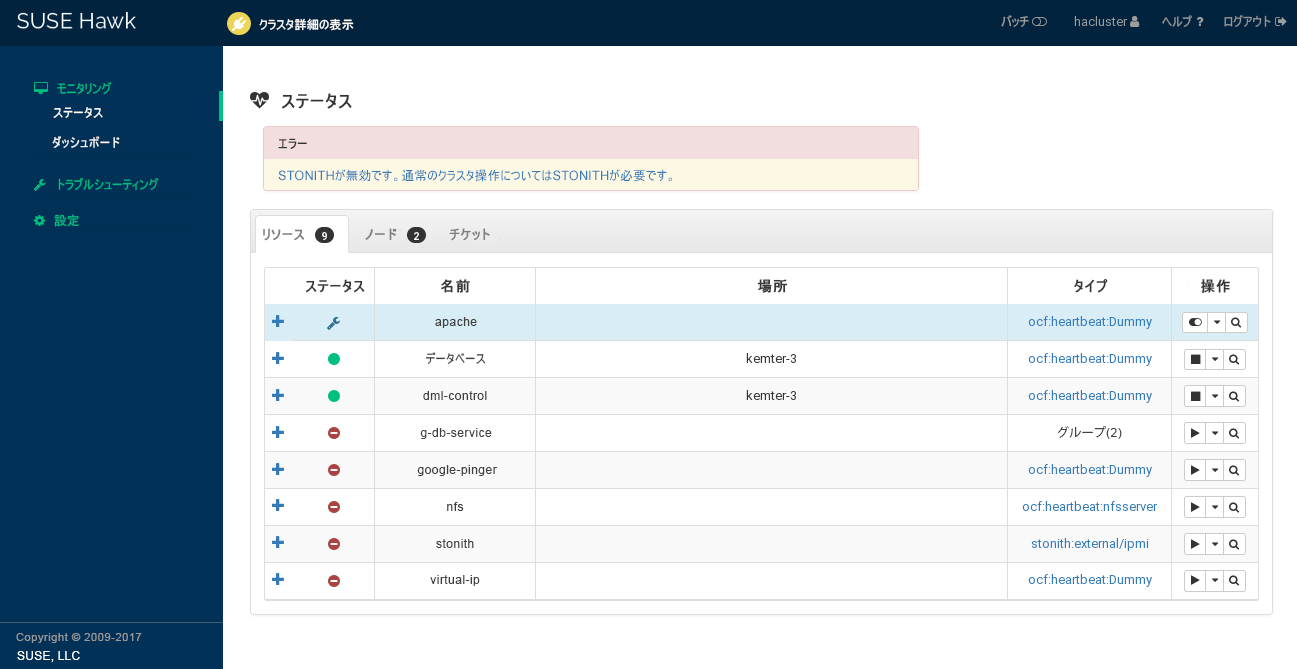

- 7.5 Hawk2 - STONITHリソース

- 7.6 Hawk2 - リソースグループ

- 7.7 Hawk2 - クローンリソース

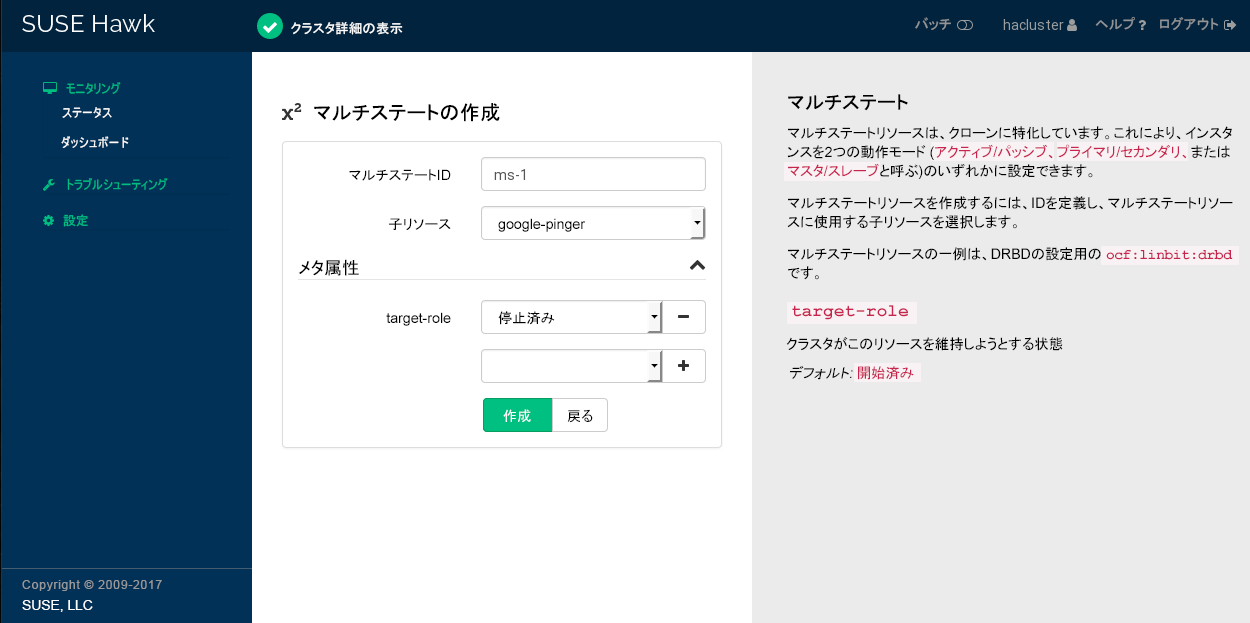

- 7.8 Hawk2 - マルチステートリソース

- 7.9 Hawk2 - タグ

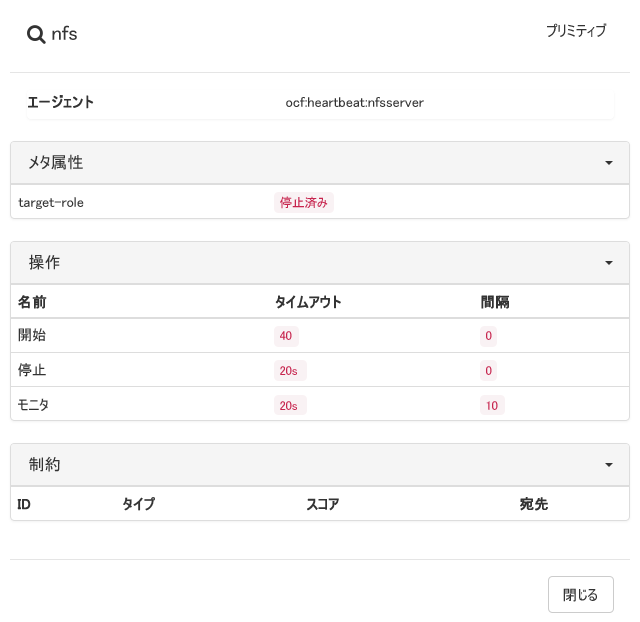

- 7.10 Hawk2 - リソース詳細

- 7.11 Hawk2 - 場所制約

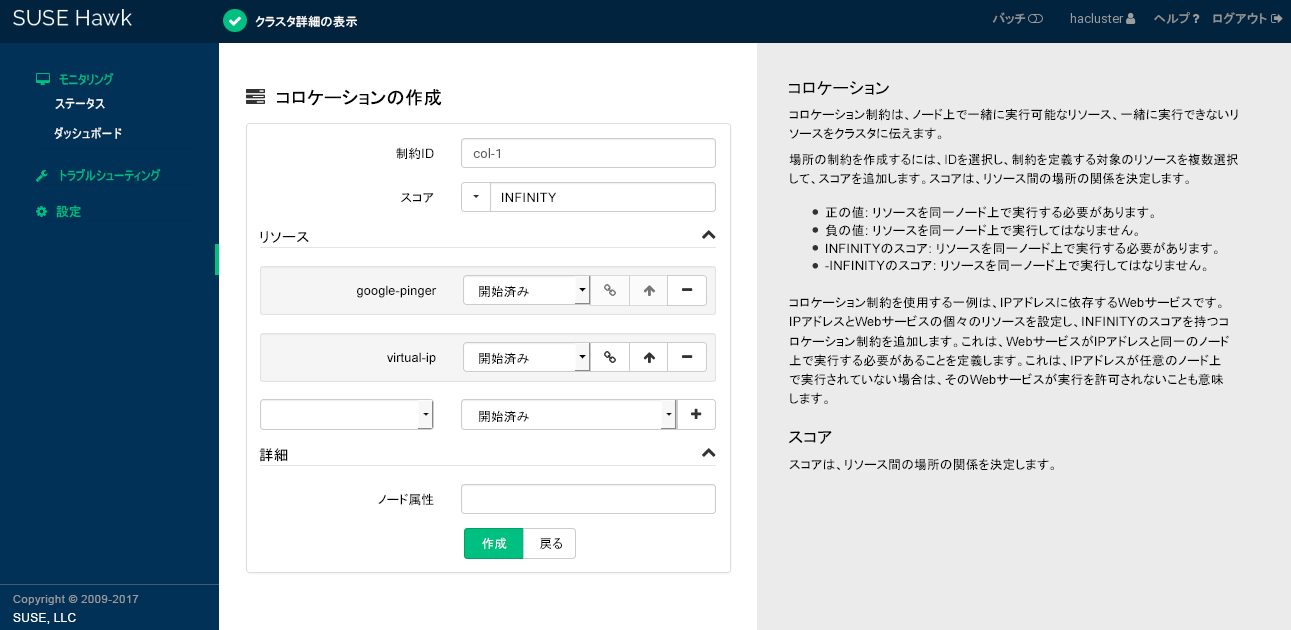

- 7.12 Hawk2 - コロケーション制約

- 7.13 Hawk2 - 順序制約

- 7.14 Hawk2 - コロケーション制約の2つのリソースセット

- 7.15 Hawk2 - クラスタの状態

- 7.16 最初のクラスタサイト1つのクラスタサイト(

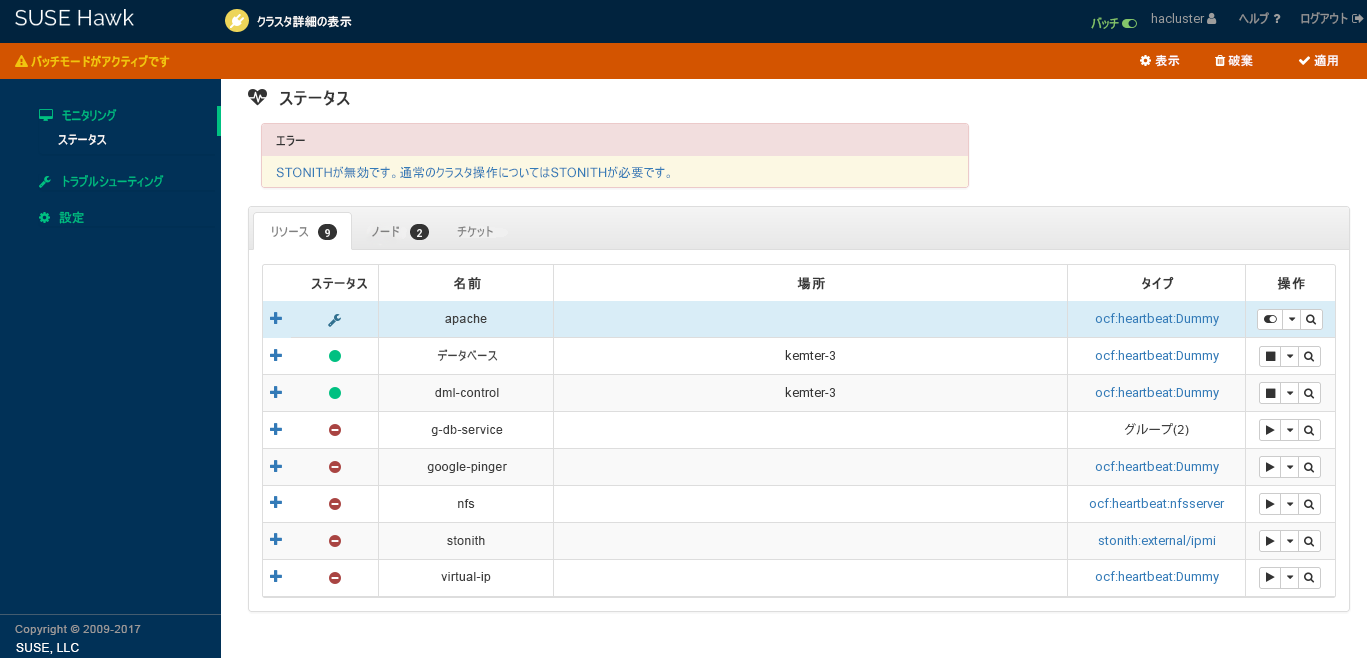

amsterdam)を表示するHawk2ダッシュボード - 7.17 Hawk2バッチモードが有効

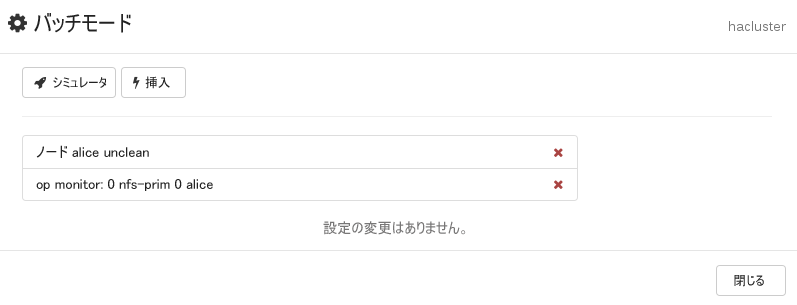

- 7.18 Hawk2のバッチモード - 注入されたイベントと設定の変更

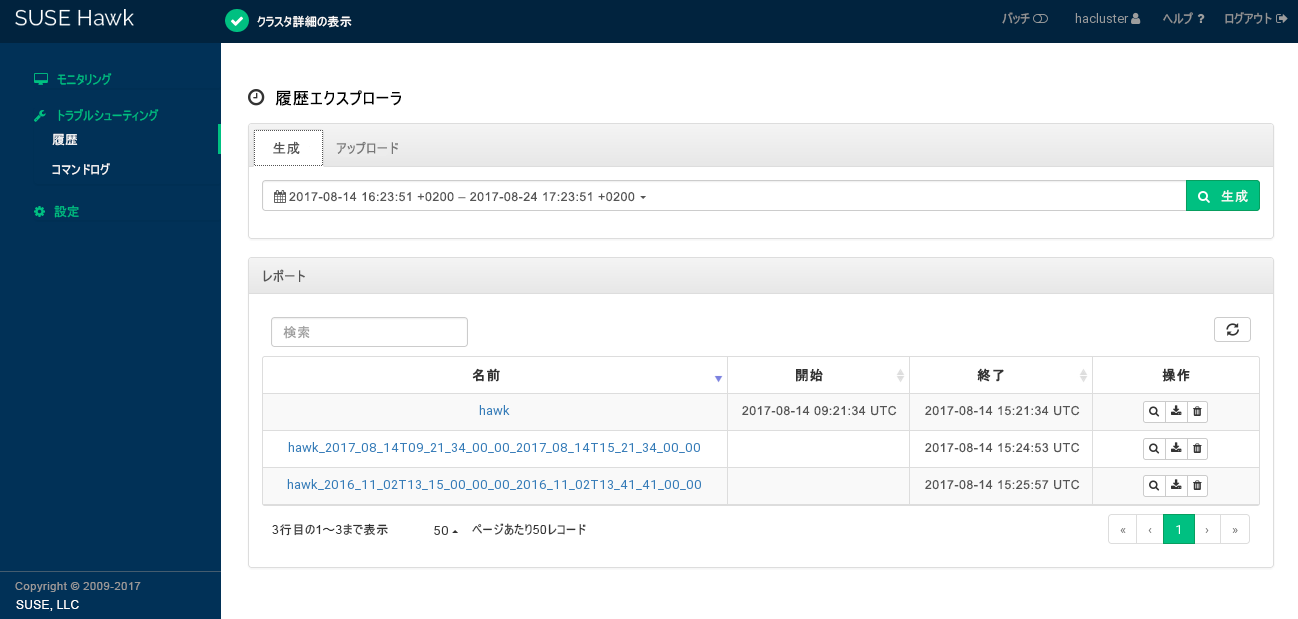

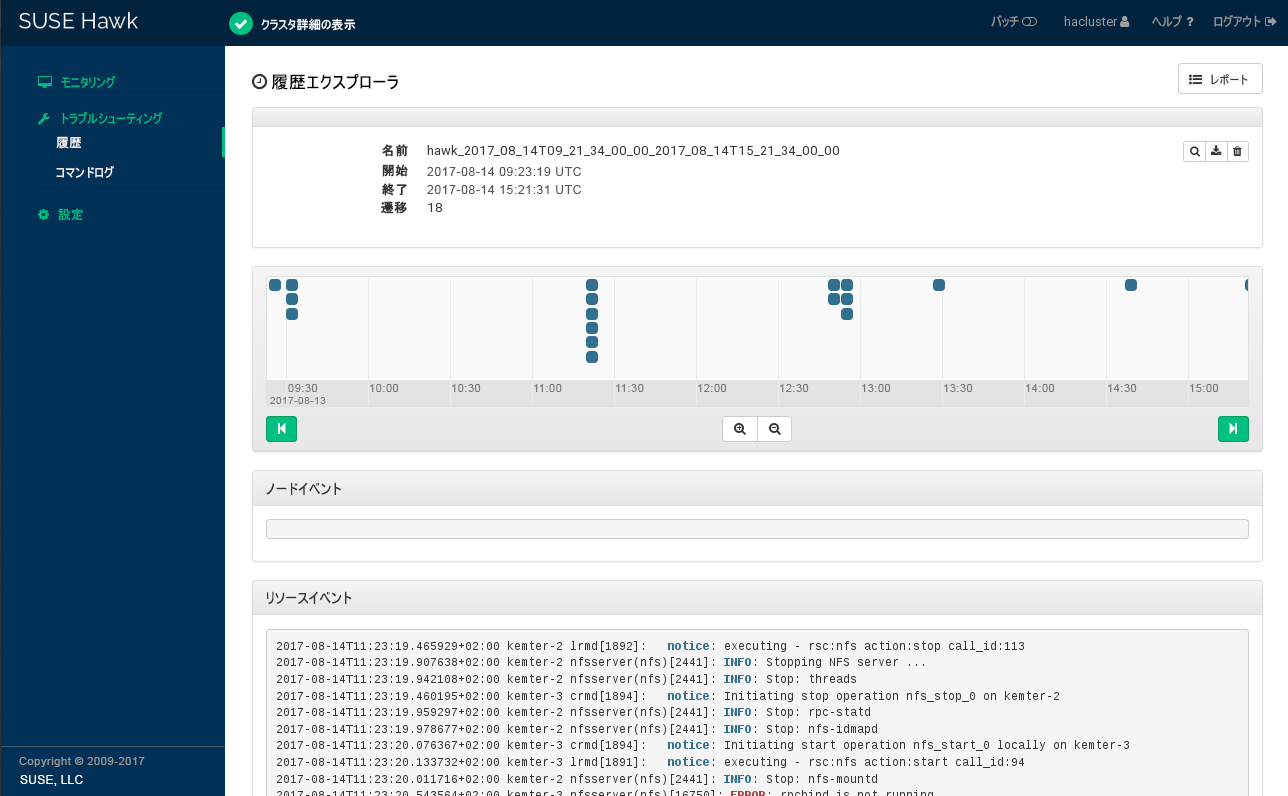

- 7.19 Hawk2 - 履歴エクスプローラーのメインビュー

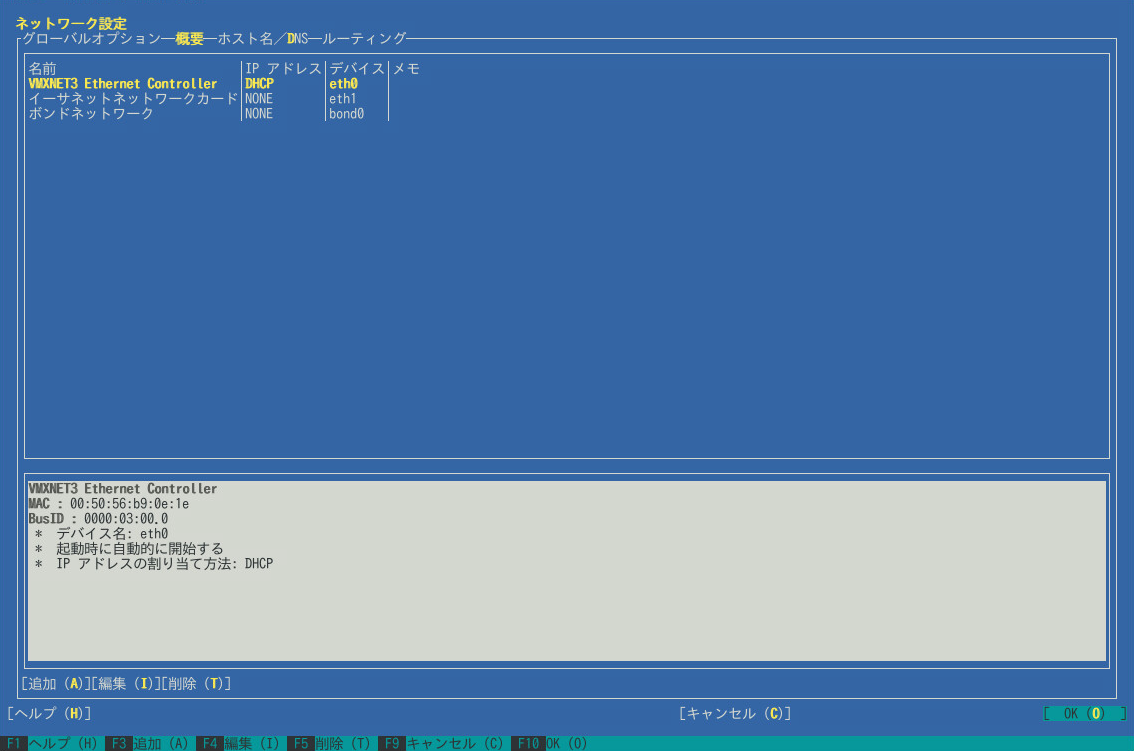

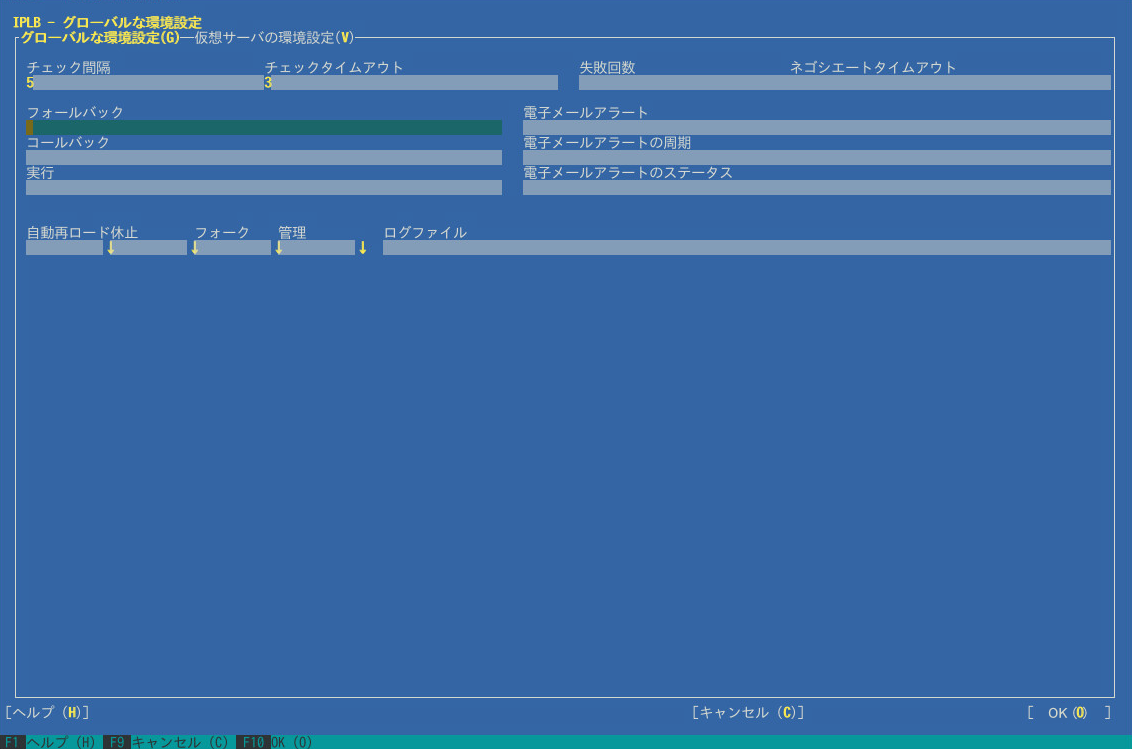

- 15.1 YaST IP負荷分散 - グローバルパラメータ

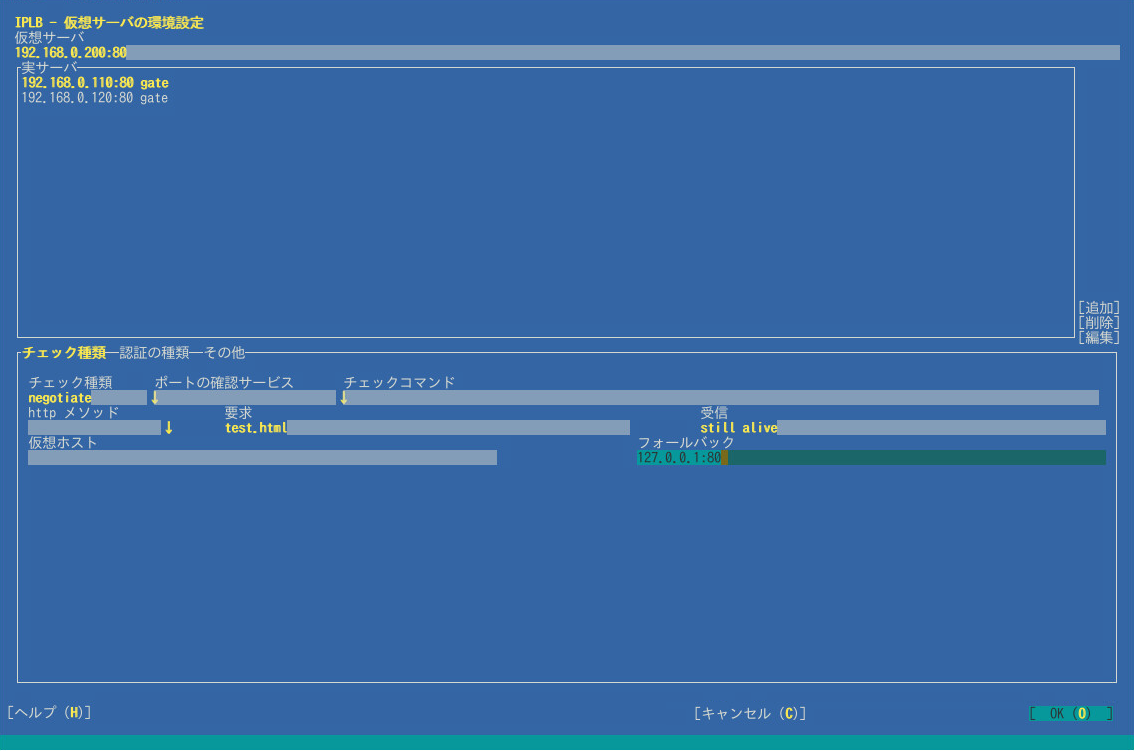

- 15.2 YaST IP負荷分散 - 仮想サービス

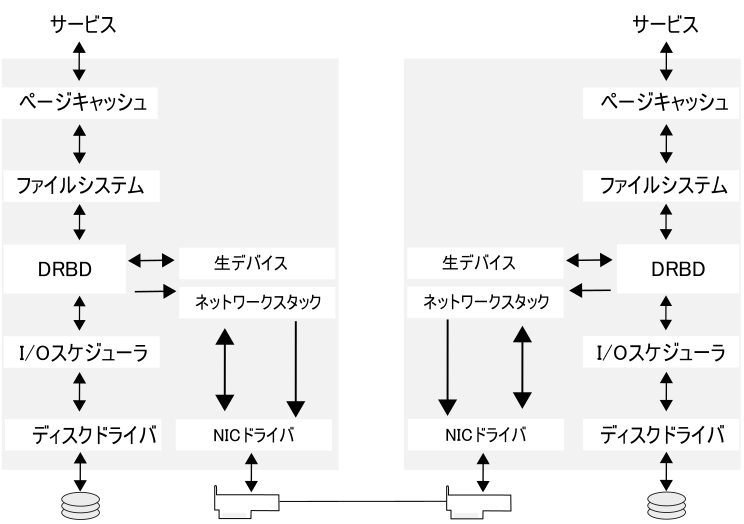

- 21.1 Linux内でのDRBDの位置

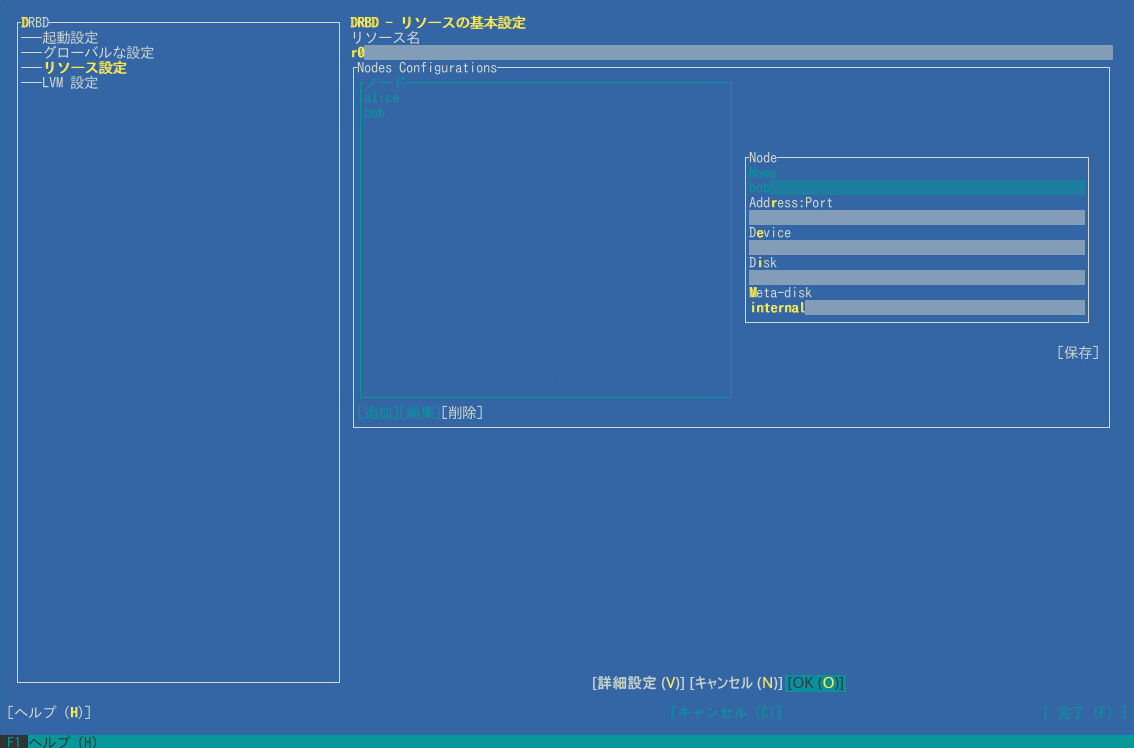

- 21.2 リソースの環境設定

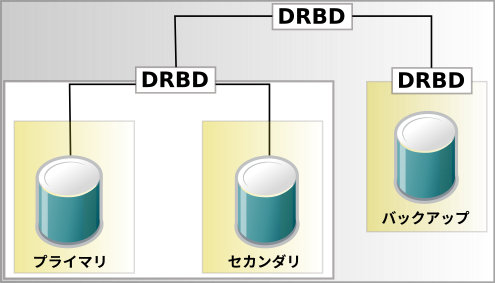

- 21.3 リソースのスタッキング

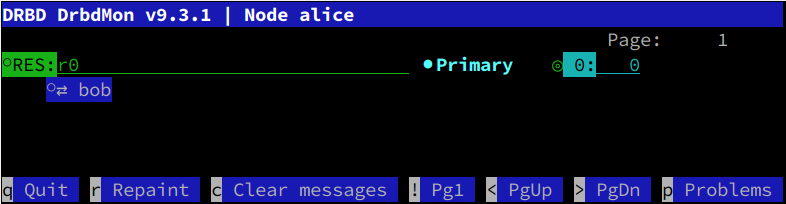

- 21.4

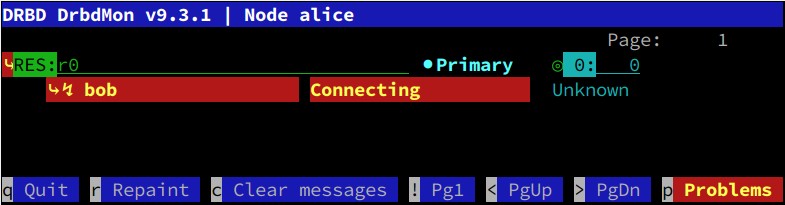

drbdmonが示す正常な接続 - 21.5

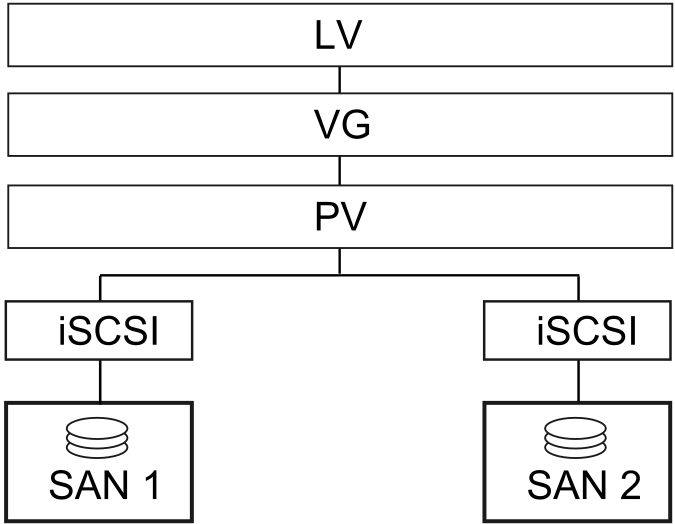

drbdmonが示す異常な接続 - 22.1 Cluster LVMを使用した共有ディスクのセットアップ

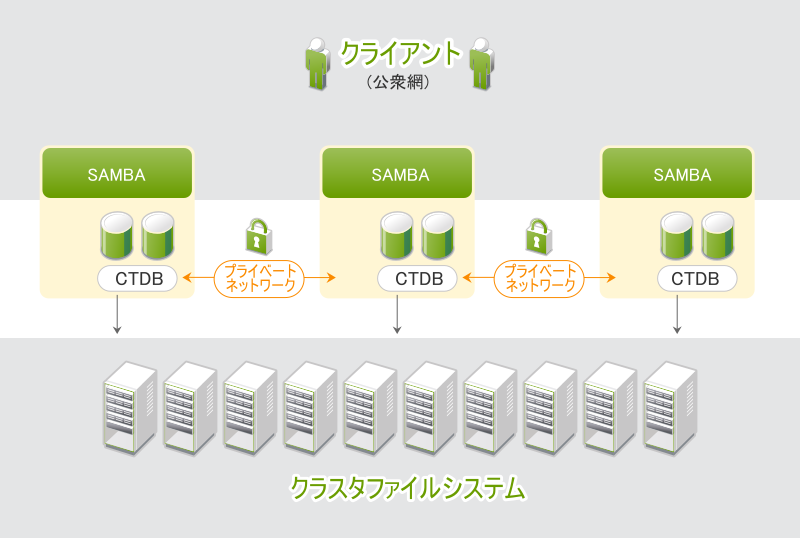

- 24.1 CTDBクラスタの構造

- 6.1 2ノードクラスタのCorosync設定の例

- 6.2 NノードクラスタのCorosync設定の例

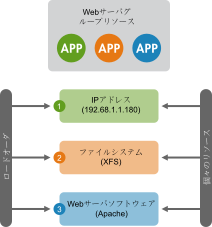

- 6.3 Webサーバのリソースグループ

- 6.4 場所制約のリソースセット

- 6.5 コロケートされたリソースのチェーン

- 6.6 順序付けされたリソースのチェーン

- 6.7 リソースセットとして表される順序付けされたリソースのチェーン

- 6.8 マイグレーションしきい値 - プロセスフロー

- 6.9 負荷分散型配置の設定例

- 6.10 監視プラグインのリソースの設定

- 8.1 単純なcrmshシェルスクリプト

- 10.1 IBM RSAライトアウトデバイスの設定

- 10.2 UPSフェンシングデバイスの設定

- 10.3 kdumpデバイスの設定

- 11.1 タイムアウト計算の式

- 12.1 QDeviceのステータス

- 12.2 QNetdサーバのステータス

- 13.1 XML内のクラスタ設定の例

- 15.1 単純なldirectord設定

- 21.1 3ノードのスタックされたDRBDリソースの設定

- 21.2 クラスタ情報ベース(CIB)を使用したリソースレベルのフェンシングを含むDRBDの設定

- 25.1 NFSサーバを使用したファイルバックアップの保存

- 25.2 サードパーティのバックアップツール(EMC NetWorkerなど)の使用

- A.1 停止されたリソース

Copyright © 2006–2025 SUSE LLC and contributors.All rights reserved.

この文書は、GNUフリー文書ライセンスのバージョン1.2または(オプションとして)バージョン1.3の条項に従って、複製、配布、および/または改変が許可されています。ただし、この著作権表示およびライセンスは変更せずに記載すること。ライセンスバージョン1.2のコピーは、「GNUフリー文書ライセンス」セクションに含まれています。

SUSEの商標については、http://www.suse.com/company/legal/を参照してください。その他の第三者のすべての商標は、各社の所有に帰属します。商標記号(®、 ™など)は、SUSEおよび関連会社の商標を示します。アスタリスク(*)は、第三者の商標を示します。

本書のすべての情報は、細心の注意を払って編集されています。しかし、このことは絶対に正確であることを保証するものではありません。SUSE LLC、その関係者、著者、翻訳者のいずれも誤りまたはその結果に対して一切責任を負いかねます。

序文 #

1 利用可能なマニュアル #

- オンラインマニュアル

本製品のオンラインマニュアルは、https://documentation.suse.com/#sle-haで入手できます。様々な形式のマニュアルをブラウズまたはダウンロードできます。

他の製品のオンラインマニュアルは、https://documentation.suse.com/で検索してください。

注記: 最新のアップデート最新のマニュアルアップデートは、通常、英語版マニュアルで入手できます。

- リリースノート

リリースノートはhttps://www.suse.com/releasenotes/を参照してください。

- ご使用のシステムで

オフラインで利用するには、システムの

/usr/share/docにインストールされたマニュアルを確認してください。「マニュアルページ」には、多くのコマンドについても詳しく説明されています。説明を表示するには、manコマンドに確認したいコマンドの名前を付加して実行してください。システムにmanコマンドがインストールされていない場合は、sudo zypper install manコマンドでインストールします。

2 ドキュメントの改善 #

このドキュメントに対するフィードバックや貢献を歓迎します! 次のチャネルがあります。

- サービス要求およびサポート

ご使用の製品に利用できるサービスとサポートのオプションについては、http://www.suse.com/support/を参照してください。

サービス要求を開くには、SUSE Customer Centerでの購読が必要です。https://scc.suse.com/support/requestsからログインしてをクリックしてください。

- バグレポート

https://bugzilla.suse.com/から入手できるドキュメントを使用して、問題を報告してください。このプロセスを簡略化するために、このドキュメントのHTMLバージョンの見出しの横にあるリンクを使用できます。リンクを使用すると、Bugzillaで適切な製品とカテゴリが事前に選択され、現在のセクションへのリンクが追加されます。バグレポートの入力を直ちに開始できます。Bugzillaアカウントが必要です。

- ドキュメントの編集に貢献

このドキュメントに貢献するには、このドキュメントのHTMLバージョンの見出しの横にあるリンクを使用してください。GitHubのソースコードに移動し、そこからプル要求を提出できます。GitHubアカウントが必要です。

このドキュメントに使用されるドキュメント環境に関する詳細については、リポジトリのREADMEを参照してください。

- メール

ドキュメントに関するエラーの報告やフィードバックは<doc-team@suse.com>宛に送信してください。ドキュメントのタイトル、製品のバージョン、およびドキュメントの発行日を明記してください。関連するセクション番号とタイトル(またはURLを含めて)、問題の簡潔な説明を記載してください。

3 マニュアルの表記規則 #

このマニュアルでは、次の通知と表記規則が使用されています。

tux >commandrootユーザを含む、任意のユーザが実行可能なコマンド。root #commandroot特権で実行する必要のあるコマンド。多くの場合、これらのコマンドの頭にsudoコマンドを置いて実行することもできます。crm(live)#対話型crmシェルで実行されるコマンド。詳細については、第8章 「クラスタリソースの設定と管理(コマンドライン)」を参照してください。

/etc/passwd:ディレクトリ名とファイル名PLACEHOLDER:PLACEHOLDERは、実際の値で置き換えられます

PATH:環境変数PATHls、--help:コマンド、オプション、およびパラメータuser:ユーザまたはグループpackagename:パッケージの名前

Alt, Alt–F1 :使用するキーまたはキーの組み合わせ、キーはキーボード上と同様、大文字で表示される

、 › : メニュー項目、ボタン

amd64, em64t, ipf この説明は、

amd64、em64t、およびipfの各アーキテクチャにのみ当てはまります。矢印は、テキストブロックの先頭と終わりを示します。Dancing Penguins (「Penguins」の章、↑他のマニュアル):他のマニュアルの章への参照です。

通知

警告続行する前に知っておくべき、無視できない情報。セキュリティ上の問題、データ損失の可能性、ハードウェアの損傷、または物理的な危険について警告します。

重要続行する前に知っておくべき重要な情報です。

注記追加情報。たとえば、ソフトウェアバージョンの違いに関する情報です。

ヒントガイドラインや実際的なアドバイスなどの役に立つ情報です。

クラスタノードと名前、リソース、およびに制約に関する命名規則の概要については、付録B 命名規則を参照してください。

4 サポート #

SUSE Linux Enterprise High Availability Extensionのサポートステートメントと、技術プレビューに関する概要を以下に示します。製品ライフサイクルの詳細については、SUSE Linux Enterprise Server 15 SP3の『アップグレードガイド』を参照してください。

サポートを受ける資格がある場合は、SUSE Linux Enterprise Server 15 SP3の『管理ガイド』でサポートチケットの情報を収集する方法の詳細を確認してください。

4.1 SUSE Linux Enterprise High Availability Extensionのサポートステートメント #

サポートを受けるには、サービス内容に応じたサブスクリプションをSUSEから購入する必要があります。利用可能なサポートサービスを具体的に確認するには、https://www.suse.com/support/にアクセスして製品を選択してください。

サポートレベルは次のように定義されます。

- L1

問題の判別。互換性情報、使用サポート、継続的な保守、情報収集、および利用可能なドキュメントを使用した基本的なトラブルシューティングを提供するように設計されたテクニカルサポートを意味します。

- L2

問題の切り分け。データの分析、お客様の問題の再現、問題領域の特定、レベル1で解決できない問題の解決、またはレベル3の準備を行うように設計されたテクニカルサポートを意味します。

- L3

問題解決。技術者の関与の下で問題を解決するように設計されたテクニカルサポートを意味し、レベル2サポートで特定された製品の不具合を解決します。

契約されているお客様およびパートナーの場合、SUSE Linux Enterprise High Availability Extensionでは、次のものを除くすべてのパッケージに対してL3サポートを提供します。

技術プレビュー.

サウンド、グラフィック、フォント、およびアートワーク。

追加の顧客契約が必要なパッケージ.

パッケージの中には、「Workstation Extension」モジュールの一部として出荷されるものがあります。これについてはL2サポートまでしか提供されません。

名前が -devel で終わるパッケージ(ヘッダファイルなどの開発用リソースが含まれるパッケージ)のサポートを受けるには、そのメインパッケージが必要です。

SUSEは、オリジナルのパッケージだけをサポートします。すなわち、変更や再コンパイルを行ったパッケージはサポート対象外です。

4.2 技術プレビュー #

技術プレビューとは、今後のイノベーションを垣間見ていただくための、SUSEによって提供されるパッケージ、スタック、または機能を意味します。プレビューは、使用中の環境内で新しいテクノロジーをテストする際の利便性のために用意されています。私たちはフィードバックを歓迎しています。技術プレビューをテストする場合は、SUSEの担当者に連絡して、経験や使用例をお知らせください。お客様からの情報を、今後の開発に役立てさせていただきます。

ただし、技術プレビューには、次の制限事項があります。

技術プレビューはまだ開発中です。したがって、機能が不完全であったり、不安定であったり、何らかの理由で運用環境での使用には適していなかったりする場合があります。

技術プレビューにはサポートが提供されません。

技術プレビューは、特定のハードウェアアーキテクチャでしか利用できないことがあります。

技術プレビューの詳細および機能は、変更される場合があります。そのため、今後リリースされる技術プレビューへのアップグレードができない場合や、再インストールが必要となる場合があります。

技術プレビューは、任意の時点で終了する可能性があります。たとえば、SUSEでプレビューがお客様または市場のニーズを満たしていない、またはエンタープライズ基準に準拠していないことが判明した場合などです。SUSEでは、このようなテクノロジーのサポートされるバージョンを将来的に提供できない場合があります。

ご使用の製品に付属している技術プレビューの概要については、https://www.suse.com/releasenotes/にあるリリースノートを参照してください。

パート I インストール、セットアップ、およびアップグレード #

- 1 製品の概要

SUSE® Linux Enterprise High Availability Extensionは、オープンソースクラスタリング技術の統合スイートです。これにより、高可用性の物理および仮想Linuxクラスタを実装し、シングルポイント障害を排除することができます。データ、アプリケーション、サービスなどの重要なネットワークリソースの高度な可用性と管理のしやすさを実現します。その結果、ミッションクリティカルなLinuxワークロードに対してビジネスの継続性維持、データ整合性の保護、予期せぬダウンタイムの削減を行います。

基本的な監視、メッセージング、およびクラスタリソース管理の機能を標準装備し、個々の管理対象クラスタリソースのフェールオーバー、フェールバック、およびマイグレーション(負荷分散)をサポートします。

この章では、High Availability Extensionの主な製品機能と利点を紹介します。ここには、いくつかのクラスタ例が記載されており、クラスタを設定するコンポーネントについて学ぶことができます。最後のセクションでは、アーキテクチャの概要を示し、クラスタ内の個々のアーキテクチャ層とプロセスについて説明します。

High Availabilityクラスタのコンテキストでよく使用される用語については、用語集を参照してください。

- 2 システム要件と推奨事項

次のセクションでは、SUSE® Linux Enterprise High Availability Extensionのシステム要件と前提条件について説明します。また、クラスタセットアップの推奨事項についても説明します。

- 3 High Availability Extensionのインストール

初めてSUSE® Linux Enterprise High Availability Extensionを使用してHigh Availabilityクラスタを設定する場合、最も簡単な方法は、基本的な2ノードクラスタで開始することです。2ノードクラスタを使用して、一部のテストを実行することもできます。後で、AutoYaSTを使用して既存のクラスタノードのクローンを作成することにより、さらにノードを追加できます。クローンを作成したノードには、元のノードと同じパッケージがインストールされ、クローンノードは同じシステム設定を持つことになります。

前のバージョンのSUSE Linux Enterprise High Availability Extensionを実行する既存のクラスタをアップグレードする場合は、第5章 「クラスタアップグレードとソフトウェアパッケージの更新」を参照してください。

- 4 YaSTクラスタモジュールの使用

YaSTクラスタモジュールでは、クラスタを手動で(最初から)設定するか、既存のクラスタのオプションを変更することができます。

ただし、クラスタの設定に自動化された方法を選ぶ場合は、Article “インストールおよびセットアップクイックスタート”を参照してください。このマニュアルでは、必要なパッケージのインストール方法と、

ha-cluster-bootstrapスクリプトを使用して基本的な2ノードクラスタを設定する手順を説明しています。たとえば、1つのノードをYaSTクラスタで設定してから、ブートストラップスクリプトの1つを使用して他のノードを統合させる(またはその逆も可能)など、両方のセットアップ方法を組み合わせることもできます。

- 5 クラスタアップグレードとソフトウェアパッケージの更新

この章では、次の2つの異なるシナリオ(SUSE Linux Enterprise High Availability Extensionの別バージョン(メジャーリリースまたはサービスパック)へのクラスタアップグレード、およびクラスタノード上の各パッケージの更新)について説明します。5.2項 「最新の製品バージョンへのクラスタアップグレード」および5.3項 「クラスタノード上のソフトウェアパッケージの更新」を参照してください。

クラスタをアップグレードする場合、アップグレードを開始する前に、5.2.1項 「SLE HAおよびSLE HA Geoでサポートされるアップグレードパス」および5.2.2項 「アップグレード前に必要な準備」を確認してください。

1 製品の概要 #

SUSE® Linux Enterprise High Availability Extensionは、オープンソースクラスタリング技術の統合スイートです。これにより、高可用性の物理および仮想Linuxクラスタを実装し、シングルポイント障害を排除することができます。データ、アプリケーション、サービスなどの重要なネットワークリソースの高度な可用性と管理のしやすさを実現します。その結果、ミッションクリティカルなLinuxワークロードに対してビジネスの継続性維持、データ整合性の保護、予期せぬダウンタイムの削減を行います。

基本的な監視、メッセージング、およびクラスタリソース管理の機能を標準装備し、個々の管理対象クラスタリソースのフェールオーバー、フェールバック、およびマイグレーション(負荷分散)をサポートします。

この章では、High Availability Extensionの主な製品機能と利点を紹介します。ここには、いくつかのクラスタ例が記載されており、クラスタを設定するコンポーネントについて学ぶことができます。最後のセクションでは、アーキテクチャの概要を示し、クラスタ内の個々のアーキテクチャ層とプロセスについて説明します。

High Availabilityクラスタのコンテキストでよく使用される用語については、用語集を参照してください。

1.1 拡張としての提供 #

High Availability Extensionは、SUSE Linux Enterprise Server 15 SP3の拡張として入手できます。Geo Clustering for SUSE Linux Enterprise High Availability Extensionを使用することで、無制限の距離にまたがってHigh Availabilityクラスタを使用できるようになります。

1.2 主な特長 #

SUSE® Linux Enterprise High Availability Extensionでは、ネットワークリソースの可用性を確保し、管理することができます。以降のセクションでは、いくつかの主要機能に焦点を合わせて説明します。

1.2.1 広範なクラスタリングシナリオ #

High Availability Extensionは次のシナリオをサポートしています。

アクティブ/アクティブ設定

アクティブ/パッシブ設定: N+1、N+M、Nから1、NからM

ハイブリッド物理仮想クラスタ。仮想サーバを物理サーバとともにクラスタ化できます。これによって、サービスの可用性とリソースの使用状況が向上します。

ローカルクラスタ

メトロクラスタ(「ストレッチされた」ローカルクラスタ)

Geoクラスタ(地理的に離れたクラスタ)

クラスタには、最大32のLinuxサーバを含めることができます。pacemaker_remoteを使用すると、この制限を超えて追加のLinuxサーバを含めるようにクラスタを拡張できます。クラスタ内のどのサーバも、クラスタ内の障害が発生したサーバのリソース(アプリケーション、サービス、IPアドレス、およびファイルシステム)を再起動することができます。

1.2.2 柔軟性 #

High Availability Extensionには、Corosyncメッセージングおよびメンバーシップ層のほか、Pacemakerクラスタリソースマネージャが標準装備されています。管理者は、Pacemakerを使用して、リソースのヘルスと状態を継続的に監視し、依存関係を管理することができます。高度に設定可能なルールとポリシーに基づいて、サービスを自動的に停止および開始することができます。High Availability Extensionでは、ユーザの組織に適した特定のアプリケーションおよびハードウェアインフラストラクチャに合わせて、クラスタのカスタマイズが可能です。時間依存設定を使用して、サービスを特定の時刻に修復済みのノードに自動的にフェールバック(マイグレート)させることができます。

1.2.3 ストレージとデータレプリケーション #

High Availability Extensionでは必要に応じてサーバストレージを自動的に割り当て、再割り当てすることができます。ファイバチャネルまたはiSCSIストレージエリアネットワーク(SAN)をサポートしています。共有ディスクもサポートされていますが、必要要件ではありません。SUSE Linux Enterprise High Availability Extensionには、クラスタ対応のファイルシステム(OCFS2)とCluster Logical Volume Manager (Cluster LVM2)も含まれています。データをレプリケーションする場合は、DRBD*を使用して、High Availabilityサービスのデータをクラスタのアクティブノードからスタンバイノードへミラーリングします。さらに、SUSE Linux Enterprise High Availability Extensionでは、Sambaクラスタリング技術であるCTDB (Cluster Trivial Database)もサポートしています。

1.2.4 仮想化環境のサポート #

SUSE Linux Enterprise High Availability Extensionは、物理Linuxサーバと仮想Linuxサーバの混合クラスタリングをサポートしています。SUSE Linux Enterprise Server 15 SP3には、オープンソースの仮想化ハイパーバイザであるXenと、KVM (カーネルベースの仮想マシン)が付属しています。KVMは、ハードウェア仮想化の拡張機能に基づいた、Linux用の仮想化ソフトウェアです。High Availability Extension内のクラスタリソースマネージャは、仮想サーバで実行中のサービスと物理サーバで実行中のサービスを認識、監視、および管理できます。ゲストシステムは、クラスタにサービスとして管理されます。

1.2.5 ローカル、メトロ、およびGeoクラスタのサポート #

SUSE Linux Enterprise High Availability Extensionは、様々な地理的なシナリオをサポートするように拡張されています。SUSE Linux Enterprise High Availability Extension用のGeo Clusteringでは、地理的に分散したクラスタ(Geoクラスタ)のサポートが利用可能です。

- ローカルクラスタ

1つのロケーション内の単一のクラスタ(たとえば、すべてのノードが1つのデータセンターにある)。クラスタはノード間の通信にマルチキャストまたはユニキャストを使用し、フェールオーバーを内部で管理します。ネットワークの遅延時間は無視できます。ストレージは通常、すべてのノードに同時にアクセスされます。

- メトロクラスタ

すべてのサイトがファイバチャネルで接続された、複数の建物またはデータセンターにわたってストレッチできる単一のクラスタ。クラスタはノード間の通信にマルチキャストまたはユニキャストを使用し、フェールオーバーを内部で管理します。ネットワークの遅延時間は通常は短くなります(約20マイルの距離で5ms未満)。ネットワークのレイテンシは通常は短くなります(約20マイルの距離で<5ms)。ストレージは頻繁にレプリケートされます(ミラーリングまたは同期レプリケーション)

- Geoクラスタ(マルチサイトクラスタ)

それぞれにローカルクラスタを持つ、複数の地理的に離れたサイト。サイトはIPによって交信します。サイト全体のフェールオーバーはより高いレベルのエンティティによって調整されます。Geoクラスタは限られたネットワーク帯域幅および高レイテンシに対応する必要があります。ストレージは同期的にレプリケートされます。

個々のクラスタノード間の地理的距離が大きいほど、クラスタが提供するサービスの高可用性を妨げる可能性のある要因が多くなります。ネットワークの遅延時間、限られた帯域幅およびストレージへのアクセス が長距離クラスタの課題として残ります。

1.2.6 リソースエージェント #

SUSE Linux Enterprise High Availability Extensionには、Apache、IPv4、IPv6、その他多数のリソースを管理するための膨大な数のリソースエージェントが含まれています。またIBM WebSphere Application Serverなどの一般的なサードパーティアプリケーション用のリソースエージェントも含まれています。ご利用の製品に含まれているOpen Cluster Framework (OCF)リソースエージェントの概要は、8.1.3項 「OCFリソースエージェントに関する情報の表示」で説明されるcrm raコマンドを使用してください。

1.2.7 ユーザフレンドリな管理ツール #

High Availability Extensionには、一連の強力なツールが付属しています。クラスタの基本的なインストールとセットアップ、および効果的な設定と管理のためにこれらのツールを使用してください。

- YaST

一般的なシステムインストールおよび管理用グラフィカルユーザインタフェース。『インストールおよびセットアップクイックスタート』で説明されているように、YaSTを使用して、High Availability ExtensionをSUSE Linux Enterprise Server上にインストールします。YaSTでは、クラスタまたは個々のコンポーネントの設定に役立つように、High Availabilityカテゴリ内の次のモジュールも提供しています。

クラスタ: 基本的なクラスタセットアップ。詳細については、第4章 「YaSTクラスタモジュールの使用」を参照してください。

DRBD: Distributed Replicated Block Deviceの設定。

IP負荷分散: Linux仮想サーバまたはHAProxyによる負荷分散の設定。詳細については、第15章 「負荷分散」を参照してください。

- Hawk2

High AvailabilityクラスタをLinuxまたは非Linuxマシンから同様に監視および管理することができる、ユーザフレンドリなWebベースのインタフェース。Hawk2には、(グラフィカルな)Webブラウザを使用して、クラスタの内部または外部の任意のマシンからアクセスできます。したがって、使用しているシステムが最小限のグラフィカルユーザインタフェースしか提供していない場合でも、理想的なソリューションとなります。詳細については、第7章 「Hawk2を使用したクラスタリソースの設定と管理」を参照してください。

crmシェルリソースを設定し、すべての監視または管理作業を実行する、統合されたパワフルなコマンドラインインタフェースです。詳細については、第8章 「クラスタリソースの設定と管理(コマンドライン)」を参照してください。

1.3 利点 #

High Availability Extensionを使用すると、最大32台のLinuxサーバを高可用性クラスタ(HAクラスタ)に設定できます。リソースを動的に切り替えたり、クラスタ内の任意のノードに移動することができます。ノード障害発生時のリソースの自動マイグレーションの設定ができます。また、ハードウェアのトラブルシューティングやワークロードのバランスをとるために、リソースを手動で移動することもできます。

High Availability Extensionは、コモディティコンポーネントによる高可用性を提供しています。アプリケーションと操作をクラスタに統合することによって、運用コストを削減できます。High Availability Extensionを使用すると、クラスタ全体を一元的に管理することもできます。変化するワークロード要件に合わせてリソースを調整する(つまり、手動でクラスタを「負荷分散」する)ことができます。3ノード以上でクラスタを設定すると、複数のノードが「ホットスペア」を共用できて無駄がありません。

その他にも重要な利点として、予測できないサービス停止を削減したり、ソフトウェアおよびハードウェアの保守やアップグレードのための計画的なサービス停止を削減できる点が挙げられます。

次に、クラスタによるメリットについて説明します。

可用性の向上

パフォーマンスの改善

運用コストの低減

拡張性

障害回復

データの保護

サーバの集約

ストレージの集約

共有ディスクサブシステムにRAID を導入することによって、共有ディスクの耐障害性を強化できます。

次のシナリオは、High Availability Extensionの利点を紹介するものです。

クラスタシナリオ例#

ノード3台でクラスタが設定され、それぞれのノードにWebサーバをインストールしたと仮定します。クラスタ内の各ノードが、2つのWebサイトをホストしています。各Webサイトのすべてのデータ、グラフィックス、Webページコンテンツは、クラスタ内の各ノードに接続された、共有ディスクサブシステムに保存されています。次の図は、このクラスタのセットアップを示しています。

通常のクラスタ操作では、クラスタ内の各ノードが他のノードと常に交信し、すべての登録済みリソースを定期的にポーリングして、障害を検出します。

Webサーバ1でハードウェアまたはソフトウェアの障害が発生したため、このサーバを利用してインターネットアクセス、電子メール、および情報収集を行っているユーザの接続が切断されたとします。次の図は、Webサーバ1で障害が発生した場合のリソースの移動を表したものです。

WebサイトAがWebサーバ2に、WebサイトBがWebサーバ3に移動します。IPアドレスと証明書もWebサーバ2とWebサーバ3に移動します。

クラスタを設定するときに、それぞれのWebサーバがホストしているWebサイトについて、障害発生時の移動先を指定します。先に説明した例では、WebサイトAの移動先としてWebサーバ2が、WebサイトBの移動先としてWebサーバ3が指定されています。このようにして、Webサーバ 1によって処理されていたワークロードが、残りのクラスタメンバーに均等に分散され、可用性を維持できます。

Webサーバ1で障害が発生すると、High Availability Extensionソフトウェアは次の処理を実行します。

障害を検出し、Webサーバ 1が本当に機能しなくなっていることをSTONITHを使用して検証。STONITHは「Shoot The Other Node In The Head」の略です。これは、動作異常のノードを停止することでクラスタに問題を発生させないようにする手段です。

Webサーバ1にマウントされていた共有データディレクトリを、Webサーバ2およびWebサーバ3に再マウント。

Webサーバ1で動作していたアプリケーションを、Webサーバ2およびWebサーバ3で再起動。.

IPアドレスをWebサーバ2およびWebサーバ3に移動。

この例では、フェールオーバープロセスが迅速に実行され、ユーザはWebサイトの情報へのアクセスを数秒程度で回復できます。通常、再度ログインする必要はありません。

ここで、Webサーバ1で発生した問題が解決し、通常に操作できる状態に戻ったと仮定します。WebサイトAおよびWebサイトBは、Webサーバ1に自動的にフェールバック(復帰)することも、そのままの状態を維持することもできます。これは、リソースの設定方法によって決まります。サービスをWebサーバ1に戻すと、ある程度のダウンタイムが生じます。このため、High Availability Extensionでは、サービスの中断がほとんどまたはまったく発生しなくなるまで、マイグレーションを延期することもできます。いずれの場合でも利点と欠点があります。

High Availability Extensionは、リソースマイグレーション機能も提供します。アプリケーション、Webサイトなどをシステム管理の必要性に応じて、クラスタ内の他のサーバに移動することができます。

たとえば、WebサイトAまたはWebサイトBをWebサーバ1からクラスタ内の他のサーバに手動で移動することができます。これは、Webサーバ1のアップグレードや定期メンテナンスを実施する場合、また、Webサイトのパフォーマンスやアクセスを向上させる場合に有効な機能です。

1.4 クラスタ設定: ストレージ #

High Availability Extensionでのクラスタ構成には、共有ディスクサブシステムが含まれる場合と含まれない場合があります。共有ディスクサブシステムの接続には、高速ファイバチャネルカード、ケーブル、およびスイッチを使用でき、また設定にはiSCSIを使用することができます。ノードの障害時には、クラスタ内の別の指定されたノードが、障害の発生したノードにマウントされていた共有ディスクディレクトリを自動的にマウントします。この機能によって、ネットワークユーザは、共有ディスクサブシステム上のディレクトリに対するアクセスを中断することなく実行できます。

共有ディスクサブシステムをLVM2と使用する場合、クラスタ内の、アクセスが必要なすべてのサーバにそのサブシステムを接続する必要があります。

一般的なリソースの例としては、データ、アプリケーション、およびサービスなどがあります。次の図は、一般的なファイバチャネルクラスタの設定を表したものです。緑色の線は、Ethernet電源スイッチへの接続を示しています。このようなデバイスは、ネットワークを介して制御することが可能であり、ping要求が失敗したときにノードを再起動することができます。

ファイバチャネルは最も高いパフォーマンスを提供しますが、iSCSIを利用するようにクラスタを設定することもできます。iSCSIは低コストなストレージエリアネットワーク(SAN)を作成するための方法として、ファイバチャネルの代わりに使用できます。次の図は、一般的なiSCSIクラスタの設定を表したものです。

ほとんどのクラスタには共有ディスクサブシステムが含まれていますが、共有ディスクサブシステムなしのクラスタを作成することもできます。次の図は、共有ディスクサブシステムなしのクラスタを表したものです。

1.5 アーキテクチャ #

このセクションでは、High Availability Extensionアーキテクチャの概要を説明します。アーキテクチャコンポーネントと、その相互運用方法について説明します。

1.5.1 アーキテクチャ層 #

High Availability Extensionのアーキテクチャは層化されています。図1.6「アーキテクチャ」に異なる層と関連するコンポーネントを示します。

1.5.1.1 メンバーシップとメッセージング層(Corosync) #

このコンポーネントは、クラスタのメッセージング、メンバーシップ、クォーラムに関する信頼性の高い情報を提供します。具体的には、グループ通信システムであるCorosyncクラスタエンジンがその処理を担っています。

1.5.1.2 クラスタリソースマネージャ(Pacemaker) #

クラスタリソースマネージャであるPacemakerは、クラスタ内で発生したイベントへの対応を司る「頭脳」です。これは、あらゆるアクションを統括するpacemaker-controldクラスタコントローラとして実装されます。イベントとは、クラスタにおけるノードの加入と離脱、リソースでの障害発生、保守などの計画的なアクティビティのことを指します。

- ローカルリソースマネージャ

ローカルリソースマネージャは、各ノードのPacemaker層とリソース層の間に存在し、

pacemaker-execdデーモンとして実装されます。このデーモンにより、Pacemakerでのリソースの起動、停止、監視が可能になります。- CIB (クラスタ情報データベース)

Pacemakerは、ノードごとにCIBを保持しています。CIBとは、クラスタ設定のXML表現のことで、クラスタの各オプション、ノード、リソース、制約、個々の要素間の関係性などが記述されています。CIBには、現在のクラスタのステータスも反映されます。各クラスタノードにはCIBレプリカが配置され、クラスタ全体との同期がとられます。クラスタの設定とステータスの読み書きは、

pacemaker-basedデーモンが行います。- DC (指定コーディネータ)

DCは、クラスタ内にあるすべてのノードの中から選択されます。この操作は、DCがまだ指定されていない場合や、現在のDCがなんらかの理由でクラスタを離脱した場合に行われます。DCは、ノードのフェンシングやリソースの移動など、クラスタ全体におよぶ変更が必要かどうかを判断できる、クラスタ内で唯一のエンティティです。その他すべてのノードは、現在のDCから設定とリソース割り当て情報を取得します。

- ポリシーエンジン

ポリシーエンジンはすべてのノードで実行できますが、DC上にあるものだけがアクティブになります。このエンジンは

pacemaker-schedulerdデーモンとして実装されます。クラスタ遷移が必要になると、pacemaker-schedulerdはクラスタの現在の状態と設定を基に、次のクラスタの状態を計算します。また、次の状態を達成するためにどんなアクションを行う必要があるかも決定します。

1.5.1.3 リソースおよびリソースエージェント #

高可用性を備えたクラスタでは、高い可用性を維持し続ける必要があるサービスのことを「リソース」と呼びます。RA (リソースエージェント)とは、これらのクラスタリソースの起動、停止、監視に使用されるスクリプトのことです。

1.5.2 プロセスフロー #

pacemakerdデーモンは、その他のあらゆる関連デーモンの起動と監視を行います。pacemaker-controldデーモンはすべてのアクションを統括し、自身のインスタンスを各クラスタノードに配置します。Pacemakerは、マスタとして動作するインスタンスを1つ選択することにより、クラスタのすべての意思決定を一元化します。選択したpacemaker-controldデーモンで障害が発生する場合は、新たなインスタンスがマスタになります。

クラスタ内で実行するアクションの多くは、クラスタ全体におよぶ変更を伴います。これらのアクションにはクラスタリソースの追加や削除、リソース制約の変更などがあります。このようなアクションを実行する場合は、クラスタ内でどのような変化が発生するのかを理解することが重要です。

たとえば、クラスタIPアドレスリソースを追加するとします。そのためには、crmシェルかWebインタフェースを使用してCIBを変更できます。DCでアクションを実行する必要はありません。クラスタの任意のノードでいずれかのツールを使用して、DCにリレーされます。そして、DCがすべてのクラスタノードにCIBの変更を複製します。

このときは、CIBの情報に基づいて、pacemaker-schedulerdがクラスタの理想的な状態とその達成方法を計算し、命令のリストをDCにフィードします。DCはメッセージング/インフラストラクチャ層を介してコマンドを送信し、他のノードのpacemaker-controldピアがこれらのコマンドを受信します。それぞれのピアは、ローカルでリソースエージェントエグゼキュータ(pacemaker-execd)を使用してリソースに変更を加えます。pacemaker-execdはクラスタに対応しておらず、リソースエージェントと直接通信します。

すべてのピアノードは操作結果をDCに返送します。DCが、すべての必要な操作がクラスタ内で成功したことを確認すると、クラスタはアイドル状態に戻り、次のイベントを待機します。予定通り実行されなかった操作があれば、CIBに記録された新しい情報を基に、pacemaker-schedulerdを再度呼び出します。

場合によっては、共有データの保護や完全なリソース復旧のためにノードの電源を切らなければならないことがあります。Pacemakerクラスタにおけるノードレベルフェンシングの実装は、STONITHです。このPacemakerにはフェンシングサブシステムpacemaker-fencedが内蔵されています。STONITHデバイスは、(特定のフェンシングエージェントを使用する)クラスタリソースとして設定する必要があります。これにより、初めてフェンシングデバイスの監視が可能になるからです。クライアントは障害を検出すると、pacemaker-fencedへ要求を送信します。このデーモンはフェンシングエージェントを実行することにより、ノードを停止します。

2 システム要件と推奨事項 #

次のセクションでは、SUSE® Linux Enterprise High Availability Extensionのシステム要件と前提条件について説明します。また、クラスタセットアップの推奨事項についても説明します。

2.1 ハードウェア要件 #

次のリストは、SUSE® Linux Enterprise High Availability Extensionに基づくクラスタのハードウェア要件を指定しています。これらの要件は、最低のハードウェア設定を表しています。クラスタの使用方法によっては、ハードウェアを追加しなければならないこともあります。

- サーバ

2.2項 「ソフトウェアの必要条件」に指定されたソフトウェアを搭載した1~32台のLinuxサーバ。

サーバはベアメタルでも仮想マシンでも構いません。各サーバが同一のハードウェア設定(メモリ、ディスクスペースなど)になっている必要はありませんが、アーキテクチャは同じである必要があります。クロスプラットフォームのクラスタはサポートされていません。

pacemaker_remoteを使用すると、32ノード制限を超えて追加のLinuxサーバを含めるようにクラスタを拡張できます。- 通信チャネル

クラスタノードあたり、少なくとも2つのTCP/IP通信メディア。ネットワーク機器は、クラスタ通信に使用する通信手段(マルチキャストまたはユニキャスト)をサポートする必要があります。通信メディアは100Mbit/s以上のデータレートをサポートする必要があります。サポートされるクラスタセットアップでは、2つ以上の冗長通信パスが必要です。これは次のように実行できます。

ネットワークデバイスボンディング(推奨)。

Corosync内の2つ目の通信チャネル。

詳細については、第14章 「ネットワークデバイスボンディング」と手順4.3「冗長通信チャネルの定義」をそれぞれ参照してください。

- ノードフェンシング/STONITH

「スプリットブレイン」シナリオを回避するため、クラスタにはノードフェンシングメカニズムが必要です。スプリットブレインシナリオでは、クラスタノードは、お互いを認識していない2つ以上のグループに分割されます(ハードウェアまたはソフトウェアの障害か、ネットワーク接続の切断による)。フェンシングメカニズムにより、問題のあるノードを分離します(通常はノードをリセットするか、ノードの電源をオフにすることによって分離します)。これをSTONITH (「Shoot the other node in the head」)と呼びます。ノードフェンシングメカニズムは、物理デバイス(電源スイッチ)でも、SBD (ディスクによるSTONITH)のようなメカニズムとウォッチドッグを組み合わせたものでも構いません。SBDを使用するには共有ストレージが必要です。

SBDが使用される場合を除き、High Availabilityクラスタの各ノードには少なくとも1つのSTONITHデバイスが必要です。ノードごとに複数のSTONITHデバイスを使用することを強くお勧めします。

重要: STONITHがない場合はサポートなしクラスタにはノードフェンシングメカニズムが必要です。

グローバルクラスタオプション

stonith-enabledおよびstartup-fencingをtrueに設定する必要があります。これらを変更するとサポートされなくなります。

2.2 ソフトウェアの必要条件 #

クラスタの一部になるすべてのノードには、少なくとも次のモジュールと拡張機能が含まれている必要があります。

Basesystem Module 15 SP3

Server Applications Module 15 SP3

SUSE Linux Enterprise High Availability Extension 15 SP3

インストール中に選択したシステムの役割に応じて、デフォルトで次のソフトウェアパターンがインストールされます。

|

システムの役割 |

ソフトウェアパターン(YaST/Zypper) |

|---|---|

|

HAノード |

|

|

HA GEOノード |

|

これらのシステムの役割を介してインストールすると、最小限のインストールにのみ抑えられます。必要に応じて、パッケージを手動で追加しなければならない場合があります。

最初別のシステムの役割が割り当てられていたマシンの場合、sles_haまたはha_geoパターンとその他の必要なパッケージを手動でインストールする必要があります。

2.3 ストレージ要件 #

一部のサービスでは、共有ストレージが必要です。外部NFS共有を使用する場合は、冗長通信パスを介してすべてのクラスタノードから確実にアクセスできる必要があります。

クラスタでデータの可用性を高めたい場合は、共有ディスクシステム(SAN: Storage Area Network)の利用をお勧めします。共有ディスクシステムを使用する場合は、次の要件を満たしていることを確認してください。

メーカーの指示のに従い、共有ディスクシステムが適切に設定され、正しく動作していることを確認します。

共有ディスクシステム中のディスクを、ミラーリングまたはRAIDを使用して耐障害性が高められるように設定してください。

共有ディスクシステムのアクセスにiSCSIを使用している場合、iSCSIイニシエータとターゲットを正しく設定していることを確認します。

2台のマシンにデータを配分するミラーリングRAIDシステムを実装するためにDRBD*を使用する際、DRBDに提供されるデバイスにのみアクセスし、決してバッキングデバイスにはアクセスしないようにします。冗長性を確保するために、クラスタの残りの部分と同一のNICを利用できます。

SBDをSTONITHメカニズムとして使用する場合は、共有ストレージに対して追加の要件が適用されます。詳細については、11.3項 「要件」を参照してください。

2.4 その他の要件と推奨事項 #

サポートされていて、役に立つHigh Availabilityセットアップについては、次の推奨事項を検討してください。

- クラスタノード数

3つ以上のノードを持つクラスタに対して、奇数のクラスタノードを使用してクォーラムを持つようにすることを強くお勧めします。クォーラムの詳細については、6.2項 「クォーラムの判断」を参照してください。通常のクラスタには最大32ノードを含めることができます。

pacemaker_remoteサービスを使用すると、高可用性クラスタを拡張して、この制限を超えて追加のノードを含めることができます。詳細については、『Pacemaker Remote Quick Start』を参照してください。- 時刻同期

クラスタノードはクラスタ外のNTPサーバに同期する必要があります。SUSE Linux Enterprise High Availability Extension 15以降、Chronyは、NTPでデフォルトで実装されるようになりました。詳細については、SUSE Linux Enterprise Server 15 SP3の『管理ガイド』を参照してください。

ノードが同期されていない場合、クラスタが正常に動作しないことがあります。また、同期が行われていないと、ログファイルとクラスタレポートの分析が非常に困難になります。ブートストラップスクリプトを使用するときにNTPがまだ設定されていない場合、警告が表示されます。

- ネットワークインタフェースカード(NIC)名

すべてのノード上で同一である必要があります。

- ホスト名およびIPアドレス

静的IPアドレスを使用します。

/etc/hostsファイルにあるすべてのクラスタノードを、完全修飾ホスト名およびショートホスト名で一覧表示します。クラスタのメンバーが名前で互いを見つけられることが重要です。名前を使用できない場合、内部クラスタ通信は失敗します。Pacemakerがノード名を取得する方法の詳細については、http://clusterlabs.org/doc/en-US/Pacemaker/1.1/html/Pacemaker_Explained/s-node-name.htmlも参照してください。

- SSH

すべてのクラスタノードはSSHによって互いにアクセスできる必要があります。

crm report(トラブルシューティング用)などのツールおよびHawk2のは、ノード間でパスワード不要のSSHアクセスを必要とします。それがない場合、現在のノードからしかデータを収集できません。注記: 規定要件パスワード不要のSSHアクセスが規定要件に適合しない場合は、付録D

rootアクセスなしでのクラスタレポートの実行で説明されている次善策を使用してcrm reportを実行できます。については、現在のところ、パスワード不要のログインに代わる方法はありません。

3 High Availability Extensionのインストール #

初めてSUSE® Linux Enterprise High Availability Extensionを使用してHigh Availabilityクラスタを設定する場合、最も簡単な方法は、基本的な2ノードクラスタで開始することです。2ノードクラスタを使用して、一部のテストを実行することもできます。後で、AutoYaSTを使用して既存のクラスタノードのクローンを作成することにより、さらにノードを追加できます。クローンを作成したノードには、元のノードと同じパッケージがインストールされ、クローンノードは同じシステム設定を持つことになります。

前のバージョンのSUSE Linux Enterprise High Availability Extensionを実行する既存のクラスタをアップグレードする場合は、第5章 「クラスタアップグレードとソフトウェアパッケージの更新」を参照してください。

3.1 手動インストール #

High Availability Extension用のパッケージの手動インストールについては、Article “インストールおよびセットアップクイックスタート”を参照してください。このマニュアルでは、基本的な2ノードクラスタをセットアップする手順を説明しています。

3.2 AutoYaSTによる大量インストールと展開 #

2ノードクラスタをインストールしてセットアップした後で、AutoYaSTを使用して既存のノードのクローンを作成し、クラスタにそのクローンを追加することによりクラスタを拡張できます。

AutoYaSTでは、インストールおよび設定データを含むプロファイルを使用します。このプロファイルによって、インストールする対象と、インストールしたシステムが最終的に使用準備が整ったシステムになるように設定する方法がAutoYaSTに指示されます。そこでこのプロファイルはさまざまな方法による大量配備に使用できます(たとえば、既存のクラスタノードのクローンなど)。

さまざまなシナリオでAutoYaSTを使用する方法の詳細な手順については、SUSE Linux Enterprise Server 15 SP3の『AutoYaSTガイド』を参照してください。

手順3.1「AutoYaSTによるクラスタノードのクローン作成」では、同じハードウェア構成を持つ一群のマシンにSUSE Linux Enterprise High Availability Extension 15 SP3を展開していることを前提としています。

同じではないハードウェア上にクラスタノードを展開する必要がある場合は、『SUSE Linux Enterprise 15 SP3導入ガイド』、「Automated Installation」の章の「Rule-Based Autoinstallation」セクションを参照してください。

クローンを作成するノードが正しくインストールされ、設定されていることを確認します。詳細については、SUSE Linux Enterprise High Availability Extension用の『インストールおよびセットアップクイックスタート』または第4章 「YaSTクラスタモジュールの使用」を参照してください。

単純な大量インストールについては、『SUSE Linux Enterprise 15 SP3 導入ガイド』の説明に従ってください。これには、次の基本ステップがあります。

AutoYaSTプロファイルの作成AutoYaST GUIを使用して、既存のシステム設定をもとにプロファイルを作成し、変更します。AutoYaSTでは、モジュールを選択し、ボタンをクリックします。必要な場合は、他のモジュールの設定を調整し、その結果のコントロールファイルをXMLとして保存します。

DRBDを設定した場合、AutoYaST GUIでこのモジュールを選択してクローンを作成することもできます。

AutoYaSTプロファイルのソースと、他のノードのインストールルーチンに渡すパラメータを決定します。

SUSE Linux Enterprise ServerのソースとSUSE Linux Enterprise High Availability Extensionインストールデータを決定します。

自動インストールのブートシナリオを決定し、設定します。

パラメータを手動で追加するか、または

infoファイルを作成することにより、インストールルーチンにコマンド行を渡します。自動インストールプロセスを開始および監視します。

クローンのインストールに成功したら、次の手順を実行して、クローンノードをクラスタに加えます。

4.5項 「すべてのノードへの設定の転送」の説明に従って、Csync2を使用して、設定済みのノードからクローンノードへ重要な設定ファイルを転送します。

ノードをオンラインにするには、4.8項 「ノードごとにクラスタをオンラインにする」の説明のとおり、クローンノード上でPacemakerサービスを開始します。

これで、/etc/corosync/corosync.confファイルがCsync2を介してクローンノードに適用されたので、クローンノードがクラスタに加わります。CIBは、クラスタノード間で自動的に同期されます。

4 YaSTクラスタモジュールの使用 #

YaSTクラスタモジュールでは、クラスタを手動で(最初から)設定するか、既存のクラスタのオプションを変更することができます。

ただし、クラスタの設定に自動化された方法を選ぶ場合は、Article “インストールおよびセットアップクイックスタート”を参照してください。このマニュアルでは、必要なパッケージのインストール方法と、ha-cluster-bootstrapスクリプトを使用して基本的な2ノードクラスタを設定する手順を説明しています。

たとえば、1つのノードをYaSTクラスタで設定してから、ブートストラップスクリプトの1つを使用して他のノードを統合させる(またはその逆も可能)など、両方のセットアップ方法を組み合わせることもできます。

4.1 用語の定義 #

YaSTクラスタモジュールおよびこの章で使用されているいくつかの主要な用語を以下に定義します。

- バインドネットワークアドレス(

bindnetaddr) Corosyncエグゼクティブのバインド先のネットワークアドレス。クラスタ間の設定ファイルの共有を簡素化するため、Corosyncはネットワークインタフェースネットマスクを使用して、ネットワークのルーティングに使用されるアドレスビットのみをマスクします。たとえば、ローカルインタフェースが

192.168.5.92でネットマスクが255.255.255.0の場合、bindnetaddrは192.168.5.0に設定します。ローカルインタフェースが192.168.5.92でネットマスクが255.255.255.192の場合は、bindnetaddrを192.168.5.64に設定します。ringX_addrを含むnodelistが/etc/corosync/corosync.confで明示的に設定されている場合、bindnetaddrは厳密には必要ありません。注記: すべてのノードのネットワークアドレスすべてのノード上で同じCorosync設定が使用されるため、ネットワークアドレスは、特定のネットワークインタフェースのアドレスではなく、

bindnetaddrとして使用します。conntrackツールカーネル内の接続トラッキングシステムとやり取りできるようにして、iptablesでのステートフルなパケット検査を可能にします。High Availability Extensionによって、クラスタノード間の接続ステータスを同期化するために使用されます。詳細については、http://conntrack-tools.netfilter.org/を参照してください。

- Csync2

クラスタ内のすべてのノード、およびGeoクラスタ全体に設定ファイルを複製するために使用できる同期ツールです。Csync2は、同期グループ別にソートされた任意の数のホストを操作できます。各同期グループは、メンバーホストの独自のリストとその包含/除外パターン(同期グループ内でどのファイルを同期するか定義するパターン)を持っています。グループ、各グループに属するホスト名、および各グループの包含/除外ルールは、Csync2設定ファイル

/etc/csync2/csync2.cfgで指定されます。Csync2は、認証には、同期グループ内でIPアドレスと事前共有キーを使用します。管理者は、同期グループごとに1つのキーファイルを生成し、そのファイルをすべてのグループメンバーにコピーする必要があります。

Csync2の詳細については、http://oss.linbit.com/csync2/paper.pdfを参照してください。

- 既存のクラスタ

「既存のクラスタ」という用語は、1つ以上のノードで構成されるクラスタを指すものとして使用されます。既存のクラスタは、通信チャネルを定義する基本的なCorosync設定を持ちますが、必ずしもリソース設定を持つとは限りません。

- マルチキャスト

ネットワーク内で一対多数の通信に使用される技術で、クラスタ通信に使用できます。Corosyncはマルチキャストとユニキャストの両方をサポートしています。

注記: スイッチとマルチキャストクラスタ通信にマルチキャストを使用するには、ご使用のスイッチがマルチキャストをサポートしていることを確認します。

- マルチキャストアドレス(

mcastaddr) Corosyncエグゼクティブによるマルチキャストに使用されるIPアドレス。このIPアドレスはIPv4またはIPv6のいずれかに設定できます。IPv6ネットワークを使用する場合は、ノードのIDを指定する必要があります。プライベートネットワークでは、どのようなマルチキャストアドレスでも使用できます。

- マルチキャストポート(

mcastport) クラスタ通信に使用されるポート。Corosyncでは、マルチキャストの受信用に指定する

mcastportと、マルチキャストの送信用のmcastport -1の、2つのポートを使用します。- 冗長リングプロトコル(RRP)

ネットワーク障害の一部または全体に対する災害耐性のために、複数の冗長ローカルエリアネットワークが使用できるようになります。この方法では、ひとつのネットワークが作動中である限り、クラスタ通信を維持できます。Corosyncはトーテム冗長リングプロトコルをサポートします。信頼できるソートされた方式でメッセージを配信するために、論理トークンパスリングがすべての参加ノードに課せられます。ノードがメッセージをブロードキャストできるのは、トークンを保持している場合のみです。

Corosyncに定義済みの冗長通信チャネルを持つ場合、RRPを使用してこれらのインタフェースの使用方法をクラスタに伝えます。RRPでは次の3つのモードを使用できます(

rrp_mode)。activeに設定した場合、Corosyncは両方のインタフェースをアクティブに使用します。ただし、このモードは非推奨の機能です。passiveに設定した場合、Corosyncは代わりに使用可能なネットワークを介してメッセージを送信します。noneに設定した場合、RRPは無効になります。

- ユニキャスト

ひとつのあて先ネットワークにメッセージを送信する技術Corosyncはマルチキャストとユニキャストの両方をサポートしています。Corosyncでは、ユニキャストはUDP-unicast (UDPU)として実装されます。

4.2 YaSTモジュール #

YaSTを起動して、 › を選択します。または、コマンドラインでモジュールを開始します。

sudo yast2 cluster

次のリストは、YaSTクラスタモジュールで使用可能な画面の概要を示しています。この画面には、クラスタセットアップの成功に必要なパラメータが含まれているかどうか、またはそのパラメータがオプションであるかどうかも説明されています。

- 通信チャネル(必須)

クラスタノード間の通信に1つまたは2つの通信チャネルを定義できます。転送プロトコルとして、マルチキャスト(UDP)またはユニキャスト(UDPU)のいずれかを使用します。詳細については、4.3項 「通信チャネルの定義」を参照してください。

重要: 冗長通信パスサポートされるクラスタセットアップでは、2つ以上の冗長通信パスが必要です。推奨される方法は、第14章 「ネットワークデバイスボンディング」で説明されるように、ネットワークデバイスボンディングを使用することです。

使用できない場合は、Corosync内にの2つ目の通信チャネルを定義する必要があります。

- セキュリティ(オプションだが推奨)

クラスタの認証設定を定義できます。共有シークレットが必要なHMAC/SHA1認証を使用して、メッセージを保護し、認証することができます。詳細については、4.4項 「認証設定の定義」を参照してください。

- Csync2の設定(オプションだが推奨)

Csync2では、設定変更を追跡して、クラスタノード間でファイルの同期を取ることができます。詳細については、4.5項 「すべてのノードへの設定の転送」を参照してください。

- conntrackdの設定(オプション)

ユーザスペース

conntrackdを設定できます。iptablesでの「ステートフルな」パケット検査のためにconntrackツールを使用します。詳細については、4.6項 「クラスタノード間の接続ステータスの同期」を参照してください。- サービス(必須)

クラスタノードをオンラインにするためにサービスを設定できます。ブート時にPacemakerサービスを開始するかどうか、およびノード間の通信に必要なポートをファイアウォールで開くかどうかを定義します。詳細については、4.7項 「サービスの設定」を参照してください。

初めてクラスタモジュールを起動した場合は、モジュールが、ウィザードのように、基本設定に必要なすべてのステップをガイドします。そうでない場合は、左パネルのカテゴリをクリックして、ステップごとに設定オプションにアクセスします。

YaSTクラスタモジュール内のいくつかの設定は、現在のノードにのみ適用されます。他の設定はCsync2を使用してすべてのノードに自動的に転送できます。これについての詳しい情報は次のセクションを参照してください。

4.3 通信チャネルの定義 #

クラスタノード間で正常な通信を行うには、少なくとも1つの通信チャネルを定義します。手順 4.1または手順 4.2のそれぞれで説明されるように、転送プロトコルとしてマルチキャスト(UDP)またはユニキャスト(UDPU)のいずれかを使用します。2番目の冗長チャネル(手順 4.3)を定義する場合は、両方の通信チャネルで「同じ」プロトコルを使用する必要があります。

SUSE Linux Enterprise High Availability Extensionをパブリッククラウドプラットフォームに展開する場合は、ユニキャストで通信してください。クラウドプラットフォームでは、一般的にマルチキャストでの通信がサポートされていません。

YaST画面で定義されるすべての設定は、/etc/corosync/corosync.confに書き込まれます。マルチキャストおよびユニキャストセットアップのサンプルファイルは、/usr/share/doc/packages/corosyncにあります。

IPv4アドレスを使用する場合、ノードIDはオプションです。IPv6アドレスを使用する場合、ノードIDは必須です。各ノードにIDを手動で指定する代わりに、YaSTクラスタモジュールには、クラスタノードごとに固有のIDを自動的に生成するオプションが含まれています。

マルチキャストを使用する場合、すべてのクラスタノードに対して同じbindnetaddr、mcastaddr、mcastportが使用されます。クラスタ内のすべてのノードは同じマルチキャストアドレスを使用することで互いを認識します。別のクラスタは、別のマルチキャストアドレスを使用します。

YaSTクラスタモジュールを起動して、カテゴリに切り替えます。

プロトコルを

Multicastに設定します。を定義します。クラスタマルチキャストに使用するサブネットに値を設定します。

を定義します。

を定義します。

クラスタノードごとに一意のIDを自動的に生成するには、を有効にしたままにします。

を定義します。

の数を入力します。これは、パーティションされたクラスタでCorosyncがクォーラムを計算する場合に重要です。デフォルトでは、各ノードには

1票が割り当てられています。の数は、クラスタ内のノード数と一致する必要があります。変更内容を確認します。

必要な場合は、手順4.3「冗長通信チャネルの定義」で説明するように、Corosyncで冗長な通信チャネルを定義します。

クラスタ通信にマルチキャストではなくユニキャストを使用する場合は、次の手順に従います。

YaSTクラスタモジュールを起動して、カテゴリに切り替えます。

プロトコルを

Unicastに設定します。を定義します。

ユニキャスト通信では、Corosyncはクラスタ内のすべてのノードのIPアドレスを認識する必要があります。クラスタの一部になる各ノードで、をクリックし、次の詳細を入力します。

[]

[](Corosyncで2つ目の通信チャネルを使用する場合にのみ必要)

[](オプションが無効になっている場合にのみ必要)

クラスタメンバーのアドレスを変更または削除するには、またはボタンを使用します。

クラスタノードごとに一意のIDを自動的に生成するには、を有効にしたままにします。

を定義します。

の数を入力します。これは、パーティションされたクラスタでCorosyncがクォーラムを計算する場合に重要です。デフォルトでは、各ノードには

1票が割り当てられています。の数は、クラスタ内のノード数と一致する必要があります。変更内容を確認します。

必要な場合は、手順4.3「冗長通信チャネルの定義」で説明するように、Corosyncで冗長な通信チャネルを定義します。

ネットワークデバイスボンディングが何らかの理由で使用できない場合、第2の選択は、Corosyncに冗長通信チャネル(2つ目のリング)を定義することです。この方法では、2つの物理的に分かれたネットワークが通信に使用できます。1つのネットワークが失敗しても、クラスタノードは、もう一方のネットワークを介して通信できます。

Corosync内の追加の通信チャネルは2つ目のトークンパスリングを形成します。/etc/corosync/corosync.confでは、設定した最初のチャネルはプライマリリングで、リング番号0を取得します。2つ目のリング(冗長チャネル)はリング番号1を取得します。

Corosyncに定義済みの冗長通信チャネルを持つ場合、RRPを使用してこれらのインタフェースの使用方法をクラスタに伝えます。RRPでは、2つの物理的に別個のネットワークが通信に使用されます。1つのネットワークが失敗しても、クラスタノードは、もう一方のネットワークを介して通信できます。

RRPでは次の3つのモードを使用できます。

activeに設定した場合、Corosyncは両方のインタフェースをアクティブに使用します。ただし、このモードは非推奨の機能です。passiveに設定した場合、Corosyncは代わりに使用可能なネットワークを介してメッセージを送信します。noneに設定した場合、RRPは無効になります。

/etc/hosts Corosync内で複数のリングが設定されている場合、各ノードが複数のIPアドレスを持つことができます。これはすべてのノードの/etc/hostsに反映する必要があります。

YaSTクラスタモジュールを起動して、カテゴリに切り替えます。

を有効にします。冗長チャネルは、定義した最初の通信チャネルと同じプロトコルを使用する必要があります。

マルチキャストを使用する場合は冗長チャネル用に次のパラメータを入力します:。 使用する、、および。

ユニキャストを使用する場合は次のパラメータを定義します: 。使用する、および。クラスタに参加するすべてのノードのIPアドレスを入力します。

Corosyncに、異なるチャネルを使用する方法とタイミングを伝えるには、使用するを選択します。

通信チャネルが1つだけ定義されている場合、が自動的に無効化されます(値

なし)。activeに設定した場合、Corosyncは両方のインタフェースをアクティブに使用します。ただし、このモードは非推奨の機能です。passiveに設定した場合、Corosyncは代わりに使用可能なネットワークを介してメッセージを送信します。

RRPの使用時に、High Availability Extensionは現在のリングの状態を監視し、障害発生後に冗長リングを自動的に再度有効化します。

または、

corosync-cfgtoolを使用してリングの状態を手動で確認します。使用可能なオプションは-hで参照できます。変更内容を確認します。

4.4 認証設定の定義 #

クラスタの認証設定を定義するには、HMAC/SHA1認証を使用できます。共有シークレットが必要なHMAC/SHA認証を使用して、メッセージを保護し、認証する必要があります。指定した認証キー(パスワード)が、クラスタ中のすべてのノードで使用されます。

YaSTクラスタモジュールを起動し、カテゴリに切り替えます。

をオンにします。

新しく作成したクラスタの場合は、をクリックします。認証キーが作成され、

/etc/corosync/authkeyに書き込まれます。ご使用のマシンを既存のクラスタに参加させたい場合、新しいキーファイルは生成しないでください。代わりに、いずれかのノードから

/etc/corosync/authkeyを(手動またはCsync2によって)ご使用のマシンにコピーします。変更内容を確認します。YaSTが設定を

/etc/corosync/corosync.confに書き込みます。

4.5 すべてのノードへの設定の転送 #

結果として生成された設定ファイルをすべてのノードに手動でコピーする代わりに、csync2ツールを使用して、クラスタ内のすべてのノードにレプリケートします。

これには、次の基本手順を必要とします。

Csync2では、設定変更を追跡して、クラスタノード間でファイルの同期を取ることができます。

操作に対して重要なファイルのリストを定義できます。

(他のクラスタノードに対して)これらのファイルの変更を表示できます。

1つのコマンドで複数の設定済みファイルの同期を取ることができます。

~/.bash_logoutの単純なシェルスクリプトを使用して、システムからログアウトする前に、同期化されていない変更について通知できます。

Csync2の詳細については、http://oss.linbit.com/csync2/とhttp://oss.linbit.com/csync2/paper.pdfにアクセスしてください。

4.5.1 YaSTによるCsync2の設定 #

YaSTクラスタモジュールを起動して、カテゴリに切り替えます。

同期グループを指定するには、グループでをクリックし、クラスタ内のすべてのノードのローカルホスト名を入力します。ノードごとに、

hostnameコマンドから返された文字列を正確に使用する必要があります。ヒント: ホスト名解決ホスト名解決がネットワークで正しく機能しない場合は、各クラスタノードのホスト名とIPアドレスの組み合わせを指定することもできます。この指定には、HOSTNAME@IP文字列(たとえば、

alice@192.168.2.100)を使用します。Csync2は、接続時にIPアドレスを使用します。をクリックして、同期グループのキーファイルを生成します。キーファイルは、

/etc/csync2/key_hagroupに書き込まれます。このファイルは、作成後に、クラスタのすべてのメンバーに手動でコピーする必要があります。すべてのノード間で、通常、同期される必要のあるファイルをリストに入れるには、をクリックします。

同期するファイルのリストからファイルを、、またはするには、該当する各ボタンを使用します。ファイルごとに絶対パス名を入力する必要があります。

をクリックして、Csync2をアクティブにします。これによって次のコマンドが実行され、ブート時にCsync2が自動的に起動します。

root #systemctlenable csync2.socket変更内容を確認します。YaSTがCsync2の設定内容を

/etc/csync2/csync2.cfgに書き込みます。ここで同期プロセスを開始するには、4.5.2項 「Csync2を使用した変更内容の同期」で続行します。

4.5.2 Csync2を使用した変更内容の同期 #

Csync2を使用してファイルを正常に同期するには、以下の前提条件が満たされている必要があります。

同じCsync2設定をすべてのクラスタノードで使用できる必要があります。

同じCsync2認証キーをすべてのクラスタノードで使用できる必要があります。

Csync2はすべてのクラスタノード上で実行されている必要があります。

したがって、Csync2を初めて実行する前に、以下の準備を行う必要があります。

ファイル

/etc/csync2/csync2.cfgを、4.5.1項 「YaSTによるCsync2の設定」で説明されるとおりに設定した後、すべてのノードに手動でコピーします。4.5.1項のステップ 3の1つのノードで作成した

/etc/csync2/key_hagroupファイルを、クラスタ内のすべてのノードにコピーしてください。このファイルは、Csync2による認証で必要になります。ただし、すべてのノードで同じファイルでなければならないので、他のノードではファイルを再生成しないでください。すべてのノード上で次のコマンドを実行して、Csync2サービスを今すぐ開始します。

root #systemctlstart csync2.socket

最初にすべてのファイルを一度同期させるには、設定の「コピー元」であるマシン上で次のコマンドを実行します。

root #csync2-xvこれによって、すべてのファイルをその他のノードにプッシュすることで、一度に同期を行います。すべてのファイルが正常に同期されると、Csync2がエラーなしで終了します。

同期対象の1つ以上のファイルが(現在のノードだけでなく)他のノード上で変更されている場合は、Csync2から衝突が報告されます。次の出力とよく似た出力が表示されます。

While syncing file /etc/corosync/corosync.conf: ERROR from peer hex-14: File is also marked dirty here! Finished with 1 errors.

現在のノードのファイルバージョンが「最良」だと確信する場合は、そのファイルを強制して再同期を行い、競合を解決できます。

root #csync2-f/etc/corosync/corosync.confroot #csync2-x

Csync2オプションの詳細については、次のコマンドを実行してください

csync2 -help

Csync2は変更のみをプッシュします。Csync2はマシン間でファイルを絶えず同期しているわけではありません。

同期が必要なファイルを更新する際はいつも、変更を加えたマシン上でcsync2

-xvを実行することで、変更をその他のマシンにプッシュする必要があります。変更されていないファイルが配置された他のマシン上でこのコマンドを実行しても、何も起こりません。

4.6 クラスタノード間の接続ステータスの同期 #

iptablesに対してステートフルなパケット検査ができるようにするには、conntrackツールを設定して使用します。これには、次の基本手順を必要とします。

conntrackdの設定 #

YaSTクラスタモジュールを使用して、ユーザスペースconntrackdを設定します(図4.5「YaST - conntrackd」を参照してください)。これには、その他の通信チャネルに使用されていない専用のネットワークインタフェースが必要です。デーモンは後でリソースエージェントによって起動できます。

YaSTクラスタモジュールを起動して、カテゴリに切り替えます。

接続ステータスの同期に使用するを定義します。

で、接続ステータスを同期させるグループのID番号を定義します。

をクリックして、

conntrackdの設定ファイルを作成します。既存のクラスタでオプションを変更した場合、変更を確認して、クラスタモジュールを終了します。

クラスタ設定を先に進めるには、をクリックして、4.7項 「サービスの設定」で続行します。

を選択して、接続ステータスを同期します。選択したインタフェースのIPv4アドレスが自動的に検出され、YaSTに表示されます。これはすでに設定済みで、マルチキャストをサポートしている必要があります。

conntrackd #conntrackツールを設定したら、これをLinux Virtual Serverで使用できます(負荷分散を参照してください)。

4.7 サービスの設定 #

YaSTクラスタモジュールは、ブート時にノード上で一定のサービスを開始するかどうか定義します。サービスを手動で開始または停止するためにモジュールを使用することもできます。クラスタノードをオンラインにし、クラスタリソースマネージャを起動するには、Pacemakerをサービスとして実行する必要があります。

YaSTクラスタモジュール内で、カテゴリに切り替えます。

このクラスタノードがブートするたびにPacemakerを起動するには、グループで該当するオプションを選択します。グループで、を選択する場合は、このノードがブートするたびに手動でPacemakerを起動する必要があります。Pacemakerを手動で起動するには、次のコマンドを使用します。

root #crmcluster startPacemakerをただちに起動または停止するには、それぞれのボタンをクリックします。

現在のマシン上でのクラスタ通信に必要なポートをファイアウォールで開くには、をアクティブにします。

変更内容を確認します。この設定は、すべてのクラスタノードではなく、ご使用のマシンにのみ適用されることにご注意ください。

4.8 ノードごとにクラスタをオンラインにする #

最初のクラスタ設定が完了した後、各クラスタノード上でクラスタサービスを開始し、スタックをオンラインにします。

既存のノードにログインします。

サービスがすでに実行していることを確認します。

root #crmcluster status実行していない場合は、クラスタサービスを今すぐ開始します。

root #crmcluster startそれぞれのクラスタノードに対してこの手順を繰り返します。

ノードの1つで、

crm statusコマンドを使用してクラスタの状態を確認します。すべてのノードがオンラインの場合、出力は次のようになります。root #crm status Cluster Summary: * Stack: corosync * Current DC: alice (version ...) - partition with quorum * Last updated: ... * Last change: ... by hacluster via crmd on bob * 2 nodes configured * 1 resource instance configured Node List: * Online: [ alice bob ] ...この出力は、クラスタリソースマネージャが起動し、リソースを管理できる状態にあることを示しています。

基本設定を完了し、ノードがオンラインになったら、クラスタリソースの設定を開始できます。crmシェル(crmsh)やHawk2などのクラスタ管理ツールのいずれかを使用します。詳細については、第8章 「クラスタリソースの設定と管理(コマンドライン)」または第7章 「Hawk2を使用したクラスタリソースの設定と管理」を参照してください。

5 クラスタアップグレードとソフトウェアパッケージの更新 #

この章では、次の2つの異なるシナリオ(SUSE Linux Enterprise High Availability Extensionの別バージョン(メジャーリリースまたはサービスパック)へのクラスタアップグレード、およびクラスタノード上の各パッケージの更新)について説明します。5.2項 「最新の製品バージョンへのクラスタアップグレード」および5.3項 「クラスタノード上のソフトウェアパッケージの更新」を参照してください。

クラスタをアップグレードする場合、アップグレードを開始する前に、5.2.1項 「SLE HAおよびSLE HA Geoでサポートされるアップグレードパス」および5.2.2項 「アップグレード前に必要な準備」を確認してください。

5.1 用語集 #

次に、この章で使用される最も重要な用語の定義を示します。

- メジャーリリース, 一般出荷(GA)バージョン

メジャーリリースとは、新しい機能やツールを導入し、非推奨になっていたコンポーネントを削除した、新しい製品バージョンです。これには、後方互換性のない変更が存在します。

- クラスタオフラインアップグレード

新しい製品バージョンに後方互換性のない大きな変更が含まれている場合は、クラスタオフラインアップグレードによってクラスタをアップグレードする必要があります。すべてのノードをオンラインに戻す前に、すべてのノードをオフラインにして、クラスタ全体をアップグレードする必要があります。

- クラスタローリングアップグレード

クラスタローリングアップグレードでは、一度に1つのクラスタノードがアップグレードされ、残りのクラスタはまだ実行されています。最初のノードをオフラインにし、アップグレードして、オンラインに戻してから、クラスタに参加させます。その後、すべてのクラスタノードがメジャーバージョンにアップグレードされるまで、1つずつアップグレードを続けます。

- サービスパック(SP)

複数のパッチを組み合わせて、インストールまたは展開しやすい形式にします。サービスパックには番号が付けられ、通常、プログラムのセキュリティ修正、更新、アップグレード、または拡張機能が含まれます。

- この状態から

新しいマイナーバージョンのパッケージのインストールです。通常、セキュリティの修正やその他の重要な修正が含まれています。

- アップグレード

パッケージまたは配布の新しい主要バージョンのインストール。これにより新機能がもたらされます。クラスタオフラインアップグレードおよびクラスタローリングアップグレードも参照してください。

5.2 最新の製品バージョンへのクラスタアップグレード #

サポートされるアップグレードパスおよびアップグレードの実行方法は、現在の製品バージョンおよび移行したいターゲットバージョンによって異なります。

High Availability Extensionには、基盤となる基本システムと同じサポートされているアップグレードパスがあります。完全な概要については、『SUSE Linux Enterprise Serverアップグレードガイド』の「SUSE Linux Enterprise Server 15 SP3へのサポートされているアップグレードパス」を参照してください。

また、高可用性クラスタスタックはクラスタをアップグレードするための2つの方法を提供するため、次のルールが適用されます。

クラスタローリングアップグレード. クラスタローリングアップグレードは、同じメジャーリリース内(あるサービスパックから次のサービスパックへ、または製品のGAバージョンからSP1へ)でのみサポートされます。

クラスタオフラインアップグレード. あるメジャーリリースから次のメジャーリリース(たとえば、SSLE HA 12からSLE HA 15など)、または特定のメジャーリリース内のサービスパックから次のメジャーリリース(たとえば、SLE HA 12 SP3からSLE HA 15)へアップグレードするには、クラスタオフラインアップグレードが必要です。

5.2.1項では、あるバージョンから次のバージョンへ移行するためにSLE HA (Geo)でサポートされているアップグレードパスと方法を一覧表示しています。列詳細情報の参照先には、参照する必要がある特定のアップグレードドキュメント(基本システムとGeo Clustering for SUSE Linux Enterprise High Availability Extensionも含まれます)が一覧表示されています。このマニュアルは以下から入手できます。

SUSE Linux Enterprise High Availability Extension 12/SUSE Linux Enterprise High Availability Extension 15で実行する混合クラスタはサポートされていません。

製品バージョン15へのアップグレードプロセス後に、製品バージョン12に戻す処理は、サポートされていません。

5.2.1 SLE HAおよびSLE HA Geoでサポートされるアップグレードパス #

|

アップグレード元とアップグレード先 |

アップグレードパス |

詳細情報の参照先 |

|---|---|---|

|

SLE HA 11 SP3から SLE HA (Geo) 12 |

クラスタオフラインアップグレード |

|

|

SLE HA (Geo) 11 SP4からSLE HA (Geo) 12 SP1 |

クラスタオフラインアップグレード |

|

|

SLE HA (Geo) 12からSLE HA (Geo) 12 SP1 |

クラスタローリングアップグレード |

|

|

SLE HA (Geo) 12 SP1からSLE HA (Geo) 12 SP2 |

クラスタローリングアップグレード |

|

|

SLE HA (Geo) 12 SP2からSLE HA (Geo) 12 SP3 |

クラスタローリングアップグレード |

|

|

SLE HA (Geo) 12 SP3からSLE HA (Geo) 12 SP4 |

クラスタローリングアップグレード |

|

|

SLE HA (Geo) 12 SP3からSLE HA (Geo) 15 |

クラスタオフラインアップグレード |

|

|

SLE HA (Geo) 12 SP4からSLE HA (Geo) 12 SP5 |

クラスタローリングアップグレード |

|

|

SLE HA (Geo) 12 SP4からSLE HA (Geo) 15 SP1 |

クラスタオフラインアップグレード |

|

|

SLE HA (Geo) 12 SP5からSLE HA (Geo) 15 SP2 |

クラスタオフラインアップグレード |

|

|

SLE HA (Geo) 15からSLE HA (Geo) 15 SP1 |

クラスタローリングアップグレード |

|

|

SLE HA (Geo) 15 SP1からSLE HA (Geo) 15 SP2 |

クラスタローリングアップグレード |

|

|

SLE HA (Geo) 15 SP2からSLE HA (Geo) 15 SP3 |

クラスタローリングアップグレード |

|

最も単純なアップグレードパスは、すべてのサービスパックを連続してインストールすることです。SUSE Linux Enterprise 15製品ライン(GAとそれ以降のサービスパック)については、アップグレード時に1つのサービスパックをスキップすることもサポートされています。たとえば、SLE HA 15 GAからSLE HA 15 SP2へのアップグレードや、SLE HA 15 SP1からSLE HA 15 SP3へのアップグレードがサポートされます。

5.2.2 アップグレード前に必要な準備 #

- バックアップ

システムバックアップが最新で、復元可能かどうかを確認します。

- テスト

運用環境で実行する前に、まず、クラスタセットアップのステージングインスタンスでアップグレード手順をテストします。これにより、メンテナンス期間に要するタイムフレームを予測できます。発生する可能性のある予期しない問題を検出し、解決するのにも役立ちます。

5.2.3 クラスタオフラインアップグレード #

この項は次のシナリオに適用されます。

SLE HA 11 SP3からSLE HA 12へのアップグレード - 詳細については、手順5.1「製品バージョン11から12へのアップグレード: クラスタオフラインアップグレード」を参照してください。

SLE HA 11 SP4からSLE HA 12 SP1へのアップグレード - 詳細については、手順5.1「製品バージョン11から12へのアップグレード: クラスタオフラインアップグレード」を参照してください。

SLE HA 12 SP3からSLE HA 15へのアップグレード - 詳細については、手順5.2「製品バージョン12から15へのアップグレード: クラスタオフラインアップグレード」を参照してください。

SLE HA 12 SP4からSLE HA 15 SP1へのアップグレード - 詳細については、手順5.2「製品バージョン12から15へのアップグレード: クラスタオフラインアップグレード」を参照してください。

SLE HA 12 SP5からSLE HA 15 SP2へのアップグレード - 詳細については、手順5.2「製品バージョン12から15へのアップグレード: クラスタオフラインアップグレード」を参照してください。

クラスタがまだこれらより古い製品バージョンに基づいている場合は、まず、必要なターゲットバージョンにアップグレードするためのソースとして使用できるバージョンのSLESおよびSLE HAにクラスタをアップグレードします。

High Availability Extension 12クラスタスタックでは、さまざまなコンポーネントに大幅な変更が導入されています(たとえば、/etc/corosync/corosync.conf、OCFS2のディスクフォーマットなど)。したがって、SUSE Linux Enterprise High Availability Extension 11バージョンからのクラスタローリングアップグレードはサポートされません。代わりに、次に示すように、すべてのクラスタノードをオフラインにしてから、クラスタ全体をアップグレードする必要があります。

各クラスタノードにログインし、次のコマンドを使用してクラスタスタックを停止します。

root #rcopenaisstopクラスタノードごとに、目的のターゲットバージョンのSUSE Linux Enterprise ServerおよびSUSE Linux Enterprise High Availability Extensionへのアップグレードを実行します。5.2.1項 「SLE HAおよびSLE HA Geoでサポートされるアップグレードパス」を参照してください。

アップグレードプロセスが完了した後で、SUSE Linux Enterprise ServerおよびSUSE Linux Enterprise High Availability Extensionのアップグレード済みバージョンがインストールされた各ノードを再起動します。

クラスタセットアップでOCFS2を使用する場合は、次のコマンドを実行して、オンデバイス構造をアップデートします。

root #o2cluster--update PATH_TO_DEVICE追加のパラメータがディスクに追加されます。これらのパラメータは、SUSE Linux Enterprise High Availability Extension 12および12 SPxに付属しているアップデートされたOCFS2バージョンで必要になります。

Corosyncバージョン2の

/etc/corosync/corosync.confをアップデートするには:1つのノードにログインして、YaSTクラスタモジュールを起動します。

カテゴリに切り替えて、新しいパラメータ(および)の値を入力します。詳細については、手順4.1「最初の通信チャネルの定義(マルチキャスト)」または手順4.2「最初の通信チャネルの定義(ユニキャスト)」をそれぞれ参照してください。

Corosyncバージョン2で無効になっていたり、見つからない他のオプションをYaSTが検出する場合、変更を求めるプロンプトが表示されます。

YaSTで変更内容を確認します。YaSTが変更を

/etc/corosync/corosync.confに書き込みます。クラスタに対してCsync2が設定されている場合は、次のコマンドを使用して、アップデートされたCorosync設定を他のクラスタノードにプッシュします。

root #csync2-xvCsync2の詳細については、4.5項 「すべてのノードへの設定の転送」を参照してください。

または、

/etc/corosync/corosync.confをすべてのクラスタノードに手動でコピーして、更新されたCorosync設定の同期を取ります。

各ノードにログインして、次のコマンドを使用してクラスタスタックを起動します。

root #crmcluster startcrm statusまたはHawk2を使用してクラスタの状態を確認します。ブート時に起動するように以下のサービスを設定します。

root #systemctl enable pacemakerroot #systemctl enable hawkroot #systemctl enable sbd

新しい機能は、最新のCIB構文バージョンでのみ使用可能な場合もあります。新しい製品バージョンにアップグレードした場合でも、デフォルトではCIB構文バージョンはアップグレードされません。

バージョンをチェックします。

cibadmin -Q | grep validate-with

最新のCIB構文バージョンにアップグレードします。

root #cibadmin--upgrade --force

クラスタノードを(アップグレードするのではなく)最初からインストールすることにした場合、2.2項 「ソフトウェアの必要条件」SUSE Linux Enterprise High Availability Extension15 SP3 に必要なモジュールのリストについて、を参照してください。モジュール、拡張機能、および関連製品の詳細については、SUSE Linux Enterprise Server 15のリリースノートを確認してください。これらは、https://www.suse.com/releasenotes/から入手できます。

SUSE Linux Enterprise High Availability Extension 15へのオフラインアップグレードを開始する前に、注記: CIB構文バージョンのアップグレードの説明に従って現在のクラスタでCIB構文を手動でアップグレードしてください。

各クラスタノードにログインし、次のコマンドを使用してクラスタスタックを停止します。

root #crmcluster stopクラスタノードごとに、目的のターゲットバージョンのSUSE Linux Enterprise ServerおよびSUSE Linux Enterprise High Availability Extensionへのアップグレードを実行します。5.2.1項 「SLE HAおよびSLE HA Geoでサポートされるアップグレードパス」を参照してください。

アップグレードプロセスが完了した後で、SUSE Linux Enterprise ServerおよびSUSE Linux Enterprise High Availability Extensionのアップグレード済みバージョンがインストールされた各ノードにログインして起動します。

Cluster LVMを使用する場合は、clvmdからlvmlockdに移行する必要があります。

lvmlockdのマニュアルページの「changing a clvm VG to a lockd VG」および22.4項 「Mirror LVからCluster MDへのオンラインマイグレーション」を参照してください。次のコマンドを実行してこのクラスタスタックを開始します。

root #crmcluster startcrm statusまたはHawk2を使用してクラスタの状態を確認します。

5.2.4 クラスタローリングアップグレード #

この項は次のシナリオに適用されます。

SLE HA 12からSLE HA 12 SP1へのアップグレード

SLE HA 12 SP1からSLE HA 12 SP2へのアップグレード

SLE HA 12 SP2からSLE HA 12 SP3へのアップグレード

SLE HA 12 SP3からSLE HA 12 SP4へのアップグレード

SLE HA 12 SP4からSLE HA 12 SP5へのアップグレード

SLE HA 15からSLE HA 15 SP1へのアップグレード

SLE HA 15 SP1からSLE HA 15 SP2へのアップグレード

SLE HA 15 SP2からSLE HA 15 SP3へのアップグレード

シナリオに合わせて次の手順のいずれかを使用します。

ノードのアップグレードを開始する前に、「そのノード上の」クラスタスタックを「停止」します。

ソフトウェアの更新中にノード上のクラスタリソースマネージャがアクティブな場合、アクティブノードのフェンシングのような結果を招く場合があります。

最新の製品バージョンに装備されている新機能は、「すべての」クラスタノードが最新の製品バージョンにアップグレードされた後でないと使用できません。混合バージョンのクラスタは、クラスタローリングアップグレード中の短いタイムフレームでのみサポートされます。クラスタローリングアップグレードは1週間以内に完了してください。

すべてのオンラインノードでアップグレードされたバージョンが実行される場合、古いバージョンの他のノードはアップグレードせずに(再)参加できなくなります。

アップグレードするノードで

rootとしてログインし、クラスタスタックを停止します。root #crmcluster stop目的のターゲットバージョンのSUSE Linux Enterprise ServerおよびSUSE Linux Enterprise High Availability Extensionへのアップグレードを実行します。個々のアップグレードプロセスの詳細を確認するには、5.2.1項 「SLE HAおよびSLE HA Geoでサポートされるアップグレードパス」を参照してください。

アップグレードしたノードでクラスタスタックを起動して、ノードをクラスタに再加入させます。

root #crmcluster start次のノードをオフラインにし、そのノードに関して手順を繰り返します。

crm statusまたはHawk2を使用してクラスタの状態を確認します。クラスタノードに異なるCRMバージョンが検出される場合、Hawk2の画面に警告も表示されます。

最新の製品バージョンに装備されている新機能は、「すべての」クラスタノードが最新の製品バージョンにアップグレードされた後でないと使用できません。混合バージョンのクラスタは、ローリングアップグレード中の短いタイムフレームでのみサポートされます。ローリングアップグレードは1週間以内に完了してください。

クラスタノードに異なるCRMバージョンが検出される場合、Hawk2の画面に警告も表示されます。

多くのお客様は、インプレースアップグレードのほかに、次のサービスパックに移行する場合でも新規インストールを希望しています。次の手順では、ノードaliceとbobを持つ2ノードクラスタを次のサービスパック(SP)にアップグレードする場合のシナリオを示しています。

クラスタ設定のバックアップを作成します。次のリストに、最小ファイルセットを示します。

/etc/corosync/corosync.conf /etc/corosync/authkey /etc/sysconfig/sbd /etc/modules-load.d/watchdog.conf /etc/hosts /etc/ntp.conf

リソースに応じて、次のファイルが必要になる場合もあります。

/etc/services /etc/passwd /etc/shadow /etc/groups /etc/drbd/* /etc/lvm/lvm.conf /etc/mdadm.conf /etc/mdadm.SID.conf

ノードaliceから開始します。

ノードをスタンバイモードにします。これにより、リソースをノードから移動できます。

root #crm--wait node standby alice rebootオプション

--waitを使用すると、クラスタが遷移を終えて、アイドル状態になったときにのみコマンドが返されます。rebootオプションには、ノードがもう一度オンラインになったときにはスタンドバイモードではなくなるという効果があります。その名前にかかわらず、rebootオプションは、ノードがオフラインおよびオンラインになっている限り機能します。ノードaliceでクラスタサービスを停止します。

root #crmcluster stopこの時点で、aliceには実行中のリソースはありません。ノードaliceをアップグレードして後で再起動します。クラスタサービスは起動時には開始されないことが想定されます。

バックアップファイルをステップ 1から元の場所にコピーします。

ノードaliceをクラスタに戻します。

root #crmcluster startリソースに問題がないことを確認します。

ノードbobに対してステップ 2を繰り返します。

5.3 クラスタノード上のソフトウェアパッケージの更新 #

ノードのパッケージ更新を開始する前に、クラスタスタックが影響を受けるか否かによって、「そのノード上の」クラスタスタックを「停止」するか、「ノードを保守モード」にします。詳細についてはステップ 1を参照してください。

ソフトウェアの更新中にノード上のクラスタリソースマネージャがアクティブな場合、アクティブノードのフェンシングのような結果を招く場合があります。

ノード上にパッケージ更新をインストールする前に、次の内容を確認してください。

その更新は、SUSE Linux Enterprise High Availability ExtensionまたはGeo Clustering for SUSE Linux Enterprise High Availability Extensionに属するパッケージに影響しますか。

影響する場合は、ソフトウェアの更新を開始する前に、ノード上でクラスタスタックを停止します。root #crmcluster stopパッケージ更新には再起動が必要ですか。必要な場合は、ソフトウェアの更新を開始する前に、ノード上でクラスタスタックを停止します。

root #crmcluster stopこれらの状況のいずれにも該当しない場合は、クラスタスタックを停止する必要はありません。その場合は、ソフトウェアの更新を開始する前に、ノードを保守モードにします。

root #crmnode maintenance NODE_NAME保守モードの詳細については、17.2項 「保守タスクのためのさまざまなオプション」を参照してください。

YaSTまたはZypperを使用してパッケージ更新をインストールします。

更新が正常にインストールされたら、次のいずれかを行います。

それぞれのノードでクラスタスタックを起動します(ステップ 1で停止した場合)。

root #crmcluster startまたは、ノードの保守フラグを削除して、ノードを通常モードに戻します。

root #crmnode ready NODE_NAME

crm statusまたはHawk2を使用してクラスタの状態を確認します。

5.4 詳細の参照先 #

アップグレード先の製品の変更点と新機能の詳細については、それぞれのリリースノートを参照してください。リリースノートは、https://www.suse.com/releasenotes/で入手できます。

パート II 設定および管理 #

- 6 設定および管理の基本事項

HAクラスタの主な目的はユーザサービスの管理です。ユーザサービスの典型的な例は、Apache Webサーバまたはデータベースです。サービスとは、ユーザの観点からすると、指示に基づいて特別な何かを行うことを意味していますが、クラスタにとっては開始や停止できるリソースにすぎません。サービスの性質はクラスタには無関係なのです。

この章では、リソースを設定しクラスタを管理する場合に知っておく必要のある基本概念を紹介します。後続の章では、High Availability Extensionが提供する各管理ツールを使用して、主要な設定および管理タスクを行う方法を説明します。

- 7 Hawk2を使用したクラスタリソースの設定と管理

クラスタリソースを設定および管理する場合、 Hawk2、またはcrmシェル(crmsh)コマンドラインユーティリティのいずれかを使用します。Hawkがインストールされている前のバージョンのSUSE® Linux Enterprise High Availability Extensionからアップグレードする場合は、パッケージが現在のバージョン、Hawk2で置き換えられます。

Hawk2のユーザフレンドリなWebインタフェースを使用すると、High AvailabilityクラスタをLinuxまたは非Linuxマシンから同様に監視および管理することができます。Hawk2には、(グラフィカルな)Webブラウザを使用して、クラスタの内部または外部の任意のマシンからアクセスできます。

- 8 クラスタリソースの設定と管理(コマンドライン)

クラスタリソースを設定および管理するには、コマンドラインユーティリティであるcrmシェル(crmsh)またはWebベースのユーザインタフェースであるHawk2のいずれかを使用します。

この章では、

crmコマンドラインツールを紹介し、このツールの概要、テンプレートの使用方法、そして、主にクラスタリソースの設定と管理(基本的なリソースと高度なリソース(グループとクローン)の作成、制約の設定、フェールオーバーノードとフェールバックノードの指定、リソース監視の設定、リソースの開始、クリーンアップ、または削除、および手動によるリソースの移行について説明します。- 9 リソースエージェントの追加または変更

クラスタによる管理が必要なすべての作業は、リソースとして使用できなければなりません。主要なグループとして、リソースエージェントとSTONITHエージェントの2つがあります。両方のカテゴリで、エージェントの追加や所有が可能で、クラスタ機能を各自のニーズに合わせて拡張することができます。

- 10 フェンシングとSTONITH

フェンシングはHA(High Availability)向けコンピュータクラスタにおいて、非常に重要なコンセプトです。クラスタがノードの1つの誤動作を検出し、そのノードの削除が必要となることがあります。これをフェンシングと呼び、一般にSTONITHリソースで実行されます。フェンシングは、HAクラスタを既知の状態にするための方法として定義できます。

クラスタのすべてのリソースには、それぞれ状態が関連付けられています。たとえば、「リソースr1はaliceで起動されている」などです。HAクラスタでは、このような状態は「リソースr1はalice以外のすべてのノードで停止している」ことを示します。クラスタは各リソースが1つのノードでのみ起動されるようにするためです。各ノードはリソースに生じた変更を報告する必要があります。つまり、クラスタの状態は、リソースの状態とノードの状態の集まりです。

ノードまたはリソースの状態を十分に確定することができない場合には、フェンシングが発生します。クラスタが所定のノードで起こっていることを認識しない場合でも、フェンシングによって、そのノードが重要なリソースを実行しないようにできます。

- 11 ストレージ保護とSBD

SBD (STONITH Block Device)は、共有ブロックストレージ(SAN、iSCSI、FCoEなど)を介したメッセージの交換を通じて、Pacemakerベースのクラスタのノードフェンシングメカニズムを提供します。これにより、フェンシングメカニズムが、ファームウェアバージョンの変更や特定のファームウェアコントローラへの依存から切り離されます。動作異常のノードが本当に停止したかどうかを確認するために、各ノードではウォッチドッグが必要です。特定の条件下では、ディスクレスモードで実行することにより、共有ストレージなしでSBDを使用することもできます。

sapMDCsapVirtHostname ha-cluster-bootstrap スクリプトは、フェンシングメカニズムとしてSBDを使用するオプションを用いて、クラスタを設定する自動化された方法を提供します。詳細については、Article “インストールおよびセットアップクイックスタート”を参照してください。ただし、SBDを手動で設定する場合、個々の設定に関するオプションが増えます。

この章では、SBDの背後にある概念について説明します。スプリットブレインシナリオの場合に潜在的なデータ破損からクラスタを保護するために、SBDが必要とするコンポーネントを設定する手順を説明します。

ノードレベルのフェンシングに加えて、LVM2排他アクティブ化やOCFS2ファイルロックのサポート(リソースレベルのフェンシング)など、ストレージ保護のための追加のメカニズムを使用することができます。これにより、管理上またはアプリケーション上の障害からシステムが保護されます。

- 12 QDeviceとQNetd

QDeviceとQNetdはクォーラムの決定に参加します。アービトレータ

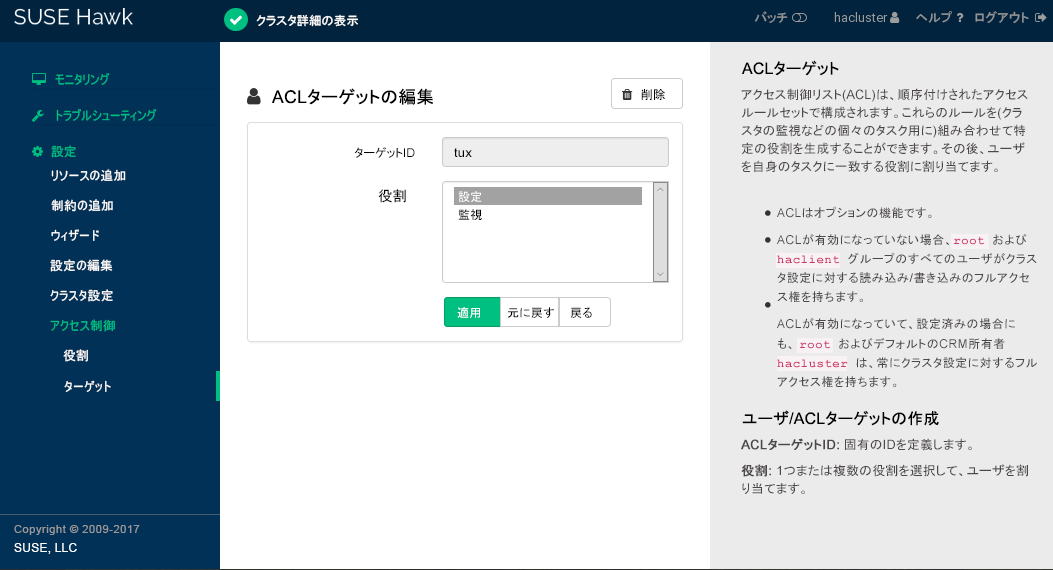

corosync-qnetdからの支援により、corosync-qdeviceは設定可能な投票数を提供するため、クラスタは標準のクォーラムルールで許可されているよりも多くのノード障害に耐えることができます。2ノードクラスタにはcorosync-qnetdとcorosync-qdeviceを展開することを強くお勧めしますが、ノード数が偶数のクラスタには一般的にQNetdとQDeviceを使用することもお勧めします。- 13 アクセス制御リスト

crmシェル(crmsh)またはHawk2などのクラスタ管理ツールは、

rootユーザまたはhaclientグループ内のユーザが使用できます。デフォルトで、これらのユーザは完全な読み込み/書き込みのアクセス権を持ちます。アクセスを制限するか、または詳細なアクセス権を割り当てるには、「アクセス制御リスト」(ACL)を使用できます。アクセス制御リストは、順序付けされたアクセスルールセットで構成されています。各ルールにより、クラスタ設定の一部への読み込みまたは書き込みアクセスの許可、またはアクセスの拒否が行われます。ルールは通常、組み合わせて特定の役割を生成し、ユーザを自分のタスクに一致する役割に割り当てることができます。

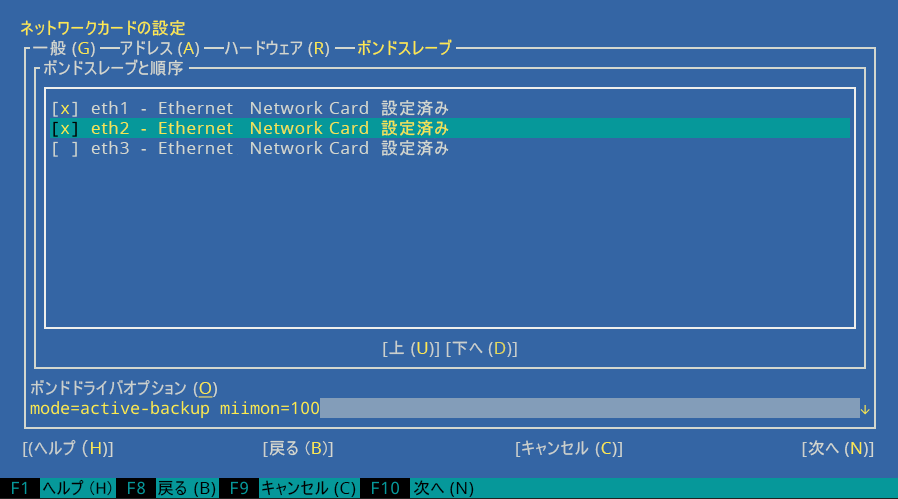

- 14 ネットワークデバイスボンディング

多くのシステムで、通常のEthernetデバイスの標準のデータセキュリティ/可用性の要件を超えるネットワーク接続の実装が望ましいことがあります。その場合、数台のEthernetデバイスを集めて1つのボンディングデバイスを設定できます。

- 15 負荷分散

「負荷分散」によって、外部のクライアントからは、サーバのクラスタが1つの大きな高速サーバであるかのようにみえます。この単一サーバのように見えるサーバは、 仮想サーバと呼ばれます。このサーバは、着信要求をディスパッチする1つ以上のロードバランサと実際のサービスを実行しているいくつかの実際のサーバで構成されます。High Availability Extensionの負荷分散設定によって、高度にスケーラブルで可用性の高いネットワークサービス(Web、キャッシュ、メール、FTP、メディア、VoIPなど)を構築できます。

- 16 Geoクラスタ(マルチサイトクラスタ)

SUSE® Linux Enterprise High Availability Extension 15 SP3は、ローカルクラスタとメトロエリアクラスタのほかに、地理的に離れたクラスタ(Geoクラスタ。マルチサイトクラスタとも呼ばれます)もサポートしています。これは、それぞれひとつのローカルクラスタで持った複数の地理的に離れたサイトを持てることを意味します。これらクラスタ間のフェールオーバーは、より高いレベルのエンティティである

boothによって管理されます。Geoクラスタの使用方法と設定方法の詳細については、Article “Geo Clusteringのクイックスタート”とBook “管理ガイド”を参照してください。- 17 保守タスクの実行

クラスタノードで保守タスクを実行するには、そのノードで実行中のリソースを停止し、それらを移動するか、あるいはそのノードをシャットダウンするか再起動する必要がある場合があります。また、クラスタからリソースの制御を一時的に引き継ぐか、またはリソースを実行中のままにしてクラスタサービスを停止することも必要な場合があります。

この章では、負の影響を及ぼすことなくクラスタノードを手動で切断する方法について説明します。また、クラスタスタックが保守タスクを実行するために提供するさまざまなオプションの概要についても説明します。

6 設定および管理の基本事項 #

HAクラスタの主な目的はユーザサービスの管理です。ユーザサービスの典型的な例は、Apache Webサーバまたはデータベースです。サービスとは、ユーザの観点からすると、指示に基づいて特別な何かを行うことを意味していますが、クラスタにとっては開始や停止できるリソースにすぎません。サービスの性質はクラスタには無関係なのです。

この章では、リソースを設定しクラスタを管理する場合に知っておく必要のある基本概念を紹介します。後続の章では、High Availability Extensionが提供する各管理ツールを使用して、主要な設定および管理タスクを行う方法を説明します。

6.1 ユースケースのシナリオ #

一般的に、クラスタは次の2つのカテゴリのいずれかに分類されます。

2ノードクラスタ

2ノードより多いクラスタ。これは通常、奇数のノード数を意味します。

異なるトポロジを追加して、異なるユースケースを生成することもできます。次のユースケースは最も一般的です。

- 1つの場所の2ノードクラスタ

設定:FC SANまたは同様の共有ストレージ、レイヤ2ネットワーク。

使用シナリオ:サービスの高可用性、およびデータレプリケーションのデータ冗長性なしに焦点を当てた埋め込みクラスタ。このようなセットアップは無線ステーションや組立てラインコントローラなどに使用されます。

- 2つの場所の2ノードクラスタ(最も広く使用されている)

設定:対称的なストレッチクラスタ、FC SAN、およびレイヤ2ネットワークのすべてが2つの場所に及ぶ。

使用シナリオ:サービスの高可用性、およびローカルデータの冗長性に焦点を当てた従来のストレッチクラスタ。データベースおよびエンタープライズリソース計画に適しており、ここ数年間で最も人気のあるセットアップの1つです。

- 3つの場所の奇数のノード数

設定:2×N+1ノード、FC SANが2つの主な場所に及ぶ。FC SANを使用しない補助的な3番目のサイト、過半数メーカーとして機能する。レイヤ2ネットワーク、少なくとも2つの主な場所に及ぶ。

使用シナリオ:サービスの高可用性、およびデータの冗長性に焦点を当てた従来のストレッチクラスタ。たとえば、データベース、エンタープライズリソースプランニング。

6.2 クォーラムの判断 #

1つ以上のノードとその他のクラスタ間で通信が失敗した場合は、常にクラスタパーティションが発生します。ノードは同じパーティション内の他のノードのみと通信可能で、切り離されたノードは認識しません。クラスタパーティションは、ノード(投票)の過半数を保有する場合、クォーラムを持つ(「定足数に達している」)と定義されます。これを実現する方法は「クォーラム計算」によって実行されます。クォーラムはフェンシングの要件です。

クォーラム計算はSUSE Linux Enterprise High Availability Extension 11とSUSE Linux Enterprise High Availability Extension 15の間で変更されました。SUSE Linux Enterprise High Availability Extension 11では、クォーラムはPacemakerによって計算されました。SUSE Linux Enterprise High Availability Extension 12以降では、CorosyncがPacemakerの設定を変更せずに直接2ノードクラスタのクォーラムを処理できます。

クォーラムの計算方法は、次のような要因によって影響されます。

- クラスタノード数

実行中のサービスを継続させるため、2ノードを超えるクラスタはクラスタパーティションの解決においてクォーラム(過半数)に依存します。次の数式に基づき、クラスタが機能するために必要な動作ノードの最少数を計算できます。

N ≥ C/2 + 1 N = minimum number of operational nodes C = number of cluster nodes

たとえば、5ノードクラスタでは、最低3つの動作ノード(または障害が発生する可能性のある2ノード)が必要です。

2ノードクラスタまたは奇数のクラスタノードのいずれかを使用することを強くお勧めします。2ノードクラスタは、2サイト間のストレッチセットアップで重要です。奇数のノード数を持つクラスタは、1つのシングルサイトで構築するか、または3つのサイト間で分散させることができます。

- Corosyncの設定

Corosyncはメッセージングおよびメンバーシップ層です。6.2.4項 「2ノードクラスタのCorosync設定」および6.2.5項 「NノードクラスタのCorosync設定」を参照してください。

6.2.1 グローバルクラスタオプション #

グローバルクラスタオプションは、一定の状況下でのクラスタの動作を制御します。それらは、セットにグループ化され、Hawk2やcrmシェルなどのクラスタ管理ツールで表示したり、変更することができます。

事前に定義されている値は、通常は、そのまま保持できます。ただし、クラスタの主要機能を正しく機能させるには、クラスタの基本的なセットアップ後に、次のパラメータを調整する必要があります。

6.2.2 グルーバルオプションno-quorum-policy #

このグローバルオプションは、クラスタパーティションにクォーラムがない(ノードの過半数がパーティションに含まれない)場合どうするかを定義します。

許容値は、次のとおりです。

ignoreno-quorum-policyをignoreに設定するとクラスタがクォーラムを持つように動作します。リソース管理は続行されます。SLES 11では、この値が2ノードのクラスタ用の推奨設定でした。SLES 12以降、このオプションは廃止されました。設定と条件に基づいて、Corosyncはクラスタノードまたは単一ノードに「クォーラム」を与えます。または与えません。

2ノードのクラスタの場合、クォーラムが失われた場合の唯一の意味のある動作は、常に反応することです。最初のステップとして、クォーラムを失ったノードのフェンシングを試行してください。

freezeクォーラムが失われた場合は、クラスタパーティションがフリーズします。リソース管理は続行されます。実行中のリソースは停止されません(ただし、イベントの監視に対応して再起動される可能性があります)。ただし、影響を受けたパーティション内では、以後のリソースが開始されません。

一定のリソースが他のノードとの通信に依存しているクラスタの場合(たとえば、OCFS2マウントなど)は、この設定が推奨されます。この場合、デフォルト設定

no-quorum-policy=stopは、次のようなシナリオになるので有効でありません。つまり、ピアノードが到達不能な間はそれらのリソースを停止できなくなります。その代わり、停止の試行は最終的にタイムアウトし、stop failureになり、エスカレートされた復元とフェンシングを引き起こします。stop(デフォルト値)クォーラムが失われると、影響を受けるクラスタパーティション内のすべてのリソースが整然と停止します。

suicideクォーラムが失われると、影響を受けるクラスタパーティション内のすべてのノードがフェンシングされます。このオプションは、SBDと組み合わせる場合にのみ機能します。第11章 「ストレージ保護とSBD」を参照してください。

6.2.3 グローバルオプションstonith-enabled #

このグローバルオプションは、フェンシングを適用して、STONITHデバイスによる、障害ノードや停止できないリソースを持つノードのダウンを許可するかどうか定義します。通常のクラスタ操作には、STONITHデバイスの使用が必要なので、このグローバルオプションは、デフォルトでtrueに設定されています。デフォルト値では、クラスタは、STONITHリソースが定義されていない場合にはリソースの開始を拒否します。

何らかの理由でフェンシングを無効にする必要がある場合は、stonith-enabledをfalseに設定しますが、これはご使用の製品のサポートステータスに影響を及ぼすことに注意してください。また、stonith-enabled="false"を指定すると、Distributed Lock Manager (DLM)のようなリソースやDLMによるすべてのサービス(lvmlockd、GFS2、OCFS2など)は開始できません。

STONITHがないクラスタはサポートされません。

6.2.4 2ノードクラスタのCorosync設定 #

ブートストラップスクリプトを使用する場合、Corosyn設定には次のオプションを持つquorumセクションがあります。

quorum {

# Enable and configure quorum subsystem (default: off)

# see also corosync.conf.5 and votequorum.5

provider: corosync_votequorum

expected_votes: 2

two_node: 1

}

SUSE Linux Enterprise 11とは反対に、SUSE Linux Enterprise 12のvotequorumサブシステムは、Corosyncバージョン2.xで機能します。つまり、no-quorum-policy=ignoreオプションは使用してはならないことを意味します。

デフォルトで、two_node: 1が設定されている場合、wait_for_allオプションが自動的に有効になります。wait_for_allが有効でない場合、クラスタは両方のノードでパラレルに開始される必要があります。または、最初のノードが、見つからない2番目のノードで起動フェンシングを実行します。

6.2.5 NノードクラスタのCorosync設定 #

2ノードクラスタを使用しない場合、Nノードクラスタに奇数のノードを使用することを強くお勧めします。クォーラム設定に関して、次のオプションがあります。

ha-cluster-joinコマンドを使用したノードの追加、またはCorosync設定の手動調整。

/etc/corosync/corosync.confを手動で調整する場合、次の設定を使用します。

quorum {

provider: corosync_votequorum 1

expected_votes: N 2

wait_for_all: 1 3

}Corosyncからのクォーラムサービスの使用 | |

予想される投票数。このパラメータは | |

wait for all (WFA)機能を有効にします。WFAが有効な場合、クラスタはすべてのノードが認識可能になった後でのみ定足数に達します。一部の起動時の競合状態を回避するために、 |

6.3 クラスタリソース #

クラスタの管理者は、クラスタ内のサーバ上の各リソースや、サーバ上で実行する各アプリケーションに対してクラスタリソースを作成する必要があります。クラスタリソースには、Webサイト、電子メールサーバ、データベース、ファイルシステム、仮想マシン、およびユーザが常時使用できるようにする他のサーバベースのアプリケーションまたはサービスなどが含まれます。

6.3.1 リソースの管理 #

リソースは、クラスタで使用する前にセットアップする必要があります。たとえば、Apacheサーバをクラスタリソースとして使用するには、まず、Apacheサーバをセットアップし、Apacheの環境設定を完了してから、クラスタで個々のリソースを起動します。

リソースに特定の環境要件がある場合は、それらの要件がすべてのクラスタノードに存在し、同一であることを確認してください。この種の設定は、High Availability Extensionでは管理されません。これは、管理者自身が行う必要があります。

High Availability Extensionでリソースを管理しているときに、同じリソースを他の方法(クラスタ外で、たとえば、手動、ブート、再起動など)で開始したり、停止してはなりません。High Availability Extensionソフトウェアが、すべてのサービスの開始または停止アクションを実行します。

サービスがクラスタ制御下ですでに実行された後にテストまたは保守タスクを実行する必要がある場合は、リソース、ノード、またはクラスタ全体を保守モードに設定してから、これらのいずれかに手動でタッチしてください。詳細については、17.2項 「保守タスクのためのさまざまなオプション」を参照してください。

クラスタ内でリソースを設定したら、クラスタ管理ツールを使用して、すべてのリソースを手動で起動、停止、クリーンアップ、削除、または移行します。これらの操作の詳細については、使用しているクラスタ管理ツールに応じて次のいずれかを参照してください。

クラスタリソースとクラスタノードは異なる名前にする必要があります。そうでない場合、Hawk2は失敗します。

6.3.2 サポートされるリソースエージェントクラス #

追加するクラスタリソースごとに、リソースエージェントが準拠する基準を定義する必要があります。リソースエージェントは、提供するサービスを抽象化して正確なステータスをクラスタに渡すので、クラスタは管理するリソースについてコミットする必要がありません。クラスタは、リソースエージェントに依存して、start、stop、またはmonitorのコマンドの発行に適宜対応します。

通常、リソースエージェントはシェルスクリプトの形式で配布されます。High Availability Extensionは、次のクラスのリソースエージェントをサポートしています。

- Open Cluster Framework (OCF)リソースエージェント

OCF RAエージェントは、High Availabilityでの使用に最適であり、特に、プロモータブルクローンリソースまたは特殊なモニタリング機能を必要とする場合に適しています。それらのエージェントは、通常、

/usr/lib/ocf/resource.d/providerにあります。この機能はLSBスクリプトの機能と同様です。ただし、環境設定では、常に、パラメータの受け入れと処理を容易にする環境変数が使用されます。OCF仕様には、アクション終了コードの厳密な定義があります。9.3項 「OCF戻りコードと障害回復」を参照してください。クラスタは、それらの仕様に正確に準拠します。すべてのOCFリソースエージェントは少なくとも

start、stop、status、monitor、meta-dataのアクションを持つ必要があります。meta-dataアクションは、エージェントの設定方法についての情報を取得します。たとえば、プロバイダheartbeatでIPaddrエージェントの詳細を知るには、次のコマンドを使用します。OCF_ROOT=/usr/lib/ocf /usr/lib/ocf/resource.d/heartbeat/IPaddr meta-data

出力は、XML形式の情報であり、いくつかのセクションを含みます(一般説明、利用可能なパラメータ、エージェント用の利用可能なアクション)。

または、crmshを使用して、OCFリソースエージェントに関する情報を表示します。詳細については、8.1.3項 「OCFリソースエージェントに関する情報の表示」を参照してください。

- Linux Standards Base (LSB)スクリプト

LSBリソースエージェントは一般にオペレーティングシステム/配布パッケージによって提供され、

/etc/init.dにあります。リソースエージェントをクラスタで使用するには、それらのエージェントがLSB iniスクリプトの仕様に準拠している必要があります。たとえば、リソースエージェントには、いくつかのアクションが実装されている必要があります。それらのアクションとして、少なくともstart、stop、restart、reload、force-reload、statusがあります。詳細については、http://refspecs.linuxbase.org/LSB_4.1.0/LSB-Core-generic/LSB-Core-generic/iniscrptact.htmlを参照してください。これらのサービスの構成は標準化されていません。High AvailabilityでLSBスクリプトを使用する場合は、該当のスクリプトの設定方法を理解する必要があります。これに関する情報は、多くの場合、

/usr/share/doc/packages/PACKAGENAME内の該当パッケージのマニュアルに記載されています。- Systemd

SUSE Linux Enterprise 12から、一般的なSystem V initデーモンがsystemdに置き代わりました。Pacemakerは、systemdサービスが存在する場合は、それを管理できます。initスクリプトの代わりに、systemdはユニットファイルを持ちます。一般的に、サービス(またはユニットファイル)は、オペレーティングシステムによって提供されます。既存のinitスクリプトを変換する場合は、http://0pointer.de/blog/projects/systemd-for-admins-3.htmlで詳細情報を検索してください。

- サービス

現在、並列に存在する「通常」タイプのシステムサービスが多数あります:

LSB(System V initに属する)、systemd、および(一部のディストリビューションでは)upstart。そのため、Pacemakerは、どれが指定のクラスタノードに適用されるのかをインテリジェントに理解する特殊なエイリアスをサポートします。これは、クラスタにsystemd、upstart、およびLSBサービスが混在する場合には特に役立ちます。Pacemakerは、次の順番で指定されたサービスを検索しようとします:。 LSB (SYS-V) initスクリプト、systemdユニットファイル、またはUpstartジョブ。- Nagios

モニタリングプラグイン(かつてはNagiosプラグインと呼ばれていた)により、リモートホスト上のサービスを監視できます。Pacemakerは、モニタリングプラグインが存在する場合は、これを使用してリモートモニタリングを実行できます。詳細については、6.6.1項 「監視プラグインを使用したリモートホストでのサービスの監視」を参照してください。

- STONITH(フェンシング)リソースエージェント

このクラスは、フェンシング関係のリソース専用に使用されます。詳細については、第10章 「フェンシングとSTONITH」を参照してください。

High Availability Extensionで提供されるエージェントは、OCF仕様に従って作成されています。

6.3.3 リソースのタイプ #

次のリソースタイプを作成できます。

- プリミティブ

プリミティブリソースは、リソースの中で最も基本的なタイプです。

選択したクラスタ管理ツールでプリミティブリソースを作成する方法については、次を参照してください。

Hawk2: 手順7.5「プリミティブリソースの追加」

crmsh: 8.3.2項 「クラスタリソースの作成」

- グループ

グループには、一緒の場所で見つけ、連続して開始し、逆の順序で停止する必要のあるリソースセットが含まれます。詳細については、6.3.5.1項 「グループ」を参照してください。

- クローン

クローンは、複数のホスト上でアクティブにできるリソースです。対応するリソースエージェントがサポートしていれば、どのようなリソースもクローン化できます。詳細については、6.3.5.2項 「クローン」を参照してください。

プロモータブルクローン(以前はマスタ/スレーブまたはマルチステートリソースと呼ばれていました)は、昇格できる特別なタイプのクローンリソースです。

6.3.4 リソーステンプレート #

類似した設定のリソースを多く作成する最も簡単な方法は、リソーステンプレートを定義することです。定義された後でテンプレートは、プリミティブ内で参照したり、6.5.3項 「リソーステンプレートと制約」で説明するように、特定のタイプの制約内で参照することができます。

プリミティブ内でテンプレートを参照すると、そのテンプレートで定義されている操作、インスタンス属性(パラメータ)、メタ属性、使用属性がすべてプリミティブに継承されます。さらに、プリミティブに対して特定の操作または属性を定義することもできます。これらのいずれかがテンプレートとプリミティブの両方で定義されていた場合、プリミティブで定義した値の方が、テンプレートで定義された値よりも優先されます。

選択したクラスタ管理ツールでリソーステンプレートを定義する方法については、次を参照してください。

Hawk2: 手順7.6「リソーステンプレートの追加」

crmsh: 8.3.3項 「リソーステンプレートの作成」

6.3.5 高度なリソースタイプ #

プリミティブは、最も単純なタイプのリソースなので、設定が容易ですが、クラスタ設定には、より高度なリソースタイプ(グループ、クローン、プロモータブルクローンリソースなど)が必要になることがあります。

6.3.5.1 グループ #

クラスタリソースの中には、他のコンポーネントやリソースに依存しているものもあります。それぞれのコンポーネントやリソースが決められた順序で開始され、依存しているリソースと同じサーバ上で同時に実行していなければならない場合があります。この設定を簡素化するには、クラスタリソースグループを使用できます。

リソースグループの1例として、IPアドレスとファイルシステムを必要とするWebサーバがあります。この場合、各コンポーネントは、個々のリソースであり、それらが組み合わされてクラスタリソースグループを構成します。リソースグループは、1つ以上のサーバで実行されます。ソフトウェアまたはハードウェアが機能しない場合には、個々のクラスタリソースと同様に、グループはクラスタ内の別のサーバにフェールオーバーします。

グループには次のプロパティがあります。

- 開始と停止

リソースは認識される順序で開始し、逆の順番で停止します。

- 依存関係

グループ内のリソースがどこかで開始できない場合は、グループ内のその後の全リソースは実行することができません。

- コンテンツ

グループにはプリミティブクラスタリソースしか含むことができません。グループには1つ以上のリソースを含む必要があります。空の場合は設定は無効になります。グループリソースの子を参照するには、グループのIDではなく子のIDを使用します。

- 制約

制約でグループの子を参照することはできますが、通常はグループ名を使用することをお勧めします。

- 固着性

固着性はグループ内で統合可能なプロパティです。グループ内のアクティブな各メンバーは、グループの合計値に対して固着性を追加します。したがって、デフォルトの

resource-stickinessが100で、グループに7つのメンバーがあり、そのうち5つがアクティブな場合は、グループが全体として、スコア500で、現在の場所を優先します。- リソース監視

グループのリソース監視を有効にするには、グループ内で監視の必要な各リソースに対して監視を設定する必要があります。

選択したクラスタ管理ツールでグループを作成する方法については、次を参照してください。

Hawk2: 手順7.9「リソースグループの追加」

crmsh: 8.3.10項 「クラスタリソースグループの設定」

6.3.5.2 クローン #

クラスタ内の複数のノードで特定のリソースを同時に実行することができます。このためには、リソースをクローンとして設定する必要があります。クローンとして設定するリソースの一例として、OCFS2などのクラスタファイルシステムが挙げられます。提供されているどのリソースも、クローンとして設定できます。これは、リソースのリソースエージェントによってサポートされます。クローンリソースは、ホスティングされているノードによって異なる設定をすることもできます。

リソースクローンには次の3つのタイプがあります。

- 匿名クローン

最も簡単なクローンタイプです。実行場所にかかわらず、同じ動作をします。このため、マシンごとにアクティブな匿名クローンのインスタンスは1つだけ存在できます。

- グローバルに固有なクローン

このリソースは独自のエントリです。1つのノードで実行しているクローンのインスタンスは、別なノードの別なインスタンスとは異なり、同じノードの2つのインスタンスが同一になることもありません。

- プロモータブルクローン(マルチステートリソース)

このリソースのアクティブインスタンスは、アクティブとパッシブという2つの状態に分けられます。プライマリとセカンダリ、またはマスタとスレーブと呼ばれることもあります。プロモータブルクローンが、匿名またはグローバルに固有の場合もあります。6.3.5.3項 「プロモータブルクローン(マルチステートリソース)」も参照してください。

クローンは、グループまたは通常リソースを1つだけ含む必要があります。

リソースのモニタリングまたは制約を設定する場合、クローンには、単純なリソースとは異なる要件があります。詳細については、『Pacemaker Explained』(http://www.clusterlabs.org/pacemaker/doc/から入手可)を参照してください。特に、「Clones - Resources That Get Active on Multiple Hosts」のセクションを参照してください。

選択したクラスタ管理ツールでクローンを作成する方法については、次を参照してください。

Hawk2: 手順7.10「クローンリソースの追加」

crmsh: 8.3.11項 「クローンリソースの設定」。

6.3.5.3 プロモータブルクローン(マルチステートリソース) #

プロモータブルクローン(以前はマルチステートリソースと呼ばれていました)は、クローンが得意とするところです。これにより、インスタンスを2つの動作モード(masterまたはslaveと呼ばれているが、任意の名前を割り当てることができる)のいずれかに設定できます。プロモータブルクローンは、グループまたは通常リソースを1つだけ含む必要があります。

リソースのモニタリングまたは制約を設定する場合、プロモータブルクローンには、単純なリソースとは異なる要件があります。詳細については、『Pacemaker Explained』を参照してください。Pacemaker 1.1のバージョンはhttp://www.clusterlabs.org/pacemaker/doc/から入手できます。特に、「Multi-state - Resources That Have Multiple Modes」のセクションを参照してください。

6.3.6 リソースオプション(メタ属性) #

追加した各リソースについて、オプションを定義できます。クラスタはオプションを使用して、リソースの動作方法を決定します。CRMに特定のリソースの処理方法を通知します。リソースオプションは、crm_resource --metaコマンドまたはHawk2を使用して設定できます(手順7.5「プリミティブリソースの追加」を参照)。

|

オプション |

説明 |

デフォルト |

|---|---|---|

|

|

一部のリソースをアクティブにできない場合、クラスタは優先度の低いリソースを停止して、優先度の高いリソースをアクティブに維持します。 |

|

|

|

クラスタが維持しようとするこのリソースの状態。使用できる値: |

|

|

|

クラスタがリソースを開始して停止できるかどうか。使用できる値: |

|

|

|

リソースは手動でタッチできるかどうか。使用できる値: |

|

|

|

リソースが現在の状態をどの程度維持したいか。 |

計算済み |

|

|

ノードがこのリソースをホストできなくなるまで、このリソースについてノード上で発生する失敗の回数。 |

|

|

|

複数のノードでアクティブなリソースを検出した場合のクラスタの動作。使用できる値: |

|

|

|

失敗が発生していないように動作する(リソースを失敗したノードに戻す)前に、待機する秒数 |

|

|

|

|

|

|

|

このリソースが定義するリモートノードの名前。これにより、リモートノードのリソースが有効化されるだけでなく、リモートノードの識別に使用される固有の名前が定義されます。また、他のパラメータが設定されていない場合、この値は 警告: 固有のIDの使用 この値は、既存のリソースやノードIDとは重複させないでください。 |

なし(無効) |

|

|

pacemaker_remoteへのゲスト接続用のカスタムポート。 |

|

|

|

リモートノードの名前がゲストのホスト名ではない場合に接続するIPアドレスまたはホスト名。 |

|

|

|

中断したゲスト接続がタイムアウトするまでの時間。 |

|

6.3.7 インスタンス属性(パラメータ) #

すべてのリソースクラスのスクリプトでは、動作方法および管理するサービスのインスタンスを指定するパラメータを指定できます。リソースエージェントがパラメータをサポートする場合、それらのパラメータをcrm_resourceコマンドまたはHawk2を使用して追加できます(手順7.5「プリミティブリソースの追加」を参照)。インスタンス属性は、crmコマンドラインユーティリティではparams、Hawk2ではParameterと呼ばれます。OCFスクリプトでサポートされているインスタンス属性のリストは、次のコマンドをrootとして実行すると参照できます。

root # crm ra info [class:[provider:]]resource_agentまたは(オプション部分なし):

root # crm ra info resource_agent出力には、サポートされているすべての属性、それらの目的、およびデフォルト値が一覧されます。

たとえば、次のコマンドを使用します。

root # crm ra info IPaddr次の出力が返されます。

Manages virtual IPv4 addresses (portable version) (ocf:heartbeat:IPaddr)

This script manages IP alias IP addresses

It can add an IP alias, or remove one.

Parameters (* denotes required, [] the default):

ip* (string): IPv4 address

The IPv4 address to be configured in dotted quad notation, for example

"192.168.1.1".

nic (string, [eth0]): Network interface

The base network interface on which the IP address will be brought

online.

If left empty, the script will try and determine this from the

routing table.

Do NOT specify an alias interface in the form eth0:1 or anything here;

rather, specify the base interface only.

cidr_netmask (string): Netmask

The netmask for the interface in CIDR format. (ie, 24), or in

dotted quad notation 255.255.255.0).

If unspecified, the script will also try to determine this from the

routing table.

broadcast (string): Broadcast address

Broadcast address associated with the IP. If left empty, the script will

determine this from the netmask.

iflabel (string): Interface label

You can specify an additional label for your IP address here.

lvs_support (boolean, [false]): Enable support for LVS DR

Enable support for LVS Direct Routing configurations. In case a IP

address is stopped, only move it to the loopback device to allow the

local node to continue to service requests, but no longer advertise it

on the network.

local_stop_script (string):

Script called when the IP is released

local_start_script (string):

Script called when the IP is added

ARP_INTERVAL_MS (integer, [500]): milliseconds between gratuitous ARPs

milliseconds between ARPs

ARP_REPEAT (integer, [10]): repeat count

How many gratuitous ARPs to send out when bringing up a new address

ARP_BACKGROUND (boolean, [yes]): run in background

run in background (no longer any reason to do this)

ARP_NETMASK (string, [ffffffffffff]): netmask for ARP

netmask for ARP - in nonstandard hexadecimal format.

Operations' defaults (advisory minimum):

start timeout=90

stop timeout=100

monitor_0 interval=5s timeout=20sグループ、クローン、およびプロモータブルクローンリソースには、インスタンス属性がないので注意してください。ただし、インスタンス属性のセットは、グループ、クローン、またはプロモータブルクローンリソースの子によって継承されます。

6.3.8 リソース操作 #

デフォルトで、クラスタはリソースが良好な状態であることを保証しません。クラスタにこれを行わせるには、リソースの定義に監視操作を追加する必要があります。監視操作は、すべてのクラスまたはリソースエージェントに追加できます。詳細については、6.4項 「リソース監視」を参照してください。

|

操作 |

説明 |

|---|---|

|

|

アクションに指定する名前。一意にする必要があります。(IDは表示されません) |

|

|

実行するアクション。共通の値: |

|

|

操作を実行する頻度。単位: 秒 |

|

|

アクションが失敗したと宣言する前に待機する長さ。 |

|

|

このアクションが発生する前に満たす必要のある条件。使用できる値: |

|

|

このアクションが失敗した場合に実行するアクション。使用できる値:

|

|

|

|

|

|

リソースにこの役割がある場合のみ操作を実行します。 |

|

|

グローバルに設定したり、個々のリソースに対して設定できます。リソース上の「in-flight」操作の状態をCIBに反映させます。 |

|

|

操作について説明します。 |

6.3.9 タイムアウト値 #

リソースのタイムアウト値は次の3つのパラメータの影響を受けることがあります。

op_defaults(操作用のグローバルタイムアウト)リソーステンプレートに対して定義された特定のタイムアウト値

リソースに対して定義された特定のタイムアウト値

リソースに対して「特定の」値が定義される場合、グローバルデフォルトより優先されます。また、リソースに対して定義された特定の値は、リソーステンプレートで定義された値より優先されます。

タイムアウト値を適切に設定することは非常に重要です。これらの値を短くしすぎると、次のような理由で、多数の(不必要な)フェンシング処理が発生します。

リソースでタイムアウトが発生すると、リソースは失敗し、クラスタはリソースを停止しようとします。

リソースの停止も失敗した場合(たとえば、停止用タイムアウトの設定が低すぎるため)、クラスタはノードをフェンシングします。これが制御不能になるノードを考慮します。

操作に対するグローバルデフォルトを調整し、crmshおよびHawk2の両方で特定のタイムアウト値を設定できます。タイムアウト値の決定および設定のベストプラクティスは次のとおりです。

負荷の下でリソースが開始および停止するためにかかる時間を確認します。

必要に応じて、

op_defaultsパラメータを追加して、それに応じて(デフォルトの)タイムアウト値を設定します。たとえば、

op_defaultsを60秒に設定します。crm(live)configure#op_defaults timeout=60さらに長い時間を必要とするリソースについては、個別の値を定義します。

あるリソースに対して操作を設定する場合には、個別の

startおよびstop操作を追加します。Hawk2を使用して設定する場合、これらの操作に適したタイムアウト値候補が表示されます。

6.4 リソース監視 #

リソースが実行中であるかどうか確認するには、そのリソースにリソースの監視を設定しておく必要があります。

リソースモニタが障害を検出すると、次の処理が行われます。

/etc/corosync/corosync.confのloggingセクションで指定された設定に従って、ログファイルメッセージが生成されます。障害がクラスタ管理ツール(Hawk2、

crm status)と、CIBステータスセクションに反映されます。クラスタが明瞭な復旧アクションを開始します。これらのアクションには、リソースを停止して障害状態を修復する、ローカルまたは別のノードでリソースを再起動するなどが含まれる場合があります。設定やクラスタの状態によっては、リソースが再起動されないこともあります。

リソースの監視を設定しなかった場合、開始成功後のリソース障害は通知されず、クラスタは常にリソース状態を良好として表示してしまいます。

- 停止されたリソースの監視

通常、リソースは動作している限り、クラスタのみによって監視されます。しかし、同時実行違反を検出するために、停止されるリソースの監視も設定する必要があります。例:

primitive dummy1 ocf:heartbeat:Dummy \ op monitor interval="300s" role="Stopped" timeout="10s" \ op monitor interval="30s" timeout="10s"この設定は、

300秒ごとに、リソースdummy1に対する監視操作をトリガします。これは、リソースがrole="Stopped"に入ると有効になります。実行中には、リソースは30秒ごとに監視されます。- プローブ

CRMはすべてのノードの各リソースに対して、

probeと呼ばれる初期監視を実行します。probeはリソースのクリーンアップ後にも実行されます。1つのリソースに対して複数の監視操作が定義されている場合、CRMは最も時間間隔の短い監視を1つ選択し、そのタイムアウト値をプローブのデフォルトタイムアウトとして使用します。監視操作が何も設定されていない場合は、クラスタ規模のデフォルトが適用されます。デフォルトは、20秒です(別途op_defaultsパラメータを設定して指定されていない場合)。自動計算やop_defaultsの値に依存したくない場合は、このリソースの「プローブ」に対して特定の監視操作を定義します。intervalを0に設定した監視操作を追加することで、この操作を行います。たとえば次のようになります。crm(live)configure#primitiversc1 ocf:pacemaker:Dummy \ op monitor interval="0" timeout="60"rsc1のプローブは60sでタイムアウトになります。この値は、op_defaultsで定義されているグローバルなタイムアウト値や、その他の操作で設定されたタイムアウト値とは無関係です。それぞれのリソースのプローブを指定するためにinterval="0"を設定していない場合、CRMは、そのリソースに定義されている監視操作がほかにないかどうかを自動的に確認し、上で説明されているようにプローブのタイムアウト値を計算します。

選択したクラスタ管理ツールでリソースに対して監視操作を追加する方法については、次を参照してください。

Hawk2: 手順7.13「操作の追加または変更」

crmsh: 8.3.9項 「リソース監視の設定」

6.5 リソースの制約 #

すべてのリソースを設定する以外にも、多くの作業が必要です。クラスタが必要なすべてのリソースを認識しても、正しく処理できるとは限りません。リソースの制約を指定して、リソースを実行可能なクラスタノード、リソースのロード順序、特定のリソースが依存している他のリソースを指定することができます。

6.5.1 制約のタイプ #

使用可能な制約には3種類あります。

- リソースの場所

場所の制約はリソースを実行できるノード、できないノード、または実行に適したノードを定義するものです。

- リソースのコロケーション

コロケーション制約は、ノード上で一緒に実行可能な、または一緒に実行することが禁止されているリソースをクラスタに伝えます。

- リソースの順序

アクションの順序を定義する、順序の制約です。

リソースグループの「メンバー」に対してコロケーション制約を作成しないでください。代わりに、リソースグループ全体を指すリソース制約を作成してください。その他のタイプの制約はすべて、リソースグループのメンバーに対して使用しても問題ありません。

クローンリソースまたはプロモータブルクローンリソースが適用されているリソースで制約を使用しないでください。制約はクローンまたはプロモータブルクローンリソースに適用する必要があり、その子リソースに適用することはできません。

6.5.1.1 リソースセット #

6.5.1.1.1 制約を定義するためにリソースセットを使用する #

場所、コロケーション、または順序の制約を定義するための別のフォーマットとして、resource setsを使用することができます。リソースセットでは、プリミティブが1つのセットでグループ化されます。以前は、これはリソースグループを定義するか(デザインを正確に表現できない場合もあった)、個々の制約として各関係を定義することでこの操作が可能でした。個々の制約として定義した場合、多数のリソースとの組み合わせが増えるにつれて、制約が飛躍的に増加しました。リソースセットを介した設定で、冗長性が常に低減されるわけではありませんが、次の例が示すように、定義内容の把握と管理がより容易になります。

たとえば、crmshでリソースセット(loc-alice)の次の設定を使用して、2つの仮想IP (vip1とvip2)を同じノードaliceに配置できます。

crm(live)configure# primitive vip1 ocf:heartbeat:IPaddr2 params ip=192.168.1.5

crm(live)configure# primitive vip2 ocf:heartbeat:IPaddr2 params ip=192.168.1.6

crm(live)configure# location loc-alice { vip1 vip2 } inf: aliceリソースセットを使用してコロケーション制約の設定を置き換える場合は、次の2つの例を検討します。

<constraints>

<rsc_colocation id="coloc-1" rsc="B" with-rsc="A" score="INFINITY"/>

<rsc_colocation id="coloc-2" rsc="C" with-rsc="B" score="INFINITY"/>

<rsc_colocation id="coloc-3" rsc="D" with-rsc="C" score="INFINITY"/>

</constraints>リソースセットで表される同一の設定:

<constraints>

<rsc_colocation id="coloc-1" score="INFINITY" >

<resource_set id="colocated-set-example" sequential="true">

<resource_ref id="A"/>

<resource_ref id="B"/>

<resource_ref id="C"/>

<resource_ref id="D"/>

</resource_set>

</rsc_colocation>

</constraints>リソースセットを使用して順序の制約の設定を置き換える場合は、次の2つの例を検討します。

<constraints>

<rsc_order id="order-1" first="A" then="B" />

<rsc_order id="order-2" first="B" then="C" />

<rsc_order id="order-3" first="C" then="D" />

</constraints>順序付けされたリソースを持つリソースセットを使用して、同様な目的を達成できます。

<constraints>

<rsc_order id="order-1">

<resource_set id="ordered-set-example" sequential="true">

<resource_ref id="A"/>

<resource_ref id="B"/>

<resource_ref id="C"/>

<resource_ref id="D"/>

</resource_set>

</rsc_order>

</constraints>

これらのセットは、順序付けされている(sequential=true)場合もあれば、順序付けされていない場合(sequential=false)場合もあります。また、require-all属性を使用して、ANDおよびORロジック間を切り替えることができます。

6.5.1.1.2 依存関係のないコロケーション制約のリソースセット #

同じノード上にリソースのグループを配置する方が役立つ場合がありますが(コロケーション制約を定義)、リソース間に困難な依存関係を持つことはありません。たとえば、同じノード上に2つのリソースを配置したいが、それらの一方で障害が発生した場合に他方をクラスタで再起動したくない場合があります。これは、weak bondコマンドを使用して、crmシェルで実行できます。

選択したクラスタ管理ツールでこれらの「弱い結合」を設定する方法については、次を参照してください。

6.5.1.2 詳細の参照先 #

様々な種類の制約を追加する方法については、選択したクラスタ管理ツールに応じて次のいずれかを参照してください。

Hawk2: 7.6項 「制約の設定」

crmsh: 8.3.5項 「リソース制約の設定」

制約の設定の詳細や、順序付けおよびコロケーションの基本的な概念についての詳しいバックグラウンド情報は次のドキュメントを参照してください。これらのドキュメントは、http://www.clusterlabs.org/pacemaker/doc/で入手できます。

『Pacemaker Explained』の「Resource Constraints」の章

『Colocation Explained』

『オーダーの概要』

6.5.2 スコアと無限大 #

制約を定義する際は、スコアも扱う必要があります。あらゆる種類のスコアはクラスタの動作方法と密接に関連しています。スコアの操作によって、リソースのマイグレーションから、速度が低下したクラスタで停止するリソースの決定まで、あらゆる作業を実行できます。スコアはリソースごとに計算され、リソースに対して負のスコアが付けられているノードは、そのリソースを実行できません。リソースのスコアを計算した後、クラスタはスコアが最も高いノードを選択します。

INFINITYは現在1,000,000と定義されています。この値の増減は、次の3つの基本ルールに従います。

任意の値+ INFINITY = INFINITY

任意の値- INFINITY = -INFINITY

INFINITY - INFINITY = -INFINITY

リソース制約を定義する際は、各制約のスコアを指定します。スコアはこのリソース制約に割り当てる値を示します。スコアの高い制約は、それよりもスコアが低い制約より先に適用されます。1つのリソースに対して場所の制約を複数作成し、それぞれに異なるスコアを指定することで、リソースがフェールオーバーするノードの順序を指定できます。

6.5.3 リソーステンプレートと制約 #

リソーステンプレートを定義したら(6.3.4項 「リソーステンプレート」を参照)、次のタイプの制約で参照できます。

順序の制約

コロケーション制約

rsc_ticket制約(Geoクラスタの場合)

ただし、コロケーション制約には、テンプレートへの参照を複数含めることはできません。リソースセットには、テンプレートへの参照を含めることはできません。