本指南概括介绍了虚拟化技术。其中介绍了 libvirt(统一虚拟化接口),并提供了有关特定超级管理程序的详细信息。

- 前言

- I 简介

- II 使用

libvirt管理虚拟机 - III 独立于超级管理程序的功能

- IV 使用 Xen 管理虚拟机

- V 使用 QEMU 管理虚拟机

- 词汇表

- A 虚拟机驱动程序

- B 为 NVIDIA 卡配置 GPU 直通

- C XM、XL 工具栈和

libvirt框架 - D GNU licenses

- 3.1 Xen 虚拟化体系结构

- 4.1 KVM 虚拟化体系结构

- 6.1 “系统角色”屏幕

- 9.1 连接细节

- 9.2 创建虚拟网络

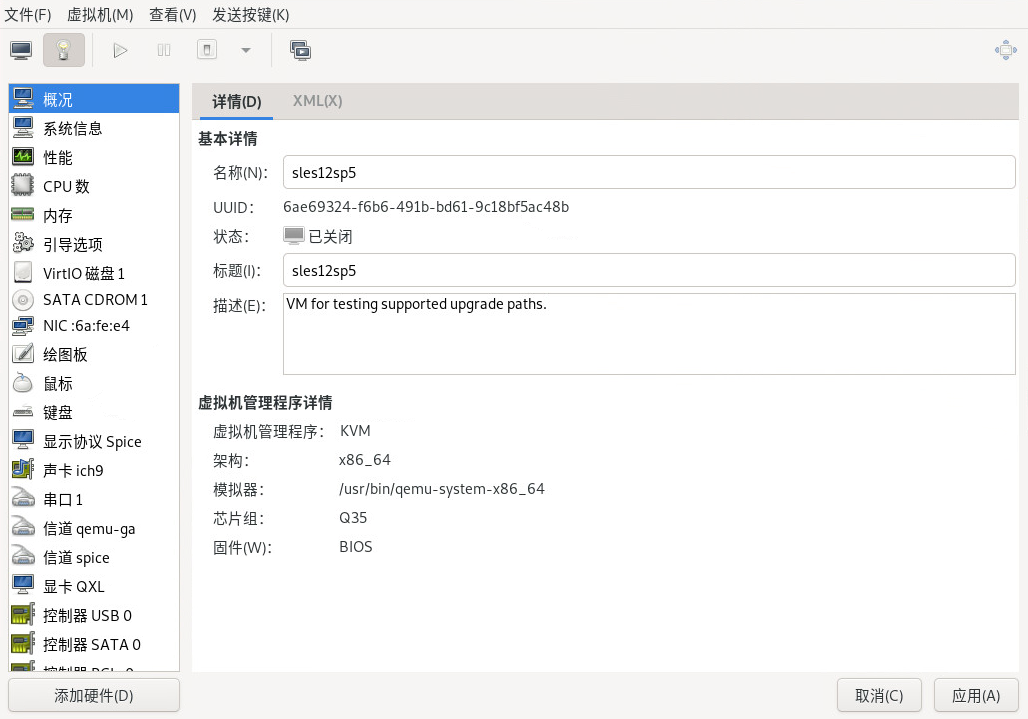

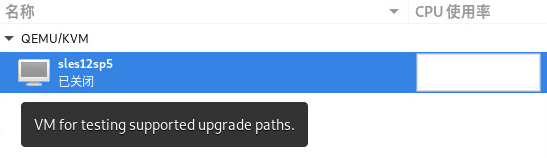

- 14.1 VM Guest 的视图

- 14.2 概览细节

- 14.3 VM Guest 标题和说明

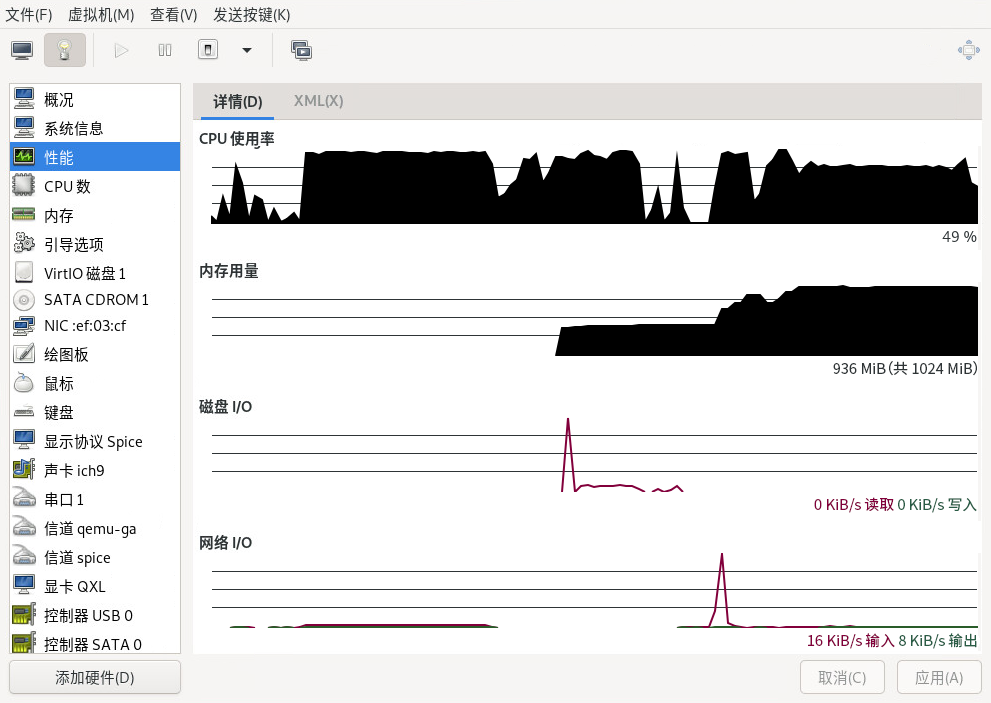

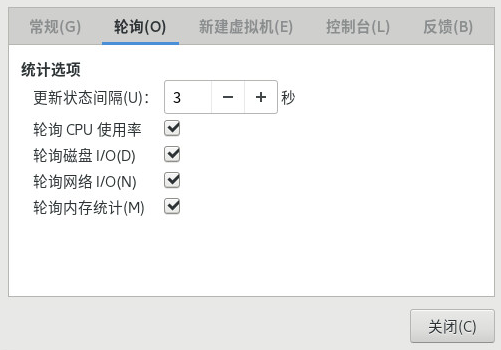

- 14.4 性能

- 14.5 统计图

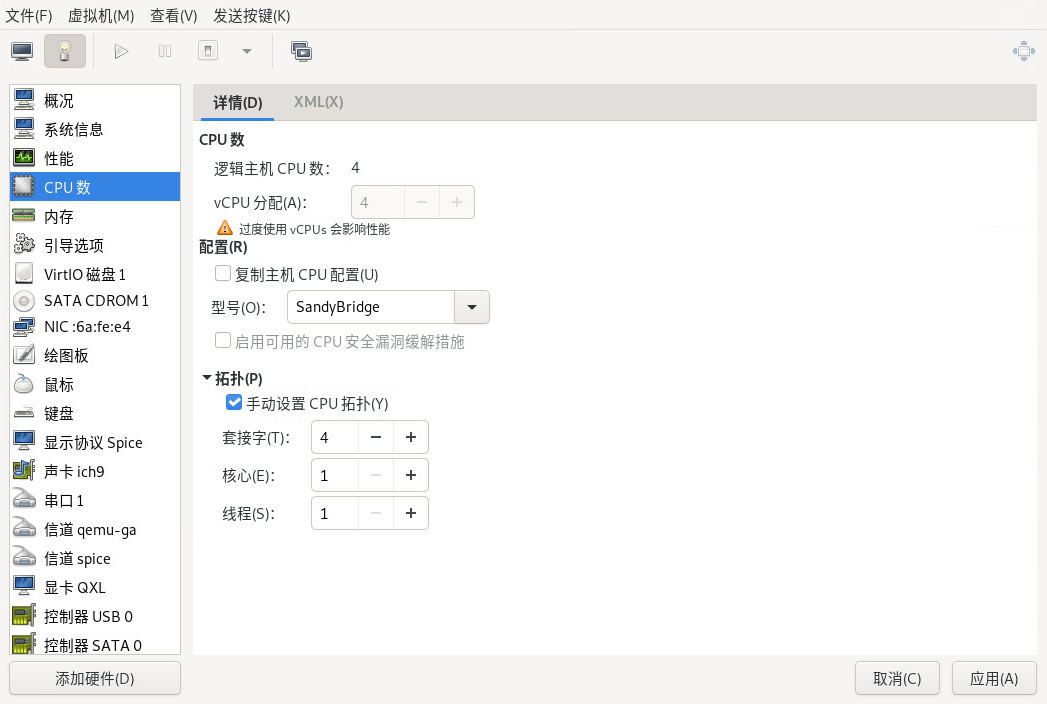

- 14.6 处理器视图

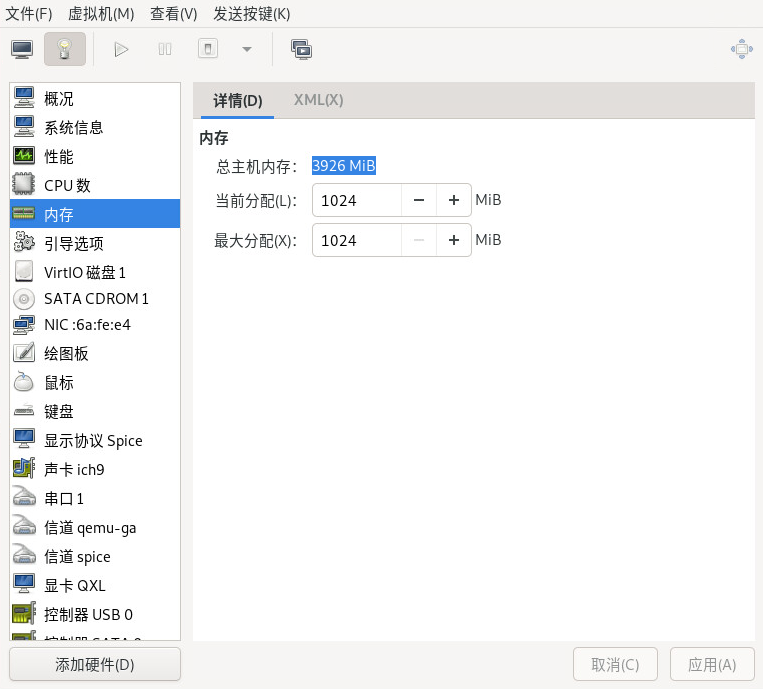

- 14.7 内存视图

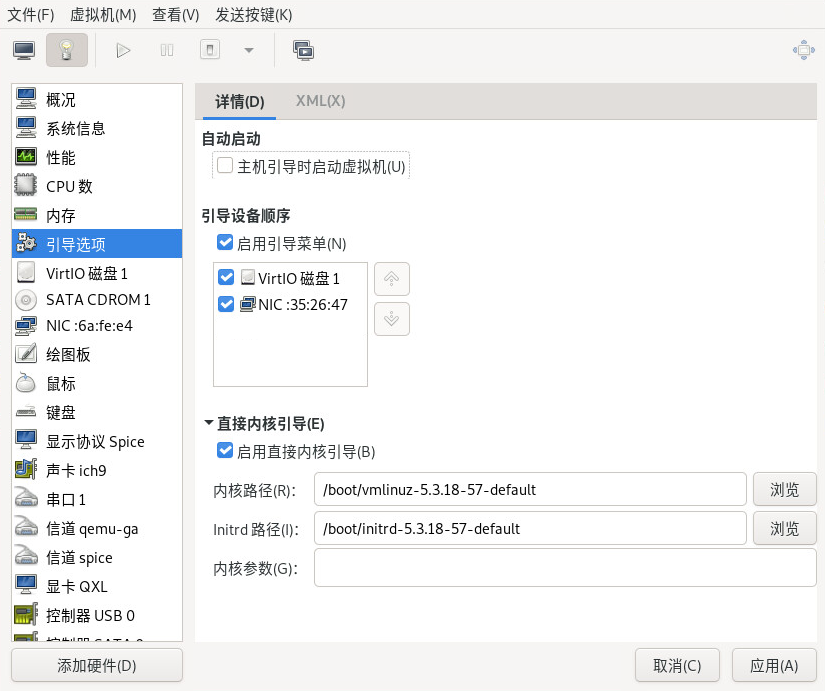

- 14.8 引导选项

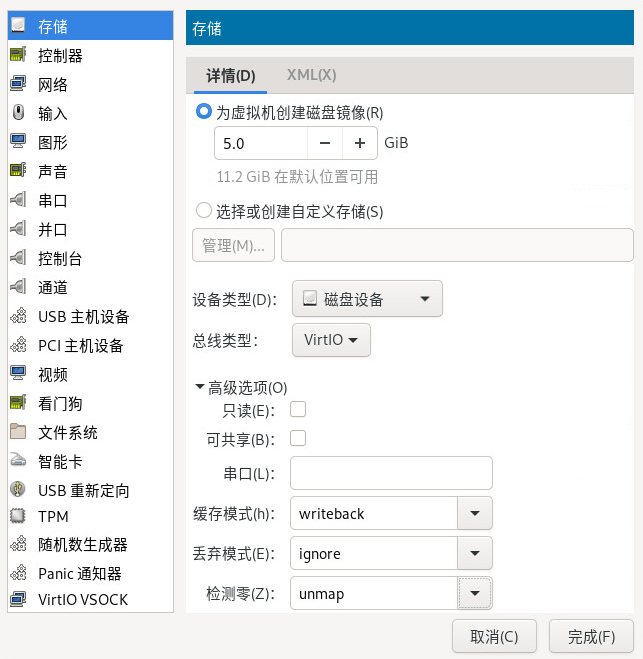

- 14.9 添加新储存设备

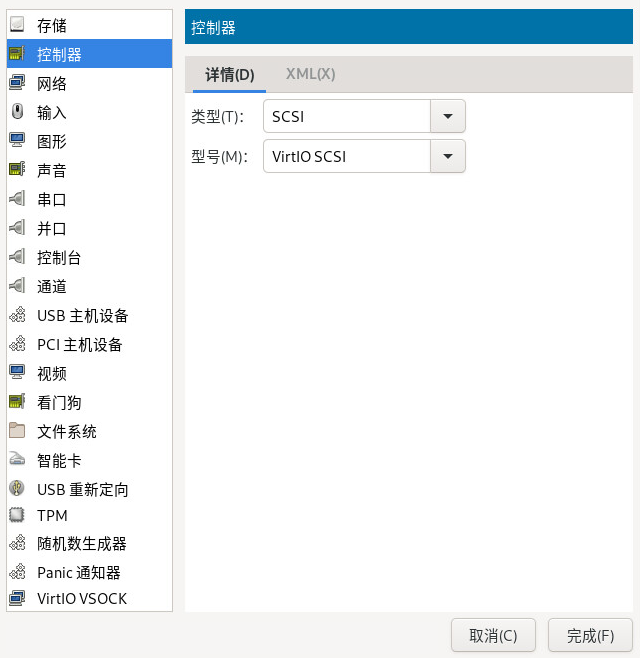

- 14.10 添加新控制器

- 14.11 添加新网络接口

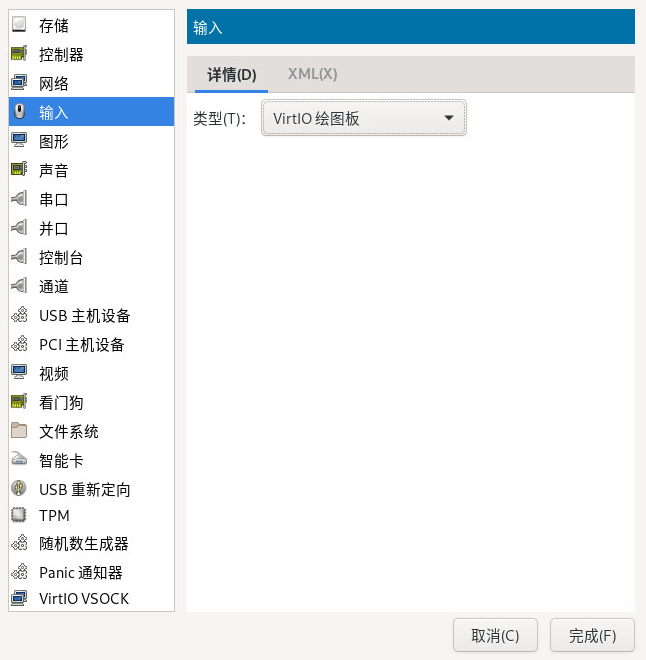

- 14.12 添加新输入设备

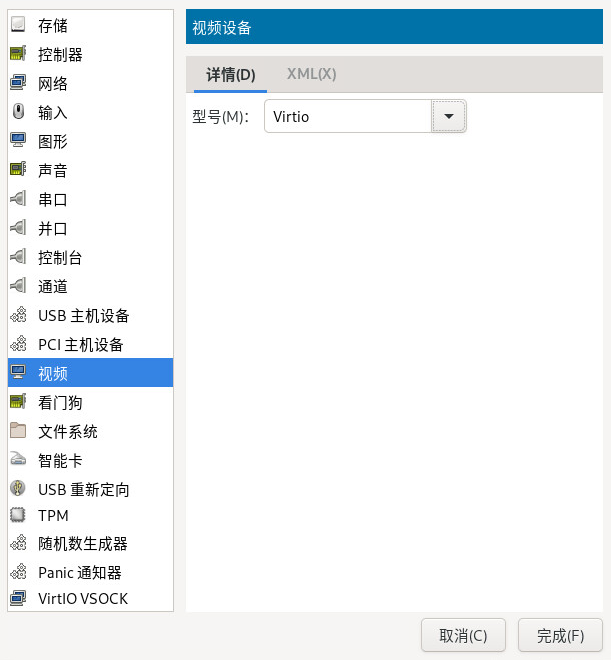

- 14.13 添加新视频设备

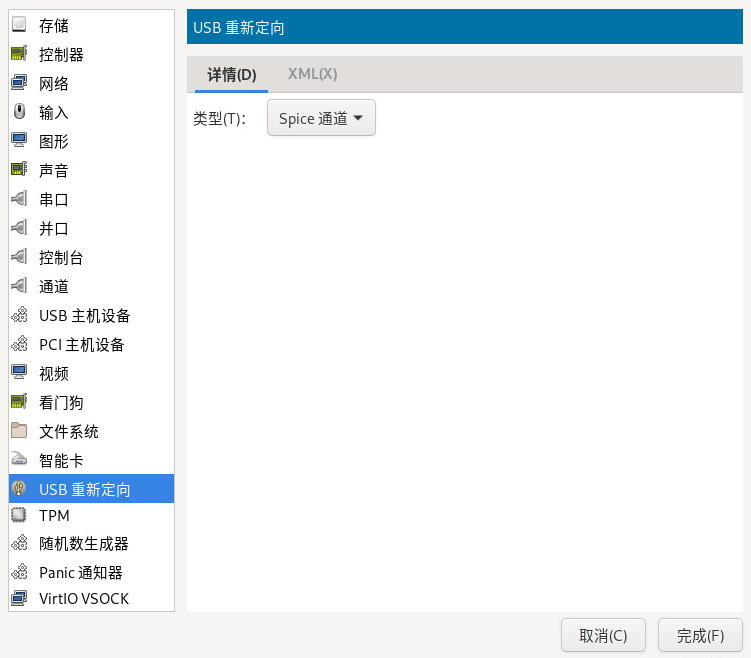

- 14.14 添加新 USB 重定向器

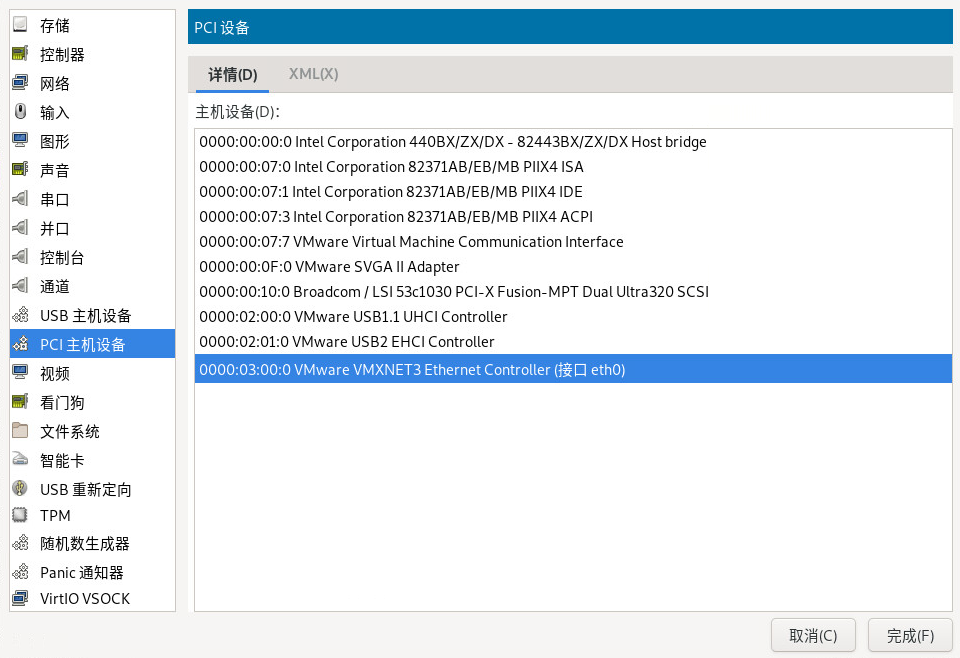

- 14.15 添加 PCI 设备

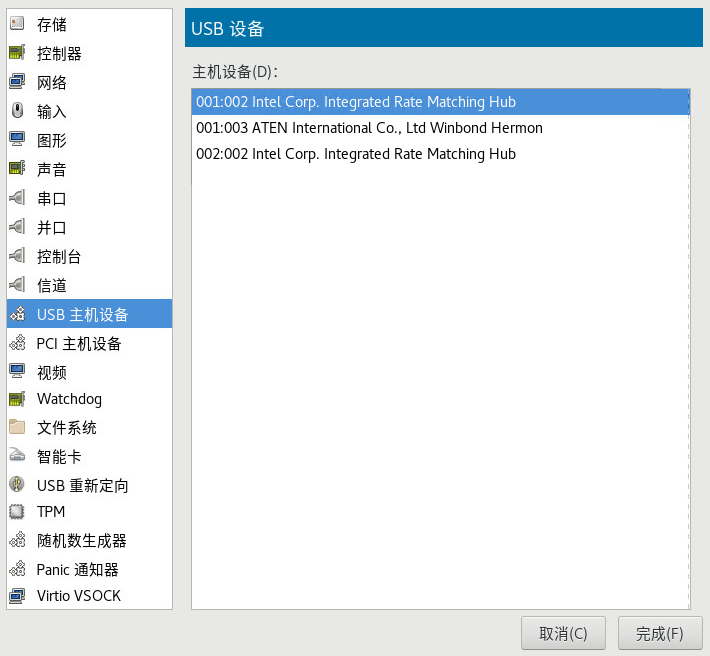

- 14.16 添加 USB 设备

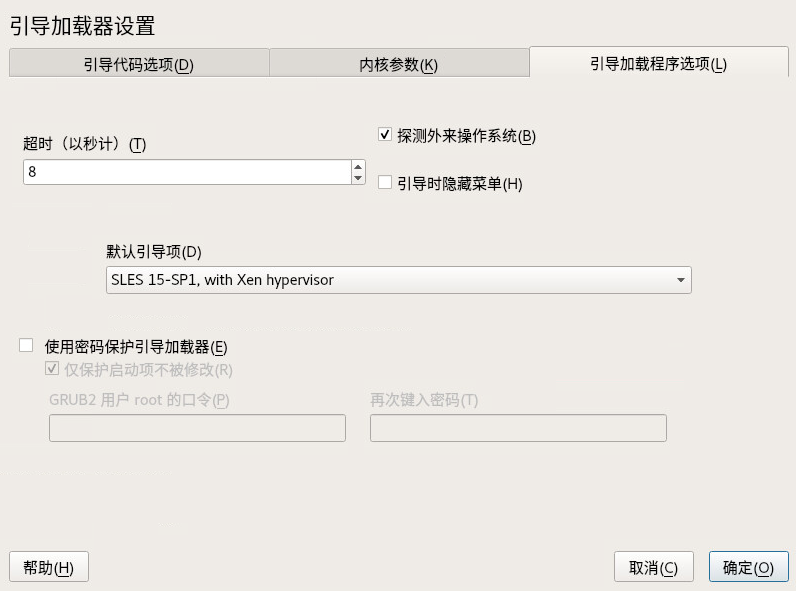

- 28.1 引导加载程序设置

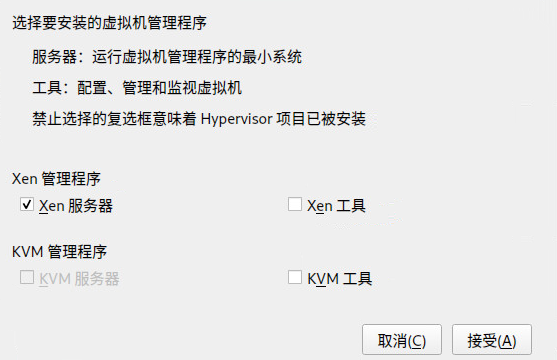

- 33.1 安装 KVM 超级管理程序和工具

- 33.2 网桥

- 35.1 显示使用 SLES 作为 VM Guest 的 QEMU 窗口

- 35.2 QEMU VNC 会话

- 35.3 Remmina 中的身份验证对话框

- 7.1 KVM VM 限制

- 7.2 Xen VM 限制

- 7.3 Xen 主机限制

- 7.4 支持以下 SUSE 主机环境

- 7.5 支持的从 SUSE Linux Enterprise Server 12 SP3 脱机迁移 Guest 的场景

- 7.6 支持的从 SUSE Linux Enterprise Server 12 SP4 脱机迁移 Guest 的场景

- 7.7 支持的从 SUSE Linux Enterprise Server 12 SP5 脱机迁移 Guest 的场景

- 7.8 支持的从 SUSE Linux Enterprise Server 15 GA 脱机迁移 Guest 的场景

- 7.9 支持的从 SUSE Linux Enterprise Server 15 SP1 脱机迁移 Guest 的场景

- 7.10 支持的从 SUSE Linux Enterprise Server 15 SP2 脱机迁移 Guest 的场景

- 7.11 支持的从 SLES 12 SP3 实时迁移 Guest 的场景

- 7.12 支持的从 SLES 12 SP4 实时迁移 Guest 的场景

- 7.13 支持的从 SLES 12 SP5 实时迁移 Guest 的场景

- 7.14 支持的从 SLES 15 实时迁移 Guest 的场景

- 7.15 支持的从 SLES 15 SP1 实时迁移 Guest 的场景

- 7.16 支持的从 SLES 15 SP2 实时迁移 Guest 的场景

- 7.17 支持的从 SLES 15 SP3 实时迁移 Guest 的场景

- 7.18 功能支持 — 主机 (

Dom0) - 7.19 功能支持 — 半虚拟化 Guest

- 7.20 功能支持 — 全虚拟化 Guest

- 30.1 Xen 远程储存

- C1 表示法约定

- C2 新的全局选项

- C3 通用选项

- C4 已去除的域管理选项

- C5 已去除的 USB 设备管理选项

- C6 已去除的 CPU 管理选项

- C7 其他选项

- C8 已更改的

xlcreate选项 - C9 已去除的

xmcreate选项 - C10 添加的

xlcreate选项 - C11 添加的

xlconsole选项 - C12 已去除的

xminfo选项 - C13 已去除的

xmdump-core选项 - C14 已去除的

xmlist选项 - C15 添加的

xllist选项 - C16 已更改的

xlmem-*选项 - C17 已去除的

xmmigrate选项 - C18 添加的

xlmigrate选项 - C19 已去除的

xmreboot选项 - C20 添加的

xlreboot选项 - C21 添加的

xlsave选项 - C22 添加的

xlrestore选项 - C23 已去除的

xmshutdown选项 - C24 添加的

xlshutdown选项 - C25 已更改的

xltrigger选项 - C26 已去除的

xmsched-credit选项 - C27 添加的

xlsched-credit选项 - C28 已去除的

xmsched-credit2选项 - C29 添加的

xlsched-credit2选项 - C30 已去除的

xmsched-sedf选项 - C31 添加的

xlsched-sedf选项 - C32 已去除的

xmcpupool-list选项 - C33 已去除的

xmcpupool-create选项 - C34 添加的

xlpci-detach选项 - C35 已去除的

xmblock-list选项 - C36 其他选项

- C37 网络选项

- C38 已去除的

xlnetwork-attach选项 - C39 新选项

- 9.1 基于 NAT 的网络

- 9.2 路由网络

- 9.3 隔离网络

- 9.4 使用 VM 主机服务器上的现有网桥

- 10.1 从 HTTP 服务器装载内核和 initrd

- 10.2

virt-install命令行示例 - 11.1

kvm_stat的典型输出 - 15.1 示例 XML 配置文件

- 25.1 SLED 12 的 Guest 域配置文件:

/etc/xen/sled12.cfg - 33.1 使用 VirtFS 导出主机的文件系统

- 35.1 受限用户模式网络

- 35.2 使用自定义 IP 范围的用户模式网络

- 35.3 使用网络引导和 TFTP 的用户模式网络

- 35.4 使用主机端口转发的用户模式网络

- 35.5 口令身份验证

- 35.6 x509 证书身份验证

- 35.7 x509 证书和口令身份验证

- 35.8 SASL 身份验证

- C1 将 Xen 域配置转换为

libvirt

版权所有 © 2006–2025 SUSE LLC 和贡献者。保留所有权利。

根据 GNU 自由文档许可 (GNU Free Documentation License) 版本 1.2 或(根据您的选择)版本 1.3 中的条款,在此授予您复制、分发和/或修改本文档的权限;本版权声明和许可附带不可变部分。许可版本 1.2 的副本包含在题为“GNU Free Documentation License”的部分。

有关 SUSE 商标,请参见 https://www.suse.com/company/legal/。所有其他第三方商标分别为相应所有者的财产。商标符号(®、™ 等)代表 SUSE 及其关联公司的商标。星号 (*) 代表第三方商标。

本指南力求涵盖所有细节,但这不能确保本指南准确无误。SUSE LLC 及其关联公司、作者和译者对于可能出现的错误或由此造成的后果皆不承担责任。

前言 #

1 可用文档 #

- 联机文档

https://documentation.suse.com/#sles 上提供了此产品的相关联机文档。您可浏览或下载各种格式的文档。

https://documentation.suse.com/ 上提供了其他产品的相关联机文档。

注意:最新更新最新的文档更新通常会在文档的英文版中提供。

- 发行说明

有关发行说明,请参见 https://www.suse.com/releasenotes/。

- 在您的系统中

要以脱机方式使用,请参见安装的系统中

/usr/share/doc下的文档。许多命令的手册页中也对相应命令进行了详细说明。要查看手册页,请运行man后跟特定的命令名。如果系统上未安装man命令,请使用sudo zypper install man加以安装。

2 改进文档 #

欢迎您提供针对本文档的反馈及改进建议!我们提供了多种反馈渠道:

- 服务请求和支持

有关产品可用的服务和支持选项,请参见 https://www.suse.com/support/。

要创建服务请求,需在 SUSE Customer Center 中获取一个订阅。请转到 https://scc.suse.com/support/requests 并登录,然后单击。

- Bug 报告

在 https://bugzilla.suse.com/ 中报告文档问题。要简化此过程,可以使用本文档 HTML 版本中的标题旁边的 链接。这样,就会在 Bugzilla 中预先选择正确的产品和类别,并添加当前章节的链接。然后,您便可以立即开始键入 Bug 报告。需要一个 Bugzilla 帐户。

- 贡献

要帮助改进本文档,请使用本文档 HTML 版本中的标题旁边的链接。这些链接会将您转到 GitHub 上的源代码,在其中可以创建拉取请求。需要一个 GitHub 帐户。

有关本文档使用的文档环境的详细信息,请参见储存库的 README。

- 邮件

另外,您也可以将有关本文档中的错误以及相关反馈发送至:<doc-team@suse.com>。请确保反馈中含有文档标题、产品版本和文档发布日期。请引用相关的章节号和标题(或者包含 URL),并提供问题的简要说明。

3 文档约定 #

本文档中使用了以下通知和排版约定:

/etc/passwd:目录名称和文件名PLACEHOLDER:PLACEHOLDER 将会替换为实际的值

PATH:环境变量 PATHls、--help:命令、选项和参数用户:用户和组软件包名称 :软件包名称

Alt、Alt–F1:按键或组合键;这些键以大写形式显示,如在键盘上一样

、 › :菜单项,按钮

AMD/Intel 本段内容仅与 AMD64/Intel 64 体系结构相关。箭头标记文本块的开始位置和结束位置。

IBM Z, POWER 本段内容仅与

IBM Z和POWER体系结构相关。箭头标记文本块的开始位置和结束位置。跳舞的企鹅(企鹅一章,↑其他手册):此内容参见自其他手册中的一章。

必须使用

root特权运行的命令。您往往还可以在这些命令前加上sudo命令,以非特权用户身份来运行它们。root #commandtux >sudocommand可以由非特权用户运行的命令。

tux >command注意

警告:警报通知在继续操作之前,您必须了解的不可或缺的信息。向您指出有关安全问题、潜在数据丢失、硬件损害或物理危害的警告。

重要:重要通知在继续操作之前,您必须了解的重要信息。

注意:注意通知额外信息,例如有关软件版本差异的信息。

提示:提示通知有用信息,例如指导方针或实用性建议。

4 支持 #

下面提供了 SUSE Linux Enterprise Server 的支持声明和有关技术预览的一般信息。有关产品生命周期的细节,请参见Book “升级指南”, Chapter 2 “生命周期和支持”。

如果您有权获享支持,可在Book “管理指南”, Chapter 39 “收集系统信息以供支持所用”中查找有关如何收集支持票据所需信息的细节。

4.1 SUSE Linux Enterprise Server 支持声明 #

要获得支持,您需要一个适当的 SUSE 订阅。要查看为您提供的具体支持服务,请转到 https://www.suse.com/support/ 并选择您的产品。

支持级别的定义如下:

- L1

问题判定,该技术支持级别旨在提供兼容性信息、使用支持、持续维护、信息收集,以及使用可用文档进行基本查错。

- L2

问题隔离,该技术支持级别旨在分析数据、重现客户问题、隔离问题领域,并针对级别 1 不能解决的问题提供解决方法,或作为级别 3 的准备级别。

- L3

问题解决,该技术支持级别旨在借助工程方法解决级别 2 支持所确定的产品缺陷。

对于签约的客户与合作伙伴,SUSE Linux Enterprise Server 将为除以下软件包外的其他所有软件包提供 L3 支持:

技术预览。

声音、图形、字体和作品。

需要额外客户合同的软件包。

工作站扩展模块随附的某些软件包仅享受 L2 支持。

名称以 -devel 结尾的软件包(包含头文件和类似的开发人员资源)只能同其主软件包一起接受支持。

SUSE 仅支持使用原始软件包,即,未发生更改且未重新编译的软件包。

4.2 技术预览 #

技术预览是 SUSE 提供的旨在让用户大致体验未来创新的各种软件包、堆栈或功能。随附这些预览只是为了提供方便,让您有机会在自己的环境中测试新的技术。非常希望您能提供反馈!如果您测试了技术预览,请联系 SUSE 代表,将您的体验和用例告知他们。您的反馈对于我们的未来开发非常有帮助。

但是,技术预览存在以下限制:

技术预览仍处于开发阶段。因此,它们的功能可能不完备、不稳定,或者在其他方面不适合用于生产。

技术预览不受支持。

技术预览可能仅适用于特定的硬件体系结构。

技术预览的细节和功能可能随时会发生变化。因此,可能无法升级到技术预览的后续版本,而只能进行全新安装。

我们随时可能会放弃技术预览。例如,如果 SUSE 发现某个预览不符合客户或市场的需求,或者不能证明它符合企业标准,则可能会放弃该预览。SUSE 不承诺未来将提供此类技术的受支持版本。

有关产品随附的技术预览的概述,请参见 https://www.suse.com/releasenotes/ 上的发行说明。

第 I 部分 简介 #

- 1 虚拟化技术

虚拟化技术提供了一种供计算机(主机)在主机操作系统上运行另一个操作系统(Guest 虚拟机)的方式。

- 2 虚拟化场景

虚拟化可为您的组织提供多种有用功能:提高硬件使用效率、支持旧式软件、隔离操作系统、实时迁移、灾难恢复和负载平衡。

- 3 Xen 虚拟化简介

本章介绍并阐述您在设置和管理基于 Xen 的虚拟化环境时需要了解的组件与技术。

- 4 KVM 虚拟化简介

- 5 虚拟化工具

libvirt是一个库,提供用于管理 KVM、Xen 等流行虚拟化解决方案的通用 API。该库为这些虚拟化解决方案提供规范化管理 API,以便为更高层级的管理工具提供一个跨超级管理程序的稳定接口。该库还提供用于管理 VM 主机服务器上的虚拟网络和储存的 API。每个 VM Guest 的配置都储存在 XML 文件中。您还可以使用

libvirt来远程管理 VM Guest。它支持 TLS 加密、x509 证书和 SASL 身份验证。这样,您便可以通过单个工作站集中管理 VM 主机服务器,无需再单独访问每台 VM 主机服务器。建议您使用基于

libvirt的工具来管理 VM Guest。libvirt与基于libvirt的应用程序之间的互操作性已经过测试,SUSE 的支持原则将其视为不可或缺的一部分。- 6 安装虚拟化组件

可通过两种方式安装运行 VM 主机服务器所需的虚拟化工具:

- 7 虚拟化限制和支持

目前,SUSE 支持在 AMD64/Intel 64、Arm AArch64、IBM Z 和 LinuxONE 主机上实施 KVM 全虚拟化。

1 虚拟化技术 #

虚拟化技术提供了一种供计算机(主机)在主机操作系统上运行另一个操作系统(Guest 虚拟机)的方式。

1.1 概述 #

SUSE Linux Enterprise Server 中包含最新的开源虚拟化技术:Xen 和 KVM。借助这些超级管理程序,可以使用 SUSE Linux Enterprise Server 在单个物理系统上供应、取消供应、安装、监视和管理多个虚拟机 (VM Guest)(有关详细信息,请参见超级管理程序)。SUSE Linux Enterprise Server 能够创建可运行经过修改、高度优化的半虚拟化操作系统,以及未经修改的全虚拟化操作系统的虚拟机。

操作系统中实现虚拟化的主要组件是超级管理程序(或虚拟机管理器),它是直接在服务器硬件上运行的软件层。超级管理程序控制着平台资源,并通过向每个 VM Guest 提供虚拟化的硬件接口,在多个 VM Guest 及其操作系统之间共享这些资源。

SUSE Linux Enterprise 是企业级 Linux 服务器操作系统,提供两种类型的超级管理程序:Xen 和 KVM。

包含 Xen 或 KVM 的 SUSE Linux Enterprise Server 充当虚拟化主机服务器 (VHS),支持具有各自 Guest 操作系统的 VM Guest。SUSE VM Guest 体系结构由一个超级管理程序以及多个管理组件组成,这些管理组件构成运行许多托管了应用程序的 VM Guest 的 VHS。

在 Xen 中,管理组件在通常称为 Dom0 的特权 VM Guest 中运行。在 Linux 内核充当超级管理程序的 KVM 中,管理组件直接在 VHS 上运行。

1.2 虚拟化的优点 #

虚拟化不仅能够提供与硬件服务器相同的服务,而且还具有许多优势。

首先,它降低了基础结构的成本。服务器主要用于向客户提供服务,而虚拟化的操作系统能够提供相同的服务,同时还具备以下优势:

更少的硬件:您可以在一台主机上运行多个操作系统,因此可以减轻总体硬件维护工作量。

更低的能耗/散热成本:更少的硬件意味着当您需要更多服务时,无需在电能、后备电源和散热方面投入更多成本。

节省空间:由于不需要更多的硬件服务器(服务器数量比运行的服务数量更少),因此可以节省数据中心的空间。

更少的管理工作:使用 VM Guest 可以简化基础结构的管理。

灵活性和工作效率:虚拟化提供迁移功能:实时迁移和快照。这些功能减少了停机时间,并且可以在不造成任何服务中断的情况下,让您轻松将服务从一个位置转移到另一个位置。

1.3 虚拟化模式 #

Guest 操作系统以全虚拟化 (FV) 模式或半虚拟 (PV) 模式托管在虚拟机上。每种虚拟化模式都各有其优缺点。

全虚拟化模式允许虚拟机运行未经修改的操作系统,例如 Windows* Server 2003。它可以使用二进制转换或硬件辅助虚拟化技术,例如 AMD* 虚拟化或 Intel* 虚拟化技术。在支持此功能的处理器上使用硬件辅助可以提高性能。

以全虚拟化模式托管的某些 Guest 操作系统可配置为使用 SUSE 虚拟机驱动程序包 (VMDP) 中的驱动程序,而不是源自操作系统的驱动程序。在 Windows Server 2003 这样的 Guest 操作系统上运行虚拟机驱动程序可以大幅提升性能。有关详细信息,请参见 附录 A “虚拟机驱动程序”。

要使 Guest 操作系统能够在半虚拟模式下运行,通常需要根据虚拟化环境对其进行修改。不过,以半虚拟模式运行的操作系统比全虚拟化模式下运行的操作系统的性能更佳。

当前已经过修改可在半虚拟模式下运行的操作系统称为半虚拟化操作系统,包括 SUSE Linux Enterprise Server 和 NetWare® 6.5 SP8。

1.4 I/O 虚拟化 #

VM Guest 不仅可以共享主机系统的 CPU 和内存资源,而且还能共享 I/O 子系统的此类资源。由于软件 I/O 虚拟化技术提供的性能低于裸机,因此最近开发了接近“本机”性能的硬件解决方案。SUSE Linux Enterprise Server 支持以下 I/O 虚拟化技术:

- 完全虚拟化

全虚拟化 (FV) 驱动程序会模拟受到广泛支持的真实设备,可以通过 VM Guest 中的现有驱动程序来使用这些设备。Guest 也称为硬件虚拟机 (HVM)。由于 VM 主机服务器上的物理设备可能不同于模拟的设备,超级管理程序需要先处理所有 I/O 操作,然后才能将其转交到物理设备。因此,所有 I/O 操作需要遍历两个软件层,这一过程不仅会显著影响 I/O 性能,而且还会消耗 CPU 时间。

- 半虚拟化

半虚拟化 (PV) 支持在超级管理程序与 VM Guest 之间直接通讯。与全虚拟化相比,它产生的开销更少,但性能却好很多。但使用半虚拟化技术时,无论是要支持半虚拟化 API 还是半虚拟化驱动程序,都必须修改 Guest 操作系统。有关支持半虚拟化的 Guest 操作系统列表,请参见第 7.4.1 节 “半虚拟化驱动程序的提供”。

- PVHVM

这种类型的虚拟化通过半虚拟化 (PV) 驱动程序以及 PV 中断和计时器处理增强了 HVM(请参见完全虚拟化)。

- VFIO

VFIO 是虚拟功能 I/O 的英文缩写,是适用于 Linux 的新式用户级驱动程序框架。它取代了传统的 KVM PCI 直通设备指派。VFIO 驱动程序会在受安全内存 (IOMMU) 保护的环境中向用户空间公开直接的设备访问。利用 VFIO,VM Guest 可以直接访问 VM 主机服务器上的硬件设备(直通),避免性能关键型路径中的模拟操作造成性能问题。此方法不允许共享设备 — 每个设备只能指派到一个 VM Guest。VFIO 需受 VM 主机服务器 CPU、芯片组和 BIOS/EFI 的支持。

与传统的 KVM PCI 设备指派相比,VFIO 具有以下优势:

资源访问与安全引导兼容。

设备会被隔离,并且其内存访问受到保护。

提供设备所有权模型更为灵活的用户空间设备驱动程序。

独立于 KVM 技术,不局限于 x86 体系结构。

在 SUSE Linux Enterprise Server 中,USB 和 PCI 直通设备指派方法被认为已过时,已由 VFIO 模型取代。

- SR-IOV

作为最新的 I/O 虚拟化技术,单根 I/O 虚拟化 (SR-IOV) 结合了上述技术的优点 — 在兼顾性能的同时还能与多个 VM Guest 共享设备。SR-IOV 要求使用特殊的 I/O 设备,这些设备必须能够复制资源,使它们看似是多个独立设备。每个这样的“伪”设备可由单个 Guest 直接使用。但对于网卡(举例而言),可使用的并发队列数有限,因此与半虚拟化驱动程序相比,SR-IOV 有可能会降低 VM Guest 的性能。在 VM 主机服务器上,SR-IOV 必须受 I/O 设备、CPU 和芯片组、BIOS/EFI 及超级管理程序的支持 — 有关设置说明,请参见第 14.12 节 “将主机 PCI 设备指派到 VM Guest”。

要能够使用 VFIO 和 SR-IOV 功能,VM 主机服务器需要满足以下要求:

需在 BIOS/EFI 中启用 IOMMU。

对于 Intel CPU,需在内核命令行上提供内核参数

intel_iommu=on。有关详细信息,请参见 Book “管理指南”, Chapter 14 “引导加载程序 GRUB 2”, Section 14.3.3.2 “选项卡”。VFIO 基础结构需可用。装载内核模块

vfio_pci即可做到这一点。有关详细信息,请参见 Book “管理指南”, Chapter 15 “systemd守护程序”, Section 15.6.4 “装载内核模块”。

2 虚拟化场景 #

虚拟化可为您的组织提供多种有用功能:提高硬件使用效率、支持旧式软件、隔离操作系统、实时迁移、灾难恢复和负载平衡。

2.1 服务器合并 #

可用一台大型物理服务器取代许多服务器,以便整合硬件,并将 Guest 操作系统转换为虚拟机。这样还能支持在新硬件上运行旧式软件。

更好地利用未完全运行的资源

减少所需的服务器占地空间

更有效地利用计算机资源:将多个工作负载放到同一台服务器上

简化数据中心基础结构

简化将工作负载转移到其他主机的过程,同时可避免服务停机

更快、更灵敏的虚拟机供应。

多个 Guest 操作系统可以在一台主机上运行

进行服务器整合需要特别注意以下几点:

应该认真规划维护时段

储存非常关键:必须能够支持迁移以及不断增长的磁盘使用量

必须校验您的服务器是否能够支持额外的工作负载

2.2 隔离 #

Guest 操作系统与运行这些操作系统的主机完全隔离。因此,如果虚拟机内部出现问题,主机不会受到损害。此外,一个 VM 内部出现问题不会影响其他 VM。不会在 VM 之间共享数据。

可对 VM 使用安全引导。

应避免使用 KSM。有关 KSM 的更多细节,请参见 KSM。

可将单独的 CPU 核心指派给 VM。

应禁用超线程 (HT),以避免潜在的安全问题。

VM 不应共享网络、储存或网络硬件。

使用 PCI 直通或 NUMA 等高级超级管理程序功能会对 VM 迁移功能产生不利影响。

使用半虚拟化和

virtio驱动程序通常可提高 VM 的性能和效率。

AMD 提供了一些与虚拟化安全性相关的特定功能。

2.3 灾难恢复 #

超级管理程序可以创建 VM 的快照,使之恢复到已知正常的状态或以前的任何所需状态。与直接在裸机上运行的操作系统相比,虚拟化操作系统对硬件配置的依赖较小,因此可将这些快照恢复到另一个服务器硬件,前提是该硬件运行的是相同的超级管理程序。

2.4 动态负载平衡 #

利用实时迁移,可以按需将 VM 从繁忙主机转移到容量富余的主机,轻松对基础结构中的服务进行负载平衡。

3 Xen 虚拟化简介 #

本章介绍并阐述您在设置和管理基于 Xen 的虚拟化环境时需要了解的组件与技术。

3.1 基本组件 #

基于 Xen 的虚拟化环境的基本组件包括 Xen 超级管理程序、Dom0、任意数量的其他 VM Guest、工具、命令,以及用于管理虚拟化的配置文件。运行所有这些组件的物理计算机统称为 VM 主机服务器,因为这些组件共同构成了托管虚拟机的平台。

- Xen 超级管理程序

Xen 超级管理程序(有时简称为虚拟机监视器)是一个开源软件程序,用于协调虚拟机与物理硬件之间的低级别交互。

- Dom0

虚拟机主机环境(也称为 Dom0 或控制域)由多个组件构成,其中包括:

SUSE Linux Enterprise Server,提供图形环境和命令行环境,用于管理虚拟机主机组件及其虚拟机。

注意术语 “Dom0” 指的是提供管理环境的特殊域。Dom0 能以图形模式或命令行模式运行。

基于 xenlight 库 (libxl) 的 xl 工具堆栈,用于管理 Xen Guest 域。

开源软件 QEMU,可模拟完整的计算机系统,包括处理器和各种外设。它提供以全虚拟化或半虚拟化模式托管操作系统的功能。

- 基于 Xen 的虚拟机

基于 Xen 的虚拟机(也称为 VM Guest 或 DomU)由以下组件构成:

至少一个包含可引导操作系统的虚拟磁盘。虚拟磁盘可以基于文件、分区、卷或其他类型的块设备。

每个 Guest 域的配置文件。这是遵循手册页

man 5 xl.conf中所述语法的文本文件。与控制域所提供的虚拟网络连接的多个网络设备。

- 管理工具、命令和配置文件

您可以结合使用 GUI 工具、命令与配置文件来管理和自定义虚拟化环境。

3.2 Xen 虚拟化体系结构 #

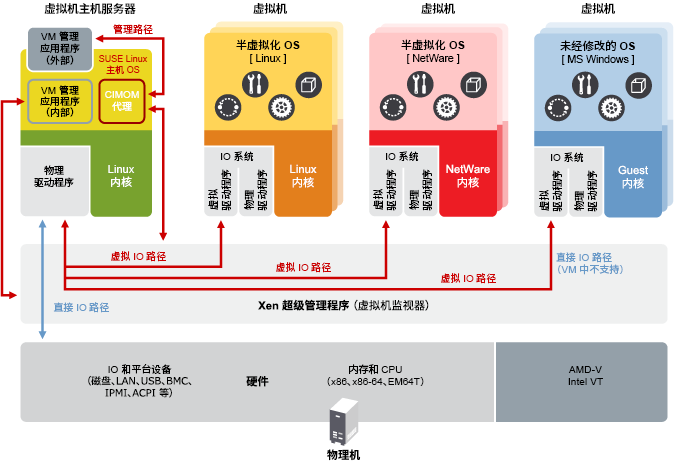

下图描绘了包含四个虚拟机的虚拟机主机。所示的 Xen 超级管理程序直接在物理硬件平台上运行。请注意,控制域也是虚拟机,不过相比所有其他虚拟机,它还承担了多项其他管理任务。

左侧所示虚拟机主机的 Dom0 运行的是 SUSE Linux Enterprise Server 操作系统。中间所示的两个虚拟机运行的是半虚拟化操作系统。右侧所示的虚拟机是全虚拟计算机,运行的是未经修改的操作系统,例如最新版本的 Microsoft Windows/Server。

4 KVM 虚拟化简介 #

4.1 基本组件 #

KVM 是支持硬件虚拟化的硬件体系结构全虚拟化解决方案(有关支持的体系结构的更多细节,请参见第 7.1 节 “体系结构支持”)。

可以直接使用 QEMU 工具或使用基于 libvirt 的堆栈来管理 VM Guest(虚拟机)、虚拟储存和虚拟网络。QEMU 工具包括 qemu-system-ARCH、QEMU 监视器、qemu-img 和 qemu-ndb。基于 libvirt 的堆栈包括 libvirt 本身,以及 virsh、virt-manager、virt-install 和 virt-viewer 等基于 libvirt 的应用程序。

4.2 KVM 虚拟化体系结构 #

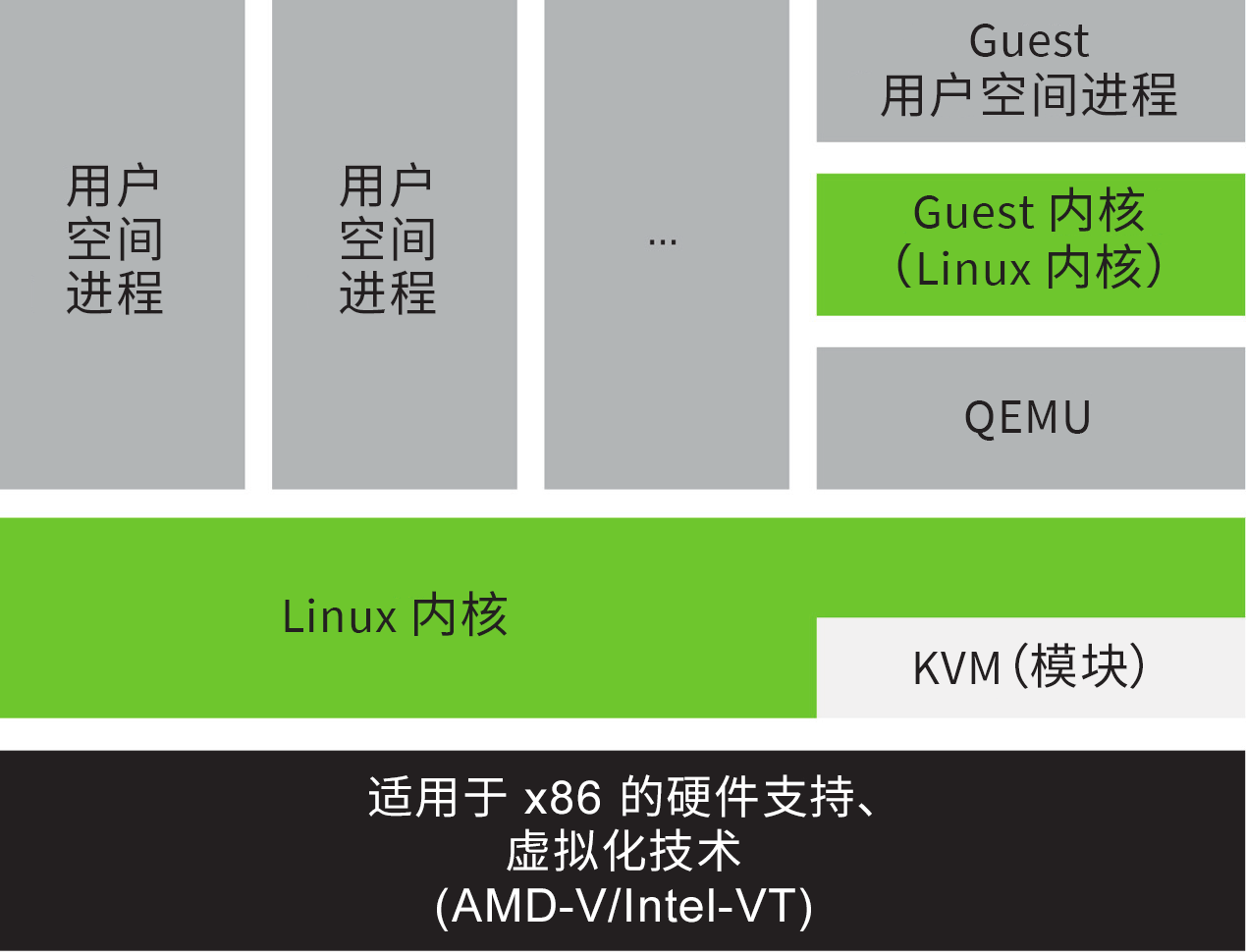

这款全虚拟化解决方案包括两个主要组件:

一组内核模块(

kvm.ko、kvm-intel.ko和kvm-amd.ko),提供核心虚拟化基础结构和特定于处理器的驱动程序。一个用户空间程序 (

qemu-system-ARCH),提供虚拟设备模拟以及用于管理 VM Guest(虚拟机)的控制机制。

术语 KVM 更适合表示内核级虚拟化功能,但在实践中,更多的是使用它来表示用户空间组件。

5 虚拟化工具 #

libvirt 是一个库,提供用于管理 KVM、Xen 等流行虚拟化解决方案的通用 API。该库为这些虚拟化解决方案提供规范化管理 API,以便为更高层级的管理工具提供一个跨超级管理程序的稳定接口。该库还提供用于管理 VM 主机服务器上的虚拟网络和储存的 API。每个 VM Guest 的配置都储存在 XML 文件中。

您还可以使用 libvirt 来远程管理 VM Guest。它支持 TLS 加密、x509 证书和 SASL 身份验证。这样,您便可以通过单个工作站集中管理 VM 主机服务器,无需再单独访问每台 VM 主机服务器。

建议您使用基于 libvirt 的工具来管理 VM Guest。libvirt 与基于 libvirt 的应用程序之间的互操作性已经过测试,SUSE 的支持原则将其视为不可或缺的一部分。

5.1 虚拟化控制台工具 #

SUSE Linux Enterprise Server 提供了以下适用于命令行的基于 libvirt 的工具:

virsh(软件包: libvirt-client)用于管理 VM Guest 的命令行工具,其功能与虚拟机管理器类似。可让您更改 VM Guest 的状态(启动、停止、暂停等)、设置新的 Guest 和设备,或编辑现有配置。

virsh还可用于编写 VM Guest 管理操作的脚本。virsh将第一个参数作为命令,将后续参数作为此命令的选项:virsh [-c URI] COMMAND DOMAIN-ID [OPTIONS]

与

zypper一样,您也可以调用不带命令的virsh。在此情况下,virsh 会启动一个外壳并等待您发出命令。此模式非常适合必须运行后续命令的情形:~> virsh -c qemu+ssh://wilber@mercury.example.com/system Enter passphrase for key '/home/wilber/.ssh/id_rsa': Welcome to virsh, the virtualization interactive terminal. Type: 'help' for help with commands 'quit' to quit virsh # hostname mercury.example.comvirt-install(软件包: virt-install)用于通过

libvirt库创建新 VM Guest 的命令行工具。它支持通过 VNC 或 SPICE 协议进行图形安装。如果指定了适当的命令行参数,virt-install能够以完全无人照管的方式运行。这样便可以轻松自动完成 Guest 安装。virt-install是虚拟机管理器使用的默认安装工具。

5.2 虚拟化 GUI 工具 #

SUSE Linux Enterprise Server 提供了以下基于 libvirt 的图形工具。所有工具由带有相应工具名称的软件包提供。

- 虚拟机管理器(软件包: virt-manager)

虚拟机管理器是用于管理 VM Guest 的桌面工具。此工具提供控制现有计算机生命周期(启动/关机、暂停/继续、保存/恢复)以及创建新 VM Guest 的功能。它可用于管理各种类型的储存设备和虚拟网络。使用它可以通过内置 VNC 查看器访问 VM Guest 的图形控制台,以及查看性能统计信息。

virt-manager支持连接到本地libvirtd来管理本地 VM 主机服务器,或连接到远程libvirtd来管理远程 VM 主机服务器。要启动虚拟机管理器,请在命令提示符处输入

virt-manager。注意要禁用通过 spice 对 VM Guest 自动进行 USB 设备重定向的功能,请结合

--spice-disable-auto-usbredir参数启动virt-manager,或运行以下命令来永久更改默认行为:tux >dconf write /org/virt-manager/virt-manager/console/auto-redirect falsevirt-viewer(软件包: virt-viewer)VM Guest 图形控制器的查看器。它使用 SPICE(默认已在 VM Guest 上配置)或 VNC 协议,并支持 TLS 和 x509 证书。可按名称、ID 或 UUID 访问 VM Guest。如果 Guest 尚未运行,可以告知该查看器先等待 Guest 启动,然后再尝试连接到控制台。

virt-viewer默认未安装,安装软件包virt-viewer后即可使用它。注意要禁用通过 spice 对 VM Guest 自动进行 USB 设备重定向的功能,请使用

--spice-usbredir-auto-redirect-filter=''参数添加一个空过滤器。yast2 vm(软件包: yast2-vm)一个 YaST 模块,可简化虚拟化工具的安装并可设置网桥:

6 安装虚拟化组件 #

可通过两种方式安装运行 VM 主机服务器所需的虚拟化工具:

在安装主机操作系统期间选择特定的系统角色。

在安装主机操作系统后运行相应的 YaST 模块。

6.1 指定系统角色 #

您可以在安装主机 SUSE Linux Enterprise Server 的过程中安装所需的全部虚拟化工具。在执行安装步骤(参见Book “部署指南”, Chapter 8 “安装步骤”)期间,您会看到屏幕。

在此屏幕中,您可以选择 或 角色。在安装操作系统期间,系统会自动执行相应软件的选择和设置。

这两个虚拟化系统角色都会创建专用的 /var/lib/libvirt 分区,并启用防火墙和 Kdump 服务。

6.2 运行 yast2-vm 模块 #

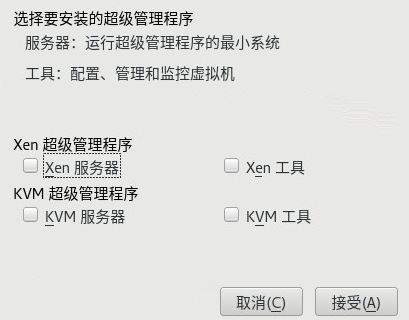

根据安装范围,可能不会在您的系统上安装任何虚拟化工具。使用 YaST 模块 › 配置超级管理程序时,会自动安装这些工具。如果 YaST 中未提供此模块,请安装软件包 yast2-vm。

6.2.1 安装 KVM #

要安装 KVM 和 KVM 工具,请执行以下操作:

确认是否已安装 yast2-vm 软件包。此软件包是 YaST 的配置工具,可以简化超级管理程序的安装过程。

启动 YaST 并选择 › 。

选择 以安装最少量的 QEMU 工具。如果还需要基于

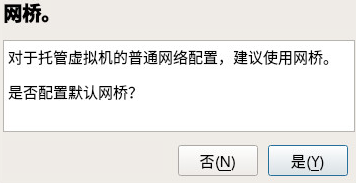

libvirt的管理堆栈,请选择 。使用确认。要为 VM Guest 启用正常网络功能,建议使用网桥。YaST 会建议自动在 VM 主机服务器上配置网桥。如果您同意执行此操作,请选择,否则请选择。

安装完成后,您便可以开始设置 VM Guest。不需要重引导 VM 主机服务器。

6.2.2 安装 Xen #

要安装 Xen 和 Xen 工具,请执行以下操作:

启动 YaST 并选择 › 。

选择 以安装最少量的 Xen 工具。如果还需要基于

libvirt的管理堆栈,请选择 。单击确认。要为 VM Guest 启用正常网络功能,建议使用网桥。YaST 会建议自动在 VM 主机服务器上配置网桥。如果您同意执行此操作,请选择,否则请选择。

安装完成后,您需使用 Xen 内核重引导计算机。

提示:默认引导内核如果一切按预期进行,请使用 YaST 更改默认引导内核,并将支持 Xen 的内核设置为默认内核。有关更改默认内核的详细信息,请参见Book “管理指南”, Chapter 14 “引导加载程序 GRUB 2”, Section 14.3 “使用 YaST 配置引导加载程序”。

6.3 模式 #

可以使用 Zypper 和模式来安装虚拟化软件包。运行 zypper in -t pattern

PATTERN 命令。可用模式包括:

- KVM

kvm_server:为 KVM VM 主机服务器设置用于进行管理的 QEMU 工具kvm_tools:安装用于管理和监视 VM Guest 的libvirt工具

- Xen

xen_server:为 Xen VM 主机服务器设置用于进行管理的 Xen 工具xen_tools:安装用于管理和监视 VM Guest 的libvirt工具

6.4 安装 UEFI 支持 #

KVM Guest 使用 OVMF 固件来支持安全引导。Xen HVM Guest 也支持从 OVMF 固件引导,但不支持安全引导。

UEFI 支持由 OVMF(开放虚拟机固件)提供。要启用 UEFI 引导,请先安装 qemu-ovmf-x86_64 或 qemu-uefi-aarch64 软件包,具体取决于 Guest 的体系结构。

系统会自动选择虚拟机使用的固件。自动选择是根据

qemu-ovmf-ARCH 软件包中的 *.json 文件做出的。libvirt QEMU 驱动程序会在装载时分析这些文件,因此知道各种固件的功能。然后,当用户选择固件类型以及任何所需功能(例如,安全引导支持)时,libvirt 能够找到符合用户要求的固件。

例如,要指定支持安全引导的 EFI,请使用以下配置:

<os firmware='efi'> <loader secure='yes'/> </os>

软件包 qemu-ovmf-ARCH 中包含以下文件:

root #rpm -ql qemu-ovmf-x86_64[...] /usr/share/qemu/ovmf-x86_64-ms-code.bin /usr/share/qemu/ovmf-x86_64-ms-vars.bin /usr/ddshare/qemu/ovmf-x86_64-ms.bin /usr/share/qemu/ovmf-x86_64-suse-code.bin /usr/share/qemu/ovmf-x86_64-suse-vars.bin /usr/share/qemu/ovmf-x86_64-suse.bin [...]

*-code.bin 文件是 UEFI 固件文件。*-vars.bin 文件是对应的变量储存映像,可用作每个 VM 的非易失性储存模板。首次创建 VM 时,libvirt 会将指定的 vars 模板复制到每个 VM 路径的 /var/lib/libvirt/qemu/nvram/ 下。名称中不包含 code 或 vars 的文件可用作单个 UEFI 映像。它们没有太大的作用,因为每次经过 VM 关开机周期后,UEFI 变量都不会保存。

*-ms*.bin 文件包含存放在实际硬件上的 Microsoft 密钥。因此,在 libvirt 中它们已配置为默认设置。同样,*-suse*.bin 文件包含预安装的 SUSE 密钥。还有一组不包含预安装密钥的文件。

有关细节,请参见使用 UEFI 和安全引导和 http://www.linux-kvm.org/downloads/lersek/ovmf-whitepaper-c770f8c.txt。

6.5 在 KVM 中启用嵌套虚拟化 #

KVM 的嵌套式虚拟化仍为技术预览版。此版本是出于测试目的提供的,我们不提供相关支持。

嵌套式 Guest 是 KVM Guest 中运行的 KVM Guest。在描述嵌套式 Guest 时,我们会用到以下虚拟化层:

- L0

运行 KVM 的裸机主机。

- L1

在 L0 上运行的虚拟机。由于它可以在另一个 KVM 上运行,因此称为 Guest 超级管理程序。

- L2

在 L1 上运行的虚拟机。称为嵌套式 Guest。

嵌套式虚拟化具有诸多优势。它可在以下场景中为您提供便利:

在云环境中直接使用所选的超级管理程序管理您自己的虚拟机。

将超级管理程序及其 Guest 虚拟机作为单个实体进行实时迁移。

使用嵌套式虚拟化进行软件开发和测试。

要暂时启用嵌套功能,请去除该模块,然后使用 nested KVM 模块参数重新装载该模块:

对于 Intel CPU,请运行:

tux >sudomodprobe -r kvm_intel && modprobe kvm_intel nested=1对于 AMD CPU,请运行:

tux >sudomodprobe -r kvm_amd && modprobe kvm_amd nested=1

要永久启用嵌套功能,请根据您的 CPU,在 /etc/modprobe.d/kvm_*.conf 文件中启用 nested KVM 模块参数:

对于 Intel CPU,请编辑

/etc/modprobe.d/kvm_intel.conf并添加下面一行:options kvm_intel nested=Y

对于 AMD CPU,请编辑

/etc/modprobe.d/kvm_amd.conf并添加下面一行:options kvm_amd nested=Y

如果 L0 主机能够嵌套,则您可以通过以下方式之一启动 L1 Guest:

使用

-cpu hostQEMU 命令行选项。将

vmx(对于 Intel CPU)或svm(对于 AMD CPU)CPU 功能添加到-cpuQEMU 命令行选项,用于启用虚拟 CPU 的虚拟化。

7 虚拟化限制和支持 #

7.1 体系结构支持 #

7.1.1 KVM 硬件要求 #

目前,SUSE 支持在 AMD64/Intel 64、Arm AArch64、IBM Z 和 LinuxONE 主机上实施 KVM 全虚拟化。

在 AMD64/Intel 64 体系结构上,KVM 是围绕 AMD* (AMD-V) 和 Intel* (VT-x) CPU 中包含的硬件虚拟化功能设计的。它支持芯片组和 PCI 设备的虚拟化功能,例如 I/O 内存映射单元 (IOMMU) 和单根 I/O 虚拟化 (SR-IOV)。您可以使用以下命令测试您的 CPU 是否支持硬件虚拟化:

tux >egrep '(vmx|svm)' /proc/cpuinfo如果此命令未返回任何输出,则表示您的处理器不支持硬件虚拟化,或者已在 BIOS 或固件中禁用此功能。

以下网站指出了支持硬件虚拟化的 AMD64/Intel 64 处理器:http://ark.intel.com/Products/VirtualizationTechnology(针对 Intel CPU),以及 http://products.amd.com/(针对 AMD CPU)。

在 Arm 体系结构上,Armv8-A 处理器支持虚拟化。

仅当 CPU 硬件虚拟化功能可用时,才会装载 KVM 内核模块。

VM 主机服务器的一般性最低硬件要求与Book “部署指南”, Chapter 2 “在 AMD64 和 Intel 64 上安装”, Section 2.1 “硬件要求”中概述的相同。不过,对于每个虚拟化的 Guest 都需要提供额外的 RAM。此额外 RAM 量应至少与物理安装所需的 RAM 量相同。另外,强烈建议为每个运行中的 Guest 至少配备一个处理器核心或超线程。

Arm AArch64 是个持续发展的平台。它不遵循传统的标准与合规性认证计划来实现与操作系统和超级管理程序的互操作性。请让您的供应商提供针对 SUSE Linux Enterprise Server 的支持声明。

不支持在 POWER 平台上运行 KVM 或 Xen 超级管理程序。

7.1.2 Xen 硬件要求 #

SUSE 支持 AMD64/Intel 64 上的 Xen。

7.2 超级管理程序限制 #

每个服务包 (SP) 的发行说明中都概述了 Xen 和 KVM 的新功能和虚拟化限制。

仅支持 SUSE Linux Enterprise Server 官方储存库中包含的软件包。相反,packagehub 中提供的所有可选子软件包和插件(对于 QEMU 为 libvirt)均不受支持。

有关每个主机的最大虚拟 CPU 总数,请参见《虚拟化最佳实践指南》中有关过量分配物理 CPU 的建议。虚拟 CPU 总数应与可用物理 CPU 数成正比。

我们已从 32 位版本的 SUSE Linux Enterprise Server 11 SP2 中去除虚拟化主机设施。32 位 Guest 不受影响,可以使用提供的 64 位超级管理程序为其提供全面支持。

7.2.1 KVM 限制 #

在 AMD64/Intel 64 上运行 Linux Guest 的 SUSE Linux Enterprise Server 15 SP3 主机所支持(已经过测试)虚拟化的限制。对于其他操作系统,请咨询具体的供应商。

|

每个 VM 的最大虚拟 CPU 数 |

256 |

|

每个 VM 的最大内存 |

6 TiB |

KVM 主机限制与 SUSE Linux Enterprise Server 相同(请参见发行说明的相应章节),但以下限制除外:

每个 VM 的最大虚拟 CPU 数:请参见 https://documentation.suse.com/sles-15/html/SLES-all/article-virtualization-best-practices.html#sec-vt-best-perf-cpu-assign 上的《虚拟化最佳实践指南》中有关过量分配物理 CPU 的建议。虚拟 CPU 总数应与可用物理 CPU 数成正比。

7.2.2 Xen 限制 #

|

每个 VM 的最大虚拟 CPU 数 |

128 (HVM)、64 (HVM Windows Guest) 或 512 (PV) |

|

每个 VM 的最大内存 |

2 TiB(64 位 Guest)、16 GiB(具有 PAE 的 32 位 Guest) |

|

最大物理 CPU 总数 |

1024 |

|

每个主机的最大虚拟 CPU 总数 |

请参见 https://documentation.suse.com/sles-15/html/SLES-all/article-virtualization-best-practices.html#sec-vt-best-perf-cpu-assign 上的《虚拟化最佳实践指南》中有关过量分配物理 CPU 的建议。虚拟 CPU 总数应与可用物理 CPU 数成正比 |

|

最大物理内存 |

16 TiB |

7.3 支持的主机环境(超级管理程序) #

本节介绍在各种虚拟化主机(超级管理程序)上作为 Guest 操作系统运行的 SUSE Linux Enterprise Server 15 SP3 的支持状态。

|

SUSE Linux Enterprise Server |

超级管理程序 |

|---|---|

|

SUSE Linux Enterprise Server 11SP4 |

Xen 和 KVM |

|

SUSE Linux Enterprise Server 12 SP1 到 SP5 |

Xen 和 KVM |

|

SUSE Linux Enterprise Server 15 GA 到 SP3 |

Xen 和 KVM |

您也可以在 SUSE YES 认证数据库中进行搜索

7.4 支持的 Guest 操作系统 #

本节列出了在 SUSE Linux Enterprise Server 15 SP3 上虚拟化且适用于 KVM 和 Xen 超级管理程序的各种 Guest 操作系统的支持状态。

SUSE Linux Enterprise Server 11SP4

SUSE Linux Enterprise Server 12 SP3、12 SP4、12 SP5

SUSE Linux Enterprise Server 15 GA、15 SP1、15 SP2、15 SP3

Windows Server 2008 SP2+、2008 R2 SP1+、2012+、2012 R2+、2016、2019

Oracle Linux 6、7、8(仅适用于 KVM 超级管理程序)

SLED 15 SP3

有关可用组合和受支持版本的列表,请参见扩展支持文档。

从 RHEL 7.2 开始,Red Hat 去除了 Xen PV 驱动程序。

Windows 8+、8.1+、10+

在其他组合中提供 L2 支持,但只在可行的情况下才提供修复。SUSE 会对主机操作系统(超级管理程序)提供全面支持。Guest 操作系统问题需要在相应操作系统供应商的支持下予以解决。如果修复某个问题同时涉及到主机环境和 Guest 环境,则客户需要联系 SUSE 和 Guest VM 操作系统供应商。

所有 Guest 操作系统既支持全虚拟化,也支持半虚拟化。只有以下操作系统例外:Windows 系统,它们只支持全虚拟化(但可以使用 PV 驱动程序:https://www.suse.com/products/vmdriverpack/);OES 操作系统,它们只支持半虚拟化。

除非另有说明,否则所有 Guest 操作系统在 32 位和 64 位环境中均受支持。

7.4.1 半虚拟化驱动程序的提供 #

为了提升 Guest 操作系统的性能,我们将会提供半虚拟化驱动程序(如果有)。尽管这些驱动程序不是必需的,但我们强烈建议使用。半虚拟化驱动程序的提供方式如下:

- SUSE Linux Enterprise Server 12/12 SP1/12 SP2

包含在内核中

- SUSE Linux Enterprise Server 11/11 SP1/11 SP2/11 SP3/11 SP4

包含在内核中

- SUSE Linux Enterprise Server 10SP4

包含在内核中

- Red Hat

从 Red Hat Enterprise Linux 5.4 开始提供。从 Red Hat Enterprise Linux 7.2 开始,Red Hat 已去除了 PV 驱动程序。

- Windows

SUSE 开发了适用于 Windows 的基于 virtio 的驱动程序,这些驱动程序包含在虚拟机驱动程序包 (VMDP) 中。有关详细信息,请参见 https://www.suse.com/products/vmdriverpack/。

从 SUSE Linux Enterprise Server 12 SP2 开始,我们已改用 PVops 内核。我们不再使用专用的 kernel-xen 软件包。Dom0 kernel-default+kernel-xen 已被 kernel-default取代,domU PV kernel-xen 已被 kernel-default取代,domU PV kernel-default+xen-kmp 已被 kernel-default取代;dom0 工具栈仍会装载所有后端驱动程序。

7.5 支持的 VM 迁移场景 #

SUSE Linux Enterprise Server 支持将虚拟机从一台物理主机迁移到另一台物理主机。

7.5.1 脱机迁移场景 #

SUSE 支持脱机迁移:关闭 Guest VM,然后将其迁移到运行不同 SLE 产品(从 SLE 12 到 SLE 15 SPX)的主机。对于以下主机操作系统组合,全面支持 (L3) 从一台主机的 Guest 迁移到另一台主机的 Guest:

|

主机源产品名称 |

目标主机 |

|---|---|

|

SUSE Linux Enterprise Server 12SP3 |

SLES 12 SP3 |

|

SLES 12 SP4 | |

|

SLES 12 SP5 | |

|

SLES 15 GA |

|

主机源产品名称 |

目标主机 |

|---|---|

|

SUSE Linux Enterprise Server 12SP4 |

SLES 12 SP4 |

|

SLES 12 SP5 | |

|

SLES 15(仅适用于 KVM) | |

|

SLES 15 SP1 |

|

主机源产品名称 |

目标主机 |

|---|---|

|

SUSE Linux Enterprise Server 12SP5 |

SLES 12 SP5 |

|

SLES 15 SP1 | |

|

SLES 15 SP2 |

|

主机源产品名称 |

目标主机 |

|---|---|

|

SUSE Linux Enterprise Server 15 GA |

SLES 15 GA |

|

SLES 15 SP1 | |

|

SLES 15 SP2 | |

|

SLES 15 SP3 |

|

主机源产品名称 |

目标主机 |

|---|---|

|

SUSE Linux Enterprise Server 15SP1 |

SLES 15 SP1 |

|

SLES 15 SP2 | |

|

SLES 15 SP3 |

|

主机源产品名称 |

目标主机 |

|---|---|

|

SUSE Linux Enterprise Server 15SP2 |

SLES 15 SP2 |

|

SLES 15 SP3 |

7.5.2 实时迁移场景 #

本节列出了在 SLES 上运行虚拟化时各种实时迁移场景的支持状态。另请参见支持的实时迁移的要求。全面支持以下主机操作系统组合(根据相应的产品生命周期,支持级别为 L3)。

|

主机源产品名称 |

目标主机 |

|---|---|

|

SUSE Linux Enterprise Server 12SP3 |

SLES 12 SP4 |

|

主机源产品名称 |

目标主机 |

|---|---|

|

SUSE Linux Enterprise Server 12SP4 |

SLES 12 SP4 |

|

SLES 12 SP5 | |

|

SLES 15 GA(仅适用于 KVM) |

|

主机源产品名称 |

目标主机 |

|---|---|

|

SUSE Linux Enterprise Server 12SP5 |

SLES 12 SP5 |

|

SLES 15 SP1 |

|

主机源产品名称 |

目标主机 |

|---|---|

|

SUSE Linux Enterprise Server 15 GA |

SLES 15 GA |

|

SLES 15 SP1 |

|

主机源产品名称 |

目标主机 |

|---|---|

|

SUSE Linux Enterprise Server 15SP1 |

SLES 15 SP1 |

|

SLES 15 SP2 |

|

主机源产品名称 |

目标主机 |

|---|---|

|

SUSE Linux Enterprise Server 15SP2 |

SLES 15 SP2 |

|

SLES 15 SP3 |

|

主机源产品名称 |

目标主机 |

|---|---|

|

SUSE Linux Enterprise Server 15SP3 |

SLES 15 SP3 |

| SLES 15 SP4(如果可用) |

SUSE 始终支持在运行 SLES 的主机之间实时迁移虚拟机,但这两个 SLES 版本的服务包编号必须是连续的。例如,从 SLES 15 SP2 迁移到 SLES 15 SP3。

SUSE 致力于为以下实时迁移提供支持:在 SUSE Linux Enterprise Server 的同一主要版本中,将虚拟机从运行 LTSS 所涵盖的服务包的主机迁移到运行更新服务包的主机。例如,将虚拟机从 SLES 12 SP2 主机迁移到 SLES 12 SP5 主机。对于从 LTSS 迁移到更新的服务包的场景,SUSE 只会执行极简单的测试,建议在尝试迁移关键的虚拟机之前执行全面的现场测试。

7.6 功能支持 #

7.6.1 Xen 主机 (Dom0) #

Dom0) #不支持在运行时添加或去除物理 CPU,但可以脱机添加或去除每个 VM Guest 的虚拟 CPU。

7.6.2 Xen 半虚拟化 Guest (DomU) #

|

功能 |

Xen |

|---|---|

|

虚拟网络和虚拟块设备热插拔 |

是 |

|

虚拟 CPU 热插拔 |

是 |

|

虚拟 CPU 过量分配 |

是 |

|

动态虚拟内存大小调整 |

是 |

|

VM 保存和恢复 |

是 |

|

VM 实时迁移 |

是(请参见第 11.7.1 节 “迁移要求”) |

|

使用 GDBC 进行高级调试 |

是 |

|

对 VM 可见的 Dom0 度量 |

是 |

|

内存气球 |

是 |

|

PCI 直通 |

是(不包括 NetWare Guest) |

对于实时迁移,源体系结构和目标体系结构均需要匹配;即处理器(AMD* 或 Intel*)必须相同。除非使用了 CPU ID 掩码(例如,使用 Intel FlexMigration),否则目标的处理器修订版应该与源相同或者比源更新。如果在不同系统之间移动 VM,那么这些规则适用于每一次移动。为了避免优化的代码在运行时或应用程序启动期间失败,源 CPU 和目标 CPU 需要公开相同的处理器扩展。Xen 透明地向 VM 公开物理 CPU 扩展。总而言之,Guest 可以是 32 位或 64 位,但 VHS 必须相同。

对于支持 Intel FlexMigration 的计算机,CPU-ID 掩码和错误引发可以提高跨 CPU 迁移的灵活性。

7.6.3 全虚拟化 Guest #

|

功能 |

Xen |

KVM |

|---|---|---|

|

虚拟网络和虚拟块设备热插拔 |

是 |

是 |

|

虚拟 CPU 热插拔 |

否 |

否 |

|

虚拟 CPU 过量分配 |

是 |

是 |

|

动态虚拟内存大小调整 |

是 |

是 |

|

VM 保存和恢复 |

是 |

是 |

|

VM 实时迁移 |

是(请参见第 11.7.1 节 “迁移要求”) |

是 |

|

VM 快照 |

是 |

是 |

|

使用 GDBC 进行高级调试 |

是 |

是 |

|

对 VM 可见的 Dom0 度量 |

是 |

是 |

|

PCI 直通 |

是 |

是 |

对于 KVM,有关支持的限制、功能、建议的设置和方案的详细说明以及其他有用信息均在 kvm-supported.txt 中提供。此文件是 KVM 软件包的一部分,可在 /usr/share/doc/packages/kvm 中找到。

7.7 嵌套虚拟化 #

使用嵌套虚拟化可在一个 VM 的内部运行另一个虚拟机,同时仍可利用主机的硬件加速功能。嵌套虚拟化的性能极差,并且在调试时会提高复杂性。嵌套虚拟化主要用于测试目的。在 SUSE Linux Enterprise Server 中,嵌套虚拟化是作为技术预览提供的。此版本仅用于测试目的,我们不提供相关支持。用户可以报告 bug,但这些 bug 的处理优先级较低。此外我们明确指出,在使用嵌套虚拟化的情况下,不支持实时迁移或保存/恢复 VM。

第 II 部分 使用 libvirt 管理虚拟机 #

- 8 启动和停止

libvirtd 虚拟化解决方案(KVM、Xen)与 libvirt API 之间的通讯由

libvirtd守护程序来管理。此守护程序需在 VM 主机服务器上运行。可能在远程计算机上运行的 libvirt 客户端应用程序(例如 virt-manager)会与 VM 主机服务器上运行的libvirtd通讯。libvirtd 使用本机超级管理程序 API 来处理请求。使用以下命令可以启动和停止libvirtd或检查其状态:- 9 准备 VM 主机服务器

在可以安装 Guest 虚拟机之前,需要准备好 VM 主机服务器,以便为 Guest 提供正常运行所需的资源。具体而言,您需要配置:

- 10 Guest 安装

VM Guest 由一个包含操作系统和数据文件的映像以及一个描述 VM Guest 虚拟硬件资源的配置文件构成。VM Guest 托管在 VM 主机服务器上并受其控制。本节提供有关安装 VM Guest 的概括说明。有关支持的 VM Guest 列表,请参见第 7 章 “虚拟化限制和支持”。

- 11 基本 VM Guest 管理

使用虚拟机管理器图形应用程序或者在命令行上使用

virsh可以完成大部分管理任务,例如启动或停止 VM Guest。而要通过 VNC 连接到图形控制台,就只能从图形用户界面进行。- 12 连接和授权

如果您要管理多个 VM 主机服务器,而每个服务器又托管了多个 VM Guest,那么管理工作很快就会变得困难起来。

libvirt的一个优势是,它能够一次连接到多个 VM 主机服务器,提供单个接口用于管理所有 VM Guest 以及连接其图形控制台。- 13 高级储存主题

本章介绍有关从 VM 主机服务器的角度操作储存设备的高级主题。

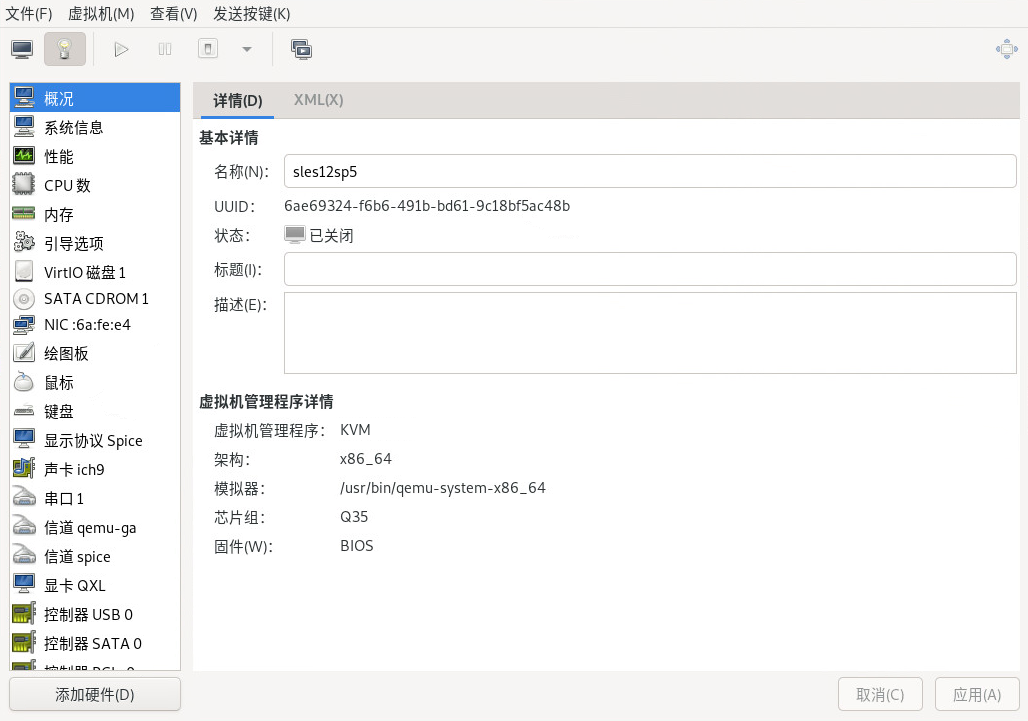

- 14 使用虚拟机管理器配置虚拟机

虚拟机管理器的视图提供有关 VM Guest 完整配置和硬件要求的深入信息。使用此视图还可以更改 Guest 配置,或者添加和修改虚拟硬件。要访问此视图,请在虚拟机管理器中打开 Guest 的控制台,然后从菜单中选择 › ,或者在工具栏中单击。

- 15 使用

virsh配置虚拟机 您也可以在命令行上使用

virsh来配置虚拟机 (VM),以此替代虚拟机管理器。使用virsh可以控制 VM 的状态、编辑 VM 的配置,甚至将 VM 迁移到另一台主机。下列章节介绍如何使用virsh来管理 VM。- 16 使用 Vagrant 管理虚拟机

Vagrant 工具为创建、部署和管理虚拟开发环境提供统一的工作流程。下列章节介绍如何使用 Vagrant 管理虚拟机。

- 17 Xen 到 KVM 的迁移指南

随着服务器管理员越来越广泛地使用 KVM 虚拟化解决方案,他们中的许多人都需要有一个途径将其基于 Xen 的现有环境迁移到 KVM。目前还没有成熟的工具可自动将 Xen VM 转换为 KVM。不过,有一个技术解决方案有助于将 Xen 虚拟机转换为 KVM。下面的信息和过程可帮助您执行这样的迁移。

8 启动和停止 libvirtd #

虚拟化解决方案(KVM、Xen)与 libvirt API 之间的通讯由 libvirtd 守护程序来管理。此守护程序需在 VM 主机服务器上运行。可能在远程计算机上运行的 libvirt 客户端应用程序(例如 virt-manager)会与 VM 主机服务器上运行的 libvirtd 通讯。libvirtd 使用本机超级管理程序 API 来处理请求。使用以下命令可以启动和停止 libvirtd 或检查其状态:

tux >sudosystemctl start libvirtdtux >sudosystemctl status libvirtd libvirtd.service - Virtualization daemon Loaded: loaded (/usr/lib/systemd/system/libvirtd.service; enabled) Active: active (running) since Mon 2014-05-12 08:49:40 EDT; 2s ago [...]tux >sudosystemctl stop libvirtdtux >sudosystemctl status libvirtd [...] Active: inactive (dead) since Mon 2014-05-12 08:51:11 EDT; 4s ago [...]

要在系统引导时自动启动 libvirtd,请使用 YaST 模块或输入以下命令将其激活:

tux >sudosystemctl enable libvirtd

libvirtd 和 xendomains

如果 libvirtd 无法启动,请检查是否装载了 xendomains 服务:

tux > systemctl is-active xendomains

active

如果该命令返回 active,您需要停止 xendomains,然后才可以启动 libvirtd 守护程序。如果您希望在重引导后也要启动 libvirtd,另外还需禁止 xendomains 自动启动。禁用该服务:

tux >sudosystemctl stop xendomainstux >sudosystemctl disable xendomainstux >sudosystemctl start libvirtd

xendomains 和 libvirtd 提供的是相同的服务,如果同时使用,可能会互相干扰。例如,xendomains 可能会尝试启动已由 libvirtd 启动的 domU。

9 准备 VM 主机服务器 #

在可以安装 Guest 虚拟机之前,需要准备好 VM 主机服务器,以便为 Guest 提供正常运行所需的资源。具体而言,您需要配置:

网络:使 Guest 能够利用主机提供的网络连接。

一个可从主机访问的储存池,以使 Guest 能够储存其磁盘映像。

9.1 配置网络 #

有两个常用网络配置可为 VM Guest 提供网络连接:

一个网桥。这是为 Guest 提供网络连接的默认方式,也是建议的方式。

一个已启用转发的虚拟网络。

9.1.1 网桥 #

网桥配置为 VM Guest 提供第 2 层交换机,可以基于与端口关联的 MAC 地址在网桥上的端口之间交换第 2 层以太网包。这样 VM Guest 便可通过第 2 层连接访问 VM 主机服务器的网络。此配置类似于将 VM Guest 的虚拟以太网网线连接到与主机以及主机上运行的其他 VM Guest 共享的集线器。该配置通常称为共享物理设备。

当 SUSE Linux Enterprise Server 配置为 KVM 或 Xen 超级管理程序时,网桥配置是它的默认配置。如果您只想将 VM Guest 连接到 VM 主机服务器的 LAN,则此为首选配置。

9.1.1.1 使用 YaST 管理网桥 #

本节包含使用 YaST 添加或去除网桥的过程。

9.1.1.1.1 添加网桥 #

要在 VM 主机服务器上添加网桥,请执行以下步骤:

启动 › › 。

激活选项卡并单击。

从列表中选择,然后在项中输入网桥设备接口名称。单击按钮继续。

在选项卡中指定网络细节,例如 DHCP/静态 IP 地址、子网掩码或主机名。

仅当您也将设备指派到与 DHCP 服务器连接的网桥时,才有作用。

如果您打算创建不与实际网络设备连接的虚拟网桥,请使用。在这种情况下,比较好的做法是使用私用 IP 地址范围(例如

192.168.0.0/16、172.16.0.0/12或10.0.0.0/8)内的地址。要创建仅在不同 Guest 之间充当连接点,而不连接到主机系统的网桥,请将 IP 地址设置为

0.0.0.0,将子网掩码设置为255.255.255.255。网络脚本会将此特殊地址作为未设置的 IP 地址来处理。激活选项卡,然后激活您要包含在网桥中的网络设备。

单击返回到选项卡,然后单击确认。现在,新网桥应在 VM 主机服务器上处于活动状态。

9.1.1.1.2 删除网桥 #

要删除现有网桥,请执行以下步骤:

启动 › › 。

从选项卡上的列表中选择您要删除的网桥设备。

单击以删除该网桥,然后单击确认。

9.1.1.2 通过命令行管理网桥 #

本节包含使用命令行添加或去除网桥的过程。

9.1.1.2.1 添加网桥 #

要在 VM 主机服务器上添加新网桥设备,请执行以下步骤:

在要创建新网桥的 VM 主机服务器上以

root身份登录。为新网桥选择一个名称(在本示例中为 virbr_test),然后运行以下命令

root #ip link add name VIRBR_TEST type bridge检查是否已在 VM 主机服务器上创建了网桥:

root #bridge vlan [...] virbr_test 1 PVID Egress Untaggedvirbr_test存在,但不与任何物理网络接口相关联。启动该网桥,并在其中添加一个网络接口:

root #ip link set virbr_test uproot #ip link set eth1 master virbr_test重要:网络接口必须未被使用只能指派尚未被其他网桥使用的网络接口。

(可选)启用 STP(请参见生成树协议)

root #bridge link set dev virbr_test cost 4

9.1.1.2.2 删除网桥 #

要通过命令行删除 VM 主机服务器上的现有网桥设备,请执行以下步骤:

在要从中删除现有网桥的 VM 主机服务器上以

root身份登录。列出现有网桥,以识别要去除的网桥的名称:

root #bridge vlan [...] virbr_test 1 PVID Egress Untagged删除网桥:

root #ip link delete dev virbr_test

9.1.1.3 使用 VLAN 接口 #

有时需要在两台 VM 主机服务器之间或者 VM Guest 系统之间创建私用连接。例如,将 VM Guest 迁移到其他网段中的主机时,或者创建只有 VM Guest 系统能够连接到的私用网桥(即使是在不同 VM 主机服务器系统上运行)时。构建此类连接的简单方法是设置 VLAN 网络。

VLAN 接口通常在 VM 主机服务器上设置。它们可以将不同的 VM 主机服务器系统互连,或者可以设置为其他仅限虚拟连接的网桥的物理接口。甚至可以创建一个使用 VLAN 作为物理接口(该接口在 VM 主机服务器中没有 IP 地址)的网桥。这样,Guest 系统就无法通过此网络访问主机。

运行 YaST 模块 › 。执行以下过程设置 VLAN 设备:

单击以创建新网络接口。

在对话框中,选择 。

将的值更改为 VLAN 的 ID。请注意,VLAN ID

1通常用于管理目的。单击。

将 VLAN 设备应连接到的借口选择为下面的 。如果所需的接口未显示在列表中,请先在不指定 IP 地址的情况下设置此接口。

选择将 IP 地址指派到 VLAN 设备的所需方法。

单击完成配置。

还可将 VLAN 接口用作网桥的物理接口。这样便可以连接多个仅限 VM 主机服务器的网络,以及实时迁移与此类网络连接的 VM Guest 系统。

YaST 并非始终允许不设置 IP 地址。但有时可能需要这种功能,尤其是应该连接仅限 VM 主机服务器的网络时。在这种情况下,请使用特殊地址 0.0.0.0 和网络掩码 255.255.255.255。系统脚本会将此地址当作未设置 IP 地址来处理。

9.1.2 虚拟网络 #

libvirt 管理的虚拟网络类似于桥接的网络,但通常不与 VM 主机服务器建立第 2 层连接。与 VM 主机服务器物理网络的连接通过第 3 层转发来实现,与第 2 层桥接网络相比,第 3 层转发在 VM 主机服务器上引入了额外的包处理。虚拟网络还为 VM Guest 提供 DHCP 和 DNS 服务。有关 libvirt 虚拟网络的详细信息,请参见 https://libvirt.org/formatnetwork.html 上的《Network XML format》(网络 XML 格式)文档。

SUSE Linux Enterprise Server 上的标准 libvirt 安装中已预定义了一个名为 default 的虚拟网络。该虚拟网络提供网络的 DHCP 和 DNS 服务,并可使用网络地址转换 (NAT) 转发模式连接到 VM 主机服务器的物理网络。尽管 default 虚拟网络是预定义的,但它需要由管理员显式启用。有关 libvirt 支持的转发模式的详细信息,请参见 https://libvirt.org/formatnetwork.html#elementsConnect 上《Network XML format》(网络 XML 格式)文档中的“Connectivity”(连接)一节。

libvirt 管理的虚拟网络可用于满足各种用例,但通常是在进行无线连接或动态/零星网络连接的 VM 主机服务器(例如便携式计算机)上使用。虚拟网络也适用于 VM 主机服务器网络的 IP 地址有限的情形,可用来在虚拟网络与 VM 主机服务器的网络之间转发包。不过,大多数服务器用例更适合网桥配置,其中的 VM Guest 会连接到 VM 主机服务器的 LAN。

在 libvirt 虚拟网络中启用转发模式会通过将 /proc/sys/net/ipv4/ip_forward 和 /proc/sys/net/ipv6/conf/all/forwarding 设置为 1 在 VM 主机服务器中启用转发,而这本质上是将 VM 主机服务器转变成路由器。重启动 VM 主机服务器的网络可能会重设置值并禁用转发。要避免这种行为,请通过编辑 /etc/sysctl.conf 文件并添加以下设置,在 VM 主机服务器中显式启用转发:

net.ipv4.ip_forward = 1

net.ipv6.conf.all.forwarding = 1

9.1.2.1 使用虚拟机管理器管理虚拟网络 #

您可以使用虚拟机管理器定义、配置和操作虚拟网络。

9.1.2.1.1 定义虚拟网络 #

启动虚拟机管理器。在可用连接列表中,右键单击您需要为其配置虚拟网络的连接名称,然后选择。

在窗口中,单击选项卡。您会看到可用于当前连接的所有虚拟网络的列表。右侧会显示选定虚拟网络的细节。

图 9.1︰ 连接细节 #要添加新虚拟网络,请单击。

为新虚拟机指定名称。

图 9.2︰ 创建虚拟网络 #指定网络模式。对于 和类型,可以指定要将网络通讯转发到的设备。(网络地址转换)会重新映射虚拟网络地址空间并允许共享单个 IP 地址,不会对来自虚拟网络的数据包进行任何转换即将其转发到 VM 主机服务器的物理网络。

如果您需要 IPv4 网络,请选中 并指定 IPv4 网络地址。如果您需要 DHCP 服务器,请选中 并指定可指派的 IP 地址范围。

如果您需要 IPv6 网络,请选中 并指定 IPv6 网络地址。如果您需要 DHCP 服务器,请选中 并指定可指派的 IP 地址范围。

如果您要指定与虚拟网络名称不同的域名,请在 下选择,并在此处输入所需的域名。

单击以创建新虚拟网络。VM 主机服务器上即会有一个新的虚拟网桥

virbrX,该网桥对应于新建的虚拟网络。您可以使用bridge link进行检查。libvirt会自动添加 iptables 规则来允许传入/传出挂接到新 virbrX 设备的 Guest 的流量。

9.1.2.1.2 启动虚拟网络 #

要启动某个暂时停止的虚拟网络,请执行以下步骤:

启动虚拟机管理器。在可用连接列表中,右键单击您需要为其配置虚拟网络的连接名称,然后选择。

在窗口中,单击选项卡。您会看到可用于当前连接的所有虚拟网络的列表。

要启动虚拟网络,请单击。

9.1.2.1.3 停止虚拟网络 #

要停止活动的虚拟网络,请执行以下步骤:

启动虚拟机管理器。在可用连接列表中,右键单击您需要为其配置虚拟网络的连接名称,然后选择。

在窗口中,单击选项卡。您会看到可用于当前连接的所有虚拟网络的列表。

选择要停止的虚拟网络,然后单击。

9.1.2.1.4 删除虚拟网络 #

要删除 VM 主机服务器中的虚拟网络,请执行以下步骤:

启动虚拟机管理器。在可用连接列表中,右键单击您需要为其配置虚拟网络的连接名称,然后选择。

在窗口中,单击选项卡。您会看到可用于当前连接的所有虚拟网络的列表。

选择要删除的虚拟网络,然后单击。

9.1.2.1.5 使用 nsswitch 获取 NAT 网络的 IP 地址(在 KVM 中) #

在 VM 主机服务器上,安装用来为 libvirt 提供 NSS 支持的 libvirt-nss:

tux >sudozypper in libvirt-nss将

libvirt添加到/etc/nsswitch.conf:... hosts: files libvirt mdns_minimal [NOTFOUND=return] dns ...

如果 NSCD 正在运行,请将其重启动:

tux >sudosystemctl restart nscd

现在,您可以从主机按名称访问 Guest 系统了。

NSS 模块的功能有限。它会读取 /var/lib/libvirt/dnsmasq/*.status 文件,以在描述 dnsmasq 所提供的每个租约的 JSON 记录中查找主机名和对应的 IP 地址。只能使用受 dnsmasq 支持且由 libvirt 管理的桥接网络在这些 VM 主机服务器上执行主机名转换。

9.1.2.2 使用 virsh 管理虚拟网络 #

您可以使用 virsh 命令行工具来管理 libvirt 提供的虚拟网络。要查看所有与网络相关的 virsh 命令,请运行以下命令

tux >sudovirsh help network Networking (help keyword 'network'): net-autostart autostart a network net-create create a network from an XML file net-define define (but don't start) a network from an XML file net-destroy destroy (stop) a network net-dumpxml network information in XML net-edit edit XML configuration for a network net-event Network Events net-info network information net-list list networks net-name convert a network UUID to network name net-start start a (previously defined) inactive network net-undefine undefine an inactive network net-update update parts of an existing network's configuration net-uuid convert a network name to network UUID

要查看特定 virsh 命令的简要帮助信息,请运行 virsh help VIRSH_COMMAND:

tux >sudovirsh help net-create NAME net-create - create a network from an XML file SYNOPSIS net-create <file> DESCRIPTION Create a network. OPTIONS [--file] <string> file containing an XML network description

9.1.2.2.1 创建网络 #

要创建新的运行中虚拟网络,请运行以下命令

tux >sudovirsh net-create VNET_DEFINITION.xml

VNET_DEFINITION.xml XML 文件包含 libvirt 接受的虚拟网络的定义。

要定义新虚拟网络但不激活它,请运行以下命令

tux >sudovirsh net-define VNET_DEFINITION.xml

以下示例说明了不同类型的虚拟网络的定义。

下面的配置允许进行 VM Guest 传出连接(如果 VM 主机服务器上提供此功能)。当没有 VM 主机服务器网络时,此配置可让 Guest 互相直接通讯。

<network> <name>vnet_nated</name>1 <bridge name="virbr1"/>2 <forward mode="nat"/>3 <ip address="192.168.122.1" netmask="255.255.255.0">4 <dhcp> <range start="192.168.122.2" end="192.168.122.254"/>5 <host mac="52:54:00:c7:92:da" name="host1.testing.com" \ ip="192.168.1.23.101"/>6 <host mac="52:54:00:c7:92:db" name="host2.testing.com" \ ip="192.168.1.23.102"/> <host mac="52:54:00:c7:92:dc" name="host3.testing.com" \ ip="192.168.1.23.103"/> </dhcp> </ip> </network>

新虚拟网络的名称。 | |

用于构造虚拟网络的网桥设备的名称。定义 <forward> 模式为“ | |

包含 <forward> 元素表示该虚拟网络将连接到物理 LAN。 | |

网桥的 IP 地址和网络掩码。 | |

为虚拟网络启用 DHCP 服务器,并提供 | |

可选的 <host> 元素指定内置 DHCP 服务器要为其分配名称和预定义 IP 地址的主机。任何 IPv4 host 元素都必须指定以下设置:要为其指派给定名称的主机的 MAC 地址、要指派到该主机的 IP,以及 DHCP 服务器要为该主机分配的名称。IPv6 host 元素与 IPv4 略有不同,它没有 |

下面的配置会在不应用任何 NAT 的情况下将流量从虚拟网络路由到 LAN。必须在 VM 主机服务器网络上的路由器的路由表中预定义 IP 地址范围。

<network>

<name>vnet_routed</name>

<bridge name="virbr1"/>

<forward mode="route" dev="eth1"/>1

<ip address="192.168.122.1" netmask="255.255.255.0">

<dhcp>

<range start="192.168.122.2" end="192.168.122.254"/>

</dhcp>

</ip>

</network>

Guest 流量只能通过 VM 主机服务器上的 |

此配置提供完全隔离的专用网络。Guest 可以相互通讯以及与 VM 主机服务器通讯,但无法访问 LAN 上的任何其他计算机,因为 XML 说明中没有 <forward> 元素。

<network> <name>vnet_isolated</name> <bridge name="virbr3"/> <ip address="192.168.152.1" netmask="255.255.255.0"> <dhcp> <range start="192.168.152.2" end="192.168.152.254"/> </dhcp> </ip> </network>

此配置说明如何使用 VM 主机服务器的现有网桥 br0。VM Guest 直接连接到物理网络。其 IP 地址全部都在物理网络的子网中,并且传入和传出连接不存在任何限制。

<network>

<name>host-bridge</name>

<forward mode="bridge"/>

<bridge name="br0"/>

</network>9.1.2.2.2 列出网络 #

要列出 libvirt 可用的所有虚拟网络,请运行以下命令:

tux >sudovirsh net-list --all Name State Autostart Persistent ---------------------------------------------------------- crowbar active yes yes vnet_nated active yes yes vnet_routed active yes yes vnet_isolated inactive yes yes

要列出可用域,请运行以下命令:

tux >sudovirsh list Id Name State ---------------------------------------------------- 1 nated_sles12sp3 running ...

要获取运行中域的接口列表,请运行 domifaddr DOMAIN,或选择性地指定接口,以在输出中仅列出此接口。默认情况下,会额外输出接口的 IP 和 MAC 地址:

tux >sudovirsh domifaddr nated_sles12sp3 --interface vnet0 --source lease Name MAC address Protocol Address ------------------------------------------------------------------------------- vnet0 52:54:00:9e:0d:2b ipv6 fd00:dead:beef:55::140/64 - - ipv4 192.168.100.168/24

要列显与指定域关联的所有虚拟接口的简要信息,请运行以下命令:

tux >sudovirsh domiflist nated_sles12sp3 Interface Type Source Model MAC --------------------------------------------------------- vnet0 network vnet_nated virtio 52:54:00:9e:0d:2b

9.1.2.2.3 获取有关网络的细节 #

要获取有关网络的详细信息,请运行以下命令:

tux >sudovirsh net-info vnet_routed Name: vnet_routed UUID: 756b48ff-d0c6-4c0a-804c-86c4c832a498 Active: yes Persistent: yes Autostart: yes Bridge: virbr5

9.1.2.2.4 启动网络 #

要启动某个已定义的非活动网络,请使用以下命令查找其名称(或唯一标识符,即 UUID):

tux >sudovirsh net-list --inactive Name State Autostart Persistent ---------------------------------------------------------- vnet_isolated inactive yes yes

然后运行:

tux >sudovirsh net-start vnet_isolated Network vnet_isolated started

9.1.2.2.5 停止网络 #

要停止某个活动的网络,请使用以下命令查找其名称(或唯一标识符,即 UUID):

tux >sudovirsh net-list --inactive Name State Autostart Persistent ---------------------------------------------------------- vnet_isolated active yes yes

然后运行:

tux >sudovirsh net-destroy vnet_isolated Network vnet_isolated destroyed

9.1.2.2.6 去除网络 #

要从 VM 主机服务器中永久去除某个非活动网络的定义,请运行以下命令:

tux >sudovirsh net-undefine vnet_isolated Network vnet_isolated has been undefined

9.2 配置储存池 #

在 VM 主机服务器本身上管理 VM Guest 时,您可以访问 VM 主机服务器的整个文件系统,以挂接或创建虚拟硬盘,或将现有映像挂接到 VM Guest。但通过远程主机管理 VM Guest 时无法做到这些。出于此原因,libvirt 支持可从远程计算机访问的所谓“储存池”。

如果希望能够从远程客户端访问 VM 主机服务器上的 CD/DVD ISO 映像,需要将这些映像也放在储存池中。

libvirt 可识别两种不同类型的储存资源:卷和池。

- 储存卷

储存卷是可指派到 Guest 的储存设备 — 虚拟磁盘或 CD/DVD/软盘映像。从物理上讲,它可以是块设备(例如分区或逻辑卷),也可以是 VM 主机服务器上的某个文件。

- 储存池

储存池是 VM 主机服务器上可用于储存卷的储存资源,类似于台式计算机的网络储存。从物理上而言,它可分为以下类型之一:

- 文件系统目录 ()

用于存放映像文件的目录。文件可以是支持的磁盘格式之一(raw 或 qcow2),也可以是 ISO 映像。

- 物理磁盘设备 ()

使用整个物理磁盘作为储存空间。系统会为添加到池的每个卷创建一个分区。

- 预格式化的块设备 ()

指定要使用的分区,该分区与文件系统目录池(用于存放映像文件的目录)的使用方式相同。唯一的区别在于,使用文件系统目录时,

libvirt会负责挂载设备。- iSCSI 目标 (iscsi)

在 iSCSI 目标上设置池。您需要先登录卷一次才能将卷用于

libvirt。使用 YaST 来检测和登录卷,有关细节,请参见Book “储存管理指南”。不支持在 iSCSI 池中创建卷;每个现有逻辑单元号 (LUN) 都代表一个卷。每个卷/LUN 还需要一个有效的(空)分区表或磁盘标签,这样您才能使用该卷。如果没有分区表或磁盘标签,请使用fdisk添加:tux >sudofdisk -cu /dev/disk/by-path/ip-192.168.2.100:3260-iscsi-iqn.2010-10.com.example:[...]-lun-2 Device contains neither a valid DOS partition table, nor Sun, SGI or OSF disklabel Building a new DOS disklabel with disk identifier 0xc15cdc4e. Changes will remain in memory only, until you decide to write them. After that, of course, the previous content won't be recoverable. Warning: invalid flag 0x0000 of partition table 4 will be corrected by w(rite) Command (m for help): w The partition table has been altered! Calling ioctl() to re-read partition table. Syncing disks.- LVM 卷组 (logical)

使用 LVM 卷组作为池。您可以使用预定义的卷组,或者通过指定要使用的设备来创建组。储存卷会创建为卷上的分区。

警告:删除基于 LVM 的池在储存管理器中删除基于 LVM 的池时,也会删除卷组。这会导致池中储存的所有数据丢失且不可恢复!

- 多路径设备 ()

目前,多路径支持仅限于向 Guest 指派现有设备。不支持从

libvirt内部创建卷或配置多路径。- 网络导出的目录 ()

指定要使用的网络目录,该网络目录与文件系统目录池(用于存放映像文件的目录)的使用方式相同。唯一的区别在于,使用文件系统目录时,

libvirt会负责挂载目录。支持的协议为 NFS 和 GlusterFS。- SCSI 主机适配器 ()

SCSI 主机适配器的使用方式与 iSCSI 目标基本相同。我们建议使用基于

/dev/disk/by-*的设备名称而不是/dev/sdX。后者可能会发生变化(例如,添加或拆除硬盘时)。不支持在 iSCSI 池中创建卷。每个现有 LUN(逻辑单元号)都代表一个卷。

为了避免数据丢失或损坏,请不要尝试使用也用于在 VM 主机服务器上构建储存池的资源,例如 LVM 卷组、iSCSI 目标等。无需从 VM 主机服务器连接到这些资源,也无需在 VM 主机服务器上挂载这些资源 — libvirt 将负责这些事项。

不要在 VM 主机服务器上按标签挂载分区。在某些情况下,分区可能是从 VM Guest 内部使用 VM 主机服务器上已有的名称标记的。

9.2.1 使用 virsh 管理储存设备 #

您也可以使用 virsh 通过命令行管理储存。不过,SUSE 目前不支持创建储存池。因此,本节仅会介绍启动、停止和删除池以及卷管理等功能。

运行 virsh help pool 和 virsh help volume 可分别获取用于管理池和卷的所有 virsh 子命令列表。

9.2.1.1 列出池和卷 #

执行以下命令可以列出当前处于活动状态的所有池。要同时列出非活动池,请添加选项 --all:

tux > virsh pool-list --details

可以使用 pool-info 子命令获取有关特定池的细节:

tux > virsh pool-info POOL默认情况下,只能按池列出卷。要列出某个池中的所有卷,请输入以下命令。

tux > virsh vol-list --details POOL

目前,virsh 不提供任何可显示某个卷是否已由 Guest 使用的工具。下面的过程说明如何列出所有池中当前已被 VM Guest 使用的卷。

将以下内容保存到某个文件(例如 ~/libvirt/guest_storage_list.xsl)来创建一个 XSLT 样式表:

<?xml version="1.0" encoding="UTF-8"?> <xsl:stylesheet version="1.0" xmlns:xsl="http://www.w3.org/1999/XSL/Transform"> <xsl:output method="text"/> <xsl:template match="text()"/> <xsl:strip-space elements="*"/> <xsl:template match="disk"> <xsl:text> </xsl:text> <xsl:value-of select="(source/@file|source/@dev|source/@dir)[1]"/> <xsl:text> </xsl:text> </xsl:template> </xsl:stylesheet>在外壳中运行以下命令:假设 Guest 的 XML 定义全部储存在默认位置 (

/etc/libvirt/qemu)。xsltproc由软件包libxslt提供。SSHEET="$HOME/libvirt/guest_storage_list.xsl" cd /etc/libvirt/qemu for FILE in *.xml; do basename $FILE .xml xsltproc $SSHEET $FILE done

9.2.1.2 启动、停止和删除池 #

使用 virsh pool 子命令来启动、停止或删除池。在以下示例中,请将 POOL 替换为池的名称或其 UUID:

- 停止池

tux >virsh pool-destroy POOL注意:池的状态不会影响挂接的卷无论池处于什么状态((已停止)或(已启动)),池中挂接到 VM Guest 的卷都始终可用。池的状态只会影响到能否通过远程管理将卷挂接到 VM Guest。

- 删除存储池

tux >virsh pool-delete POOL- 启动池

tux >virsh pool-start POOL- 启用池自动启动功能

tux >virsh pool-autostart POOL只有标记为 autostart 的池才会自动在 VM 主机服务器重引导时启动。

- 禁用池自动启动功能

tux >virsh pool-autostart POOL --disable

9.2.1.3 将卷添加到储存池 #

virsh 提供了两种将卷添加到储存池的方法:在 XML 定义中使用 vol-create 和 vol-create-from 添加,或者使用 vol-create-as 通过命令行参数添加。SUSE 目前不支持前一种方法,因此本节重点介绍 vol-create-as 子命令。

要将卷添加到现有池,请输入以下命令:

tux > virsh vol-create-as POOL1NAME2 12G --format3raw|qcow24 --allocation 4G5卷要添加到的池的名称 | |

卷的名称 | |

卷的大小,在本示例中为 12 GB。使用后缀 k、M、G、T 来分别表示千字节、兆字节、千兆字节和万亿字节。 | |

卷的格式。SUSE 目前支持 | |

可选的参数。默认情况下,

如果不指定此参数,将生成不包含分配量的稀疏映像文件。要创建非稀疏卷,请使用此参数指定整个映像大小(在本示例中为 |

9.2.1.3.1 克隆现有卷 #

将卷添加到池的另一种方法是克隆现有卷。请始终在原始实例所在的同一个池中创建新实例。

tux > virsh vol-clone NAME_EXISTING_VOLUME1NAME_NEW_VOLUME2 --pool POOL39.2.1.4 从储存池中删除卷 #

要从池中永久删除某个卷,请使用 vol-delete 子命令:

tux > virsh vol-delete NAME --pool POOL

--pool 为可选项。libvirt 会尝试自动查找卷。如果找不到,请指定此参数。

无论卷当前是否已在活动或非活动的 VM Guest 中使用,都将一律被删除。无法恢复已删除的卷。

只能使用过程 9.2 “列出 VM 主机服务器上当前使用的所有储存卷”中所述的方法来检测某个卷是否已由 VM Guest 使用。

9.2.1.5 将卷挂接到 VM Guest #

按照第 9.2.1.3 节 “将卷添加到储存池”中所述创建卷后,可将其挂接到虚拟机并作为硬盘使用:

tux > virsh attach-disk DOMAIN SOURCE_IMAGE_FILE TARGET_DISK_DEVICE例如:

tux > virsh attach-disk sles12sp3 /virt/images/example_disk.qcow2 sda2

要检查是否已挂接新磁盘,请检查 virsh dumpxml 命令的结果:

root # virsh dumpxml sles12sp3

[...]

<disk type='file' device='disk'>

<driver name='qemu' type='raw'/>

<source file='/virt/images/example_disk.qcow2'/>

<backingStore/>

<target dev='sda2' bus='scsi'/>

<alias name='scsi0-0-0'/>

<address type='drive' controller='0' bus='0' target='0' unit='0'/>

</disk>

[...]9.2.1.5.1 热插入或持久更改 #

可将磁盘挂接到活动和非活动的域。挂接操作由 --live 和 --config 选项控制:

--live将磁盘热插入到活动域。挂接操作不会保存在域配置中。对非活动域使用

--live会出错。--config持久更改域配置。下一次启动域后,挂接的磁盘将可用。

--live--config热插入磁盘并将其添加到持久域配置中。

virsh attach-device

virsh attach-device 是 virsh attach-disk 的更通用的形式。可以使用此命令将其他类型的设备挂接到域。

9.2.1.6 从 VM Guest 分离卷 #

要从域分离磁盘,请使用 virsh detach-disk:

root # virsh detach-disk DOMAIN TARGET_DISK_DEVICE例如:

root # virsh detach-disk sles12sp3 sda2

可以按照第 9.2.1.5 节 “将卷挂接到 VM Guest”中所述,使用 --live 和 --config 选项来控制挂接操作。

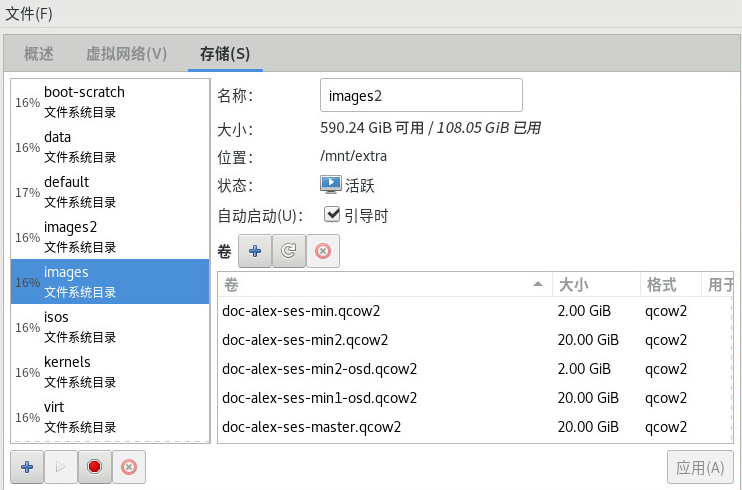

9.2.2 使用虚拟机管理器管理储存设备 #

虚拟机管理器提供了一个图形界面,即储存管理器,用于管理储存卷和池。要访问储存管理器,请右键单击某个连接并选择,或者高亮显示某个连接并选择 › 。选择选项卡。

9.2.2.1 添加储存池 #

要添加储存池,请执行以下操作:

单击左下角的。对话框即会显示。

提供池的(仅可包含字母数字字符以及

_、-或.),然后选择。在下面指定所需的细节。具体的值取决于您要创建的池类型。

- 类型:

:指定现有目录。

- 类型:

:设备分区表的格式。一般情况下,使用 应该不会有问题。如果有问题,请通过在 VM 主机服务器上运行命令

parted-l获取所需的格式。:设备的路径。建议使用基于

/dev/disk/by-*的设备名称而不是简单的/dev/sdX,因为后者可能会发生变化(例如,添加或拆除硬盘时)。您需要指定类似整个磁盘而不是磁盘上的分区(如果存在)的路径。

- 类型:

:VM 主机服务器文件系统上的挂载点。

:设备的文件系统格式。使用默认值

auto应该不会有问题。:设备文件的路径。建议使用基于

/dev/disk/by-*的设备名称而不是/dev/sdX,因为后者可能会发生变化(例如,添加或拆除硬盘时)。

- 类型:

通过在 VM 主机服务器上运行以下命令来获取所需的数据:

tux >sudoiscsiadm --mode node此命令将返回采用以下格式的 iSCSI 卷列表。以粗体文本显示的元素是必需的:

IP_ADDRESS:PORT,TPGT TARGET_NAME_(IQN)

:包含设备文件的目录。使用

/dev/disk/by-path(默认值)或/dev/disk/by-id。:iSCSI 服务器的主机名或 IP 地址。

:iSCSI 目标名称(iSCSI 限定的名称)。

:iSCSI 发起端名称。

- 类型:

:指定现有卷组的设备路径。

- 类型:

:目前对多路径的支持仅限于通过它来使所有多路径设备可用。因此,请在此处指定任意字符串,此字符串随后将被忽略。必须指定路径,否则 XML 解析器将会失败。

- 类型:

:VM 主机服务器文件系统上的挂载点。

:要导出网络文件系统的服务器的 IP 地址或主机名。

:正在导出的服务器上的目录。

- 类型:

:导出的 RADOS 块设备所在服务器的主机名。

:服务器上 RADOS 块设备的名称。

- 类型:

:包含设备文件的目录。使用

/dev/disk/by-path(默认值)或/dev/disk/by-id。:SCSI 适配器的名称。

- 类型:

:ZFS 池的名称。

注意:文件浏览从远程位置操作时,无法通过单击使用文件浏览器。

单击以添加储存池。

9.2.2.2 管理储存池 #

您可以通过虚拟机管理器的储存管理器在池中创建或删除卷。您还可以暂时停用或永久删除现有的储存池。SUSE 目前不支持更改池的基本配置。

9.2.2.2.1 启动、停止和删除池 #

储存池的用途是提供 VM 主机服务器上的块设备,远程管理 VM Guest 时,可将这些设备添加到其中。要暂时禁止远程访问某个池,请单击储存管理器左下角的。停止的池标记为,并在列表窗格中灰显。默认情况下,新建的池在 VM 主机服务器时会自动启动。

要启动某个非活动的池并再次使其可从远程位置使用,请单击储存管理器左下角的。

无论池处于什么状态((已停止)或(已启动)),池中挂接到 VM Guest 的卷都始终可用。池的状态只会影响到能否通过远程管理将卷挂接到 VM Guest。

要永久禁止访问某个池,请单击储存管理器左下角的。您只能删除非活动的池。删除某个池不会实际擦除其在 VM 主机服务器上的内容,而只会删除池配置。不过,在删除池时需要额外小心,尤其是删除基于 LVM 卷组的工具时:

删除基于本地文件系统目录、本地分区或磁盘的储存池不会影响到这些池中当前挂接到 VM Guest 的卷的可用性。

如果删除 iSCSI、SCSI、LVM 组或网络导出的目录这些类型的池,将无法再从 VM Guest 访问这些池中的卷。尽管卷本身不会被删除,但 VM 主机服务器将不再可以访问这些资源。

创建足够大的新池或者直接从主机系统挂载/访问这些资源时,iSCSI/SCSI 目标或网络导出的目录中的卷将再次可供访问。

删除基于 LVM 组的储存池时,将擦除 LVM 组定义,并且该 LVM 组将不再存在于主机系统上。其配置将不可恢复,并且此池中的所有卷都会丢失。

9.2.2.2.2 将卷添加到储存池 #

借助虚拟机管理器,您可以在所有储存池(多路径、iSCSI 或 SCSI 类型的池除外)中创建卷。这些池中的卷相当于 LUN,无法从 libvirt 内部更改。

可以使用储存管理器创建新卷,或者在将新储存设备添加到 VM Guest 时创建新卷。在以上任一情况下,请从左侧面板中选择一个储存池,然后单击。

指定映像的并选择映像格式。

SUSE 目前仅支持

raw或qcow2映像。后一个选项在基于 LVM 组的池中不可用。在的旁边,指定允许磁盘映像达到的最大大小。除非您使用

qcow2映像,否则还可以设置最初应该分配的量。如果这两个值不同,将会创建一个按需增长的稀疏映像文件。对于

qcow2映像,可以使用一个构成基本映像的(也称为“后备文件”)。这样新建的qcow2映像便只会记录对基本映像进行的更改。单击开始创建卷。

9.2.2.2.3 从储存池中删除卷 #

只能在储存管理器中删除卷:选择相应卷并单击。单击确认。

即使活动或非活动的 VM Guest 中当前正在使用卷,也能将卷删除。无法恢复已删除的卷。

储存管理器中的列会指示某个卷是否已由 VM Guest 使用。

10 Guest 安装 #

VM Guest 由一个包含操作系统和数据文件的映像以及一个描述 VM Guest 虚拟硬件资源的配置文件构成。VM Guest 托管在 VM 主机服务器上并受其控制。本节提供有关安装 VM Guest 的概括说明。有关支持的 VM Guest 列表,请参见第 7 章 “虚拟化限制和支持”。

与运行操作系统需要满足的要求相比,虚拟机几乎没有什么要求。如果操作系统未根据虚拟机主机环境进行优化,它将只能以全虚拟化模式在硬件辅助虚拟化计算机硬件上运行,并需要装载特定的设备驱动程序。提供给 VM Guest 的硬件取决于主机的配置。

您应该了解与在多个虚拟机上运行单个已许可操作系统副本相关的任何许可问题。有关详细信息,请查阅操作系统许可协议。

10.1 基于 GUI 的 Guest 安装 #

向导将帮助您完成创建虚拟机和安装其操作系统所需执行的步骤。要启动该向导,请打开虚拟机管理器并选择 › 。或者,启动 YaST 并选择 › 。

从 YaST 或虚拟机管理器中启动 向导。

选择安装源 — 本地可用的媒体或网络安装源。如果您要从现有映像安装 VM Guest,请选择。

在运行 Xen 超级管理程序的 VM 主机服务器上,您可以选择是要安装半虚拟化 Guest 还是全虚拟化 Guest。您可以在下选择相应的选项。根据此项选择,并非所有安装选项均可用。

根据在上一步中所做的选择,您需要提供以下数据:

在 VM 主机服务器上指定包含安装数据的 ISO 映像的路径。如果该映像是作为 libvirt 储存池中的卷提供的,您也可以使用来选择。有关更多信息,请参见第 13 章 “高级储存主题”。

或者,选择已插入到 VM 主机服务器光驱中的物理 CD-ROM 或 DVD。

提供指向安装源的 。例如,有效的 URL 前缀包括

ftp://、http://和https://。在 下,提供自动安装文件(例如 AutoYaST 或 Kickstart)的路径以及内核参数。提供 URL 后,应该就会自动正确检测到操作系统。如果情况并非如此,请取消选择,并手动选择和。

要从现有映像安装 VM Guest,您需要在 VM 主机服务器上指定该映像的路径。如果该映像是作为 libvirt 储存池中的卷提供的,您也可以使用来选择。有关更多信息,请参见第 13 章 “高级储存主题”。

如果您要创建虚拟机,手动配置其组件并稍后安装其操作系统,则适合使用这种安装方法。要将 VM 调整为特定的产品版本,请开始键入版本名称(例如

sles),然后在出现匹配项时选择所需的版本。

选择新虚拟机的内存大小和 CPU 数量。

如果在第一步中选择了,则会省略此步骤。

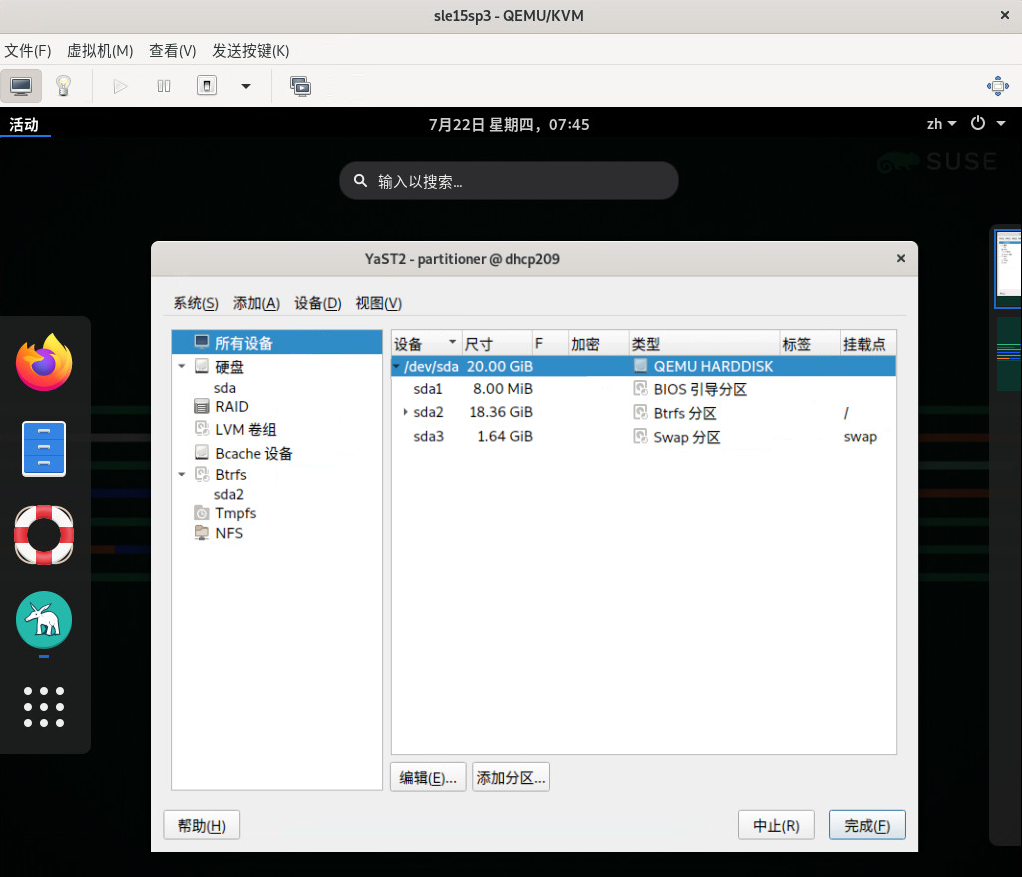

设置 VM Guest 的虚拟硬盘。创建新磁盘映像,或者从储存池中选择一个现有的磁盘映像(有关详细信息,请参见第 13 章 “高级储存主题”)。如果您选择创建磁盘,将会创建一个

qcow2映像。默认情况下,该映像储存在/var/lib/libvirt/images下。设置磁盘是可选操作。例如,如果您正在直接从 CD 或 DVD 运行实时系统,可以通过停用来省略此步骤。

在向导的最后一个屏幕上指定虚拟机的名称。如果您希望能够查看和更改虚拟化硬件选择,请激活。在下指定网络设备。使用时,系统会预先填充主机上的第一个网桥。要使用其他网桥,请在文本框中手动更新为该网桥名称。

单击。

(可选) 如果您在上一步中保留了默认设置,安装现在就会开始。如果您选择了,一个 VM Guest 配置对话框将会打开。有关配置 VM Guest 的详细信息,请参见第 14 章 “使用虚拟机管理器配置虚拟机”。

完成配置后,单击。

安装将在一个虚拟机管理器控制台窗口中开始。某些组合键(例如 Ctrl–Alt–F1)会被 VM 主机服务器接受,但不会传递给虚拟机。虚拟机管理器提供“粘滞键”功能来绕过 VM 主机服务器。按 Ctrl、Alt 或 Shift 三次使该键成为粘滞键,然后按组合键中剩余的键便可将组合键传递给虚拟机。

例如,要将 Ctrl–Alt–F2 传递给 Linux 虚拟机,请按 Ctrl 三次,然后按 Alt–F2。也可以按 Alt 三次,然后按 Ctrl–F2。

在安装 VM Guest 期间以及安装之后,都可以在虚拟机管理器中使用粘滞键功能。

10.1.1 为虚拟机配置 PXE 引导 #

PXE 引导使虚拟机能够从网络引导安装媒体,而无需从物理媒体或安装磁盘映像进行引导。有关设置 PXE 引导环境的更多细节,请参见Book “部署指南”, Chapter 17 “准备网络引导环境”。

要使您的 VM 从 PXE 服务器引导,请执行以下步骤:

按照第 10.1 节 “基于 GUI 的 Guest 安装”中所述启动安装向导。

选择方法。

按照向导操作到最后一步,然后选中。单击确认。

在屏幕上,选择。

检查,并选中旁边的框。

在下,选中 并单击确认。

单击以开始安装。如果正确配置了 PXE 服务器,PXE 菜单屏幕将会显示。

10.2 使用 virt-install 从命令行安装 #

virt-install 是个命令行工具,可帮助您使用 libvirt 库创建新虚拟机。如果您无法使用图形用户界面,或需要自动化虚拟机创建过程,此工具十分有用。

virt-install 是个复杂的脚本,其中包含大量命令行开关。下面是必需的开关。有关详细信息,请参见 virt-install (1) 手册页。

- 一般选项

--name VM_GUEST_NAME:指定新虚拟机的名称。该名称必须在同一连接上超级管理程序已知的所有 Guest 中保持唯一。该名称用于创建和命名 Guest 的配置文件,您可以通过virsh使用该名称来访问 Guest。名称可包含字母数字和_-.:+字符。--memory REQUIRED_MEMORY:以 MB 为单位指定分配给新虚拟机的内存量。--vcpus NUMBER_OF_CPUS:指定虚拟 CPU 数量。要获得最佳性能,虚拟处理器数量应小于或等于物理处理器数量。

- 虚拟化类型

--paravirt:安装半虚拟化 Guest。如果 VM 主机服务器支持半虚拟化和全虚拟化,这就是默认设置。--hvm:安装全虚拟化 Guest。--virt-type HYPERVISOR:指定超级管理程序。支持的值为kvm或xen。

- Guest 储存

指定

--disk、--filesystem或--nodisks作为新虚拟机的储存类型。例如,--disk size=10会在超级管理程序的默认映像位置创建 10 GB 磁盘,并将此磁盘用于 VM Guest。--filesystem /export/path/on/vmhost指定 VM 主机服务器上要导出到 Guest 的目录。--nodisks安装不带本地储存的 VM Guest(适合使用实时 CD 的情形)。- 安装方法

使用

--location、--cdrom、--pxe、--import或--boot指定安装方法。- 访问安装

使用

--graphics VALUE选项指定如何访问安装。SUSE Linux Enterprise Server 支持值vnc或none。如果使用 VNC,

virt-install将尝试启动virt-viewer。如果 virt-viewer 未安装或无法运行,请使用您偏好的查看器手动连接到 VM Guest。要显式阻止virt-install启动查看器,请使用--noautoconsole。要定义用于访问 VNC 会话的口令,请使用以下语法:--graphics vnc,password=PASSWORD。如果您使用

--graphics none,可以通过操作系统支持的服务(例如 SSH 或 VNC)访问 VM Guest。请参见操作系统安装手册了解如何在安装系统中设置这些服务。- 传递内核和 initrd 文件

可以直接指定安装程序的内核和 Initrd,例如,指定来自网络来源的内核和 Initrd。要设置网络来源,请参见Book “部署指南”, Chapter 16 “设置网络安装源”, Section 16.4 “手动设置 HTTP 储存库”。

要传递其他引导参数,请使用

--extra-args选项。此选项可用于指定网络配置。有关详细信息,请参见Book “部署指南”, Chapter 7 “引导参数”。例 10.1︰ 从 HTTP 服务器装载内核和 initrd #root #virt-install--location "http://example.tld/REPOSITORY/DVD1/" \ --extra-args="textmode=1" --name "SLES15" --memory 2048 --virt-type kvm\ --connect qemu:///system --disk size=10 --graphics vnc \ --network network=vnet_nated- 启用控制台

默认不会对使用

virt-install安装的新虚拟机启用控制台。要启用控制台,请按下面的示例所示使用--extra-args="console=ttyS0 textmode=1":tux >virt-install --virt-type kvm --name sles12 --memory 1024 \ --disk /var/lib/libvirt/images/disk1.qcow2 --os-variant sles12 --extra-args="console=ttyS0 textmode=1" --graphics none安装完成后,VM 映像中的

/etc/default/grub文件将会更新,在GRUB_CMDLINE_LINUX_DEFAULT行中包含console=ttyS0选项。- 使用 UEFI 和安全引导

按照第 6.4 节 “安装 UEFI 支持”中所述安装 OVMF。然后将

--boot uefi选项添加到virt-install命令。设置使用 OVMF 的新 VM 时,将自动使用安全引导。要使用特定的固件,请使用

--boot loader=/usr/share/qemu/ovmf-VERSION.bin。请将 VERSION 替换为所需的文件。

virt-install 命令行示例 #下面的命令行示例会创建带有 virtio 加速磁盘和网卡的新 SUSE Linux Enterprise Desktop 12 虚拟机。它将创建新的 10 GB qcow2 磁盘映像作为储存空间,源安装媒体为主机 CD-ROM 驱动器。此命令行将使用 VNC 图形,并自动启动图形客户端。

- KVM

tux >virt-install --connect qemu:///system --virt-type kvm --name sled12 \ --memory 1024 --disk size=10 --cdrom /dev/cdrom --graphics vnc \ --os-variant sled12- Xen

tux >virt-install --connect xen:// --virt-type xen --name sled12 \ --memory 1024 --disk size=10 --cdrom /dev/cdrom --graphics vnc \ --os-variant sled12

10.3 高级 Guest 安装方案 #

本节提供有关超出了正常安装范围的操作(例如使用内存气球和安装附加产品)的说明。

10.3.1 对 Windows Guest 使用内存气球 #

内存气球是在运行时更改 VM Guest 所用内存量的方法。KVM 和 Xen 超级管理程序都提供此方法,但需要 Guest 也支持此方法。

基于 openSUSE 和 SLE 的 Guest 支持内存气球,而 Windows Guest 需要通过虚拟机驱动程序包 (VMDP) 来提供气球技术。要使设置的最大内存大于为 Windows Guest 配置的初始内存,请执行以下步骤:

安装最大内存等于或小于初始值的 Windows Guest。

在 Windows Guest 中安装虚拟机驱动程序包,以提供所需的驱动程序。

关闭 Windows Guest。

将 Windows Guest 的最大内存重设置为所需值。

再次启动 Windows Guest。

10.3.2 在安装中包含附加产品 #

某些操作系统(例如 SUSE Linux Enterprise Server)允许在安装过程中包含附加产品。如果附加产品安装源是通过 SUSE Customer Center 提供的,则无需进行特殊的 VM Guest 配置。如果安装源是通过 CD/DVD 或 ISO 映像提供的,则需要向 VM Guest 安装系统提供标准安装媒体映像和附加产品的映像。

如果您使用的是基于 GUI 的安装,请在向导的最后一步选择,并通过 › 添加附加产品 ISO 映像。指定映像的路径,并将设置为 。

如果您是从命令行安装的,则需要使用 --disk 参数而不是 --cdrom 来设置虚拟 CD/DVD 驱动器。将使用第一个指定的设备进行引导。下面的示例会将 SUSE Enterprise Storage 扩展随 SUSE Linux Enterprise Server 15 一并安装:

tux > virt-install \

--name sles15+storage \

--memory 2048 --disk size=10 \

--disk /path/to/SLE-15-SP3-Full-ARCH-GM-media1.iso-x86_64-GM-DVD1.iso,device=cdrom \

--disk /path/to/SUSE-Enterprise-Storage-VERSION-DVD-ARCH-Media1.iso,device=cdrom \

--graphics vnc --os-variant sle1511 基本 VM Guest 管理 #

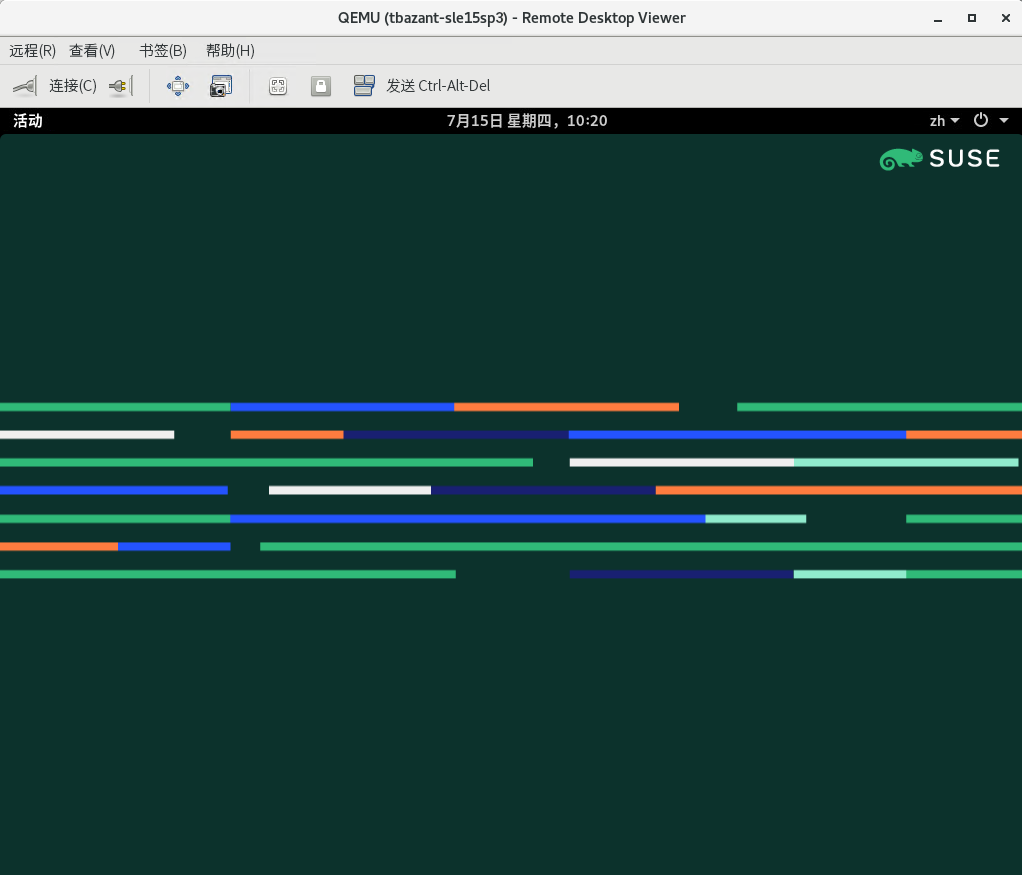

使用虚拟机管理器图形应用程序或者在命令行上使用 virsh 可以完成大部分管理任务,例如启动或停止 VM Guest。而要通过 VNC 连接到图形控制台,就只能从图形用户界面进行。

如果 VM 主机服务器上启动了虚拟机管理器、virsh 和 virt-viewer 这些 libvirt 工具,则可以使用它们来管理主机上的 VM Guest。不过,您也可以管理远程 VM 主机服务器上的 VM Guest。这需要在主机上为 libvirt 配置远程访问权限。有关说明,请参见第 12 章 “连接和授权”。

要使用虚拟机管理器连接到此类远程主机,需要按照第 12.2.2 节 “使用虚拟机管理器管理连接”中所述设置连接。如果通过 virsh 或 virt-viewer 连接到远程主机,需要使用参数 -c 指定连接 URI(例如,virsh -c qemu+tls://saturn.example.com/system 或 virsh -c xen+ssh://)。连接 URI 的格式取决于连接类型和超级管理程序 — 有关细节,请参见第 12.2 节 “连接到 VM 主机服务器”。

本章列出的所有示例都不包含连接 URI。

11.1 列出 VM Guest #

VM Guest 列表显示 VM 主机服务器上由 libvirt 管理的所有 VM Guest。

11.1.1 使用虚拟机管理器列出 VM Guest #

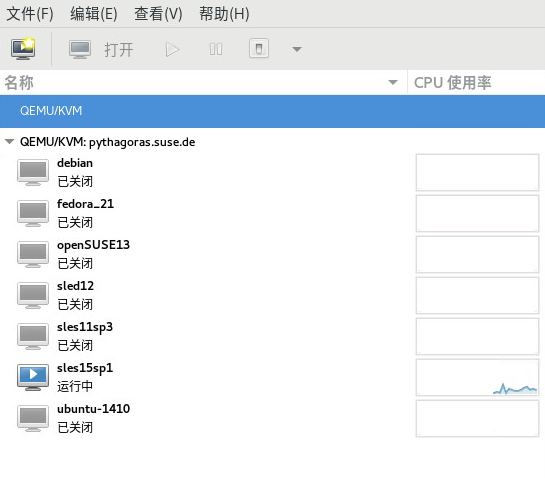

虚拟机管理器的主窗口会列出它所连接的每台 VM 主机服务器的所有 VM Guest。每个 VM Guest 项包含该计算机的名称及状态(、或),这些信息以图标、文本和 CPU 使用率条的形式显示。

11.1.2 使用 virsh 列出 VM Guest #

使用 virsh list 命令可获取 VM Guest 的列表:

- 列出所有正在运行的 Guest

tux >virsh list- 列出所有正在运行的 Guest 以及非活动的 Guest

tux >virsh list --all

有关详细信息和其他选项,请参见 virsh help list 或 man 1 virsh。

11.2 通过控制台访问 VM Guest #

可以通过 VNC 连接(图形控制台)或串行控制台(如果受 Guest 操作系统的支持)访问 VM Guest。

11.2.1 打开图形控制台 #

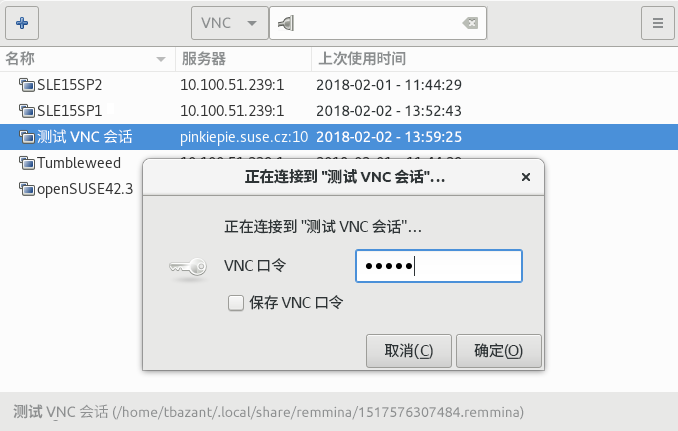

打开与 VM Guest 连接的图形控制台可与该计算机交互,就如同通过 VNC 连接与物理主机交互一样。如果访问 VNC 服务器需要身份验证,系统会提示您输入用户名(如果适用)和口令。

当您单击进入 VNC 控制台时,光标将被“夺取”,不能再在控制台外部使用。要释放光标,请按 Alt–Ctrl。

某些组合键(例如 Ctrl–Alt–Del)由主机解释,不会传递给 VM Guest。要将此类组合键传递给 VM Guest,请在 VNC 窗口中打开菜单,然后选择所需的组合键项。仅当使用虚拟机管理器和 virt-viewer 时,菜单才可用。借助虚拟机管理器,可以按照提示:将组合键传递给虚拟机中所述改用“粘滞键”功能。

理论上而言,所有 VNC 查看器都可连接到 VM Guest 的控制台。但如果您是使用 SASL 身份验证和/或 TLS/SSL 连接来访问 Guest 的,那么您的选择就比较有限。tightvnc 或 tigervnc 等常见 VNC 查看器既不支持 SASL 身份验证,也不支持 TLS/SSL。唯一可替代虚拟机管理器和 virt-viewer 的工具是 Remmina(请参见Book “管理指南”, Chapter 10 “使用 VNC 的远程图形会话”, Section 10.2 “Remmina:远程桌面客户端”)。

11.2.1.1 使用虚拟机管理器打开图形控制台 #

在虚拟机管理器中,右键单击某个 VM Guest 项。

从弹出菜单中选择。

11.2.1.2 使用 virt-viewer 打开图形控制台 #

virt-viewer 是一个简单的 VNC 查看器,其中添加了用于显示 VM Guest 控制台的功能。例如,可以 “wait” 模式启动该查看器,在此情况下,它会先等待 VM Guest 启动,然后再建立连接。它还支持自动重新连接到重引导的 VM Guest。

virt-viewer 按名称、ID 或 UUID 对 VM Guest 进行寻址。使用 virsh list --all 可获取这些数据。

要连接到正在运行或已暂停的 Guest,请使用 ID、UUID 或名称。已关闭的 VM Guest 没有 ID — 您只能按 UUID 或名称与其建立连接。

- 连接到 ID 为

8的 Guest tux >virt-viewer 8- 连接到名为

sles12的非活动 Guest;Guest 启动后,连接窗口就会打开 tux >virt-viewer --wait sles12如果使用

--wait选项,即使 VM Guest 此刻未运行,也会保持连接。当 Guest 启动时,查看器即会启动。

有关详细信息,请参见 virt-viewer

--help 或 man 1 virt-viewer。

使用 virt-viewer 通过 SSH 来与远程主机建立连接时,需要输入 SSH 口令两次。第一次用于向 libvirt 进行身份验证,第二次用于向 VNC 服务器进行身份验证。第二个口令需要在启动 virt-viewer 的命令行上提供。

11.2.2 打开串行控制台 #

要访问虚拟机的图形控制台,需要在访问 VM Guest 的客户端上提供一个图形环境。或者,也可通过串行控制台和 virsh 在外壳中访问使用 libvirt 管理的虚拟机。要打开与名为 “sles12” 的 VM Guest 连接的串行控制台,请运行以下命令:

tux > virsh console sles12

virsh console 接受两个可选标志:--safe 确保以独占方式访问控制台,--force 在连接之前断开与所有现有会话的连接。这两个功能需受 Guest 操作系统的支持。

Guest 操作系统必须支持串行控制台访问,并且该操作系统也受到适当的支持,才能通过串行控制台连接到 VM Guest。有关详细信息,请参见 Guest 操作系统手册。

SUSE Linux Enterprise 和 openSUSE 中默认会禁用串行控制台访问。要启用它,请执行下列步骤:

- SLES 12 和 up/openSUSE

启动 YaST 引导加载程序模块并切换到选项卡。将

console=ttyS0添加到字段。- SLES 11

启动 YaST 引导加载程序模块,并选择要为其激活串行控制台访问的引导项。选择,并将

console=ttyS0添加到字段。此外,请编辑/etc/inittab并取消注释包含以下内容的行:#S0:12345:respawn:/sbin/agetty -L 9600 ttyS0 vt102

11.3 更改 VM Guest 的状态:启动、停止、暂停 #

可以使用虚拟机管理器或 virsh 来启动、停止或暂停 VM Guest。您还可以将 VM Guest 配置为在引导 VM 主机服务器时自动启动。

关闭 VM Guest 时,可将其正常关机或强制关机。后一种操作的效果等同于拔下物理主机上的电源插头,建议仅在没有其他办法时才这样做。强制关机可能导致 VM Guest 上的文件系统损坏或数据丢失。

要能够执行正常关机,必须将 VM Guest 配置为支持 ACPI。如果 Guest 是使用虚拟机管理器创建的,则可在 VM Guest 中使用 ACPI。

根据 Guest 操作系统,能够使用 ACPI 可能还不足以执行正常关机。在生产环境中使用 Guest 之前,强烈建议先对其进行关机和重引导测试。例如,openSUSE 或 SUSE Linux Enterprise Desktop 可能需要获得 PolKit 授权才能关机和重引导。确保已在所有 VM Guest 上关闭此策略。

如果在安装 Windows XP/Windows Server 2003 Guest 期间启用了 ACPI,只在 VM Guest 配置中开启 ACPI 并不足够。有关更多信息,请参见:

无论 VM Guest 的配置如何,始终都可以从 Guest 操作系统内部实现正常关机。

11.3.1 使用虚拟机管理器更改 VM Guest 的状态 #

可以通过虚拟机管理器的主窗口或 VNC 窗口更改 VM Guest 的状态。

右键单击某个 VM Guest 项。

在弹出菜单中选择、或其中一个。

按照第 11.2.1.1 节 “使用虚拟机管理器打开图形控制台”中所述打开 VNC 窗口。

在工具栏或菜单中,选择、或其中一个选项。

11.3.1.1 自动启动 VM Guest #

您可以在引导 VM 主机服务器时自动启动 Guest。此功能默认未启用,需要为每个 VM Guest 单独启用。无法全局激活此功能。

在虚拟机管理器中双击 VM Guest 项以打开其控制台。

选择 › 打开 VM Guest 配置窗口。

选择,然后选中。

单击保存新配置。

11.3.2 使用 virsh 更改 VM Guest 的状态 #

以下示例会更改名为 “sles12” 的 VM Guest 的状态。

- 开始

tux >virsh start sles12- 暂停

tux >virsh suspend sles12- 恢复(已暂停的 VM Guest)

tux >virsh resume sles12- 重引导

tux >virsh reboot sles12- 正常关机

tux >virsh shutdown sles12- 强制关机

tux >virsh destroy sles12- 开启自动启动

tux >virsh autostart sles12- 关闭自动启动

tux >virsh autostart --disable sles12

11.4 保存和恢复 VM Guest 的状态 #

保存 VM Guest 会保留其内存的确切状态。该操作类似于将计算机休眠。保存的 VM Guest 可以快速恢复到以前保存的运行中状况。

保存时,VM Guest 将会暂停,其当前内存状态将保存到磁盘,然后该 Guest 停止。该操作不会复制 VM Guest 虚拟磁盘的任何一部分。保存虚拟机所需的时长取决于分配的内存量。保存时,VM Guest 的内存将返回到 VM 主机服务器上的可用内存池。

恢复操作将装载先前保存的 VM Guest 内存状态文件并启动该 Guest。该 Guest 不会引导,而是在以前保存它的位置继续运行。该操作类似于退出休眠状态。

VM Guest 将保存到某个状态文件。请确保要保存到的分区有足够的空间。要估计预期的文件大小(以 MB 为单位),请在 Guest 上发出以下命令:

tux > free -mh | awk '/^Mem:/ {print $3}'使用保存操作后,请不要引导或启动保存的 VM Guest。这样做会使计算机的虚拟磁盘和保存的内存状态不同步,有可能导致在恢复 Guest 时发生严重错误。

要能够再次使用保存的 VM Guest,请使用恢复操作。如果您是使用 virsh 保存 VM Guest 的,将无法使用虚拟机管理器将其恢复。在这种情况下,请务必使用 virsh 进行恢复。

raw、qcow2 的 VM Guest

仅当 VM Guest 使用的虚拟磁盘为 raw (.img) 或 qcow2 类型时,才可以保存和恢复该 VM Guest。

11.4.1 使用虚拟机管理器保存/恢复 #

打开 VM Guest 的 VNC 连接窗口。确保该 Guest 正在运行。

选择 › › 。

打开 VM Guest 的 VNC 连接窗口。确保该 Guest 未运行。

选择 › 。

如果 VM Guest 以前是使用虚拟机管理器保存的,则系统不会为您提供用于该 Guest 的选项。但请注意警告:始终恢复保存的 Guest中所述的有关使用

virsh保存的计算机的注意事项。

11.4.2 使用 virsh 保存和恢复 #

使用 virsh

save 命令保存运行中的 VM Guest,并指定要将其保存到的文件。

- 保存名为

opensuse13的 Guest tux >virsh save opensuse13 /virtual/saves/opensuse13.vmsav- 保存 ID 为

37的 Guest tux >virsh save 37 /virtual/saves/opensuse13.vmsave

要恢复 VM Guest,请使用 virsh

restore:

tux > virsh restore /virtual/saves/opensuse13.vmsave11.5 创建和管理快照 #

VM Guest 快照是整个虚拟机的快照,包括 CPU、RAM、设备的状态,以及所有可写磁盘的内容。要使用虚拟机快照,所有挂接的硬盘均需使用 qcow2 磁盘映像格式,并且其中至少有一个硬盘需是可写的。

快照可让您将计算机恢复到特定时间点的状态。在撤消有错误的配置或者安装大量软件包时,此功能十分有用。启动一个在 VM Guest 处于关闭状态下创建的快照后,需要引导该 Guest。在该时间点之后写入磁盘的所有更改都将在启动快照时丢失。

快照仅在 KVM VM 主机服务器上受支持。

11.5.1 术语 #

有多个特定术语用于描述快照的类型:

- 内部快照

保存到原始 VM Guest 的 qcow2 文件中的快照。该文件包含保存的快照状态,以及自截取快照以来发生的更改。内部快照的主要优势是它们全都储存在一个文件中,因此方便在多个计算机之间复制或移动。

- 外部快照

创建外部快照时,会保存原始 qcow2 文件并将其设为只读,同时会创建一个新的 qcow2 文件用于存放更改。原始文件有时称为“后备”文件或“基础”文件,包含所有更改的新文件称为“覆盖”文件或“派生”文件。备份 VM Guest 时,外部快照很有用。但外部快照不受虚拟机管理器的支持,且无法直接通过

virsh删除。有关 QEMU 中外部快照的详细信息,请参见第 34.2.4 节 “有效操作磁盘映像”。- 实时快照

当原始 VM Guest 正在运行时创建的快照。内部实时快照支持保存设备以及内存和磁盘状态,而使用

virsh的外部实时快照则支持保存内存状态和/或磁盘状态。- 脱机快照

基于已关闭的 VM Guest 创建的快照。由于 Guest 的所有进程已停止且未使用任何内存,因此此类快照可确保数据完整性。

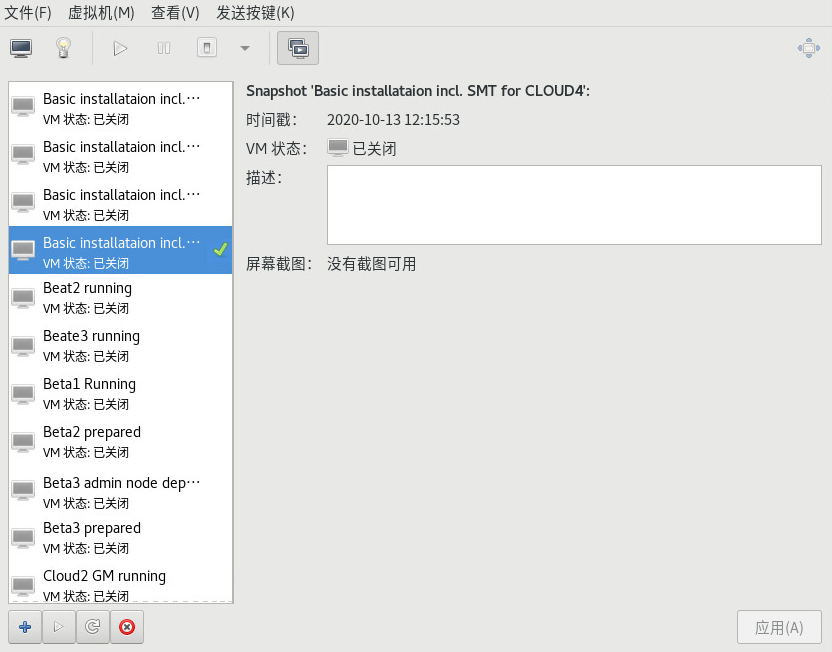

11.5.2 使用虚拟机管理器创建和管理快照 #

虚拟机管理器仅支持实时或脱机的内部快照。

要在虚拟机管理器中打开快照管理视图,请按照第 11.2.1.1 节 “使用虚拟机管理器打开图形控制台”中所述打开 VNC 窗口。现在请选择 › ,或单击工具栏中的。

所选 VM Guest 的现有快照列表显示在窗口的左侧。上次启动的快照带有绿色对勾标记。窗口的右侧显示列表中当前标记的快照的细节。这些细节包括快照的标题和时戳、截取快照时 VM Guest 的状态以及说明。运行中 Guest 的快照还包括一个屏幕截图。可以直接在此视图中更改。其他快照数据不可更改。

11.5.2.1 创建快照 #

要截取 VM Guest 的新快照,请执行以下操作:

(可选)如果您要创建脱机快照,请关闭 VM Guest。

单击 VNC 窗口左下角的。

窗口即会打开。

提供和说明(可选)。截取快照后将无法更改该名称。为方便以后识别该快照,请使用“自述性名称”。

单击确认。

11.5.2.2 删除快照 #

要删除 VM Guest 的快照,请执行以下操作:

单击 VNC 窗口左下角的。

单击确认删除。

11.5.2.3 启动快照 #

要启动快照,请执行以下操作:

单击 VNC 窗口左下角的。

单击确认启动。

11.5.3 使用 virsh 创建和管理快照 #

要列出某个域(以下示例中为 admin_server)的所有现有快照,请运行 snapshot-list 命令:

tux > virsh snapshot-list --domain sle-ha-node1

Name Creation Time State

------------------------------------------------------------

sleha_12_sp2_b2_two_node_cluster 2016-06-06 15:04:31 +0200 shutoff

sleha_12_sp2_b3_two_node_cluster 2016-07-04 14:01:41 +0200 shutoff

sleha_12_sp2_b4_two_node_cluster 2016-07-14 10:44:51 +0200 shutoff

sleha_12_sp2_rc3_two_node_cluster 2016-10-10 09:40:12 +0200 shutoff

sleha_12_sp2_gmc_two_node_cluster 2016-10-24 17:00:14 +0200 shutoff

sleha_12_sp3_gm_two_node_cluster 2017-08-02 12:19:37 +0200 shutoff

sleha_12_sp3_rc1_two_node_cluster 2017-06-13 13:34:19 +0200 shutoff

sleha_12_sp3_rc2_two_node_cluster 2017-06-30 11:51:24 +0200 shutoff

sleha_15_b6_two_node_cluster 2018-02-07 15:08:09 +0100 shutoff

sleha_15_rc1_one-node 2018-03-09 16:32:38 +0100 shutoff

使用 snapshot-current 命令显示上次启动的快照:

tux > virsh snapshot-current --domain admin_server

Basic installation incl. SMT for CLOUD4

运行 snapshot-info 命令可以获取有关特定快照的细节:

tux > virsh snapshot-info --domain admin_server \

-name "Basic installation incl. SMT for CLOUD4"

Name: Basic installation incl. SMT for CLOUD4

Domain: admin_server

Current: yes

State: shutoff

Location: internal

Parent: Basic installation incl. SMT for CLOUD3-HA

Children: 0

Descendants: 0

Metadata: yes11.5.3.1 创建内部快照 #

要截取 VM Guest 的内部快照(实时或脱机快照),请按如下所示使用 snapshot-create-as 命令:

tux > virsh snapshot-create-as --domain admin_server1 --name "Snapshot 1"2 \

--description "First snapshot"311.5.3.2 创建外部快照 #

使用 virsh 可以截取 Guest 内存状态和/或磁盘状态的外部快照。

要同时截取 Guest 磁盘的实时和脱机外部快照,请指定 --disk-only 选项:

tux > virsh snapshot-create-as --domain admin_server --name \

"Offline external snapshot" --disk-only

可以指定 --diskspec 选项来控制外部文件的创建方式:

tux > virsh snapshot-create-as --domain admin_server --name \

"Offline external snapshot" \

--disk-only --diskspec vda,snapshot=external,file=/path/to/snapshot_file

要截取 Guest 内存的实时外部快照,请指定 --live 和 --memspec 选项:

tux > virsh snapshot-create-as --domain admin_server --name \

"Offline external snapshot" --live \

--memspec snapshot=external,file=/path/to/snapshot_file

要截取 Guest 磁盘和内存状态的实时外部快照,请将 --live、--diskspec 和 --memspec 选项结合使用:

tux > virsh snapshot-create-as --domain admin_server --name \

"Offline external snapshot" --live \

--memspec snapshot=external,file=/path/to/snapshot_file

--diskspec vda,snapshot=external,file=/path/to/snapshot_file

有关更多细节,请参见 man 1 virsh 中的“快照命令”部分。

11.5.3.3 删除快照 #

无法使用 virsh 删除外部快照。要删除 VM Guest 的内部快照并恢复其占用的磁盘空间,请使用 snapshot-delete 命令:

tux > virsh snapshot-delete --domain admin_server --snapshotname "Snapshot 2"11.5.3.4 启动快照 #

要启动快照,请使用 snapshot-revert 命令:

tux > virsh snapshot-revert --domain admin_server --snapshotname "Snapshot 1"

要启动当前快照(用于启动 VM Guest 的快照),使用 --current 便已足够,不需要指定快照名称:

tux > virsh snapshot-revert --domain admin_server --current11.6 删除 VM Guest #

默认情况下,使用 virsh 删除 VM Guest 只会去除其 XML 配置。由于默认不会删除挂接的储存设备,因此您可以在另一个 VM Guest 上重复使用该储存设备。使用虚拟机管理器还可以删除 Guest 的储存文件 — 这会彻底擦除该 Guest。

11.6.1 使用虚拟机管理器删除 VM Guest #

在虚拟机管理器中,右键单击某个 VM Guest 项。

从上下文菜单中选择。

一个确认窗口即会打开。单击会永久擦除该 VM Guest。该删除操作不可恢复。

您还可以通过激活来永久删除 Guest 的虚拟磁盘。该删除操作也不可恢复。

11.6.2 使用 virsh 删除 VM Guest #

要删除 VM Guest,需先将其关闭。无法删除运行中的 Guest。有关关机的信息,请参见第 11.3 节 “更改 VM Guest 的状态:启动、停止、暂停”。

要使用 virsh 删除 VM Guest,请运行 virsh undefine

VM_NAME。

tux > virsh undefine sles12没有可自动删除挂接的储存文件的选项。如果这些文件由 libvirt 管理,请按照第 9.2.1.4 节 “从储存池中删除卷”中所述将其删除。

11.7 迁移 VM Guest #

虚拟化的主要优势之一是 VM Guest 可移植。当某台 VM 主机服务器出于维护目的而需要关闭时,或者当该主机过载时,可以轻松将 Guest 迁移到另一台 VM 主机服务器。KVM 和 Xen 甚至支持“实时”迁移,在此期间,VM Guest 仍然可用。

11.7.1 迁移要求 #

要成功将 VM Guest 迁移到另一台 VM 主机服务器,需符合以下要求:

建议源系统和目标系统采用相同的体系结构。

这两台计算机必须均可访问储存设备(例如,通过 NFS 或 iSCSI),并且必须将储存设备配置为这两台计算机上的储存池。有关更多信息,请参见第 13 章 “高级储存主题”。

在迁移期间连接的 CD-ROM 或软盘映像也需要符合此要求。不过,您可以按照第 14.11 节 “使用虚拟机管理器弹出和更换软盘或 CD/DVD-ROM 媒体”中所述在迁移之前断开其连接。

这两台 VM 主机服务器上都需要运行

libvirtd,并且您必须能够打开从目标主机到源主机(或反向)的远程libvirt连接。有关详细信息,请参考 第 12.3 节 “配置远程连接”。如果目标主机上在运行防火墙,则需要打开端口以允许迁移。如果您在迁移期间不指定端口,

libvirt将从 49152:49215 范围内选择一个端口。确保在目标主机上的防火墙中打开此端口范围(建议)或所选的专用端口。主机和目标计算机应位于网络上的同一子网中,否则迁移后网络功能无法正常工作。

参与迁移的所有 VM 主机服务器必须具有 qemu 用户的相同 UID,并具有 kvm、qemu 和 libvirt 组的相同 GID。

目标主机上不能存在正在运行或已暂停的同名 VM Guest。如果存在已关闭的同名计算机,其配置将被重写。

迁移 VM Guest 时支持除主机 CPU 型号以外的所有 CPU 型号。

SATA 磁盘设备类型不可迁移。

文件系统直通功能不可迁移。

需在 VM 主机服务器和 VM Guest 上安装适当的计时功能。请参见第 19 章 “VM Guest 时钟设置”。

无法将物理设备从主机迁移到 Guest。目前,在使用具有 PCI 直通或 SR-IOV 功能的设备时,不支持实时迁移。如果需要支持实时迁移,则需使用软件虚拟化(半虚拟化或全虚拟化)。

缓存模式设置是重要的迁移设置。请参见 第 18.5 节 “缓存模式对实时迁移的影响”。

不支持向后迁移(例如,从 SLES 15 SP2 迁移到 15 SP1)。

SUSE 正致力于支持将 VM Guest 从运行 LTSS 所涵盖的服务包的 VM 主机服务器,迁移到运行同一 SLES 主要版本中更新的服务包的 VM 主机服务器。例如,将 VM Guest 从 SLES 12 SP2 主机迁移到 SLES 12 SP5 主机。对于从 LTSS 迁移到更新的服务包的方案,SUSE 只会执行极简单的测试,建议在尝试迁移关键的 VM Guest 之前执行全面的现场测试。

在两台主机上,映像目录应位于同一路径中。

所有主机的微代码级别(尤其是 spectre 微代码更新)应该相同。在所有主机上安装 SUSE Linux Enterprise Server 的最新更新即可实现此目的。

11.7.2 使用虚拟机管理器进行迁移 #

使用虚拟机管理器迁移 VM Guest 时,在哪台计算机上启动虚拟机管理器并不重要。您可以在源主机或目标主机上启动虚拟机管理器,甚至可以在这两台之外的主机上启动。对于后一种情况,您需要能够同时与目标主机和源主机建立远程连接。

启动虚拟机管理器,并与目标主机或源主机建立连接。如果虚拟机管理器不是在目标主机或源主机上启动的,则需要与这两台主机都建立连接。

右键单击要迁移的 VM Guest,然后选择。确保该 Guest 正在运行或已暂停 — 关闭的 Guest 无法迁移。

提示:提高迁移速度要将迁移速度提高到一定程度,请暂停 VM Guest。这相当于使用前面所述的虚拟机管理器中的“脱机迁移”选项。

为 VM Guest 选择一个。如果所需的目标主机未显示,请确保您已连接到该主机。

要更改用于连接到远程主机的默认选项,请在下设置,以及目标主机的(IP 地址或主机名)和。如果指定了,还必须指定。

在下,选择迁移是永久性的(默认设置)还是暂时性的(使用)。

此外我们还提供了一个选项,它允许在不禁用 VM 主机服务器缓存的情况下进行迁移。这样可以加速迁移,但仅当当前配置能够在不使用

cache="none"/0_DIRECT的情况下提供一致的 VM Guest 储存信息时,此选项才起作用。注意:带宽选项在最近的虚拟机管理器版本中,去除了用于设置迁移带宽的选项。要设置特定的带宽,请改用

virsh。要执行迁移,请单击。

迁移完成后,窗口将会关闭,该 VM Guest 随即列在虚拟机管理器窗口中的新主机上。原始 VM Guest 仍可在目标主机上使用(处于关机状态)。

11.7.3 使用 virsh 进行迁移 #

要使用 virsh

migrate 迁移 VM Guest,您需要能够直接访问或者通过外壳远程访问 VM 主机服务器,因为命令需在主机上运行。迁移命令如下所示:

tux > virsh migrate [OPTIONS] VM_ID_or_NAME CONNECTION_URI [--migrateuri tcp://REMOTE_HOST:PORT]

下面列出了最重要的选项。有关完整列表,请参见 virsh help migrate。

--live执行实时迁移。如果未指定此选项,Guest 将会在迁移期间暂停(“脱机迁移”)。

--suspend执行脱机迁移,且不重启动目标主机上的 VM Guest。

--persistent默认情况下,迁移的 VM Guest 只是暂时性迁移,因此 Guest 关闭后,系统会自动在目标主机上删除其配置。使用此开关可使迁移变为永久性迁移。

--undefinesource如果指定此选项,成功迁移后,将删除源主机上的 VM Guest 定义(但不会删除挂接到此 Guest 的虚拟磁盘)。

--parallel --parallel-connections NUM_OF_CONNECTIONS当单个迁移线程无法使源主机与目标主机之间的网络链接饱和时,可以使用并行迁移来提高迁移数据吞吐量。在具备 40 GB 网络接口的主机上,可能需要四个迁移线程才能使链接饱和。使用并行迁移可以大幅缩短迁移大内存 VM 所需的时间。

以下示例使用 mercury.example.com 作为源系统,使用 jupiter.example.com 作为目标系统;VM Guest 的名称为 opensuse131,ID 为 37。

- 使用默认参数进行脱机迁移

tux >virsh migrate 37 qemu+ssh://tux@jupiter.example.com/system- 使用默认参数进行瞬态实时迁移

tux >virsh migrate --live opensuse131 qemu+ssh://tux@jupiter.example.com/system- 永久性实时迁移;删除源上的 VM 定义

tux >virsh migrate --live --persistent --undefinesource 37 \ qemu+tls://tux@jupiter.example.com/system- 使用端口 49152 进行脱机迁移

tux >virsh migrate opensuse131 qemu+ssh://tux@jupiter.example.com/system \ --migrateuri tcp://@jupiter.example.com:49152

默认情况下,virsh migrate 为目标主机上的 VM Guest 创建暂时性(瞬态)副本。已关机版本的原始 Guest 说明将保留在源主机上。瞬态副本将会在 Guest 关机后从服务器中删除。

要为目标主机上的 Guest 创建永久副本,请使用开关 --persistent。已关机版本的原始 Guest 说明也会保留在源主机上。将选项 --undefinesource 与 --persistent 搭配使用可以实现“真正的”迁移,在此情况下,将在目标主机上创建永久副本,并删除源主机上的版本。

不建议只使用 --undefinesource 而不使用 --persistent 选项,因为这会导致两个 VM Guest 定义均会在目标主机上的 Guest 关闭后丢失。

11.7.4 分步操作示例 #

11.7.4.1 导出储存设备 #

首先需要导出储存区,以便在主机之间共享 Guest 映像。可以通过一台 NFS 服务器完成此操作。在下面的示例中,我们想要共享网络 10.0.1.0/24 中所有计算机的 /volume1/VM 目录。我们将使用一台 SUSE Linux Enterprise NFS 服务器。以 root 用户身份编辑 /etc/exports 文件并添加以下内容:

/volume1/VM 10.0.1.0/24 (rw,sync,no_root_squash)

您需要重启动该 NFS 服务器:

tux >sudosystemctl restart nfsservertux >sudoexportfs /volume1/VM 10.0.1.0/24

11.7.4.2 在目标主机上定义池 #

在您要迁移 VM Guest 的每台主机上,必须定义池才能访问卷(其中包含 Guest 映像)。我们的 NFS 服务器 IP 地址为 10.0.1.99,它的共享是 /volume1/VM 目录,而我们想要将此共享挂载 /var/lib/libvirt/images/VM 目录中。池名称为 VM。要定义此池,请创建包含以下内容的 VM.xml 文件:

<pool type='netfs'>

<name>VM</name>

<source>

<host name='10.0.1.99'/>

<dir path='/volume1/VM'/>

<format type='auto'/>

</source>

<target>

<path>/var/lib/libvirt/images/VM</path>

<permissions>

<mode>0755</mode>

<owner>-1</owner>

<group>-1</group>

</permissions>

</target>

</pool>

然后使用 pool-define 命令将其装载到 libvirt:

root # virsh pool-define VM.xml

另一种定义此池的方法是使用 virsh 命令:

root # virsh pool-define-as VM --type netfs --source-host 10.0.1.99 \

--source-path /volume1/VM --target /var/lib/libvirt/images/VM

Pool VM created

以下命令假设您在 virsh 的交互式外壳中操作,使用不带任何参数的 virsh 命令也可以访问该外壳。然后,可将池设置为在主机引导时自动启动(autostart 选项):

virsh # pool-autostart VM

Pool VM marked as autostarted如果您要禁用自动启动,请执行以下命令:

virsh # pool-autostart VM --disable

Pool VM unmarked as autostarted检查该池是否存在:

virsh #pool-list --all Name State Autostart ------------------------------------------- default active yes VM active yesvirsh #pool-info VM Name: VM UUID: 42efe1b3-7eaa-4e24-a06a-ba7c9ee29741 State: running Persistent: yes Autostart: yes Capacity: 2,68 TiB Allocation: 2,38 TiB Available: 306,05 GiB

请记住:必须在您要迁移其中的 VM Guest 的每台主机上定义此池。

11.7.4.3 创建卷 #

池已定义好,现在我们需要一个包含磁盘映像的卷。

virsh # vol-create-as VM sled12.qcow2 8G --format qcow2

Vol sled12.qcow2 created稍后将会通过 virt-install 使用所示的卷名称安装 Guest。

11.7.4.4 创建 VM Guest #

我们来使用 virt-install 命令创建一个 SUSE Linux Enterprise Server VM Guest。将使用 --disk 选项指定 VM 池;如果您不希望在执行迁移时使用 --unsafe 选项,建议您设置 cache=none。

root # virt-install --connect qemu:///system --virt-type kvm --name \

sled12 --memory 1024 --disk vol=VM/sled12.qcow2,cache=none --cdrom \

/mnt/install/ISO/SLE-12-Desktop-DVD-x86_64-Build0327-Media1.iso --graphics \

vnc --os-variant sled12

Starting install...

Creating domain...11.7.4.5 迁移 VM Guest #

一切准备就绪,现在可以执行迁移。在当前托管 VM Guest 的 VM 主机服务器上运行 migrate 命令,并选择目标。

virsh # migrate --live sled12 --verbose qemu+ssh://IP/Hostname/system Password: Migration: [ 12 %]

11.8 监视 #

11.8.1 使用虚拟机管理器进行监视 #

启动虚拟机管理器并连接到 VM 主机服务器后,所有运行中 Guest 的 CPU 使用率图表将会显示。

您也可以通过此工具获取有关磁盘和网络使用情况的信息,不过必须先在中激活此功能:

运行

virt-manager。选择 › 。

从选项卡切换到。

激活您要查看的活动类型对应的复选框:、 和。

如果需要,还可以使用来更改更新间隔。

关闭对话框。

在 › 下激活应显示的图表。

此后,磁盘和网络统计信息也会显示在虚拟机管理器的主窗口中。

可以从 VNC 窗口获取更精确的数据。按照第 11.2.1 节 “打开图形控制台”中所述打开 VNC 窗口。在工具栏或菜单中选择。可以通过左侧树菜单中的项显示统计信息。

11.8.2 使用 virt-top 进行监视 #

virt-top 是一个命令行工具,与众所周知的进程监视工具 top 类似。virt-top 使用 libvirt,因此能够显示不同超级管理程序上运行的 VM Guest 的统计信息。建议使用 virt-top,而不要使用 xentop 等特定于超级管理程序的工具。

virt-top 默认会显示所有运行中 VM Guest 的统计信息。显示的数据包括已用内存百分比 (%MEM)、已用 CPU 百分比 (%CPU),以及 Guest 的运行时长 (TIME)。数据会定期更新(默认为每三秒更新一次)。下面显示了某台 VM 主机服务器上的输出,该服务器包含七个 VM Guest,其中有四个处于非活动状态:

virt-top 13:40:19 - x86_64 8/8CPU 1283MHz 16067MB 7.6% 0.5%

7 domains, 3 active, 3 running, 0 sleeping, 0 paused, 4 inactive D:0 O:0 X:0

CPU: 6.1% Mem: 3072 MB (3072 MB by guests)

ID S RDRQ WRRQ RXBY TXBY %CPU %MEM TIME NAME

7 R 123 1 18K 196 5.8 6.0 0:24.35 sled12_sp1

6 R 1 0 18K 0 0.2 6.0 0:42.51 sles12_sp1

5 R 0 0 18K 0 0.1 6.0 85:45.67 opensuse_leap

- (Ubuntu_1410)

- (debian_780)

- (fedora_21)

- (sles11sp3)输出默认按 ID 排序。使用以下组合键可以更改排序字段:

| Shift–P:CPU 使用率 |

| Shift–M:Guest 分配的内存总量 |

| Shift–T:时间 |

| Shift–I:ID |

要使用任何其他字段进行排序,请按 Shift–F 并从列表中选择一个字段。要切换排序顺序,请使用 Shift–R。

virt-top 还支持基于 VM Guest 数据生成不同的视图,按以下键可以即时更改视图:

| 0:默认视图 |

| 1:显示物理 CPU |

| 2:显示网络接口 |

| 3:显示虚拟磁盘 |

virt-top 支持使用更多热键来更改数据视图,并支持许多可以影响程序行为的命令行开关。有关详细信息,请参见 man 1 virt-top。

11.8.3 使用 kvm_stat 进行监视 #

kvm_stat 可用于跟踪 KVM 性能事件。它会监视 /sys/kernel/debug/kvm,因此需要挂载 debugfs。SUSE Linux Enterprise Server 上默认应该已挂载 debugfs。如果未挂载,请使用以下命令:

tux >sudomount -t debugfs none /sys/kernel/debug

可采用三种不同的模式使用 kvm_stat:

kvm_stat # update in 1 second intervals

kvm_stat -1 # 1 second snapshot

kvm_stat -l > kvmstats.log # update in 1 second intervals in log format

# can be imported to a spreadsheetkvm_stat 的典型输出 #kvm statistics efer_reload 0 0 exits 11378946 218130 fpu_reload 62144 152 halt_exits 414866 100 halt_wakeup 260358 50 host_state_reload 539650 249 hypercalls 0 0 insn_emulation 6227331 173067 insn_emulation_fail 0 0 invlpg 227281 47 io_exits 113148 18 irq_exits 168474 127 irq_injections 482804 123 irq_window 51270 18 largepages 0 0 mmio_exits 6925 0 mmu_cache_miss 71820 19 mmu_flooded 35420 9 mmu_pde_zapped 64763 20 mmu_pte_updated 0 0 mmu_pte_write 213782 29 mmu_recycled 0 0 mmu_shadow_zapped 128690 17 mmu_unsync 46 -1 nmi_injections 0 0 nmi_window 0 0 pf_fixed 1553821 857 pf_guest 1018832 562 remote_tlb_flush 174007 37 request_irq 0 0 signal_exits 0 0 tlb_flush 394182 148

有关如何解释这些值的更多信息,请参见 http://clalance.blogspot.com/2009/01/kvm-performance-tools.html。

12 连接和授权 #

如果您要管理多个 VM 主机服务器,而每个服务器又托管了多个 VM Guest,那么管理工作很快就会变得困难起来。libvirt 的一个优势是,它能够一次连接到多个 VM 主机服务器,提供单个接口用于管理所有 VM Guest 以及连接其图形控制台。

为确保只有授权用户能够建立连接,libvirt 提供了多种可与不同授权机制(套接字、PolKit、SASL 和 Kerberos)结合使用的连接类型(通过 TLS、SSH、Unix 套接字和 TCP)。

12.1 身份验证 #

有权管理 VM Guest 和访问其图形控制台的用户应该限定在明确定义的人员范围内。为实现此目标,可在 VM 主机服务器上使用以下身份验证方法:

使用权限和组所有权对 Unix 套接字进行访问控制。此方法仅适用于

libvirtd连接。使用 PolKit 对 Unix 套接字进行访问控制。此方法仅适用于本地

libvirtd连接。使用 SASL(简单身份验证和安全层)进行用户名和口令身份验证。此方法适用于

libvirtd和 VNC 连接。使用 SASL 不需要在服务器上拥有实际的用户帐户,因为 SASL 使用自己的数据库来储存用户名和口令。通过 SASL 进行身份验证的连接会加密。Kerberos 身份验证。此方法仅适用于